DeepSeek hat DeepSeek V3.2 als Nachfolger seiner V3.x-Reihe veröffentlicht sowie die begleitende Variante DeepSeek-V3.2-Speciale, die das Unternehmen als leistungsstarke, auf Schlussfolgern ausgerichtete Edition für Agenten-/Tool-Nutzung positioniert. V3.2 baut auf experimentellen Arbeiten (V3.2-Exp) auf und führt eine höhere Schlussfolgerungsfähigkeit, eine für „Gold-Niveau“-Leistungen in Mathematik/Wettbewerbsprogrammierung optimierte Speciale-Edition sowie ein laut DeepSeek weltweit erstmaliges Dual-Mode-System „Thinking + Tool“ ein, das internes schrittweises Denken eng mit externer Tool-Ausführung und Agent-Workflows integriert.

Was ist DeepSeek V3.2 — und wie unterscheidet sich V3.2-Speciale?

DeepSeek-V3.2 ist der offizielle Nachfolger von DeepSeeks experimentellem V3.2-Exp-Zweig. DeepSeek beschreibt es als eine „reasoning-first“ Modelfamilie für Agenten, also Modelle, die nicht nur auf natürliche Gesprächsqualität, sondern speziell auf mehrstufige Inferenz, Tool-Aufrufe und zuverlässiges Chain-of-Thought-artiges Schlussfolgern abgestimmt sind, wenn sie in Umgebungen mit externen Tools (APIs, Code-Ausführung, Datenkonnektoren) arbeiten.

Was ist DeepSeek-V3.2 (Basis)

- Positioniert als Mainstream-Produktionsnachfolger der experimentellen V3.2-Exp-Linie; vorgesehen für breite Verfügbarkeit über DeepSeeks App/Web/API.

- Hält ein Gleichgewicht zwischen Recheneffizienz und robustem Schlussfolgern für agentische Aufgaben.

Was ist DeepSeek-V3.2-Speciale

DeepSeek-V3.2-Speciale ist eine Variante, die DeepSeek als leistungsstärkere „Special Edition“ vermarktet, abgestimmt auf Schlussfolgern auf Wettbewerbsniveau, fortgeschrittene Mathematik und Agentenleistung. Vermarktet als Variante mit höherer Leistungsfähigkeit, die „die Grenzen der Schlussfolgerungsfähigkeiten verschiebt“. DeepSeek stellt Speciale derzeit als reines API-Modell mit temporärem Zugriffsrouting bereit; frühe Benchmarks deuten darauf hin, dass es so positioniert ist, dass es bei Schlussfolgerungs- und Coding-Benchmarks mit hochwertigen geschlossenen Modellen konkurriert.

Welche Entwicklungslinie und technischen Entscheidungen führten zu V3.2?

V3.2 erbt eine Entwicklungslinie iterativer technischer Arbeit, die DeepSeek im Laufe des Jahres 2025 veröffentlicht hat: V3 → V3.1 (Terminus) → V3.2-Exp (ein experimenteller Schritt) → V3.2 → V3.2-Speciale. Das experimentelle V3.2-Exp führte DeepSeek Sparse Attention (DSA) ein — einen feingranularen Sparse-Attention-Mechanismus, der Speicher- und Rechenkosten für sehr lange Kontextlängen senken soll, während die Ausgabequalität erhalten bleibt. Diese DSA-Forschung und die Arbeit zur Kostensenkung dienten als technischer Zwischenschritt für die offizielle V3.2-Familie.

Was ist neu in DeepSeek 3.2?

1) Verbesserte Schlussfolgerungsfähigkeit — wie wurde das Schlussfolgern verbessert?

DeepSeek vermarktet V3.2 als „reasoning-first“. Das bedeutet, dass Architektur und Fine-Tuning darauf ausgerichtet sind, mehrstufige Inferenz zuverlässig auszuführen, interne Gedankengänge aufrechtzuerhalten und die Art strukturierter Überlegung zu unterstützen, die Agenten benötigen, um externe Tools korrekt zu verwenden.

Konkret umfassen die Verbesserungen:

- Training und RLHF (oder ähnliche Alignment-Verfahren), die darauf abgestimmt sind, explizite schrittweise Problemlösung und stabile Zwischenzustände zu fördern (nützlich für mathematisches Schlussfolgern, mehrstufige Code-Generierung und Logikaufgaben).

- Architektur- und Loss-Function-Entscheidungen, die längere Kontextfenster bewahren und es dem Modell ermöglichen, mit hoher Genauigkeit auf frühere Schlussfolgerungsschritte Bezug zu nehmen.

- Praktische Modi (siehe „Dual-Mode“ unten), die es demselben Modell erlauben, entweder in einem schnelleren „Chat“-Modus oder in einem deliberativen „Thinking“-Modus zu arbeiten, in dem es absichtlich Zwischenschritte durchläuft, bevor es handelt.

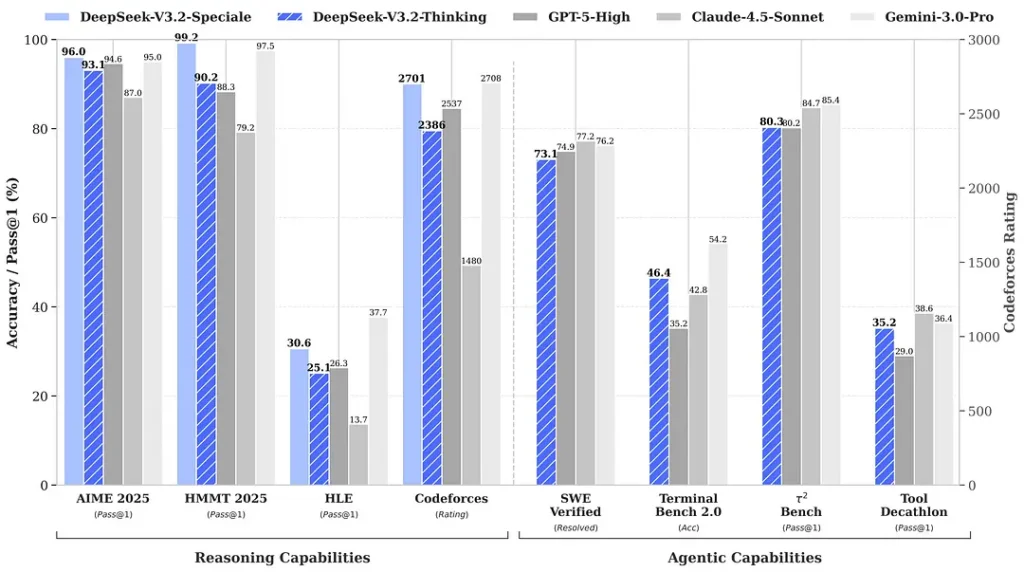

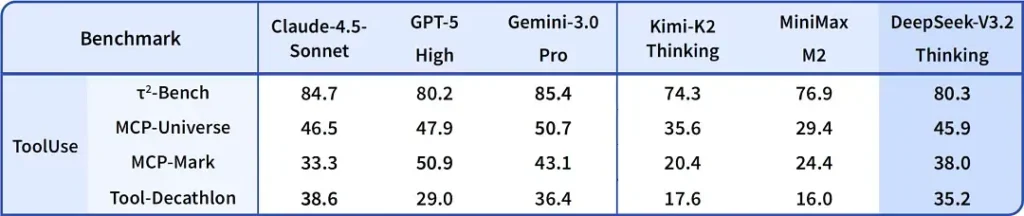

In Benchmarks rund um die Veröffentlichung werden deutliche Zugewinne bei Mathematik- und Reasoning-Suiten genannt; unabhängige frühe Community-Benchmarks berichten ebenfalls von beeindruckenden Ergebnissen auf wettbewerbsorientierten Evaluationssets:

2) Durchbruchleistung in der Special Edition — wie viel besser?

DeepSeek-V3.2-Speciale soll im Vergleich zum Standard-V3.2 einen Leistungssprung bei der Genauigkeit des Schlussfolgerns und der Agenten-Orchestrierung liefern. Der Anbieter positioniert Speciale als Leistungsstufe für rechenintensive Schlussfolgerungs-Workloads und anspruchsvolle Agentenaufgaben; es ist derzeit nur per API verfügbar und wird als temporärer Endpoint mit höherer Leistungsfähigkeit angeboten (DeepSeek gab an, dass die Verfügbarkeit von Speciale zunächst begrenzt sein wird). Die Speciale-Version integriert das vorherige mathematische Modell DeepSeek-Math-V2; sie kann mathematische Theoreme beweisen und logisches Schlussfolgern selbstständig verifizieren; sie hat in mehreren Weltklasse-Wettbewerben bemerkenswerte Ergebnisse erzielt:

- 🥇 IMO (Internationale Mathematik-Olympiade) Goldmedaille

- 🥇 CMO (Chinesische Mathematik-Olympiade) Goldmedaille

- 🥈 ICPC (Internationaler Programmierwettbewerb) Zweiter Platz (Wettbewerb für Menschen)

- 🥉 IOI (Internationale Olympiade für Informatik) Zehnter Platz (Wettbewerb für Menschen)

| Benchmark | GPT-5 High | Gemini-3.0 Pro | Kimi-K2 Thinking | DeepSeek-V3.2 Thinking | DeepSeek-V3.2 Speciale |

|---|---|---|---|---|---|

| AIME 2025 | 94.6 (13k) | 95.0 (15k) | 94.5 (24k) | 93.1 (16k) | 96.0 (23k) |

| HMMT Feb 2025 | 88.3 (16k) | 97.5 (16k) | 89.4 (31k) | 92.5 (19k) | 99.2 (27k) |

| HMMT Nov 2025 | 89.2 (20k) | 93.3 (15k) | 89.2 (29k) | 90.2 (18k) | 94.4 (25k) |

| IMOAnswerBench | 76.0 (31k) | 83.3 (18k) | 78.6 (37k) | 78.3 (27k) | 84.5 (45k) |

| LiveCodeBench | 84.5 (13k) | 90.7 (13k) | 82.6 (29k) | 83.3 (16k) | 88.7 (27k) |

| CodeForces | 2537 (29k) | 2708 (22k) | — | 2386 (42k) | 2701 (77k) |

| GPQA Diamond | 85.7 (8k) | 91.9 (8k) | 84.5 (12k) | 82.4 (7k) | 85.7 (16k) |

| HLE | 26.3 (15k) | 37.7 (15k) | 23.9 (24k) | 25.1 (21k) | 30.6 (35k) |

3) Weltweit erste Implementierung eines Dual-Mode-Systems „Thinking + Tool“

Eine der praktisch interessantesten Aussagen zu V3.2 ist ein Dual-Mode-Workflow, der zwischen schneller Konversationsnutzung und einem langsameren, deliberativen „Thinking“-Modus unterscheidet (und die Wahl zwischen beiden erlaubt), der eng mit der Tool-Nutzung verbunden ist.

- „Chat / fast“-Modus: Entwickelt für latenzarme, nutzergerichtete Chats mit prägnanten Antworten und weniger internen Reasoning-Spuren — gut für gelegentliche Hilfe, kurze Q&A und latenzsensitive Anwendungen.

- „Thinking / reasoner“-Modus: Optimiert für rigoroses Chain-of-Thought, schrittweise Planung und die Orchestrierung externer Tools (APIs, Datenbankabfragen, Code-Ausführung). Im Thinking-Modus erzeugt das Modell explizitere Zwischenschritte, die geprüft oder verwendet werden können, um in agentischen Systemen sichere und korrekte Tool-Aufrufe zu steuern.

Dieses Muster (ein Zwei-Modi-Design) war bereits in früheren experimentellen Zweigen vorhanden, und DeepSeek hat es in V3.2 und Speciale tiefer integriert — Speciale unterstützt derzeit ausschließlich den Thinking-Modus (daher die API-Zugangsbeschränkung). Die Möglichkeit, zwischen Geschwindigkeit und Deliberation umzuschalten, ist aus technischer Sicht wertvoll, weil Entwickler damit beim Aufbau von Agenten, die mit realen Systemen interagieren müssen, den richtigen Kompromiss zwischen Latenz und Zuverlässigkeit wählen können.

Warum das bemerkenswert ist: Viele moderne Systeme bieten entweder ein starkes Chain-of-Thought-Modell (zur Erklärung des Denkprozesses) oder eine separate Agenten-/Tool-Orchestrierungsschicht. DeepSeeks Darstellung deutet auf eine engere Kopplung hin — das Modell kann „denken“ und dann deterministisch Tools aufrufen und Tool-Antworten nutzen, um das anschließende Denken zu informieren — was für Entwickler beim Aufbau autonomer Agenten nahtloser ist.

Wo bekommt man DeepSeek v3.2

Kurze Antwort — Sie können DeepSeek v3.2 je nach Bedarf auf verschiedene Weise erhalten:

- Offizielles Web/App (online nutzen) — probieren Sie die DeepSeek-Weboberfläche oder die mobile App aus, um V3.2 interaktiv zu nutzen.

- API-Zugang — DeepSeek stellt V3.2 über seine API bereit (die Dokumentation enthält Modellnamen / base_url und Preise). Registrieren Sie sich für einen API-Schlüssel und rufen Sie den v3.2-Endpoint auf.

- Herunterladbare/offene Gewichte (Hugging Face) — das Modell (V3.2 / V3.2-Exp-Varianten) ist auf Hugging Face veröffentlicht und kann heruntergeladen werden (Open-Weight). Verwenden Sie

huggingface-hubodertransformers, um die Dateien abzurufen. - CometAPI — Eine KI-API-Aggregationsplattform stellt gehostete Endpoints für V3.2-Exp bereit. Der Preis ist günstiger als der offizielle Preis.

Ein paar praktische Hinweise:

- Wenn Sie Gewichte für die lokale Ausführung möchten, gehen Sie zur Modellseite auf Hugging Face (akzeptieren Sie dort etwaige Lizenz-/Zugriffsbedingungen) und verwenden Sie

huggingface-cliodertransformerszum Download; das GitHub-Repository zeigt in der Regel die genauen Befehle. - Wenn Sie Produktionseinsatz per API möchten, folgen Sie der Plattform Ihrer Wahl, etwa der API-Dokumentation von cometapi, für Endpoint-Namen und die korrekte

base_urlfür die V3.2-Variante.

DeepSeek-V3.2-Speciale:* Nur für Forschungszwecke offen, unterstützt den Dialog im „Thinking Mode“, unterstützt jedoch keine Tool-Aufrufe.

- Die maximale Ausgabe kann 128K Token erreichen (ultralange Thinking Chain).

- Derzeit bis zum 15. Dezember 2025 kostenlos testbar.

Abschließende Gedanken

DeepSeek-V3.2 stellt einen bedeutsamen Schritt in der Reifung von auf Schlussfolgern ausgerichteten Modellen dar. Seine Kombination aus verbessertem mehrstufigem Schlussfolgern, spezialisierten Hochleistungseditionen (Speciale) und einer produktionsreifen Integration von „Thinking + Tool“ ist bemerkenswert für alle, die fortgeschrittene Agenten, Coding-Assistenten oder Forschungs-Workflows entwickeln, die Deliberation mit externen Aktionen verknüpfen müssen.

Entwickler können über CometAPI auf DeepSeek V3.2 zugreifen. Erkunden Sie zunächst die Modellfähigkeiten von CometAPI im Playground und konsultieren Sie den API-Leitfaden für detaillierte Anweisungen. Stellen Sie vor dem Zugriff bitte sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben. CometAPI bietet einen Preis, der deutlich unter dem offiziellen Preis liegt, um Ihnen die Integration zu erleichtern.

Bereit loszulegen?→ Melden Sie sich noch heute bei CometAPI an !

Wenn Sie weitere Tipps, Anleitungen und Neuigkeiten zu KI erfahren möchten, folgen Sie uns auf VK, X und Discord!