In der sich rasant entwickelnden Welt der künstlichen Intelligenz stellt die Veröffentlichung jedes neuen Large Language Model (LLM) mehr als nur einen numerischen Versionssprung dar – es signalisiert Fortschritte in den Bereichen logisches Denken, Programmierfähigkeit und Mensch-Maschine-Zusammenarbeit. Ende September 2025 Zhipu AI (Z.ai) enthüllt GLM-4.6, das neueste Mitglied der General Language Model-Familie. Aufbauend auf der robusten Architektur und der starken Argumentationsgrundlage von GLM-4.5 verfeinert dieses Update die Fähigkeiten des Modells in Agentisches Denken, Kodierungsintelligenz und Verständnis langfristiger Zusammenhänge, während es für Entwickler und Unternehmen gleichermaßen offen und zugänglich bleibt.

Was ist GLM-4.6?

GLM-4.6 ist eine Hauptversion der GLM-Reihe (General Language Model), die leistungsstarkes Reasoning mit praktischen Entwickler-Workflows in Einklang bringt. Im Wesentlichen zielt die Version auf drei eng miteinander verbundene Anwendungsfälle ab: (1) Erweiterte Codegenerierung und Reasoning über Code, (2) Aufgaben mit erweitertem Kontext, die ein Modellverständnis über sehr lange Eingaben hinweg erfordern, und (3) agentische Workflows, bei denen das Modell mehrstufige Prozesse planen, Tools aufrufen und orchestrieren muss. Das Modell wird in Varianten für Cloud-APIs und Community-Modell-Hubs bereitgestellt und ermöglicht sowohl gehostete als auch selbst gehostete Bereitstellungsmuster.

In der Praxis ist GLM-4.6 als Flaggschiff positioniert, das Entwickler in den Mittelpunkt stellt: Die Verbesserungen beschränken sich nicht nur auf reine Benchmark-Zahlen, sondern umfassen Funktionen, die die Art und Weise, wie Entwickler Assistenten, Code-Copiloten und dokumenten- oder wissensbasierte Agenten erstellen, grundlegend verändern. Erwarten Sie eine Version, die den Schwerpunkt auf die Befehlsoptimierung für die Tool-Nutzung, detaillierte Verbesserungen der Codequalität und des Debuggings sowie Infrastrukturentscheidungen legt, die sehr lange Kontexte ohne lineare Leistungseinbußen ermöglichen.

Welches Ziel verfolgt GLM-4.6 zu lösen?

- Reduzieren Sie die Reibungsverluste bei der Arbeit mit langen Codebasen und großen Dokumenten, indem Sie längere effektive Kontextfenster unterstützen.

- Verbessern Sie die Zuverlässigkeit der Codegenerierung und des Debuggens und erzeugen Sie idiomatischere, testbarere Ausgaben.

- Erhöhen Sie die Robustheit des Agentenverhaltens – Planung, Werkzeugnutzung und mehrstufige Aufgabenausführung – durch gezielte Anweisungen und Feinabstimmung im Verstärkungsstil.

Was hat sich in der Praxis von GLM-4.5 zu GLM-4.6 geändert?

- Kontextskalierung: 128K Sprung zu 200 Token ist die größte UX-/Architekturänderung für Benutzer: Lange Dokumente, ganze Codebasen oder erweiterte Agententranskripte können jetzt in einem einzigen Kontextfenster verarbeitet werden. Dies reduziert den Bedarf an Ad-hoc-Chunking oder aufwändigen Abrufschleifen für viele Workflows.

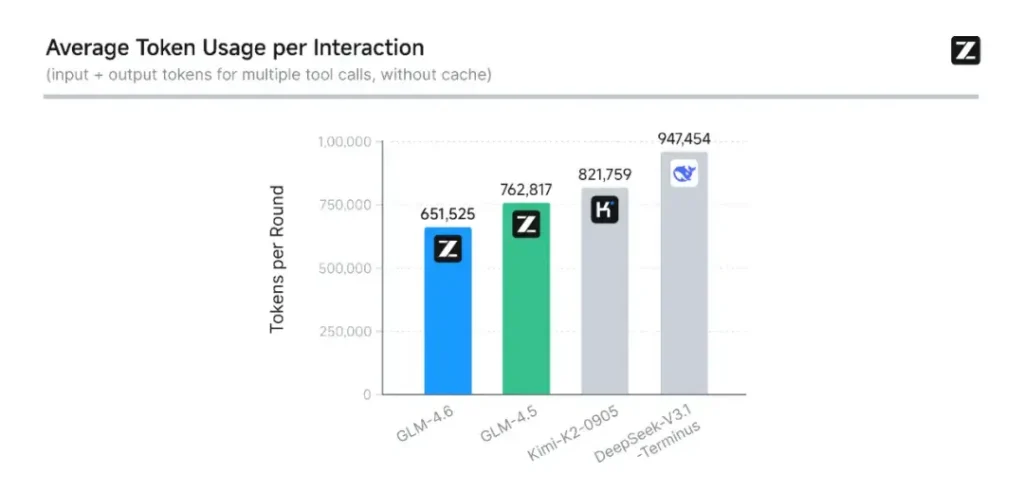

- Kodierung und Praxisbewertung: Z.ai erweiterte CC-Bench (ihren Kodierungs- und Fertigstellungs-Benchmark) mit schwierigeren, realen Aufgabentrajektorien und berichtet, dass GLM-4.6 Aufgaben mit ~15 % weniger Token als GLM-4.5 und verbessert gleichzeitig die Erfolgsraten bei komplexen Multi-Turn-Engineering-Aufgaben. Dies deutet auf eine bessere Token-Effizienz sowie auf Verbesserungen der Rohleistung in angewandten Codierungsszenarien hin. Z.ai

- Agenten- und Tool-Integration: GLM-4.6 enthält bessere Unterstützungsmuster für Toolaufrufe und Suchagenten – wichtig für Produkte, die auf das Modell angewiesen sind, um die Websuche, Codeausführung oder andere Microservices zu orchestrieren.

Was sind die Hauptfunktionen von GLM-4.6?

1. Erweitertes Kontextfenster auf 200 Token

Eines der auffälligsten Features von GLM-4.6 ist seine massiv erweitertes Kontextfenster. Erweiterung von 128K in der vorherigen Generation auf 200 TokenGLM-4.6 kann ganze Bücher, komplexe Datensätze mit mehreren Dokumenten oder stundenlange Dialoge in einer einzigen Sitzung verarbeiten. Diese Erweiterung verbessert nicht nur das Verständnis, sondern ermöglicht auch konsistente Argumentation über lange Eingaben – ein großer Fortschritt für die Dokumentzusammenfassung, Rechtsanalyse und Softwareentwicklungs-Workflows.

2. Verbesserte Codierungsintelligenz

Zhipu AI ist intern CC-Bank Benchmark, eine Reihe realer Programmieraufgaben, zeigt, dass GLM-4.6 deutliche Verbesserungen bei der Kodierungsgenauigkeit und -effizienzDas Modell kann syntaktisch korrekten, logisch einwandfreien Code erzeugen und dabei ca. 15 % weniger Token als GLM-4.5 für vergleichbare Aufgaben. Diese Token-Effizienz ermöglicht schnellere und kostengünstigere Abschlüsse ohne Qualitätseinbußen – ein entscheidender Faktor für den Einsatz in Unternehmen.

3. Erweiterte Argumentation und Tool-Integration

Über die Generierung von Rohtext hinaus glänzt GLM-4.6 in Werkzeuggestütztes Denken. Es wurde für die mehrstufige Planung und die Orchestrierung externer Systeme – von Datenbanken über Suchwerkzeuge bis hin zu Ausführungsumgebungen – trainiert und ausgerichtet. In der Praxis bedeutet dies, dass GLM-4.6 als „Gehirn“ eines autonomer KI-Agent, entscheiden, wann externe APIs aufgerufen werden, wie Ergebnisse interpretiert werden und wie die Aufgabenkontinuität über Sitzungen hinweg aufrechterhalten wird.

4. Verbesserte natürliche Sprachausrichtung

Durch kontinuierliches Verstärkungslernen und Präferenzoptimierung liefert GLM-4.6 flüssigerer Gesprächsfluss, bessere Stilanpassung und stärkere Sicherheitsausrichtung. Das Modell passt seinen Ton und seine Struktur an den Kontext an – sei es formelle Dokumentation, pädagogische Nachhilfe oder kreatives Schreiben – und verbessert so das Vertrauen der Benutzer und die Lesbarkeit.

Welche Architektur treibt GLM-4.6 an?

Ist GLM-4.6 ein Experten-Mix-Modell?

Inferenzmethode Kontinuität: Das GLM-Team weist darauf hin, dass GLM-4.5 und GLM-4.6 dieselbe grundlegende Inferenzpipeline nutzen, sodass bestehende Implementierungskonfigurationen mit minimalem Aufwand aktualisiert werden können. Dies reduziert das Betriebsrisiko für Teams, die bereits GLM-4.x verwenden – durch Skalierungsparameter und Modelldesignentscheidungen, die die Spezialisierung auf agentisches Denken, Codierung und effiziente Inferenz betonen. Der GLM-4.5-Bericht bietet die klarste öffentliche Beschreibung der MoE-Strategie und des Trainingsprogramms der Familie (mehrstufiges Vortraining, Expertenmodell-Iteration, Reinforcement Learning zur Ausrichtung); GLM-4.6 wendet diese Erkenntnisse an und optimiert gleichzeitig Kontextlänge und aufgabenspezifische Fähigkeiten.

Praktische Architekturhinweise für Ingenieure

- Parameter-Footprint vs. aktivierte Berechnung: Große Parametersummen (Hunderte von Milliarden) lassen sich nicht direkt in entsprechende Aktivierungskosten bei jeder Anfrage umrechnen. MoE bedeutet, dass pro Token-Sequenz nur eine Teilmenge von Experten aktiviert wird, was bei vielen Workloads zu einem günstigeren Kosten-/Durchsatz-Kompromiss führt.

- Token-Präzision und -Formate: Die öffentlichen Gewichte werden in den Formaten BF16 und F32 verteilt, und es erscheinen schnell Community-Quantisierungen (GGUF, 4-/8-/Bits); diese ermöglichen es Teams, GLM-4.6 auf verschiedenen Hardwareprofilen auszuführen.

- Kompatibilität des Inferenzstapels: Z.ai dokumentiert vLLM und andere moderne LLM-Laufzeiten als kompatible Inferenz-Backends, wodurch GLM-4.6 sowohl für Cloud- als auch für On-Premise-Bereitstellungen geeignet ist.

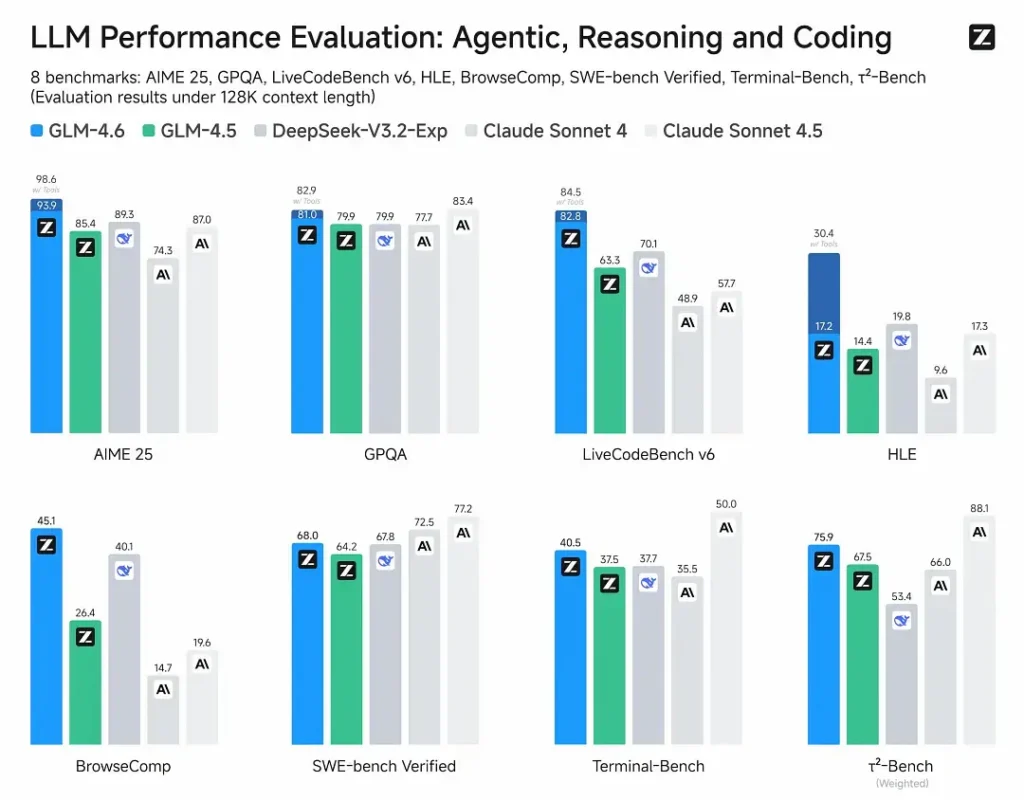

Benchmark-Leistung: Wie schlägt sich GLM-4.6?

Welche Benchmarks wurden gemeldet?

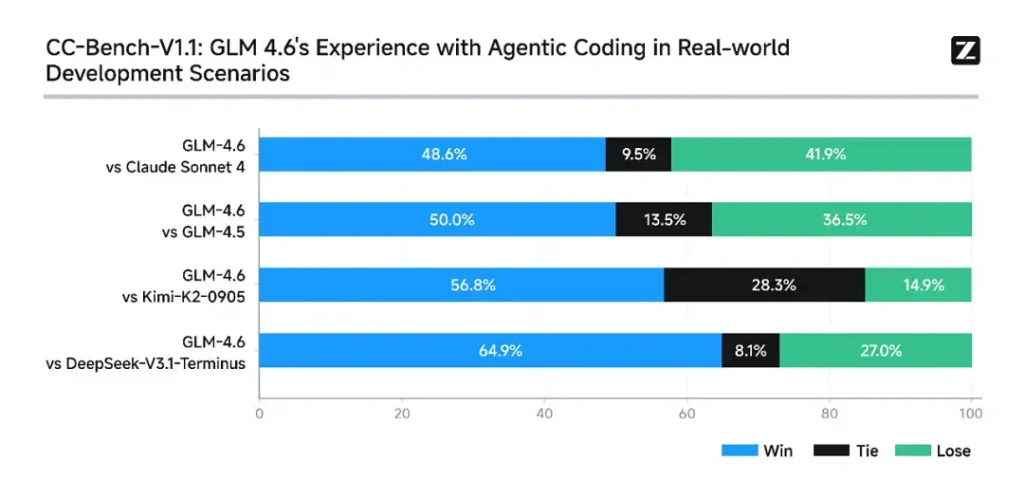

Z.ai hat GLM-4.6 anhand einer Reihe von acht öffentliche Benchmarks Die Plattform umfasst agentenbasierte Aufgaben, logisches Denken und Programmieren. Sie haben außerdem CC-Bench (einen von Menschen bewerteten, realen Programmier-Benchmark, der in Docker-isolierten Umgebungen ausgeführt wird) erweitert, um Produktionstechnikaufgaben (Front-End-Entwicklung, Tests, algorithmische Problemlösung) besser simulieren zu können. Bei diesen Aufgaben zeigte GLM-4.6 durchgängige Verbesserungen gegenüber GLM-4.5.

Codierleistung

- Echte Aufgaben gewinnen: In CC-Bench-Evaluierungen am Menschen erreichte GLM-4.6 nahezu Parität mit Anthropics Claude Sonnet 4 in Kopf-an-Kopf-Multiturn-Aufgaben – Z.ai berichtet von einem 48.6% Gewinnquote in ihren Docker-isolierten, von Menschen beurteilten Bewertungen (Interpretation: nahezu 50/50 mit Claude Sonnet 4 in ihrem kuratierten Set). Gleichzeitig übertraf GLM-4.6 bei seinen Aufgaben eine Reihe inländischer offener Modelle (z. B. DeepSeek-Varianten).

- Token-Effizienz: Z.ai-Berichte ~15 % weniger Token wird zum Abschließen von Aufgaben im Vergleich zu GLM-4.5 in CC-Bench-Trajektorien verwendet – dies ist sowohl für die Latenz als auch für die Kosten von Bedeutung.

Argumentation und Mathematik

GLM-4.6 verspricht im Vergleich zu GLM-4.5 eine verbesserte Denkfähigkeit und eine höhere Leistung bei der Tool-Nutzung. Während GLM-4.5 den Schwerpunkt auf hybride Denk- und Direktantwortmodi legte, erhöht GLM-4.6 die Robustheit für mehrstufiges Denken – insbesondere in Kombination mit Such- oder Ausführungstools.

Die öffentlichen Botschaften von Z.ai positionieren GLM-4.6 als konkurrenzfähig mit führenden internationalen und nationalen Modellen bei ihren gewählten Benchmarks – insbesondere konkurrenzfähig mit Claude Sonnet 4 und besser als bestimmte inländische Alternativen wie DeepSeek-Varianten bei Code-/Agent-Aufgaben. Aber bei einigen codierungsspezifischen Subbenchmarks** liegt GLM-4.6 immer noch hinter Claude Sonnet 4.5 (einer neueren Version von Anthropic), sodass es sich eher um einen engen Wettbewerb als um eine eindeutige Dominanz handelt.

So greifen Sie auf GLM-4.6 zu

- 1. Über die Z.ai-Plattform: Entwickler können direkt auf GLM-4.6 zugreifen über Z.ai's API or Chat-Schnittstelle (chat.z.ai). Diese gehosteten Dienste ermöglichen schnelles Experimentieren und Integrieren ohne lokale Bereitstellung. Die API unterstützt sowohl die Standardtextvervollständigung als auch strukturierte Tool-Aufrufmodi – unerlässlich für Agenten-Workflows.

- 2. Offene Gewichte auf Hugging Face und ModelScope: Für diejenigen, die eine lokale Steuerung bevorzugen, hat Zhipu AI GLM-4.6-Modelldateien veröffentlicht auf Gesicht umarmen kombiniert mit einem nachhaltigen Materialprofil. ModelScope, einschließlich Safetensor-Versionen in BF16 kombiniert mit einem nachhaltigen Materialprofil. F32 Präzision. Community-Entwickler haben bereits quantisierte GGUF-Versionen erstellt, die Inferenz auf GPUs für Verbraucher ermöglichen.

- 3. Integrationsrahmen: GLM-4.6 lässt sich nahtlos in wichtige Inferenzmaschinen integrieren, wie vLLM, SGLang und LMDeploy, wodurch es an moderne Server-Stacks anpassbar ist. Diese Vielseitigkeit ermöglicht Unternehmen die Wahl zwischen Cloud, Rand und On-Premise-Bereitstellung abhängig von Compliance- oder Latenzanforderungen.

CometAPI ist eine einheitliche API-Plattform, die über 500 KI-Modelle führender Anbieter – wie die GPT-Reihe von OpenAI, Gemini von Google, Claude von Anthropic, Midjourney, Suno und weitere – in einer einzigen, entwicklerfreundlichen Oberfläche vereint. Durch konsistente Authentifizierung, Anforderungsformatierung und Antwortverarbeitung vereinfacht CometAPI die Integration von KI-Funktionen in Ihre Anwendungen erheblich. Ob Sie Chatbots, Bildgeneratoren, Musikkomponisten oder datengesteuerte Analyse-Pipelines entwickeln – CometAPI ermöglicht Ihnen schnellere Iterationen, Kostenkontrolle und Herstellerunabhängigkeit – und gleichzeitig die neuesten Erkenntnisse des KI-Ökosystems zu nutzen.

Die neueste Integration GLM-4.6 wird bald auf CometAPI erscheinen, also bleiben Sie dran! Während wir den Upload des GLM 4.6-Modells abschließen, erkunden Sie unsere anderen Modelle auf der Seite „Modelle“ oder probieren Sie sie im AI Playground aus.

Entwickler können zugreifen GLM‑4.5 API über CometAPI, die neuste Modellversion wird immer mit der offiziellen Website aktualisiert. Erkunden Sie zunächst die Fähigkeiten des Modells in der Spielplatz und konsultieren Sie die API-Leitfaden Für detaillierte Anweisungen. Stellen Sie vor dem Zugriff sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben. CometAPI bieten einen Preis weit unter dem offiziellen Preis an, um Ihnen bei der Integration zu helfen.

Bereit loszulegen? → Melden Sie sich noch heute für CometAPI an !

Fazit – Warum GLM-4.6 jetzt wichtig ist

GLM-4.6 ist ein wichtiger Meilenstein in der GLM-Reihe, da es praktische Verbesserungen für Entwickler – längere Kontextfenster, gezielte Code- und Agentenoptimierungen sowie spürbare Benchmark-Gewinne – mit der Offenheit und Flexibilität des Ökosystems vereint, die sich viele Unternehmen wünschen. Für Teams, die Code-Assistenten, Agenten für Langformdokumente oder toolgestützte Automatisierungen entwickeln, ist GLM-4.6 ein vielversprechender Kandidat.