Seedance 2.0 ist ByteDances KI-Videogenerierungsmodell der nächsten Generation und wurde im März 2026 offiziell eingeführt. Es unterstützt Text-, Bild-, Audio- und Videoeingaben, kann bis zu 9 Bilder, 3 Videoclips und 3 Audioclips als Referenzen verwenden und ist auf Regie-Kontrolle, Bewegungsstabilität und gemeinsame Audio-Video-Generierung ausgelegt. In den aktuellen Blind-Vote-Ranglisten von Artificial Analysis führt Seedance 2.0 sowohl in den Kategorien Text-zu-Video als auch Bild-zu-Video ohne Audio mit Elo-Werten von 1269 bzw. 1351.

Was ist Seedance 2.0?

Seedance 2.0 ist das Videoerstellungsmodell der neuen Generation von ByteDance Seed. Offiziell basiert es auf einer einheitlichen multimodalen Architektur zur gemeinsamen Audio-Video-Generierung, die Text-, Bild-, Audio- und Videoeingaben akzeptiert, und ist als Creator-Tool mit ungewöhnlich breiten Referenz- und Bearbeitungsfähigkeiten positioniert. Seedance 2.0 wurde für industrielle Content-Workflows entwickelt und bietet in komplexen Bewegungsszenen eine stärkere physikalische Genauigkeit, Realitätsnähe, Steuerbarkeit und Stabilität als die vorherige Version 1.5. Im Gegensatz zu früheren Modellen, die sich hauptsächlich auf Text-zu-Video konzentrierten, führt Seedance 2.0 eine vollständig einheitliche multimodale Generierungspipeline ein und ermöglicht damit:

- Text-zu-Video-Generierung

- Bild-zu-Video-Animation

- Video-zu-Video-Bearbeitung

- Audio-synchronisierte Ausgabe

Damit ist es eine der umfassendsten Plattformen zur KI-Videoproduktion, die 2026 verfügbar sind.

Warum ist das wichtig?

Die meisten Videogeneratoren sind noch immer für einen relativ engen Workflow optimiert: Prompt rein, Clip raus. Seedance 2.0 geht weiter, indem es die Videogenerierung eher wie einen Regie-Arbeitsbereich behandelt. Laut ByteDance kann es mehrere Referenztypen gleichzeitig nutzen, die Konsistenz von Subjekten bewahren, detaillierten Anweisungen treuer folgen und sogar Kamerasprache auf eine stärker „regieartige“ Weise planen. Diese Kombination ist wichtig, weil die schwierigsten Probleme bei der Videogenerierung nicht nur Ästhetik betreffen, sondern auch Kontinuität, Bewegungskohärenz und Kontrolle darüber, was im Zeitverlauf passiert.

Was ist neu und welche Hauptfunktionen bietet Seedance 2.0?

Einheitliche multimodale Generierung

Die wichtigste Funktion ist die Fähigkeit des Modells, mehrere Modalitäten gemeinsam zu verarbeiten. Seedance 2.0 unterstützt bis zu 9 Bilder, 3 Videos und 3 Audioclips als Referenzen, zusammen mit Anweisungen in natürlicher Sprache, und kann Videos mit einer Länge von bis zu 15 Sekunden generieren. Praktisch bedeutet das, dass Sie nicht nur Subjekt und Szene steuern können, sondern auch Bewegungsstil, Kameraführung, Spezialeffekte und Audiohinweise in einem einzigen Generierungsdurchlauf.

Kontrolle auf Regie-Niveau

Seedance 2.0 ist außerdem auf das ausgelegt, was ByteDance als Kontrolle auf Regie-Niveau beschreibt. Creator können Performance, Beleuchtung, Schatten und Kamerabewegung mithilfe von Referenzbildern, Audio und Video gestalten. Das Modell kann eine stabile Subjektidentität bewahren, komplexe Skripte präzise reproduzieren und Kamerasprache so wählen, dass sie eine Art eingebaute „Schnittlogik“ widerspiegelt. Für Creator ist das ein bedeutender Schritt über einfaches Text-zu-Video hinaus.

Bearbeitung und Erweiterung, nicht nur Generierung

Ein weiteres bemerkenswertes Upgrade ist, dass Seedance 2.0 nicht bei der Generierung stehen bleibt. Seedance 2.0 fügt Funktionen zur Videobearbeitung und Videoerweiterung hinzu, die gezielte Änderungen an bestimmten Szenen, Figuren, Aktionen oder Handlungspunkten ermöglichen und fortlaufende Anschlussaufnahmen unterstützen. Der Entwicklerartikel erklärt außerdem, dass das Modell genutzt werden kann, um „weiterzudrehen“, indem ein Clip verlängert wird, statt von vorn zu beginnen. Das ist für die Workflow-Effizienz wichtig, weil dadurch nicht eine ganze Szene neu generiert werden muss, nur um ein einzelnes Segment zu korrigieren.

Besserer Umgang mit komplexer Bewegung

Seedance 2.0 ist in Szenen mit mehreren Subjekten, Interaktionen und komplizierter Bewegung deutlich stärker. Die Generierungsqualität hat sich gegenüber Version 1.5 erheblich verbessert, mit besserer physikalischer Genauigkeit, Realitätsnähe und Steuerbarkeit. Die Nutzbarkeitsrate von Seedance 2.0 in schwierigen Bewegungsszenen erreicht in seinem internen Bewertungsrahmen ein SOTA-Niveau der Branche, wobei zugleich anerkannt wird, dass bei Stabilität feiner Details, Realitätsnähe und Lebendigkeit noch weitere Verbesserungen nötig sind.

Leistungsbenchmark

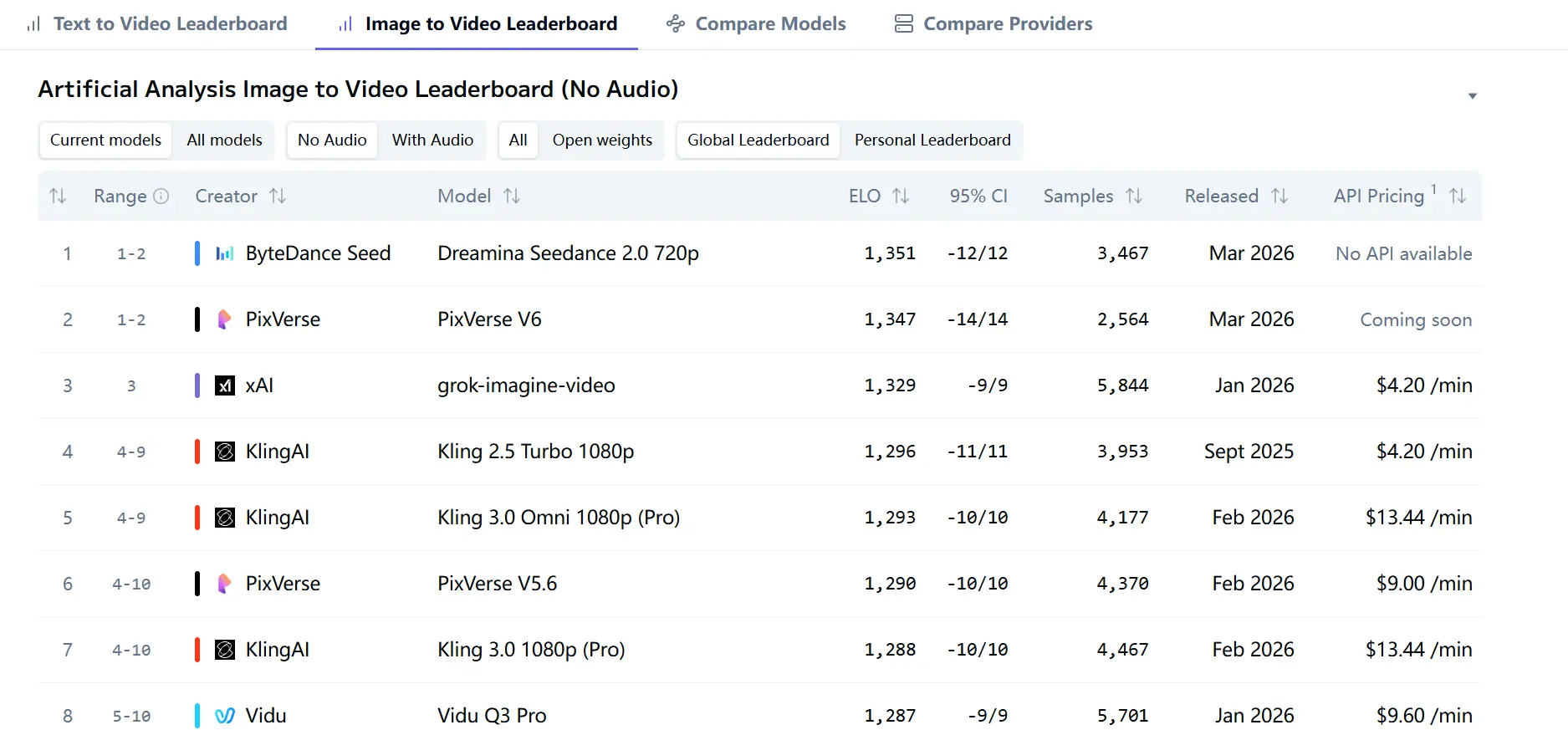

Das stärkste Drittanbieter-Signal in den geprüften Quellen ist die Artificial Analysis Video Arena. Auf den aktuellen Ranglistenseiten führt Dreamina Seedance 2.0 720p die Image-to-Video Arena without audio mit einem Elo-Wert von 1351 sowie die Text-to-Video Arena without audio mit einem Elo-Wert von 1269 an. Die Ranglistenseiten geben außerdem an, dass die Platzierungen auf blinden Nutzerabstimmungen beruhen, was wichtig ist, weil damit menschliche Präferenzen im großen Maßstab gemessen werden und nicht nur modellinterne Metriken.

Das ist wichtig, weil es bedeutet, dass Seedance 2.0 nicht nur als leistungsfähig vermarktet wird, sondern derzeit in direkten Vergleichstests in zwei großen Arenen tatsächlich von Nutzern bevorzugt wird. In Text-zu-Video ohne Audio liegt es vor Kling 3.0 1080p (Pro), SkyReels V4, PixVerse V6 und Kling 3.0 Omni 1080p (Pro). In Bild-zu-Video ohne Audio liegt es knapp vor PixVerse V6 und grok-imagine-video.

Seedance 2.0 Leistungsübersicht

| Metrik | Seedance 2.0 |

|---|---|

| Bild-zu-Video-Rang | Top 15 weltweit |

| ELO-Wert | ~1258 |

| Text-zu-Video-Rang | Top 25 |

| Kosten | ~$1.56/min |

| Stärke | Kosten-Leistungs-Balance |

👉 Interpretation:

- Nicht immer Nr. 1 bei der Rohqualität

- Aber außergewöhnliches Verhältnis von Wert zu Leistung

Wie gut ist Seedance 2.0 wirklich?

Seine größten Stärken

Die größten Stärken von Seedance 2.0 sind klar: Es verarbeitet komplexe Bewegungen besser als viele Videomodelle, unterstützt mehrere Referenzmodalitäten, bietet Bearbeitung und Erweiterung und führt derzeit die sichtbarsten öffentlichen Arena-Ranglisten in Text-zu-Video und Bild-zu-Video ohne Audio an. Verbesserungen bei physikalischer Genauigkeit, Realitätsnähe und Steuerbarkeit sind genau die Eigenschaften, die wichtig werden, wenn ein Modell von Spielzeugdemos in professionelle Workflows übergeht.

Seine aktuellen Einschränkungen

Seedance wird von ByteDance nicht als perfekt dargestellt. Es gibt noch Spielraum zur Verbesserung bei Detailstabilität, Realitätsnähe und Bewegungslebendigkeit, und es werden verbleibende Herausforderungen bei der Konsistenz mehrerer Subjekte, der Genauigkeit der Textrendering-Ausgabe und komplexen Bearbeitungseffekten genannt.

Meine Einschätzung

Auf Basis der geprüften Quellen wirkt Seedance 2.0 weniger wie ein geringfügiges Update und mehr wie ein ernsthafter Schritt hin zu einem produktionsreifen Videosystem. Sein stärkstes Argument ist nicht eine einzelne spektakuläre Demo, sondern die Kombination aus einem breiteren multimodalen Eingabestack, direkten Bearbeitungssteuerungen, Clip-Erweiterung und glaubwürdiger Führung in öffentlichen Ranglisten. Das macht es zu einem der derzeit wichtigsten Videomodelle auf dem Markt, besonders für Teams, denen Steuerbarkeit genauso wichtig ist wie rohe filmische Qualität.

Seedance 2.0 vs Sora 2 vs Veo 3.1

Vergleichstabelle (KI-Videoführer 2026)

| Funktion | Seedance 2.0 | Sora 2 | Veo 3.1 |

|---|---|---|---|

| Entwickler | ByteDance | OpenAI | |

| Eingabetypen | Text, Bild, Audio, Video | Text | Text + Bild |

| Audiogenerierung | ✅ Nativ | ❌ Eingeschränkt | ✅ |

| Maximale Videolänge | 15–20 Sek. | ~25 Sek. | ~8 Sek. (erweiterbar) |

| Bearbeitungsfähigkeit | ⭐ Fortgeschritten (referenzbasiert) | Mittel | Mittel |

| ELO-Ranking | Top 15–25 | Hoch | Hoch |

| Kosteneffizienz | ⭐ Hoch | Mittel | Mittel |

| Kommerzielle Nutzung | Ja | Eingeschränkt (Wasserzeichen) | Ja |

| Einzigartige Stärke | Multimodale Bearbeitung | Langes Storytelling | Visuelle Qualität |

Zentrale Erkenntnisse

- Seedance 2.0 = beste Bearbeitung + multimodale Flexibilität

- Sora 2 = beste narrative Länge

- Veo 3.1 = beste Bild-zu-Video-Treue

In den aktuellen Artificial Analysis Text-zu-Video-Rankings liegt Seedance 2.0 720p in der Kategorie ohne Audio vor sowohl Veo 3.1 als auch Sora 2 Pro. Das entscheidet nicht jede Qualitätsdebatte, weil sich die Modelle in Workflow, Sicherheitsbeschränkungen und Produktpaketierung unterscheiden, aber es zeigt, dass Seedance 2.0 in dieselbe Spitzengruppe wie die sichtbarsten westlichen Angebote aufgerückt ist.

Der offensichtlichste Vorteil von Seedance 2.0 ist die Breite der Eingaben. ByteDance sagt, dass es Text, Bild, Audio und Video gemeinsam verarbeiten kann und dabei bis zu 9 Bilder, 3 Videos und 3 Audioclips gleichzeitig nutzen kann. Die Dokumentation von OpenAIs Sora 2 nennt dagegen Text und Bild als Eingaben und Video plus Audio als Ausgaben, mit Zugriff über die Sora-App und sora.com; Sora 2 Pro ist außerdem für ChatGPT-Pro-Nutzer im Web verfügbar. Googles Veo 3.1 liegt irgendwo dazwischen: Es ist auf bildgeführte Erstellung und audio-reiche Videogenerierung ausgelegt, mit bis zu 3 Referenzbildern, Szenenerweiterung und Kontrolle über erstes und letztes Bild.

Wie man Zugriff erhält und wo man vergleichen kann

Wenn Sie Sora 2, Veo 3.1 und xx gleichzeitig auf einer Plattform nutzen möchten, empfehle ich CometAPI. CometAPIs Playgoud bietet direkte Videogenerierung mit nur einem einfachen Befehl oder einigen Referenzbildern. Wenn Sie Ihre eigene Videogenerierungs-API programmatisch konfigurieren möchten, ist CometAPI noch überlegenswerter. Es bietet APIs für Sora 2, Veo 3.1 usw. und ist derzeit mit 20 % Rabatt erhältlich.

Wie man Seedance 2.0 mit CometAPI verwendet

Text-zu-Video-Generierung

Geben Sie eine Beschreibung Ihrer Szene ein. Je spezifischer, desto besser — geben Sie Kamerabewegung, Beleuchtung, Stimmung und Stil an. Dank der starken Prompt-Treue von Seedance 2.0 entspricht die Ausgabe Ihrer Absicht sehr genau, was es für die Content-Produktion zuverlässiger macht als reines Trial-and-Error.

Innerhalb des CometAPI Playground können Sie Prompts direkt eingeben und mit dem Modell Seedance 2.0 Videos generieren. Das ist besonders nützlich für Social-Media-Inhalte (Reels, TikTok, YouTube Shorts), Markenvideos und kurze narrative Clips.

So funktioniert es:

- CometAPI öffnen

- Das Modell Seedance 2.0 auswählen

- Ihren Prompt eingeben

- Parameter anpassen (Dauer, Auflösung, Seitenverhältnis)

- Den Generierungsjob starten und auf die Ausgabe warten

Bild-zu-Video mit CometAPI

Laden Sie ein statisches Bild hoch — etwa ein Produktfoto, eine Konzeptillustration oder ein Design-Mockup — und nutzen Sie die Bild-zu-Video-Funktionen von Seedance 2.0 über CometAPI, um es zu animieren.

Das Ergebnis ist eine flüssige, kontextbewusste Bewegung, die aus Ihrer visuellen Eingabe generiert wird. Das ist ideal für Teams, die bereits Design-Assets haben und diese ohne vollständigen Produktionsworkflow in Video umwandeln möchten.

So funktioniert es:

- Verwenden Sie

input_reference(oder ein entsprechendes Datei-Upload-Feld im Playground) - Fügen Sie einen bewegungsfokussierten Prompt hinzu, der beschreibt, wie sich die Szene bewegen soll

Beispiel-Prompt:

„Die Kamera fährt langsam auf das Produkt zu, weiches Studiolicht, subtile Reflexionen, hochwertiger kommerzieller Look“

Audio-visuelle Generierung in einem Durchgang

Anstatt zuerst Video zu generieren und dann separat Audio hinzuzufügen, unterstützt CometAPI die native audio-visuelle Generierungspipeline von Seedance 2.0.

Indem Sie sowohl die visuellen Elemente als auch den Sound in einem einzigen Prompt beschreiben, können Sie synchronisiertes Video und Audio in einem Schritt erzeugen. Das führt zu kohärenteren und bewussteren Ergebnissen und reduziert gleichzeitig die Bearbeitungszeit.

Beispiel-Prompt:

„Ein friedlicher Strand bei Sonnenaufgang, sanfte Wellen, warmes goldenes Licht, leise Ambient-Musik mit Meeresgeräuschen“

Die Ausgabe umfasst:

- Generiertes Video

- Synchronisierten Hintergrundton

- Natürlich abgestimmtes Timing und passende Stimmung

Warum CometAPI für Seedance 2.0 verwenden

- Direkter Zugriff per API oder Playground

- Einfache Parametersteuerung (Dauer, Auflösung, Format)

- Unterstützt sowohl Text-zu-Video- als auch Bild-zu-Video-Workflows

- Integrierte Job-Verwaltung für asynchrone Videogenerierung

Fazit

Seedance 2.0 wirkt wie ein echter Sprung in der KI-Videogenerierung: ein multimodales System, das Text-, Bild-, Audio- und Videoeingaben kombiniert; ein Ranglistenführer sowohl bei Text-zu-Video als auch bei Bild-zu-Video; und ein Modell, das eher für regieartige Kontrolle als für beiläufige Spielereien entwickelt wurde. Wenn Sie sich nur für die wahrgenommene Rohqualität interessieren, deuten die aktuellen Belege darauf hin, dass es außergewöhnlich ist.

Beginnen Sie noch heute mit der Erstellung mit Seedance 2.0 auf CometAPI.