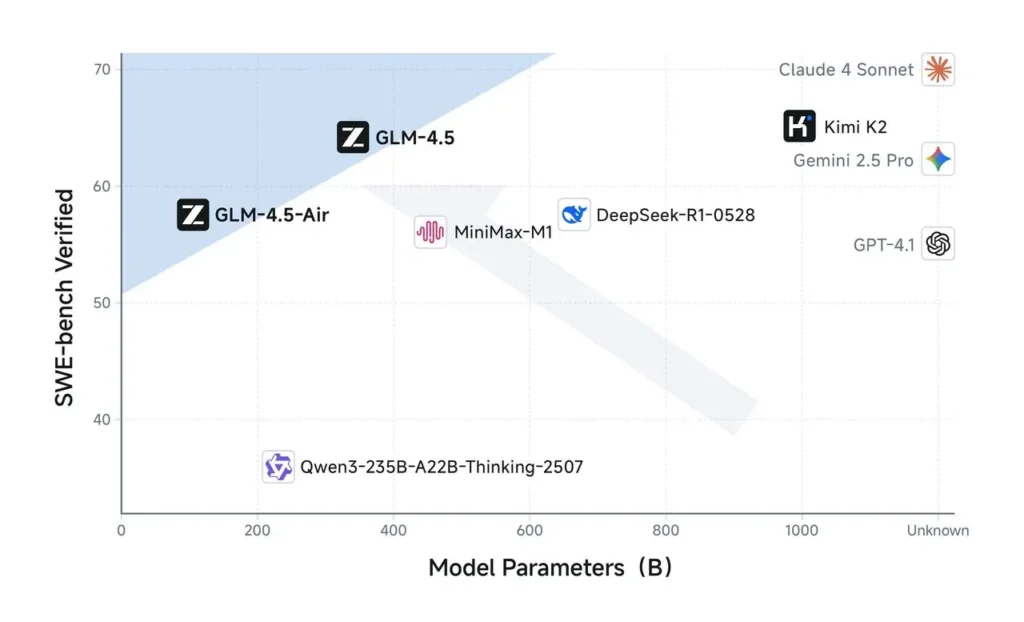

Am 28. Juli 2025 stellte das in Peking ansässige Startup Zhipu AI offiziell seine Open-Source-Serie großer Sprachmodelle GLM-4.5 vor. Damit markiert das Unternehmen seine bislang leistungsstärkste Veröffentlichung und zielt auf fortschrittliche Anwendungen intelligenter Agenten ab. Die Ankündigung – im Rahmen eines Live-Online-Events nach der World Artificial Intelligence Conference (WAIC) – präsentierte zwei Varianten: das voll skalierte GLM-4.5 mit insgesamt 355 Milliarden Parametern (32 Milliarden aktiv) und das kompaktere GLM-4.5-Air mit insgesamt 106 Milliarden Parametern (12 Milliarden aktiv). Beide Modelle nutzen eine hybride „Thinking“- und „Non-Thinking“-Reasoning-Architektur, die tiefgehende Inferenz mit schneller Reaktion ausbalancieren soll, und bieten ein Kontextfenster von 128.000 Token für umfangreiche Konversations- und aufgabenorientierte Anwendungsfälle.

Die Einführung von GLM-4.5 erfolgt inmitten eines sich verschärfenden nationalen KI-Wettlaufs. Laut der staatlichen chinesischen Nachrichtenagentur Xinhua haben chinesische Entwickler bis Juli 2025 insgesamt 1.509 große Sprachmodelle veröffentlicht und führen damit die weltweite Gesamtzahl von 3.755 Modellen an – ein klarer Beleg für das Ausmaß und die Geschwindigkeit der Expansion des chinesischen KI-Ökosystems.

Open-Source-Lizenzierung von GLM-4.5

In einer klaren Abkehr von proprietären Closed-Source-Paradigmen veröffentlicht Z.ai GLM-4.5 unter einer MIT-ähnlichen, vollständig auditierbaren Open-Source-Lizenz, die Unternehmen vollständige Transparenz hinsichtlich Modellgewichten und Trainingscode gewährt. Organisationen können GLM-4.5 On-Premise bereitstellen, es auf proprietären Datensätzen feinabstimmen oder über selbst gehostete Inferenzdienste integrieren und so Vendor Lock-in sowie intransparente API-Preisstrukturen vermeiden.

Die Verfügbarkeit sowohl von GLM-4.5 für allgemeine agentische Aufgaben als auch von GLM-4.5-Air, einer leichtgewichtigen Variante, die für Umgebungen mit geringeren Ressourcen optimiert ist, gewährleistet ein breites Spektrum an Anwendungsfällen – von groß angelegten Rechenzentrumsbereitstellungen bis hin zu Inferenzszenarien auf Edge-Geräten.

Strategisch positioniert Zhipus Open-Source-Ansatz das Unternehmen gegenüber westlichen Closed-Source-Marktführern wie OpenAI. Durch die Demokratisierung des Zugangs zu einem mit GPT-4 vergleichbaren Modell unter der MIT-Lizenz will Zhipu eine starke Community von nachgelagerten Entwicklern aufbauen und technische Benchmarks für agentische KI-Fähigkeiten setzen. Branchenbeobachter merken an, dass dieser Schritt einem breiteren Trend unter Chinas „AI Tigers“ folgt, darunter Moonshot AI und Step AI, die ebenfalls große Modelle als Open Source veröffentlicht haben, um Innovationszyklen zu beschleunigen.

Leistungs-Benchmarks und Vergleichsanalyse

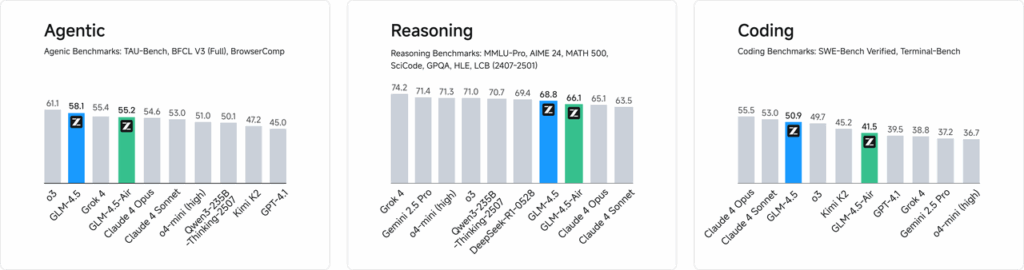

Vorläufige Benchmarks von Zhipu AI zeigen, dass GLM-4.5 einen aggregierten Wert von 63,2 über 12 branchenübliche Evaluierungssuiten erreicht – und damit unter Open-Source- wie auch proprietären Modellen den dritten Platz belegt –, während das verschlankte GLM-4.5-Air auf 59,8 kommt und damit Effizienz mit hoher Genauigkeit verbindet. Interne Coding-Bewertungen zeigen zudem, dass GLM-4.5 wichtige Rivalen übertrifft und über 52 verschiedene Programmieraufgaben hinweg eine Gewinnrate von 53,9 Prozent gegenüber Kimi K2 sowie eine Erfolgsrate von 80,8 Prozent gegenüber Qwen3-Coder erzielt.

Demonstrationen während des Live-Events unterstrichen die agentischen Fähigkeiten von GLM-4.5: Das Modell führte autonom Webrecherchen durch – indem es Informationen aus mehreren Quellen abrief und zusammenfasste – und interagierte mit simulierten Social-Media- und Entwicklungsumgebungen, um Beiträge zu erstellen, Code-Snippets auszuführen und Benutzeroberflächenelemente in Echtzeit zu manipulieren. Interessierte Nutzer können das voll skalierte Modell sofort kostenlos über Zhipus Qingyan-Portal und die CometAPI-Plattform testen, während Entwickler über den BigModel-Service von CometAPI auf API-Endpunkte zugreifen oder die vollständigen Modellgewichte unter einer MIT-Lizenz von Hugging Face und ModelScope herunterladen können.

Kosteneffizienz ist ein Grundpfeiler der Strategie von Z.ai. Trainiert auf einem Korpus von 15 Billionen Token nutzt GLM-4.5 optimierte Inferenzpfade, um einen Durchsatz von 100–200 Token pro Sekunde zu liefern – bis zu achtmal schneller als vergleichbare nationale Wettbewerber – zu einem ausgeschriebenen Preis von nur 0,11 US-Dollar pro Million Token, womit Modelle wie DeepSeek-R1 und Alibabas neueste Veröffentlichungen unterboten werden. Unter der freizügigen MIT-Lizenz sind alle Modellgewichte, der Code und die Dokumentation über Hugging Face frei verfügbar, mit dem Ziel, weltweit eine lebendige Entwickler- und Forschungsgemeinschaft zu fördern.

„GLM-4.5 verkörpert unser Engagement, den Zugang zu erstklassiger KI-Technologie zu demokratisieren“, sagte Zhang Peng, CEO von Z.ai, in einem CNBC-Interview. „Indem wir ein Modell als Open Source bereitstellen, das sich bei Reasoning, Coding und agentischen Funktionen auszeichnet, befähigen wir Organisationen jeder Größe dazu, ohne die Einschränkungen proprietärer APIs oder prohibitiv hoher Kosten zu innovieren.“

Erste Schritte

CometAPI ist eine einheitliche API-Plattform, die über 500 KI-Modelle führender Anbieter – darunter OpenAIs GPT-Serie, Googles Gemini, Anthropics Claude, Midjourney, Suno und weitere – in einer einzigen, entwicklerfreundlichen Oberfläche bündelt. Durch konsistente Authentifizierung, Anfrageformatierung und Antwortverarbeitung vereinfacht CometAPI die Integration von KI-Funktionen in Ihre Anwendungen erheblich. Ob Sie Chatbots, Bildgeneratoren, Musikkomponisten oder datengesteuerte Analysepipelines entwickeln – CometAPI ermöglicht es Ihnen, schneller zu iterieren, Kosten zu kontrollieren und anbieteragnostisch zu bleiben, während Sie gleichzeitig von den neuesten Durchbrüchen im gesamten KI-Ökosystem profitieren.

Entwickler können über CometAPI auf die GLM-4.5 API zugreifen; die aufgeführten neuesten Claude-Modellversionen entsprechen dem Stand zum Veröffentlichungsdatum des Artikels. Erkunden Sie zunächst die Fähigkeiten des Modells im Playground und konsultieren Sie den API guide für detaillierte Anweisungen. Bitte stellen Sie vor dem Zugriff sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben. CometAPI bietet einen Preis, der weit unter dem offiziellen Preis liegt, um Sie bei der Integration zu unterstützen.