GPT-5 de OpenAI se lanzó a principios de agosto de 2025 y rápidamente estuvo disponible a través de múltiples canales de distribución. Una de las maneras más rápidas para que los equipos experimenten con GPT-5 sin cambiar de SDK de proveedor es CometAPI, una puerta de enlace multimodelo que expone GPT-5 junto con cientos de otros modelos. Este artículo contiene documentación práctica para explicar... Lo que CometAPI ofrece, cómo Para llamar a GPT-5 a través de él, las ventajas y desventajas que debe evaluar y los controles prácticos de gobernanza y costos que debe implementar antes de trasladar flujos de trabajo críticos a GPT-5.

¿Qué es GPT-5 y qué lo diferencia de los modelos anteriores?

GPT-5 es la próxima gran familia de modelos de lenguaje insignia de OpenAI, lanzada a principios de agosto de 2025. Se presenta como un sistema de razonamiento unificado y multimodal que combina componentes rápidos de no razonamiento, una variante de "razonamiento" más profunda (a menudo denominada "pensamiento GPT-5") y un enrutador que decide qué submodelo utilizar según la complejidad y las herramientas requeridas. El efecto neto que OpenAI afirma: mejor razonamiento, ventanas de contexto más amplias y mejor compatibilidad con tareas de codificación y agencia.

Arquitectura y capacidades clave

- Sistema multicomponente: GPT-5 se describe como un sistema que dirige las solicitudes a diferentes submodelos internos (razonamiento rápido vs. profundo) según la necesidad; los desarrolladores pueden solicitar el modelo de razonamiento a través de la API para obtener el máximo rendimiento.

- Contexto amplio: La familia de modelos admite contextos extremadamente grandes (cientos de miles de tokens), lo que permite el manejo en una sola pasada de documentos largos, bases de código o conversaciones de múltiples archivos.

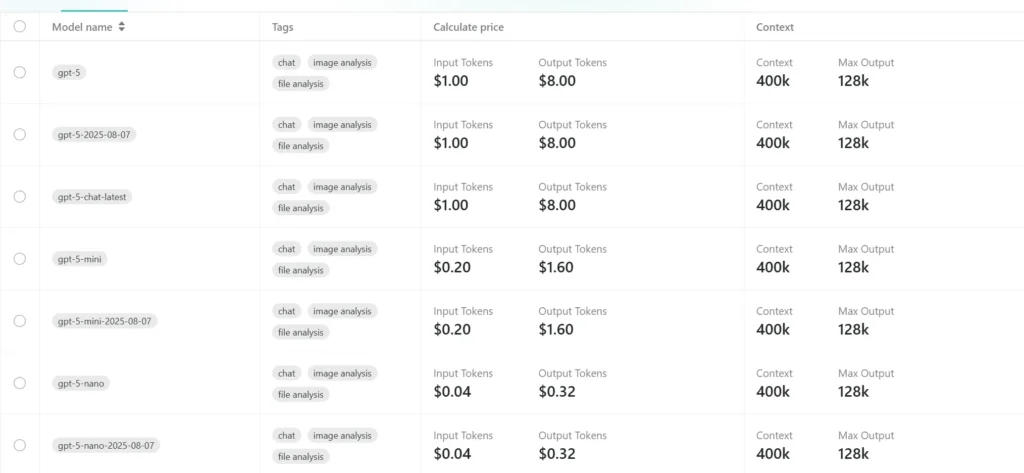

- Familia de varios tamaños: OpenAI lanzó GPT-5 en varios tamaños (normal

gpt-5,gpt-5-mini,gpt-5-nano) para que los equipos puedan equilibrar latencia, costo y capacidad de razonamiento.

¿Qué es CometAPI y realmente ofrece GPT-5?

Una definición rápida

CometAPI Es una plataforma de agregación de API que ofrece acceso unificado a cientos de modelos de IA (familias GPT de OpenAI, Anthropic Claude, xAI Grok, modelos de imagen y más) a través de una única interfaz REST compatible con OpenAI. Esto significa que los desarrolladores pueden cambiar de proveedor de modelos modificando la cadena de nombre del modelo en lugar de reescribir el código de red. En sus páginas de producto, CometAPI incluye explícitamente... GPT-5 y variantes relacionadas (por ejemplo, gpt-5, gpt-5-chat-latest, gpt-5-mini) como puntos finales disponibles.

¿Por qué los equipos usan puertas de enlace como CometAPI?

Los servicios de puerta de enlace como CometAPI son atractivos porque le permiten:

- Intercambiar modelos rápidamente sin cambiar grandes cantidades de código de integración.

- Comparar precios y dirigir ciertas solicitudes a variantes de modelos más baratos o más rápidos.

- Facturación agregada y registro en múltiples modelos y proveedores.

La documentación de CometAPI proporciona una ruta de migración simple y un cliente estilo OpenAI (por lo que su código OpenAI o “compatible con OpenAI” existente a menudo solo necesita cambios menores).

¿Cómo CometAPI expone GPT-5 programáticamente?

CometAPI presenta una API REST compatible con OpenAI superficie: una URL base, Authorization: Bearer <YOUR_KEY>y cuerpos de solicitud similares a los puntos finales de chat/finalización de OpenAI. Para GPT-5 La plataforma documenta nombres de modelos como gpt-5, gpt-5-mini e gpt-5-nano Y los puntos finales mencionados incluyen POST https://api.cometapi.com/v1/chat/completions para llamadas estilo chat y /v1/responses Para algunas variantes sin chat. Los detalles de configuración de ejemplo (URL base, formato de encabezado y parámetro de modelo) se publican en Documentación de CometAPI y guías de inicio rápido.

Patrón típico de punto final y autenticación

- URL base:

https://api.cometapi.com/v1(o el documentado/v1/chat/completionsPara chatear y/v1/responses(para algunas variantes que no son de chat). - Encabezado de autenticación:

Authorization: Bearer sk-xxxxxxxxxxxx(Problemas con CometAPIsk-tokens de estilo en el tablero ). - Tipo de contenido:

application/json. - Parámetro del modelo: .

modelagpt-5, gpt-5-2025-08-07,gpt-5-chat-latest,gpt-5-miniu otros, consulte página modelo.

¿Cómo empiezo a usar CometAPI y solicito GPT-5? (paso a paso)

A continuación se muestra un flujo de incorporación conciso y confiable que puede seguir hoy mismo.

Paso 1: Regístrese y obtenga una clave CometAPI

- Vaya a cometapi.com y crear una cuenta.

- Desde tu panel de control ve a Tokens de API or Centro personal → Agregar tokenCometAPI emite un token en

sk-...formato. Almacene esto de forma segura (no incruste claves en repositorios públicos).

Paso 2: Elige la cadena del modelo

- Seleccione el nombre del modelo que coincida con sus necesidades (por ejemplo,

gpt-5,gpt-5-nano-2025-08-07). CometAPI a menudo publica múltiples alias para cada modelo para que pueda elegir entre precisión y costos.

Paso 3: Realiza tu primera solicitud (curl)

Un mínimo curl Ejemplo que sigue el patrón compatible con OpenAI:

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-YOUR_COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-5",

"messages": [{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"Summarize the benefits of using a model aggregator."}],

"max_tokens": 500,

"temperature": 0.2

}'

Esto refleja la estructura de la API de chat de OpenAI, pero apunta a la URL base de CometAPI y utiliza su token Comet.

Paso 4: Ejemplo de Python (solicitudes)

import requests, os

COMET_KEY = os.getenv("COMETAPI_KEY") # set this in your environment

url = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "gpt-5",

"messages": [

{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"List three concrete steps to reduce model hallucination in production."}

],

"max_tokens": 400,

"temperature": 0.1

}

resp = requests.post(url, json=payload, headers=headers, timeout=60)

resp.raise_for_status()

print(resp.json())

Reemplace model con gpt-5-nano o los documentos alias exactos de CometAPI para variantes más pequeñas y económicas.

Precio en CometAPI

¿Cuáles son las mejores prácticas y mitigaciones para el uso en producción?

A continuación se presentan patrones concretos para reducir el riesgo y mejorar la confiabilidad cuando se utiliza un intermediario como CometAPI.

Comience con un pequeño piloto y realice pruebas en paralelo

Ejecute solicitudes idénticas a OpenAI (si tiene acceso directo) y CometAPI para comparar resultados, latencia y costo. Esto revela cualquier transformación implícita, filtro de contenido o discrepancia en los alias del modelo.

Instrumento para la observabilidad y el control de calidad

Registrar avisos, tokens devueltos (ofuscados para PII), latencias y códigos de error. Implementar pruebas automatizadas para detectar la desviación de avisos y las tasas de alucinaciones. Monitorear el uso de alias de modelo para que las migraciones sean auditables.

Proteja las llaves y rótelas periódicamente

Trate los tokens de CometAPI como cualquier secreto de API: guárdelos en administradores de secretos, rótelos periódicamente y asigne un alcance a los tokens a entornos (desarrollo/preparación/producción).

Implementar seguridad en capas

Utilice una combinación de:

- Ingeniería rápida para reducir las alucinaciones (restricciones explícitas, salida estructurada).

- Comprobaciones posteriores al procesamiento (verificación de hechos, listas de bloqueo, verificaciones de expresiones regulares para PII).

- Humano en el bucle para salidas de alto riesgo.

Estos son estándar para las implementaciones de GPT-5 que manejan contenido crítico o legal.

¿Cuáles son los errores más comunes y cómo solucionar los problemas de acceso?

Error: "modelo inexistente / sin acceso". Algunos desarrolladores informan que el acceso al modelo puede verse restringido por la verificación del proveedor o de la organización al usar APIs de proveedores directos. Pueden aparecer restricciones similares cuando los agregadores utilizan modelos de proveedores como proxy. Si ve un error de "modelo inexistente" o de permiso, compruebe: (a) si su clave de CometAPI es válida y no ha caducado, (b) si el nombre del modelo solicitado coincide exactamente con la lista de modelos compatibles de CometAPI, y (c) si el proveedor subyacente requiere pasos adicionales de verificación o facturación. Si se trata de errores de acceso relacionados con la verificación y anomalías de tiempo de espera o permisos, deberá proporcionar información al personal de contacto para su resolución (correo electrónico: support@cometapi.com).

Peligro: latencia o coste inesperado. Los modos de razonamiento complejo y los contextos amplios generan latencia y gasto de tokens. max_tokens, Reducir temperature cuando sea apropiado, y prefiera mini Variantes para cargas de trabajo de alto rendimiento. Monitoreo con registro y alertas.

Nota de cierre

CometAPI ofrece a los equipos una vía rápida para experimentar con variantes de GPT-5 a la vez que centraliza el acceso al modelo. Sin embargo, el uso en producción exige la misma disciplina que aplicaría a cualquier modelo potente: claves seguras, ingeniería rápida y meticulosa, supervisión de alucinaciones y revisión de políticas y aspectos legales para cargas de trabajo sensibles. Comience con un piloto pequeño, utilice los paneles de CometAPI para medir el gasto de tokens y la latencia, y escale a variantes de mayor razonamiento solo después de validar la precisión y la seguridad en su dominio.

Los desarrolladores pueden acceder GPT-5 , GPT-5 Nano y GPT-5 Mini a través de CometAPI (CometAPI recomienda /v1/responses), las últimas versiones de los modelos que se listan corresponden a la fecha de publicación del artículo. Para comenzar, explore las capacidades del modelo en el Playground Consulte la guía de la API para obtener instrucciones detalladas. Antes de acceder, asegúrese de haber iniciado sesión en CometAPI y de haber obtenido la clave de API. CometAPI Ofrecemos un precio muy inferior al oficial para ayudarte a integrarte.

Vea también Cómo utilizar los nuevos parámetros y herramientas de GPT-5

Preguntas Frecuentes

1. ¿Qué variante del modelo GPT-5 debería elegir y qué pasa con los tokens y los precios?

CometAPI enumera múltiples variantes de GPT-5 (predeterminado gpt-5, instantáneas de chat como gpt-5-chat-latest, y versiones más pequeñas como gpt-5-mini/gpt-5-nano) Elige según tus necesidades:

gpt-5/gpt-5-chat-latest— capacidad completa para chat de propósito general, mejor para calidad y razonamiento.gpt-5-mini/gpt-5-nano— menor costo y latencia para tareas de gran volumen o menor criticidad.

2. ¿Cómo se deben diseñar las llamadas para contextos amplios y razonamientos de alta calidad?

Contexto extenso: GPT-5 admite ventanas de contexto muy grandes. Al enviar documentos grandes, fragmente la entrada deliberadamente, utilice la ampliación de recuperación (base de datos vectorial + ventanas de contexto) y mantenga el máximo de tokens para las salidas limitado para controlar el costo.

3. ¿Qué medidas de seguridad, privacidad y cumplimiento debe aplicar?

Higiene de claves API. Mantenga las claves en las variables de entorno, rótelas periódicamente y ajústelas al alcance siempre que sea posible. No las envíe a repositorios. (Esta práctica recomendada se refleja en las guías para desarrolladores).

Residencia y privacidad de datos. Lea la política de privacidad y los términos de CometAPI (y la política de OpenAI) antes de enviar datos personales, de salud o regulados confidenciales a través de cualquier agregador externo. Algunas empresas requerirán contratos directos con proveedores o instancias privadas.

Límites de tarifas y protecciones de cuotas. Implemente interruptores de circuito, reducción exponencial y controles de cuotas en producción para evitar costos descontrolados y fallos en cascada. Los paneles de CometAPI muestran el uso y las cuotas; úselos para aplicar límites programáticos.