El brazo de investigación de ByteDance Semilla ha lanzado Semilla3D 1.0Un modelo de base 3D de alta fidelidad de una sola imagen que produce mallas listas para simulación, materiales PBR y texturas alineadas: recursos diseñados para integrarse directamente en motores de física y simuladores robóticos. Esta versión busca cerrar una brecha crucial: la generación escalable de contenido (contenido visual diverso) frente a la fidelidad física que requiere la IA incorporada y el entrenamiento con simuladores.

¿Qué es ByteDance Seed3D 1.0?

Seed3D 1.0 es un modelo de base 3D creado para convertir una sola imagen RGB de un objeto o entorno en un listo para simulación Paquete de recursos 3D: generalmente una malla explícita e impermeable, mapas de textura UV asociados y parámetros de material de renderizado basado en la física (PBR). El modelo está diseñado no solo para producir geometría y texturas visualmente fieles, sino también para generar recursos que requieren un posprocesamiento mínimo antes de su uso en simuladores como Isaac Sim, Unity o Unreal Engine para robótica, entrenamiento o generación de mundos virtuales.

Objetivos clave de diseño de alto nivel:

- Entrada de una sola imagen:Elimine la necesidad de hardware de escaneo o captura de múltiples vistas.

- Preparación para la simulación:Garantizar que la topología, la escala y los materiales PBR sean adecuados para la simulación física.

- Escalabilidad de la escena: permite que los objetos generados se ensamblen automáticamente en escenas coherentes.

- Integración: :adaptación mínima a motores de física comunes y canales de ejecución en tiempo real.

¿Qué características ofrece Seed3D 1.0?

Geometría de alta fidelidad (mallas estancas)

Seed3D produce geometría cerrada y múltiple Diseñado para un manejo preciso de colisiones y una física de contacto fiable. El componente de geometría utiliza un híbrido de VAE y transformador de difusión para producir mallas que preservan el nivel de detalle y conservan detalles estructurales finos, como protuberancias finas, agujeros y texto. El proceso de extracción de mallas utiliza una estrategia dual de cubos de marcha/isosuperficie jerárquica para extraer superficies de alta calidad de forma eficiente. ()

Texturas fotorrealistas y materiales PBR

El flujo de texturas genera mapas de albedo consistentes multivista y texturas PBR completas (albedo, metálicas y rugosidad), y puede generar texturas con una resolución de hasta 4K. Estos mapas están diseñados para que la iluminación se comporte de forma físicamente plausible en los motores de renderizado. Un módulo de retoque UV completa las regiones ocluidas y garantiza la coherencia espacial en todo el atlas UV.

Simulación y preparación de tuberías

Los resultados se pueden exportar a formatos comunes (OBJ/GLB). Los recursos generados se crean intencionalmente. listo para simulaciónSe integran en simuladores de física, donde las mallas de colisión y los parámetros de fricción/rigidez se pueden derivar o ajustar automáticamente, lo que permite su uso inmediato en robótica o motores de juegos. Seed3D muestra flujos de trabajo que colocan los recursos generados en Isaac Sim para experimentos de manipulación.

Generación de escenas y ensamblaje factorizado

Más allá de los objetos individuales, Seed3D utiliza un enfoque de generación de escenas factorizadas donde los modelos de lenguaje de visión infieren mapas de diseño (posiciones, escalas, orientaciones) y Seed3D sintetiza y coloca objetos en consecuencia, lo que permite una composición de escena coherente para interiores y diseños urbanos.

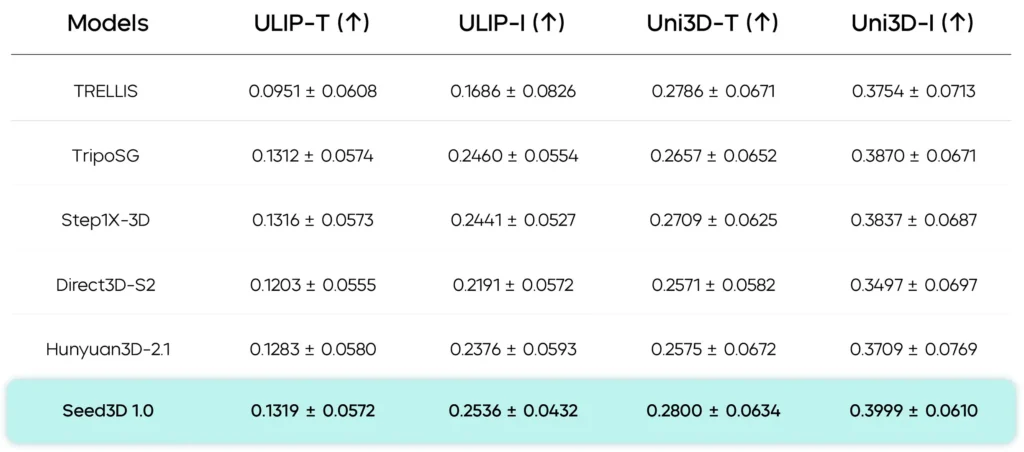

Resultado de la evaluación del desempeño

Generación de geometría

En las pruebas de geometría, el modelo geométrico de 1.5 millones de parámetros de Seed3D 1.0 (Seed3D-DiT + VAE) logra una mayor precisión estructural y detalles más finos en comparación con varias bases (TRELLIS, TripoSG, Step1X-3D, Direct3D-S2 y modelos de gran tamaño como Hunyuan3D-2.1). La arquitectura de Seed3D (difusión en espacio latente combinada con una cuidadosa decodificación SDF y extracción jerárquica de mallas) produce mallas con menos artefactos y una mejor conservación de la geometría de alta frecuencia (texto, pequeñas protuberancias).

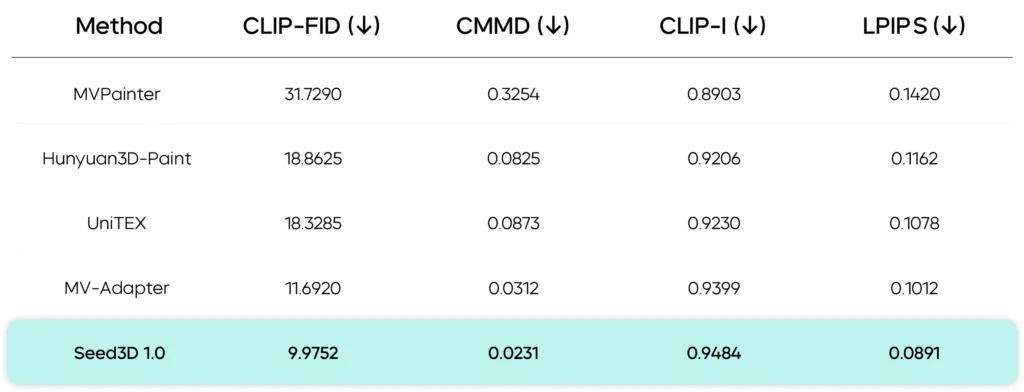

Generación de texturas

Para las estimaciones de textura y material, Seed3D reporta mejoras sustanciales en la alineación con imágenes de referencia y en el realismo del material. La descomposición Seed3D-PBR y la restauración UV Seed3D generan atlas UV que conservan los detalles de textura de alta frecuencia y proporcionan mapas PBR coherentes (albedo, metalizado, rugosidad) adecuados para la renderización física.

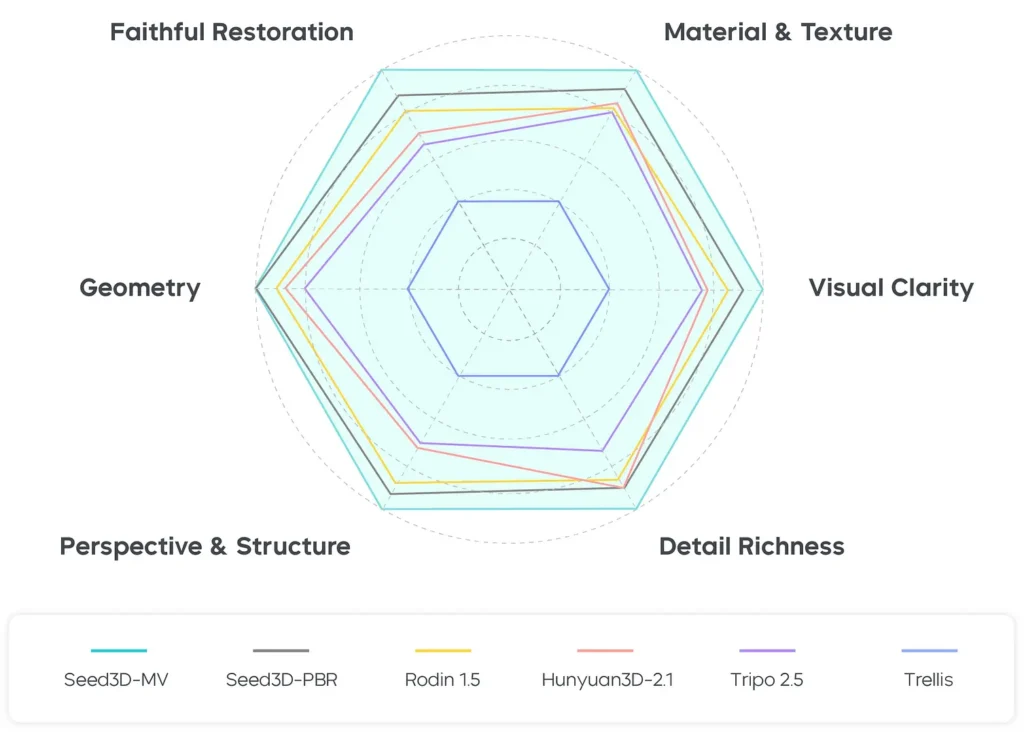

Evaluación humana (estudio de usuarios)

El artículo presenta un estudio de usuarios con 14 evaluadores humanos sobre un conjunto de pruebas de 43 imágenes. Los evaluadores compararon múltiples métodos en dimensiones como claridad visual, restauración fiel, precisión geométrica, perspectiva y estructura, realismo de materiales y texturas, y riqueza de detalles. Seed3D 1.0 recibió calificaciones subjetivas consistentemente más altas en estas categorías, con las ventajas más pronunciadas en geometría y calidad de materiales. El estudio con personas corrobora los parámetros cuantitativos, mostrando que el realismo percibido y la idoneidad de la simulación mejoraron con respecto a los valores de referencia.

¿Cómo funciona Seed3D 1.0 (arquitectura y pipeline)?

Seed3D 1.0 se presenta como un sistema multicomponente que combina representaciones de geometría latente aprendida, eliminación de ruido basada en transformadores en el espacio latente y módulos de finalización de texturas y multivista. El diseño es intencionalmente modular para que cada componente pueda optimizarse y actualizarse de forma independiente.

Componentes mayores

**Seed3D-VAE (codificador/decodificador de geometría latente)**Aprende una representación latente compacta para geometría 3D (p. ej., TSDF/malla latente). El VAE está entrenado para reconstruir geometría hermética de alta resolución a partir de códigos latentes comprimidos. Esto proporciona un cuello de botella eficiente para la etapa de generación.

**Seed3D-DiT (transformador de difusión para geometría)**Un transformador de flujo rectificado/denozador (similar a DiT) que opera en el espacio latente de la geometría aprendida. Condicionado por la incrustación de una imagen de referencia, denoza iterativamente los tokens latentes en una geometría latente que el VAE decodifica en una malla explícita.

Seed3D-MV (síntesis multivista) y Seed3D-UV (completado de texturas):Una vez producida la geometría inicial, el sistema sintetiza múltiples vistas para reducir la ambigüedad de la oclusión y luego completa los mapas UV a través de un módulo de mejora UV/repintado para producir texturas completas y coherentes.

Seed3D-PBR (descomposición de materiales):Descompone las texturas generadas en mapas PBR (metalicidad, rugosidad, mapas normales, etc.) de modo que las respuestas de contacto y sombreado físicamente plausibles se conserven en la simulación.

Modelo de visión-lenguaje para la factorización de escenasPara la generación de escenas, el pipeline utiliza VLM para detectar objetos, predecir relaciones espaciales y generar mapas de diseño (posición, escala, orientación). Los objetos individuales se generan y luego se ensamblan en una escena según el mapa de diseño. ()

Flujo de inferencia de alto nivel

- Entrada: imagen RGB única → el codificador de imágenes extrae la incrustación visual.

- Generación de geometría: Seed3D-DiT condicionado a la incrustación elimina el ruido de las latentes de la geometría → Seed3D-VAE decodifica la malla (hermética).

- Síntesis de múltiples vistas: genere vistas sintéticas a partir de la malla + canalización de renderizado para completar la textura.

- UV y textura: Seed3D-UV pinta oclusiones y produce mapas UV completos → Seed3D-PBR descompone las texturas en mapas de materiales.

- Exportar: producir .obj/.gltf con texturas y mapas de materiales, listos para motores de física (mallas de colisión, estimación de escala por VLM).

Generación de escenas

Seed3D no solo genera objetos individuales, sino que también genera automáticamente escenas completas.

Proceso de Generación:

- Entrada: Una imagen que contiene múltiples objetos;

- El modelo VLM identifica los objetos y las relaciones espaciales en la imagen;

- Seed3D genera la geometría y la textura de cada objeto;

- Finalmente, la disposición espacial se combina para formar una escena 3D completa.

¿Cuáles son las limitaciones y los desafíos abiertos?

Seed3D 1.0 es un gran paso, pero aún existen varias limitaciones, tanto intrínsecas a la generación de imágenes únicas como específicas de los contextos de simulación:

- Ambigüedad de vista única:Inferir la geometría ocluida y la topología exacta a partir de una vista es fundamentalmente un planteamiento incorrecto; las estadísticas previas y aprendidas ayudan, pero persisten los errores en el caso de regiones muy ocluidas.

- Corrección física a escala:si bien los activos están “preparados para la simulación” según muchas medidas prácticas, la estimación detallada de masa/inercia y la dinámica de las articulaciones para sistemas articulados complejos aún requieren un ajuste específico del dominio.

- Materiales raros y microestructura:Los materiales altamente especulares, translúcidos o anisotrópicos (por ejemplo, metales cepillados, telas con dispersión subsuperficial) son más difíciles de reproducir con precisión a partir de una sola imagen.

- Sesgos de datos:Las fuentes de datos de entrenamiento influyen en lo que el modelo captura bien: es posible que objetos poco comunes o artefactos culturalmente específicos se reproduzcan de manera deficiente.

- Propiedad intelectual y ética:Como ocurre con todos los sistemas generativos, los creadores y las organizaciones deben tener en cuenta la propiedad intelectual y la procedencia al convertir imágenes con derechos de autor en activos 3D.

Escenario de aplicación

Seed3D está posicionado explícitamente para IA encarnada y simulación casos de uso, pero las implicaciones abarcan múltiples industrias:

- Formación en robótica y aprendizaje a distanciaGeneración rápida de contenido para benchmarks de manipulación, programas de entrenamiento y conjuntos de datos aleatorizados por dominio para la transferencia de simulación a realidad. La preparación física de los recursos reduce la fricción del preprocesamiento.

- Desarrollo de juegos y XR:creación acelerada de activos para prototipos, accesorios de fondo o escenas completas; los flujos de trabajo PBR y las texturas 4K son particularmente útiles para experiencias de alta fidelidad.

- Producción y visualización virtual:generación rápida de accesorios y elementos ambientales para conceptualización o previsualización.

- Canales de creación de contenidoLos diseñadores pueden iterar desde referencias 2D (fotografías, arte) a prototipos 3D mucho más rápido, lo que permite flujos de trabajo híbridos humanos+IA donde los artistas afinan los resultados. ()

- InvestigaciónGeneración a gran escala de diversos datos de entrenamiento 3D para modelos de visión-lenguaje-acción y otras investigaciones multimodales. El artículo define explícitamente a Seed3D como una herramienta para impulsar la investigación a escala de simuladores mundiales y la inteligencia corpórea.

Seed3D puede convertir una sola fotografía en un objeto 3D detallado adecuado para simulación y uso interactivo, lo que amplía el acceso a la creación de contenido 3D de alta calidad.

Conclusión

Seed3D 1.0 de ByteDance representa un paso significativo hacia Generación 3D escalable y de calidad de simulación a partir de entradas 2D simples. Al combinar un flujo de trabajo de geometría enfocada (VAE + DiT), una estimación robusta de textura/PBR y la finalización UV, el sistema produce recursos fotorrealistas y de utilidad inmediata en simuladores de física. Esta combinación soluciona un obstáculo persistente para la investigación de IA incorporada y muchos flujos de trabajo aplicados. El rendimiento SOTA reportado del modelo (geometría y textura) y los resultados positivos de la evaluación humana lo convierten en una sólida incorporación al panorama generativo 3D en rápida evolución.

Primeros Pasos

CometAPI es una plataforma API unificada que integra más de 500 modelos de IA de proveedores líderes, como la serie GPT de OpenAI, Gemini de Google, Claude de Anthropic, Midjourney, Suno y más, en una única interfaz intuitiva para desarrolladores. Al ofrecer autenticación, formato de solicitudes y gestión de respuestas consistentes, CometAPI simplifica drásticamente la integración de las capacidades de IA en sus aplicaciones. Ya sea que esté desarrollando chatbots, generadores de imágenes, compositores musicales o canales de análisis basados en datos, CometAPI le permite iterar más rápido, controlar costos y mantenerse independiente del proveedor, todo mientras aprovecha los últimos avances del ecosistema de IA.

Los desarrolladores pueden acceder al modelo 3D y a otros modelos de ByteDance como API de Seedream 4.0 a través de CometAPI, la última versión del modelo Se actualiza constantemente con el sitio web oficial. Para empezar, explora las capacidades del modelo en el Playground y consultar el Guía de API Para obtener instrucciones detalladas, consulte la sección "Antes de acceder, asegúrese de haber iniciado sesión en CometAPI y de haber obtenido la clave API". CometAPI Ofrecemos un precio muy inferior al oficial para ayudarte a integrarte.

¿Listo para ir?→ Regístrate en CometAPI hoy !

Si quieres conocer más consejos, guías y novedades sobre IA síguenos en VK, X y Discord!