El Gemini 3.1 Pro ya está disponible en CometAPI, y puedes empezar a usarlo a través de los servicios de CometAPI — a un precio de lanzamiento más asequible que el precio oficial. CometAPI ya expone la familia Gemini 3 y proporciona una ruta compatible con OpenAI para invocar esos modelos desde una única pasarela unificada; esto hace que sea rápido experimentar con los modelos Gemini usando los SDK de OpenAI existentes

¿Qué es Gemini 3.1 Pro? (¿Por qué es importante?)

Gemini 3.1 Pro se refiere a una versión puntual/en vista previa dentro de la familia Gemini-3 — la misma familia de modelos insignia de Google que impulsa Gemini 3 Pro y las variantes “Flash” relacionadas. Las versiones Gemini 3.x se centran en un razonamiento multimodal más profundo (texto + imágenes + video), ventanas de tokens/contexto más amplias, generación de código mejorada (“vibe coding” y flujos de trabajo de agentes) y mejoras incrementales de rendimiento/eficiencia con respecto al lanzamiento inicial de Gemini 3 Pro. La familia Gemini 3 ahora está ampliamente disponible en las API y ofertas en la nube de Google.

Aspectos técnicos clave (lo que ofrece el modelo)

- Entradas multimodales: texto + imágenes + (en algunas variantes) video/audio.

- Ventanas de contexto muy largas (interacciones a escala de documentos y código de hasta ~1M tokens en las variantes compatibles).

- Herramientas para agentes y mejoras en la programación — diseñadas para agentes autónomos, integraciones con IDE y tareas de código complejas.

Benchmark de Gemini 3.1 Pro

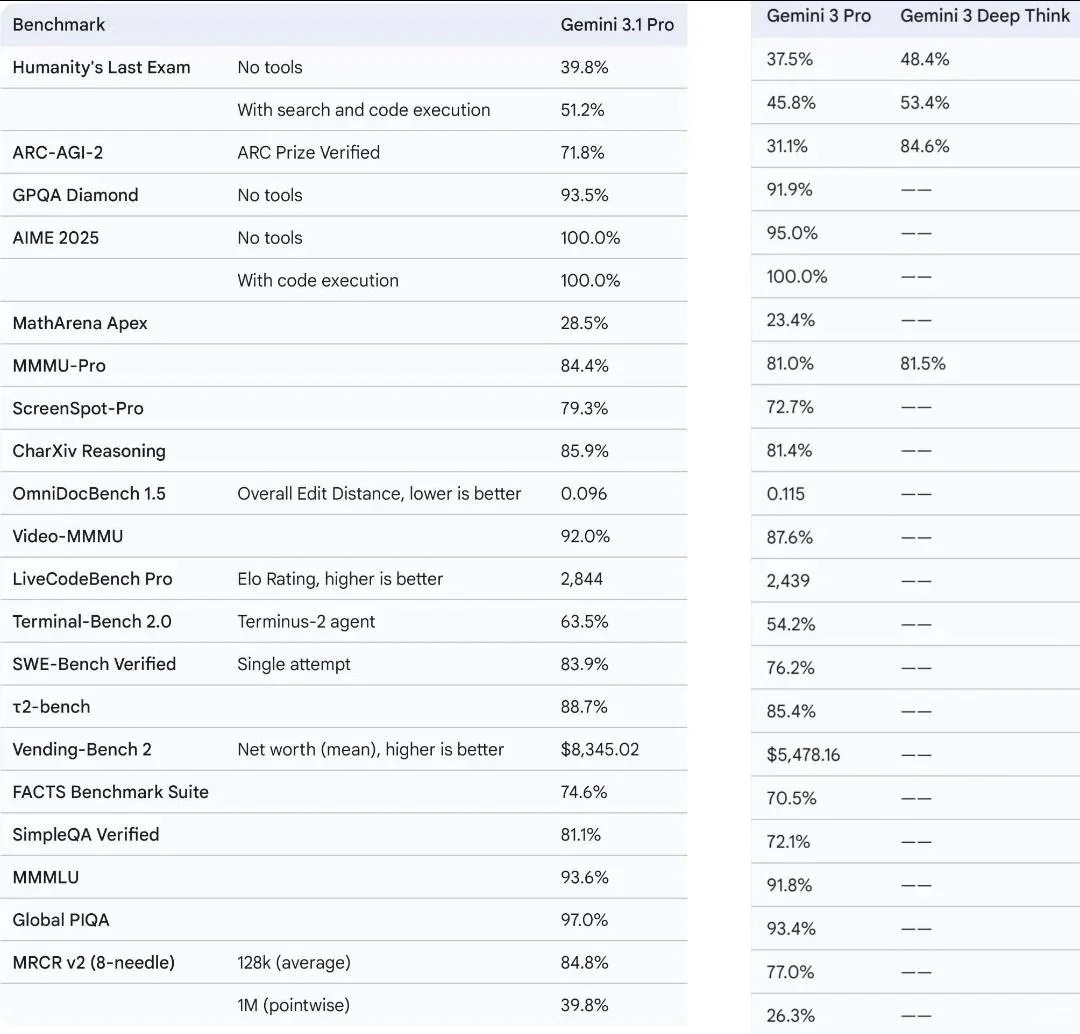

Los resultados de benchmark para Gemini 3.1 Pro son los siguientes: AIME 2025: 100% (incluida la ejecución de código); SWE-Bench Verified: 83.9%; ARC-AGI-2: 71.8%; LiveCodeBench Pro: 2844; Elo Terminal-Bench 2.0: 63.5%; MMMLU: 93.6%. Como referencia, Gemini 3 Pro obtuvo 76.2% en SWE-Bench. Será un gran salto adelante. El 84% en SWE es enorme.

vs Gemini 3.0 pro:

En los 23 benchmarks proporcionados, Gemini 3.1 Pro muestra una mejora promedio de aproximadamente 17.5%.

Sin embargo, como ilustran las capturas, las verdaderas “diferencias” se encuentran en las siguientes áreas:

Las mejoras más significativas no están en la “memorización de hechos”, sino en el razonamiento complejo y la fiabilidad en contextos largos: ARC-AGI-2 (+130.9%): Esta es la mejora más significativa. ARC mide la capacidad del modelo para aprender nuevas habilidades (inteligencia fluida) sobre la marcha, en lugar de depender de los datos de entrenamiento. El aumento del 31.1% al 71.8% indica un cambio arquitectónico importante en cómo el modelo “piensa”.

Vending-Bench 2 (+52.3%): Este benchmark rastrea el “valor neto” de un agente en su entorno. El salto aquí demuestra que la versión 3.1 supera significativamente a otras versiones en la planificación, la ejecución de tareas de múltiples pasos y la gestión eficaz de “herramientas”.

Contexto largo (MRCR v2 1 million points): Si bien el contexto estándar (128,000 tokens) ofrece una mejora de rendimiento del 10%, el salto de hasta 51.3% en 1 millón de tokens demuestra que la versión 3.1 es más estable y precisa al manejar cantidades masivas de datos.

¿CometAPI ofrece Gemini 3 / 3 Pro / 3.1?

Sí — CometAPI enumera públicamente la familia Gemini 3 (entradas de Gemini 3.1 Pro y cadenas de modelo relacionadas) en su catálogo de modelos y material de marketing, y muestra una ruta de integración compatible con OpenAI (API key única + base_url) para invocar modelos. CometAPI presenta ejemplos que usan un cliente de OpenAI apuntado a https://api.cometapi.com/v1 y nombres de modelos en el campo model. Eso significa que a menudo puedes invocar modelos de la familia Google Gemini a través de CometAPI con el código de cliente al estilo OpenAI que ya conoces. Gemini 3.1 pro ya se ofrece a través del marketplace y el playground unificados de CometAPI.

Paso a paso: lista de verificación rápida para comenzar

- Crea una cuenta en CometAPI y obtén una API key (CometAPI ofrece una clave gratuita/prueba en muchos casos).

- Desde la consola o el catálogo de modelos de CometAPI, confirma el nombre exacto del modelo (gemini-3.1-pro-preview).

- Usa el endpoint compatible con OpenAI de CometAPI (

base_url) y establece el parámetromodelen el alias de modelo del catálogo. - Comienza con prompts de prueba, verifica latencia/costo y luego escala con límites de velocidad y controles de ingeniería (timeouts, lógica de reintento, streaming, etc.).

Antes de acceder, asegúrate de haber iniciado sesión en CometAPI y de haber obtenido la API key. CometAPI ofrece un precio muy inferior al oficial para ayudarte a integrar.

¿Listo para empezar?→ Regístrate para Gemini 3.1 pro hoy !

Si quieres conocer más consejos, guías y noticias sobre IA, síguenos en VK, X y Discord!