Grok 3 y o3 representan la vanguardia en el modelado de lenguajes extensos, provenientes de dos de los laboratorios de IA más prestigiosos de la actualidad. Mientras xAI y OpenAI compiten por el liderazgo en razonamiento, multimodalidad e impacto en el mundo real, comprender las diferencias entre Grok 3 y o3 es crucial para desarrolladores, investigadores y empresas que consideren su adopción. Esta comparación exhaustiva explora sus orígenes, innovaciones arquitectónicas, rendimiento de referencia, aplicaciones prácticas y propuestas de valor, ayudándole a determinar qué modelo se ajusta mejor a sus objetivos.

¿Cuáles son los orígenes y los plazos de lanzamiento de Grok 3 y o3?

Comprender la génesis y las visiones detrás de Grok 3 y o3 prepara el escenario para apreciar cómo se ha posicionado cada modelo en el panorama de la IA.

¿Qué es Grok 3?

La serie Grok de xAI comenzó como un chatbot sin restricciones y con reglas flexibles en X (anteriormente Twitter). Grok 2.0 introdujo la integración con FLUX.1, pero Grok 3 marca un punto de inflexión: se promociona explícitamente como una "Era de Agentes Razonadores" que ofrece una profunda experiencia en finanzas, programación y extracción de textos legales. La visión de Elon Musk prioriza el debate abierto y menores restricciones de contenido, lo que permite a Grok 3 generar información controvertida o sin filtros cuando es necesario. El modo "Big Brain" utiliza pases computacionales adicionales, imitando la deliberación humana, y un nuevo motor de búsqueda profunda analiza datos web y de X en tiempo real para obtener un contexto granular.

La serie Grok de xAI se concibió para ir más allá de los agentes conversacionales y adentrarse en el ámbito del razonamiento autónomo. Grok 3, presentado en versión beta el 19 de febrero de 2025, se promocionó como "nuestro modelo más avanzado hasta la fecha", combinando módulos de razonamiento superiores con un amplio conocimiento preentrenado para facilitar diálogos y tareas más profundos y contextualizados. Elon Musk enfatizó que Grok 3 "supera a todos los rivales actuales de IA", incluyendo GPT-4o, Gemini y Claude de Anthropic, presentándolo como un desafío directo a las ofertas de OpenAI.

¿Qué es el O3?

La serie o de OpenAI se remonta a experimentos iniciales que encadenaban pasos de razonamiento antes de generar respuestas. El 16 de abril de 2025, OpenAI lanzó oficialmente o3 junto con o4-mini, destacando su capacidad de "pensar durante más tiempo antes de responder" e invocar herramientas y API externas de forma agente, capacidades cruciales para flujos de trabajo complejos y multimodales. Sam Altman elogió a o3 por demostrar una "inteligencia de nivel genio", lo que demuestra confianza en la capacidad del modelo para abordar tareas tradicionalmente reservadas a operadores humanos expertos.

La serie O de OpenAI evolucionó a partir de la introducción de la cadena de pensamiento privada por parte de O1 a finales de 2024. La arquitectura de O3 conserva los fundamentos del transformador, pero programa los pasos de inferencia para que "piensen" internamente antes de generar respuestas. Las rondas de acceso anticipado, realizadas entre diciembre de 2024 y enero de 2025, solicitaron la opinión de investigadores de seguridad, ajustando los parámetros para equilibrar la latencia con la precisión del razonamiento. O3-mini, orientado a aplicaciones sensibles al coste, mantiene objetivos de latencia similares a los de O1-mini, a la vez que potencia las capacidades STEM. O3, reservado para usuarios Pro y empresariales, aumenta el tiempo de inferencia para tareas complejas, lo que refleja la filosofía de desarrollo incremental, pero con enfoque en la seguridad, de OpenAI.

¿En qué se diferencian sus arquitecturas de modelos y estrategias de entrenamiento?

Si bien ambos modelos se basan en fundamentos transformadores, difieren en escala, mecanismos de razonamiento e integraciones multimodales.

Arquitectura central

- Grok 3: Conserva una estructura de transformadores a gran escala, reforzada con capas de razonamiento a medida, diseñadas para secuenciar explícitamente los pasos inferenciales. Esta arquitectura busca replicar la cadena de pensamiento similar a la humana, pero a escala de máquina.

- o3:Implementa un paradigma de razonamiento “agentico” donde el modelo asigna dinámicamente el esfuerzo computacional entre múltiples pasadas (baja, media o alta) para optimizar el equilibrio entre la latencia de respuesta y la profundidad del análisis.

Datos de entrenamiento y escala

- Grok 3:Según xAI, Grok 3 se entrenó en aproximadamente 200,000 GPU durante varias semanas, abarcando una combinación de texto a escala web, repositorios de código y conjuntos de datos multimedia seleccionados para permitir la comprensión tanto lingüística como visual.

- o3Basado en el extenso corpus de datos web y con licencia de OpenAI, el entrenamiento de o3 también incorporó aprendizaje de refuerzo basado en la retroalimentación humana (RLHF), optimizado específicamente para tareas de razonamiento de alto nivel. Si bien OpenAI no ha revelado la cantidad de GPU, las notas de la versión enfatizan un escalado eficiente para soportar un nivel de API tanto para investigadores como para clientes empresariales.

Capacidades multimodales

- Grok 3:La versión beta presentó funciones de generación de imágenes y búsqueda profunda, lo que sugiere que xAI apunta a un modelo unificado capaz de comprender y crear contenido visual junto con texto.

- o3:Admite la integración completa de herramientas, lo que permite llamadas encadenadas de forma nativa a las API de imágenes, ejecución de código y base de conocimiento de OpenAI, ofreciendo así un enfoque modular a la multimodalidad en lugar de un modelo monolítico todo en uno.

Escala del modelo, asignación de cómputo y pases de razonamiento

La afirmación de Grok 3 de "10 veces más capacidad de procesamiento" que Grok 2 aprovecha el aprendizaje de refuerzo a gran escala para permitir la corrección iterativa de errores en segundos o minutos, con resultados agregados mediante consenso@64 para mejorar la precisión. Este enfoque refleja los métodos de conjunto: se generan 64 respuestas candidatas y se selecciona la más frecuente. O3, en cambio, integra la cadena de pensamiento como un paso de planificación interna, evitando el muestreo externo pero aumentando el procesamiento interno por token. La profundidad de razonamiento de O3 se ajusta dinámicamente: las consultas más simples requieren menos pasos de reflexión, mientras que las indicaciones complejas desencadenan deliberaciones internas más largas.

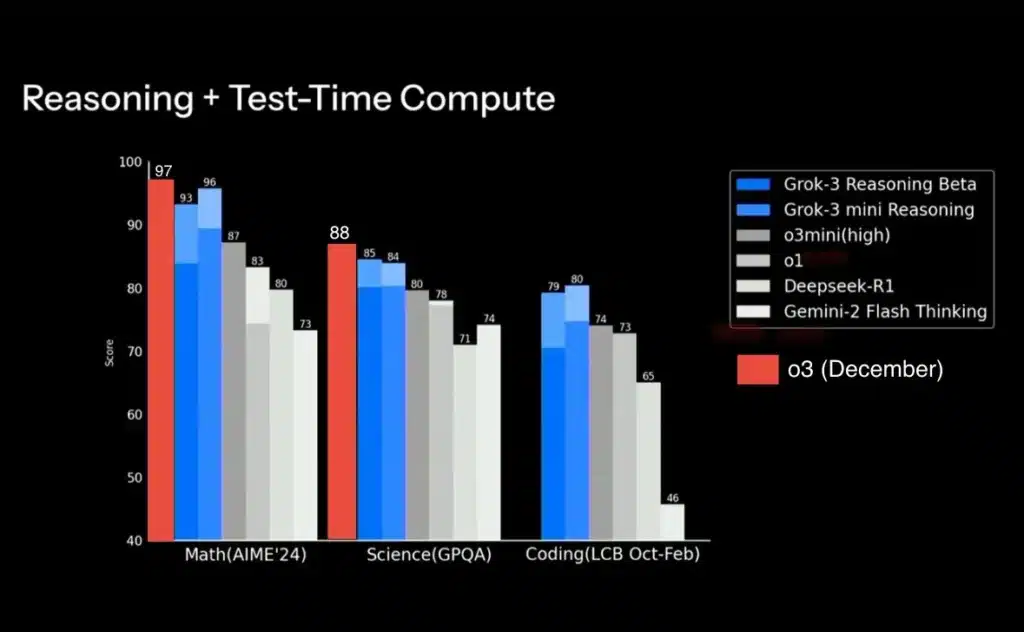

¿Qué modelo ofrece un rendimiento de referencia superior?

Puntos de referencia académicos y de codificación

En la prueba de razonamiento matemático AIME 2025, el método "consensus@3" de Grok 64 obtuvo una precisión del 89.2 %, ligeramente superior al 3 % de O87.3-mini-high en el mismo examen. En los desafíos de codificación, O3 obtuvo un Elo de Codeforces de 2727, superando tanto a Grok 3 (Elo estimado de ~2500) como a O3-mini (Elo de ~2300).

Preferencias de usuarios del mundo real y pruebas adversas

xAI reporta un Elo de 1402 en Chatbot Arena para Grok 3 (probado contra oponentes humanos e IA), superando la puntuación de 2 de x.ai para Grok 1203. Las evaluaciones internas de OpenAI muestran que O3 alcanza una tasa de satisfacción del usuario del 91 % en estudios comparativos frente a O1, con mejoras notables en las métricas de "profundidad de explicación" de OpenAI. Sin embargo, auditorías independientes han cuestionado la metodología de referencia de xAI por sobrerrepresentar los beneficios del muestreo de consenso de Grok 3 sin variantes comparables para O3, lo que subraya la necesidad de protocolos de evaluación estandarizados.

¿En qué aplicaciones del mundo real sobresalen estos modelos?

Más allá de los puntos de referencia, las tareas del mundo real iluminan cómo cada modelo puede generar valor en todas las industrias.

Flujos de trabajo creativos y de investigación

- Grok 3Los primeros revisores elogiaron su función de "búsqueda profunda", que muestra referencias académicas especializadas y genera esquemas detallados para contenido que requiere mucha reflexión, como artículos técnicos y propuestas de escritura creativa. La generación de imágenes integrada facilita además ciclos de ideación fluidos que combinan texto y elementos visuales.

- o3Los desarrolladores aprovechan su razonamiento de múltiples pasadas para crear prototipos de módulos de software complejos, depurar fragmentos de código y generar visualizaciones de datos mediante llamadas encadenadas, lo que agiliza los flujos de trabajo de investigación de un extremo a otro sin salir del entorno de API.

Tareas científicas y de laboratorio

- Grok 3Si bien la versión beta de xAI no se ha probado exhaustivamente en contextos de laboratorio, su núcleo de razonamiento mejorado muestra potencial para la generación de hipótesis y las revisiones de literatura, reduciendo potencialmente el tiempo que los científicos dedican a la minería de datos preliminar.

- o3De eficacia probada en la resolución de problemas de virología controlada, o3 puede asistir en el diseño de protocolos, el análisis de errores y la interpretación de datos, actuando eficazmente como un asistente de laboratorio virtual. Sin embargo, las organizaciones deben implementar una gobernanza estricta para mitigar los riesgos de bioseguridad.

¿Qué ecosistemas e integraciones impulsan la adopción?

Grok 3: Integración X y perspectivas en tiempo real

Grok 3 está integrado en los niveles Premium+ y SuperGrok de X, ofreciendo experiencias de chatbot en la app, vistas previas del modo de voz y acceso a la API empresarial a través de docs.x.ai. DeepSearch y, próximamente, DeeperSearch permiten a los profesionales consultar opiniones sociales, documentos legales o datos financieros en tiempo real directamente sin salir de X. Sin embargo, las deficiencias en la moderación de contenido han generado controversia cuando Grok 3 genera desinformación u contenido ofensivo, lo que ha llevado a xAI a insinuar futuras capas de protección.

O3: Implementación multiplataforma y centrada en el desarrollador

OpenAI ha implementado O3 en ChatGPT (Plus, Pro, Enterprise) y en los endpoints de API, así como en integraciones con Microsoft Azure y GitHub Copilot. Los desarrolladores aprovechan la cadena de pensamiento de O3 mediante indicadores del SDK, lo que permite pasos de razonamiento selectivos para cada caso de uso. La disponibilidad gratuita de O3-mini para todos los usuarios de ChatGPT (con límites de velocidad) democratiza el acceso, mientras que los suscriptores Pro desbloquean el nivel de razonamiento "alto". La carga de archivos e imágenes amplía aún más la aplicabilidad de O3 al análisis de documentos y la respuesta visual a preguntas.

¿Cómo se comparan los modelos de precios?

Precios centrados en el modelo de xAI

La API empresarial de Grok 3 se lanzó en abril de 3 a un precio de 15 $ por millón de tokens de entrada y 2025 $ por millón de tokens de salida, con descuentos por volumen. Grok 3 mini se ofrece a aproximadamente la mitad de estos precios, ideal para proyectos de bajo presupuesto. Los usuarios de X Premium+ pagan 40 $ al mes por acceso prioritario, mientras que los suscriptores de SuperGrok pagan una prima no revelada por consultas ilimitadas en Grok.

Estrategia de acceso escalonado de OpenAI

OpenAI incluye O3-mini en los planes ChatGPT Plus (20 $/mes) y Pro (30 $/mes): los usuarios del plan Plus obtienen razonamiento de nivel medio, mientras que el plan Pro desbloquea el de nivel alto sin cargos adicionales. Las llamadas a la API de O3 cuestan 6 $ por millón de tokens (el doble que la tarifa de O1, pero la mitad del precio del token de salida de Grok 3), lo que refleja el compromiso de OpenAI de equilibrar coste y capacidad. Este enfoque escalonado simplifica la gestión presupuestaria para startups e investigadores, aunque a costa de un control preciso sobre los niveles de razonamiento que xAI expone.

Grok 3 vs O3: ¿cuál deberías elegir?

Comparación de rendimiento: velocidad, escalabilidad y confiabilidad

| Métrica de rendimiento | o3 | Grok 3 |

|---|---|---|

| Response time | Promedio de 120 ms bajo carga | Promedio de 90 ms bajo carga |

| Global | Escalado horizontal con Kubernetes | Escalado vertical con almacenamiento en caché optimizado |

| Confiabilidad del tiempo de actividad | SLA del 99.95% | SLA del 99.9% |

| Rendimiento (solicitudes/seg) | 5000+ | 4500+ |

| Latencia del procesamiento de datos | 150 ms (modo por lotes) | 80 ms (transmisión en tiempo real) |

La elección entre Grok 3 y o3 depende de requisitos específicos, prioridades estratégicas y tolerancia al riesgo.

Recomendaciones basadas en casos de uso

- Para una investigación profunda y creatividad multimodalLas capacidades integradas de búsqueda profunda e imágenes de Grok 3 lo hacen ideal para agencias de contenido, estudios de diseño e instituciones académicas que buscan un bloc de dibujo todo en uno para la ideación y la creación de prototipos.

- Para flujos de trabajo empresariales y cadenas de herramientas:La integración de herramientas agentic de o3 y el acceso API inmediato son adecuados para equipos de software, analistas financieros y laboratorios científicos que requieren una ampliación modular y confiable dentro de las tuberías existentes.

Utilice Grok 3 y O3 en CometAPI

CometAPI Ofrecemos un precio mucho más bajo que el precio oficial para ayudarte a integrarte API de O3 (nombre del modelo: o3/ o3-2025-04-16) y API de Grok 3 (nombre del modelo: grok-3;grok-3-lates¡Recibirás $1 en tu cuenta después de registrarte e iniciar sesión! Bienvenido a registrarte y a probar CometAPI.

Para comenzar, explore las capacidades del modelo en el Playground y consulte la Guía de API Para obtener instrucciones detalladas, tenga en cuenta que algunos desarrolladores podrían necesitar verificar su organización antes de usar el modelo.

Los precios en CometAPI están estructurados de la siguiente manera:

| Categoría: | API de O3 | Grok 3 |

| Precios de API | o3/ o3-2025-04-16 Tokens de entrada: $8/M tokens Tokens de salida: $32/M tokens | grok-3;grok-3-latest Tokens de entrada: $1.6/M tokens Tokens de salida: $6.4 / M tokens grok-3-fast Tokens de entrada: $4/M tokens Tokens de salida: $20 / M tokens |

Conclusión

Grok 3 y O3 representan la vanguardia actual del razonamiento en IA. Grok 3 se basa en la computación sin procesar, la integración abierta con redes sociales y los resultados sin filtrar, lo que resulta atractivo para usuarios avanzados y empresas que buscan información en tiempo real. O3, por otro lado, incorpora un enfoque mesurado de cadena de pensamiento integrada, amplia compatibilidad con plataformas y precios diferenciados que fomenta su adopción generalizada. En última instancia, la elección depende de los requisitos del proyecto: Grok 3 destaca en entornos dinámicos y ricos en datos, mientras que O3 ofrece consistencia, seguridad y madurez del ecosistema. A medida que xAI y OpenAI perfeccionan sus modelos, los usuarios pueden esperar avances continuos en precisión, eficiencia y multimodalidad, dando forma a la próxima generación de asistentes de IA.