Luma AI se ha convertido en una de las herramientas más comentadas en la creación de contenido para consumidores y prosumidores: una app y un servicio en la nube que convierte fotos y vídeos de smartphones en NeRF 3D fotorrealistas y, mediante sus modelos Dream Machine/Ray2, genera imágenes y vídeos cortos a partir de indicaciones de texto o imagen. Pero la velocidad es una de las primeras preguntas prácticas que se plantean los creadores: ¿cuánto tiempo tarda realmente una captura, renderizado o generación de vídeo?

¿Cuánto tiempo tarda Luma AI en generar un clip de Dream Machine (texto → vídeo)?

Horarios oficiales de referencia

Las páginas de producto y el centro de aprendizaje de Luma ofrecen tiempos de referencia rápidos para sus procesos de generación de imágenes y vídeos cortos: los lotes de imágenes se miden en decenas de segundos y los trabajos de vídeo cortos en segundos o minutos en condiciones normales para usuarios de pago y comparativas internas. Estas métricas oficiales reflejan ejecuciones optimizadas del modelo en la infraestructura de Luma (pila Ray2/Dream Machine) y son las cifras óptimas para clips cortos.

Rangos reales que debes esperar

Casos extremos / nivel gratuito o carga máxima:los usuarios gratuitos o épocas de mucha demanda han producido esperas de horas o trabajos atascados en cola hasta que se libere capacidad; los hilos de la comunidad documentan esperas de varias horas durante horas punta o interrupciones. Si la baja latencia es crucial, considere esta variabilidad y considere opciones de pago o prioritarias.

Pequeños clips sociales (5 a 15 segundos):en muchos casos, el paso de generación por sí solo puede completarse en Menos de un minuto a unos pocos minutos para usuarios pagos durante la carga normal, pero el tiempo total de reloj puede ser mayor cuando se incluyen los pasos de puesta en cola, preprocesamiento y transmisión/exportación.

Clips con mayor detalle o más largos (20–60 segundos):estos pueden tomar varios minutos a decenas de minutos, especialmente si solicita una mayor resolución, movimientos de cámara complejos o refinamiento iterativo. Las reseñas de terceros y las cuentas de usuario informan tiempos típicos en el 5–30 minutos Banda para vídeos cortos más complejos.

¿Cuánto tiempo tarda Luma AI en producir una captura 3D (captura NeRF / Genie / teléfono)?

Flujos de trabajo típicos de captura 3D y sus perfiles de tiempo

Las herramientas de captura 3D de Luma (la app de captura móvil + funciones similares a las de Genie) transforman un conjunto de fotos o un vídeo grabado en un modelo 3D o una malla texturizada similar a NeRF. A diferencia de los clips cortos de Dream Machine, la reconstrucción 3D es más compleja: requiere la ingesta de muchos fotogramas, la estimación de las poses de la cámara, la optimización de la geometría volumétrica y la síntesis de texturas. Los tutoriales públicos y las guías prácticas informan. tiempos de procesamiento en el mundo real desde varios minutos hasta varias horas, dependiendo de la duración y calidad de la captura. Un ejemplo de tutorial comúnmente citado mostró 30 minutos a una hora para una captura moderada; otros tipos de captura (recorridos largos, fotogramas de alta resolución) pueden tardar más.

Rangos representativos

- Escaneos rápidos de objetos/productos (20 a 80 fotos, captura corta): unos minutos a ~30 minutos.

- Capturas a escala de sala o de recorrido (cientos a miles de fotogramas): 30 minutos a varias horas, dependiendo del tamaño de entrada y la fidelidad de la exportación final.

- Exportaciones de alta fidelidad para motores de juego (mallas, texturas de alta resolución): agregue tiempo adicional para la generación de malla, la retopología y el horneado; esto puede impulsar los trabajos hacia el horas.

¿Por qué el 3D tarda más que los vídeos cortos?

La reconstrucción 3D es iterativa y requiere mucha optimización: el modelo refina los campos volumétricos y las predicciones de textura a lo largo de muchos fotogramas, lo que requiere un alto consumo computacional. El backend de Luma paraleliza gran parte de este trabajo, pero la escala de computación por trabajo sigue siendo mayor que la generación de un solo vídeo corto.

¿Cuáles son los principales factores que afectan el tiempo de procesamiento de Luma AI?

Elección de modelo y canalización (Ray2, Photon, Genie, Modify Video)

Los diferentes modelos y funciones de Luma están diseñados para lograr diferentes ventajas y desventajas: Ray2 y Dream Machine priorizan la generación de video fotorrealista con retroalimentación interactiva de baja latencia, mientras que Photon y Genie están optimizados para la mejora de imágenes o la reconstrucción 3D y pueden ser más pesados por diseño. Elegir un modelo con mayor fidelidad aumentará el tiempo de cómputo. La documentación oficial y la API describen múltiples puntos finales del modelo e indicadores de calidad que afectan el tiempo de ejecución.

Tamaño de entrada y complejidad

- Número de marcos/fotos:más entrada = más pasos de optimización.

- Resolución:Las resoluciones de salida más altas y las entradas de mayor resolución aumentan el tiempo de procesamiento.

- Duración del clip solicitado:los clips más largos requieren más controles de renderizado y coherencia de movimiento.

Nivel de cuenta, cola y prioridad

Las suscripciones de pago y los clientes empresariales/API suelen recibir prioridad o límites de velocidad más altos. Los usuarios de la versión gratuita suelen experimentar tiempos de espera más largos cuando el sistema está sobrecargado. Los informes de la comunidad lo confirman: los planes de pago generalmente reducen la espera y mejoran el rendimiento.

Carga del sistema y hora del día

Los hilos de usuarios reales muestran que los tiempos de generación pueden aumentar durante las horas punta o cuando el lanzamiento de funciones importantes provoca picos de actividad. El equipo de Luma actualiza continuamente la infraestructura (ver registros de cambios) para abordar la capacidad, pero aún se producen retrasos transitorios.

Tiempo de carga/red y dispositivo cliente

Para los flujos de trabajo de captura, la velocidad de carga y el rendimiento del dispositivo son importantes: las cargas de captura de varios gigabytes aumentan los tiempos de procesamiento incluso antes de que comience el procesamiento. La documentación de Luma indica los tamaños máximos de archivo y recomienda las mejores prácticas de captura para minimizar la transferencia innecesaria de datos.

¿Cómo puedo estimar el tiempo de trabajo con antelación y reducir la espera?

Lista de verificación de estimación rápida

- Clasifique su trabajo:imagen, video corto (<15 s), video más largo (>15 s) o captura 3D.

- Contar entradas: número de fotos / duración del vídeo (segundos) / tamaño del archivo de captura.

- Decidir la calidad: fidelidad baja, estándar o alta: mayor fidelidad = procesamiento más prolongado.

- Consultar el nivel de la cuenta:gratis vs. pago vs. empresarial; tenga en cuenta las posibles colas.

- Realizar una prueba breve:crea un trabajo de prueba de 5 a 10 segundos para recopilar una línea de base del mundo real.

Consejos prácticos para acelerar el rendimiento

- Utilice patrones de captura recomendados (movimiento fluido de cámara, iluminación uniforme) para que la reconstrucción converja más rápido. El centro de aprendizaje y las páginas de la aplicación móvil de Luma ofrecen las mejores prácticas de captura.

- Reducir el tamaño de entrada cuando sea aceptable: recorte, reduzca la resolución o recorte el metraje antes de cargarlo para reducir el tiempo y el costo de procesamiento.

- Elija ajustes preestablecidos de menor calidad para los borradores, luego finalícelo en alta calidad solo cuando esté satisfecho con la composición.

- Programe recorridos pesados fuera de las horas punta Si es posible, los informes de la comunidad indican que las colas se reducen fuera de las horas pico.

- Considere las opciones API/empresariales Si necesita escala y un SLA predecible, la API y el registro de cambios de Luma muestran inversiones continuas en rendimiento y nuevos puntos finales como Modificar video para optimizar los flujos de trabajo.

¿Cómo se comparan los números de tiempo de Luma con los de otras herramientas?

Comparar servicios generativos de imagen/vídeo o NeRF es complejo, ya que cada proveedor optimiza diferentes opciones (calidad, velocidad y coste). Para la generación de imágenes y vídeos de corta duración, Dream Machine de Luma, especialmente con Ray2 Flash, compite con una latencia interactiva de menos de un minuto, similar a la de los principales servicios generativos orientados al consumidor. Para la captura de NeRF de escena completa y la creación de modelos 3D de alta fidelidad, las necesidades de computación en la nube y los tiempos de inserción de colas son mayores que los de los generadores de imágenes rápidos: se espera una mayor variabilidad y se debe planificar en consecuencia. La documentación de los socios y los informes de terceros suelen indicar... minutos para renders cortos y simples y horas (o impredeciblemente más tiempo) para pipelines 3D complejos.

Veredicto final: ¿cuánto tiempo? will Luma toma para my ¿trabajo?

No existe una cifra única que se ajuste a todos los usuarios ni a todos los trabajos. Utilice estos puntos de referencia pragmáticos para estimar:

- Generación de imágenes (Dream Machine): ~20–30 segundos por lote pequeño bajo carga normal.

- Generación de vídeos cortos (Dream Machine / Ray2): Decenas de segundos a unos pocos minutos para clips cortos; Ray2 Flash puede ser significativamente más rápido en flujos compatibles.

- Captura 3D → NeRF: muy variable Mejor caso: minutos para un objeto pequeño y computador ligero; Peor caso (reportado): Muchas horas o días durante alta demanda o para capturas muy grandes. Si necesita plazos fijos, adquiera planes prioritarios/empresariales o realice pruebas piloto de preproducción e incorpore un margen de tiempo planificado en su cronograma.

Primeros Pasos

CometAPI es una plataforma API unificada que integra más de 500 modelos de IA de proveedores líderes, como la serie GPT de OpenAI, Gemini de Google, Claude de Anthropic, Midjourney, Suno y más, en una única interfaz intuitiva para desarrolladores. Al ofrecer autenticación, formato de solicitudes y gestión de respuestas consistentes, CometAPI simplifica drásticamente la integración de las capacidades de IA en sus aplicaciones. Ya sea que esté desarrollando chatbots, generadores de imágenes, compositores musicales o canales de análisis basados en datos, CometAPI le permite iterar más rápido, controlar costos y mantenerse independiente del proveedor, todo mientras aprovecha los últimos avances del ecosistema de IA.

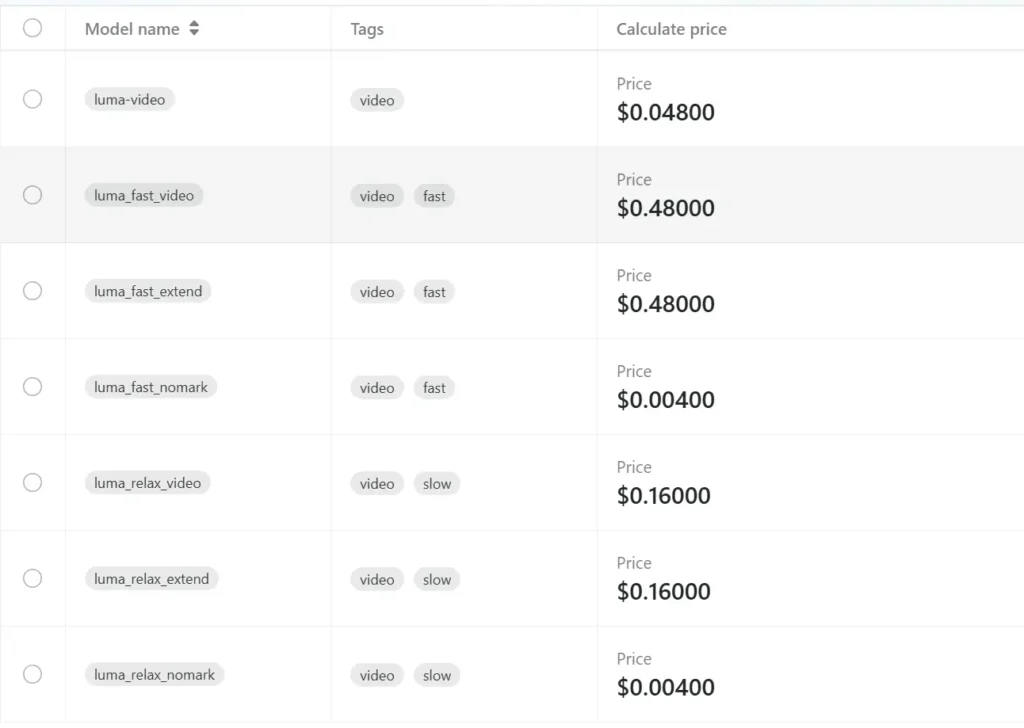

Los desarrolladores pueden acceder API de Luma atravesar CometAPILas últimas versiones de los modelos mencionados corresponden a la fecha de publicación del artículo. Para comenzar, explore las capacidades del modelo en... Playground y consultar el Guía de API Para obtener instrucciones detalladas, consulte la sección "Antes de acceder, asegúrese de haber iniciado sesión en CometAPI y de haber obtenido la clave API". CometAPI Ofrecemos un precio muy inferior al oficial para ayudarte a integrar: