En el cambiante panorama de la inteligencia artificial, la sinergia entre plataformas y modelos es fundamental para desarrollar aplicaciones robustas de IA. Dify, una plataforma de desarrollo de aplicaciones LLM (Large Language Model) de código abierto, ofrece una integración fluida con los potentes modelos de CometAPI. Este artículo profundiza en las características de Dify, explica el proceso de integración con CometAPI y ofrece información sobre cómo acceder y optimizar esta colaboración.

¿Por qué integrar Dify con CometAPI?

La integración de Dify con CometAPI combina las fortalezas de ambas plataformas, lo que permite a los desarrolladores:

- Aproveche los modelos de lenguaje avanzados:Utilice los modelos LLM de que están integrados en la interfaz intuitiva de Dify.

- Optimice el desarrollo de aplicaciones de IA:Acelere la transición del prototipo a la producción aprovechando las herramientas integrales de Dify junto con las capacidades de CometAPI.

- Personalice y controle las soluciones de IA:Adapte las aplicaciones de IA a necesidades específicas manteniendo el control sobre los datos y los flujos de trabajo.

¿Qué es CometAPI?

CometAPI es una plataforma API unificada que integra más de 500 modelos de IA de proveedores líderes, como la serie GPT de OpenAI, Gemini de Google, Claude de Anthropic, Midjourney, Suno y más, en una única interfaz intuitiva para desarrolladores. Al ofrecer autenticación, formato de solicitudes y gestión de respuestas consistentes, CometAPI simplifica drásticamente la integración de las capacidades de IA en sus aplicaciones. Ya sea que esté desarrollando chatbots, generadores de imágenes, compositores musicales o canales de análisis basados en datos, CometAPI le permite iterar más rápido, controlar costos y mantenerse independiente del proveedor, todo mientras aprovecha los últimos avances del ecosistema de IA.

¿Qué es Dify?

Dificar Es una plataforma de código abierto diseñada para simplificar el desarrollo de aplicaciones de IA basadas en grandes modelos de lenguaje. Integra diversas funcionalidades, como flujos de trabajo de IA, pipelines de Recuperación-Generación Aumentada (RAG), capacidades de agente, gestión de modelos y funciones de observabilidad, lo que facilita una transición fluida desde el concepto hasta la implementación.

Características principales de Dify

- Interfaz intuitiva:Dify ofrece una interfaz fácil de usar que simplifica la creación y gestión de aplicaciones de IA.

- Soporte integral de modelos:Admite la integración con numerosos LLM propietarios y de código abierto.

- IDE de PromptDify proporciona herramientas para crear y probar indicaciones, comparar el rendimiento de los modelos y mejorar las interacciones de las aplicaciones.

- Tubería RAG:La plataforma incluye un sólido pipeline RAG para la ingesta y recuperación de documentos, compatible con diversos formatos como PDF y PPT.

- Marco del agente:Dify permite la definición de agentes con herramientas prediseñadas o personalizadas, ampliando la funcionalidad de las aplicaciones de IA.

- LLMOps:Ofrece herramientas de monitoreo y análisis para observar los registros y el rendimiento de las aplicaciones, ayudando en la mejora continua.

- Backend como servicio:Dify proporciona API correspondientes para todas sus funciones, lo que facilita una fácil integración en la lógica empresarial existente.

¿Cómo funciona Dify?

Dify opera proporcionando un entorno estructurado donde los desarrolladores pueden crear, probar e implementar aplicaciones de IA. Su arquitectura permite la integración de diversos modelos de lenguaje, lo que permite flexibilidad y personalización en el desarrollo de aplicaciones.

Flujo de trabajo en Dify

- Integración de modelos:Conecte y configure modelos de lenguaje compatibles con la API de OpenAI (u otros) API de DeepSeek R1, Grok 4, modelo llama, modelos geimin, etc.)

- Ingeniería rápida:Desarrolle y refine indicaciones utilizando Prompt IDE de Dify para lograr los resultados deseados.

- Desarrollo de aplicaciones:Utilice las herramientas de Dify para crear aplicaciones, incorporando flujos de trabajo, agentes y pipelines RAG según sea necesario.

- Pruebas y Optimización:Pruebe aplicaciones dentro de Dify, analice registros de rendimiento y realice los ajustes necesarios.

- Despliegue:Implementar la aplicación, aprovechando los servicios de backend y las API de Dify para su integración en sistemas más amplios.

¿Cómo integrar Dify con CometAPI?

La integración de Dify con CometAPI implica varios pasos clave para garantizar una conexión perfecta entre las plataformas.

A continuación, se presenta un flujo de trabajo práctico que abarca la instalación del nodo CometAPI (plugin) y su integración en los flujos de Dify. Las etiquetas de la interfaz de usuario pueden evolucionar, pero estos pasos reflejan el patrón actual de plugin/mercado + proveedor de modelos utilizado por Dify y Flowise.

Paso 1: Obtenga su clave CometAPI

- Regístrate o inicia sesión en tu Consola CometAPI.

- Cree o navegue a su página de claves API y copie el

sk-xxxxxClave del proyecto que usarás. Guárdala de forma segura para los siguientes pasos.

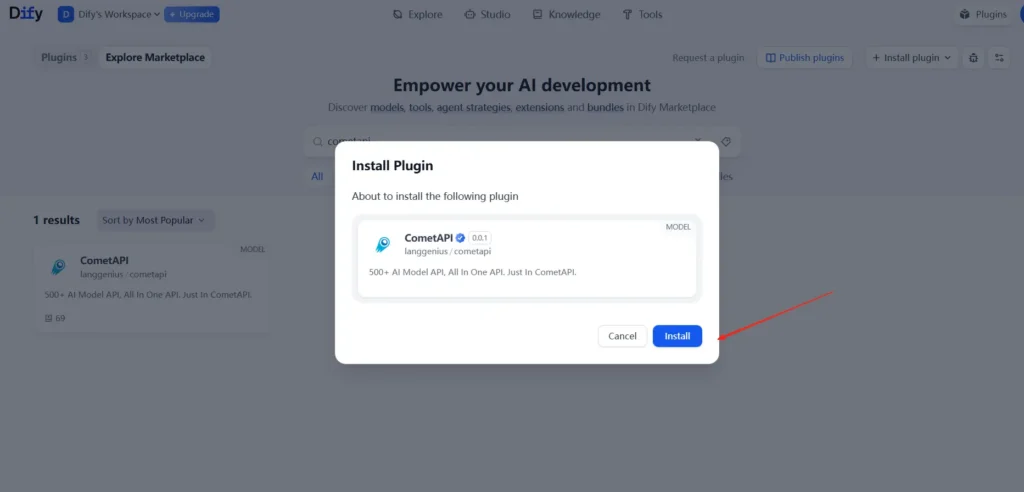

Paso 2: Instalar el complemento CometAPI en Dify

- En Dify, vaya a la Tienda Virtual or Plugins sección (el mercado de complementos de Dify es el punto de entrada para integraciones de terceros).

- Encuentre CometAPI (o proveedor “Comet” / “CometAPI”) y haga clic en Instalar.

- Después de la instalación, abra la configuración/configuración del complemento para CometAPI dentro de Dify.

Nota: Si su implementación de Dify está autohospedada, es posible que necesite derechos de administrador para agregar complementos.

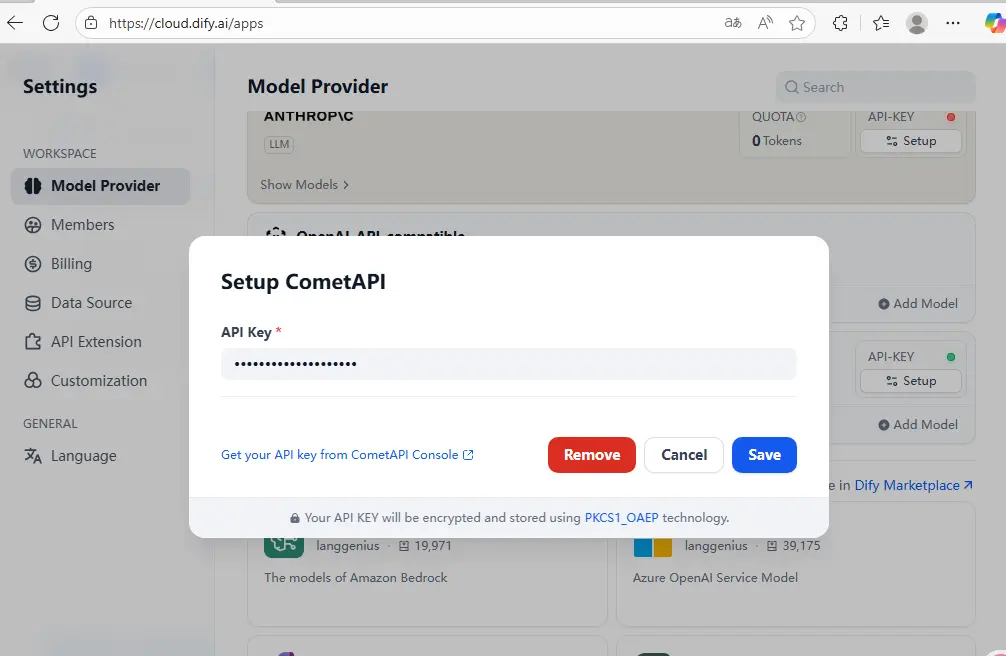

Paso 3: Configurar el complemento CometAPI en Dify

- En la configuración del complemento, pegue su

sk-xxxxxClave API en el API Key / Secreto . - Opcionalmente, puede configurar los modelos predeterminados o las opciones del proveedor que solicita el complemento (por ejemplo, puede elegir una familia de modelos predeterminada).

- Guarde la configuración del complemento. En este punto, Dify debería poder llamar a CometAPI para la inferencia del modelo. (Si Dify ofrece botones de invocación de prueba, ejecute una pequeña solicitud de prueba para confirmar la conectividad).

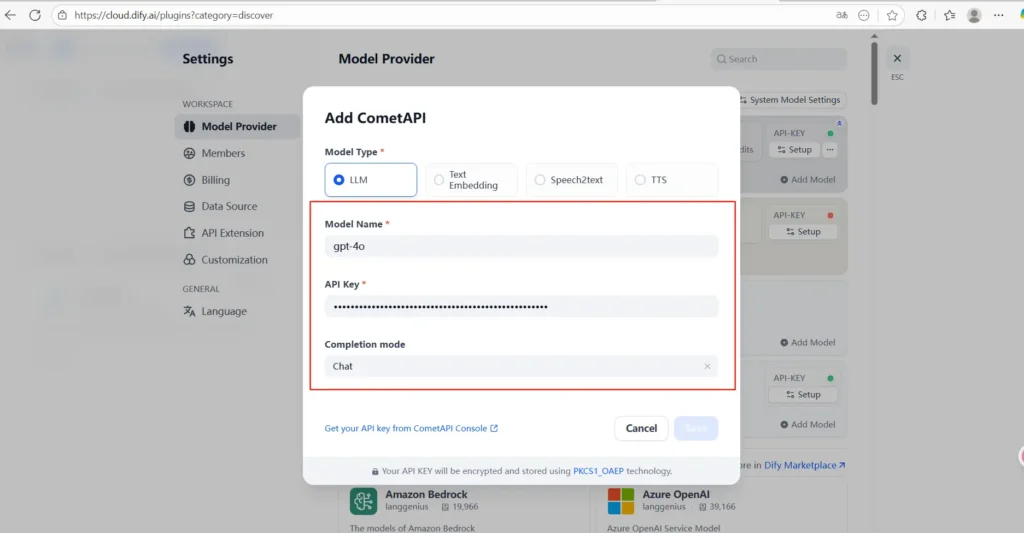

Paso 4: Agregar CometAPI como proveedor de modelos en los flujos de Dify

- Abra o cree el flujo de trabajo/agente de Dify que desee utilizar.

- Agregue un nodo (LLM/Modelo) y elija CometAPI de la lista de proveedores de modelos (este es el nodo CometAPI instalado a través del complemento).

- Configure las plantillas de solicitud, las fuentes de contexto (base de conocimiento RAG) y la temperatura/parámetros como lo haría normalmente.

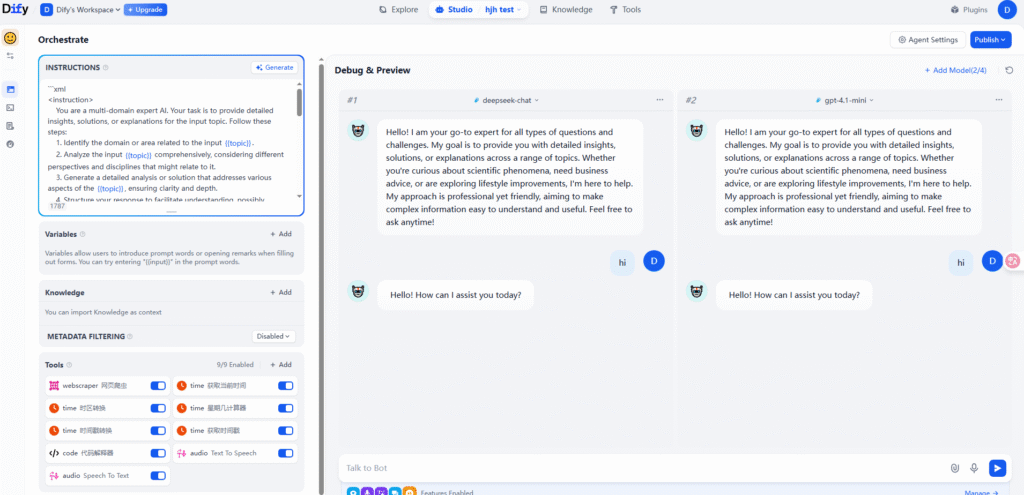

- Pruebe una conversación de principio a fin: solicitud → Orquestación de Dify → Modelo de CometAPI → respuesta. Cree una prueba rápida en el IDE de solicitud de Dify que llame a un modelo pequeño y económico (p. ej.,

o3-minio un nombre de modelo de bajo costo similar compatible con CometAPI) y verificar una respuesta de texto normal. Verificar la latencia y el formato. - Registros del monitor: Utilice las herramientas de observación de Dify y el panel de CometAPI para confirmar solicitudes/usos y detectar errores (autenticación, límites de velocidad).

Ejemplo (conceptual) de fragmento YAML para una tarea de Dify

Dify utiliza definiciones declarativas para muchos flujos. El siguiente fragmento es conceptual; adáptelo a su versión de Dify y a los campos del plugin:

model_provider: cometapi

model: gpt-4o-mini

api_key_secret: dify_plugin_cometapi_key

prompt:

- role: system

content: "You are an assistant..."

(Consulte siempre los documentos de instalación de Dify para conocer los nombres de campo exactos).

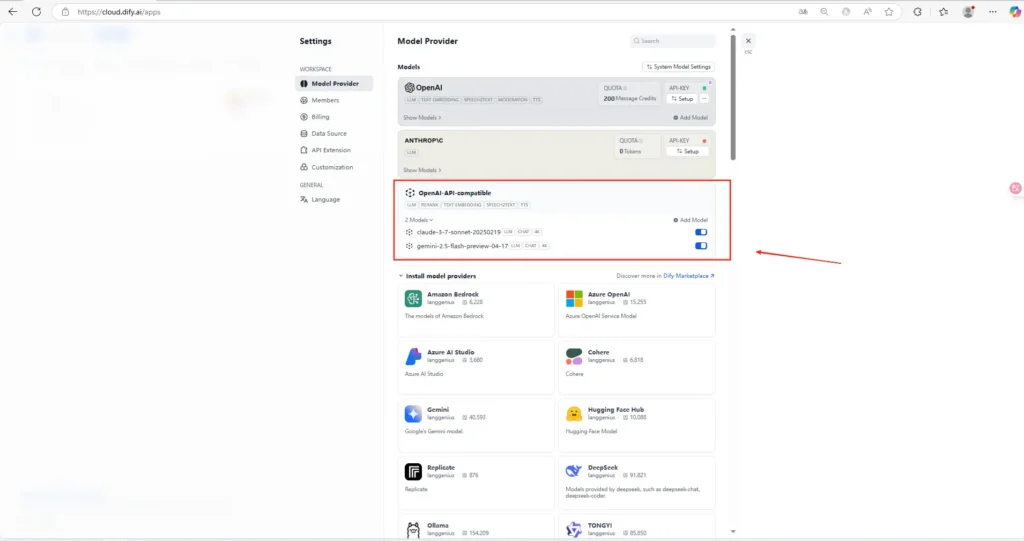

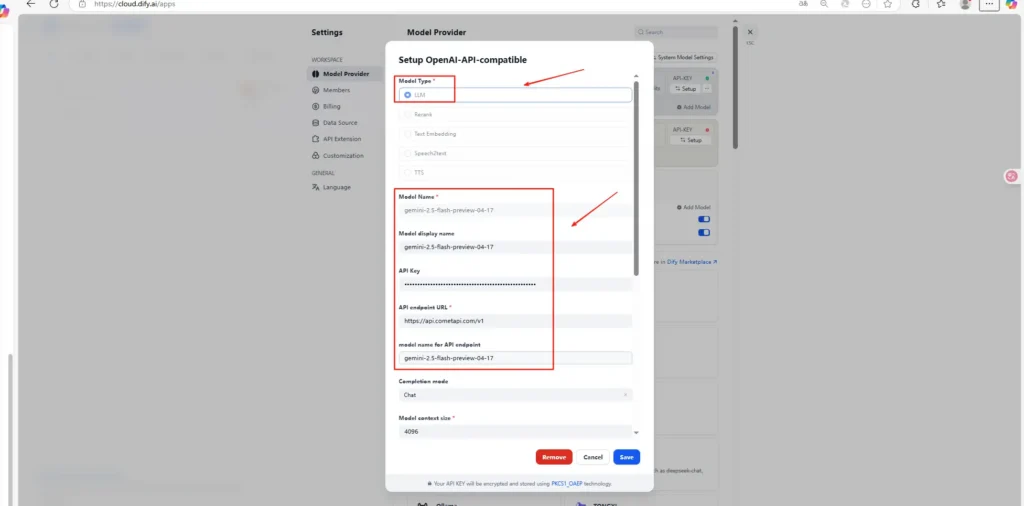

Otro método: Formato OpenAI

- Acceda a la configuración de Dify:Navegue a la sección de configuración dentro de la plataforma Dify.

- Configurar proveedores de modelos:Ubica y selecciona la opción de proveedores de modelos.

- Agregar modelo como proveedor: Elija agregar un nuevo proveedor de modelos y seleccione OpenAI (u otro) de las opciones disponibles.

- Ingrese las credenciales API:Ingrese su clave API de CometAPI y configure la URL del punto final de la API.

- Establecer parámetros del modelo:Defina parámetros como el tipo de modelo (por ejemplo, GPT-4), la longitud del contexto y los límites máximos de tokens.

- Habilitar funcionalidad:Configure ajustes adicionales como llamada de funciones, llamada de herramientas y soporte multimodal según sea necesario.

- Guardar y probar:Guarde la configuración y pruebe la integración para garantizar el funcionamiento adecuado.

Además de openAI, CometAPI proporciona más API de modelos de generación de contenido como API de DeepSeek R1, Grok 4, modelos geimin, etc., así como modelos de imágenes de texto y modelos de generación de vídeo como FLUX.1 Contexto, API de Veo 3 y API de viaje a mitad de camino etc., para ayudarle a crear su propio flujo de trabajo.

Situaciones y soluciones de resolución de problemas comunes

- Errores de autenticación: Si Dify muestra un error de autenticación, verifique la

sk-xxxxxClave y si la pegó en el campo de proveedor correcto. Confirme que Dify puede comunicarsehttps://api.cometapi.com. - Respuestas inesperadas / formato: Asegúrese de que el formato de la solicitud coincida con el estilo de OpenAI (CometAPI acepta el formato compatible con OpenAI). Verifique también

modelnombres de parámetros. - Alta latencia: Pruebe diferentes modelos de CometAPI; la latencia puede variar según la familia de modelos. También verifique la salida de red de su host Dify.

- Picos de costos: Verifique los límites de tokens en Dify y el uso en el panel de CometAPI; limite o cambie a modelos más económicos para flujos no críticos.

¿Qué casos de uso del mundo real se benefician de esta integración?

Caso de uso 1: Evaluación multimodelo para el servicio al cliente

Ponga en marcha un flujo de chat de Dify respaldado por el nodo CometAPI y realice pruebas A/B de las respuestas. gpt-4o, claude-3.7 y un candidato más pequeño y económico. Para preguntas y respuestas comunes, redirija a un modelo CometAPI de bajo costo. Para consultas complejas o de varios pasos, escale a un modelo de mayor capacidad (o a un modelo multimodal) mediante CometAPI.

Caso de uso 2: Asistente de conocimiento interno con alternativas seguras

Cree una canalización RAG en Dify que utilice incrustaciones y recuperación, pero que invoque CometAPI para la generación. Si el modelo grande alcanza los límites de velocidad, recurra automáticamente a un modelo CometAPI más pequeño. Flowise puede usarse para crear prototipos de cadenas de indicaciones antes de migrar el flujo a Dify para producción.

Caso de uso 3: Experimentación rápida para aplicaciones multimodales

CometAPI expone modelos de imagen y audio (p. ej., Suno, Runway). Combine la orquestación de Dify (direccionando las cargas de medios al servicio adecuado) con la conmutación de modelos de CometAPI para crear prototipos de funciones multimodales rápidamente.

- Utilice la orquestación de Dify para recopilar informes, plantillas y guías de estilo.

- Utilice CometAPI para llamar a un modelo de imagen (Midjourney/ API de imágenes Flash de Gemini 2.5 (Nano-Banana) modelo) y un LLM para subtítulos en el mismo flujo. La lista de modelos unificada de CometAPI simplifica esta orquestación.

Conclusión

La integración de Dify con CometAPI abre nuevas posibilidades para las aplicaciones basadas en IA, ofreciendo un flujo de trabajo optimizado, amplias opciones de personalización y capacidades de IA mejoradas. Al seguir las mejores prácticas, abordar los posibles desafíos y mantenerse al día con los nuevos avances, los desarrolladores pueden maximizar el potencial de esta integración para crear soluciones innovadoras basadas en IA.

Para comenzar a integrar CometAPI con Dify, explore las capacidades del modelo en el Playground y consultar el Dify Guía de API Para obtener instrucciones detalladas, consulte la sección "Antes de acceder, asegúrese de haber iniciado sesión en CometAPI y de haber obtenido la clave API". CometAPI Ofrecemos un precio muy inferior al oficial para ayudarte a integrarte.

¿Listo para ir?→ Regístrate en CometAPI hoy !