La API de Llama 4 es una interfaz potente que permite a los desarrolladores integrar MetaLos últimos modelos de lenguaje multimodal de gran tamaño, que permiten capacidades avanzadas de procesamiento de texto, imágenes y videos en diversas aplicaciones.

Descripción general de la serie Llama 4

La serie Llama 4 de Meta presenta modelos de IA de vanguardia diseñados para procesar y traducir diversos formatos de datos, como texto, vídeo, imágenes y audio, lo que mejora la versatilidad en diversas aplicaciones. La serie incluye:

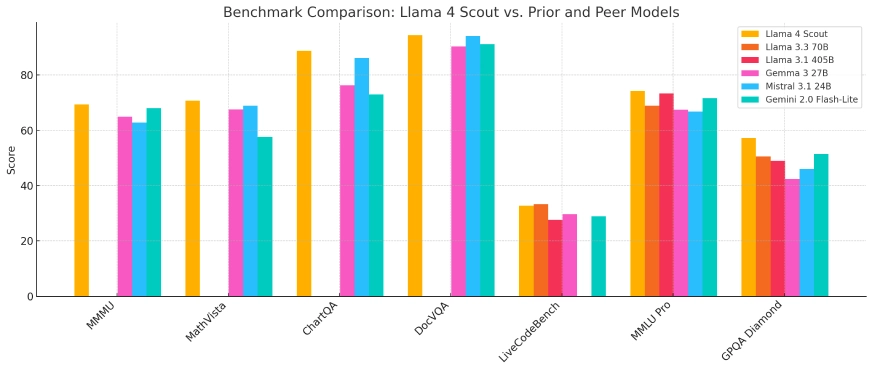

- Llama 4 ScoutUn modelo compacto optimizado para su implementación en una sola GPU Nvidia H100, con una ventana de contexto de 10 millones de tokens. Supera a competidores como Gemma 3 y Mistral 3.1 de Google en diversas pruebas de rendimiento.

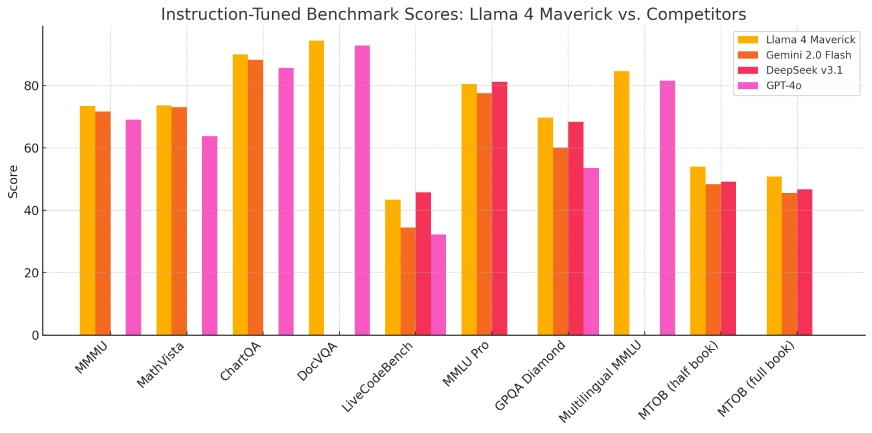

- Llama 4 Maverick:Un modelo más grande comparable en rendimiento a GPT-4o y DeepSeek-V3 de OpenAI en tareas de codificación y razonamiento, mientras que utiliza menos parámetros activos.

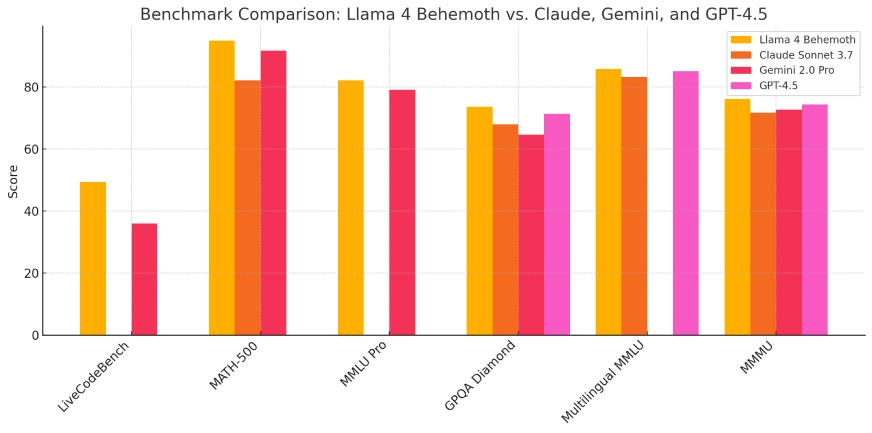

- Llama 4 BehemothActualmente en desarrollo, este modelo cuenta con 288 mil millones de parámetros activos y un total de 2 billones, y apunta a superar modelos como GPT-4.5 y Claude Sonnet 3.7 en los puntos de referencia STEM.

Estos modelos están integrados en el asistente de IA de Meta en plataformas como WhatsApp, Messenger, Instagram y la web, mejorando las interacciones del usuario con capacidades de IA avanzadas.

| Modelo | Parámetros totales | Parámetros activos | Expertos | Longitud del contexto | Se ejecuta en | Acceso público | Ideal para |

|---|---|---|---|---|---|---|---|

| explorador | 109B | 17B | 16 | 10 millones de fichas | Nvidia H100 única | ✅ sí | Tareas de IA ligeras, aplicaciones de contexto largo |

| Maverick | 400B | 17B | 128 | No se especifica | GPU única o múltiple | ✅ sí | Investigación, aplicaciones empresariales, codificación |

| Behemoth | ~2 toneladas | 288B | 16 | No se especifica | Meta infraestructura interna | ❌No | Capacitación y evaluación comparativa de modelos internos |

Arquitectura técnica e innovaciones

La serie Llama 4 emplea una arquitectura de "mezcla de expertos" (MoE), un enfoque innovador que optimiza el uso de recursos al activar únicamente los subconjuntos relevantes de los parámetros del modelo durante tareas específicas. Este diseño mejora la eficiencia computacional y el rendimiento, permitiendo que los modelos gestionen tareas complejas con mayor eficacia.

El entrenamiento de estos modelos requirió considerables recursos computacionales. Meta utilizó un clúster de GPU compuesto por más de 100,000 100 chips Nvidia HXNUMX, lo que representa una de las infraestructuras de entrenamiento de IA más grandes hasta la fecha. Esta gran capacidad computacional facilitó el desarrollo de modelos con capacidades y métricas de rendimiento mejoradas.

Evolución de los modelos anteriores

Basándose en las bases de iteraciones anteriores, la serie Llama 4 representa una evolución significativa en el desarrollo de modelos de IA de Meta. La integración de capacidades de procesamiento multimodal y la adopción de la arquitectura MoE abordan las limitaciones observadas en modelos anteriores, como las dificultades en el razonamiento y las tareas matemáticas. Estos avances posicionan a Llama 4 como un competidor formidable en el panorama de la IA.

Indicadores técnicos y de rendimiento de referencia

En evaluaciones comparativas, Llama 4 Scout demostró un rendimiento superior al de modelos como Gemma 3 y Mistral 3.1 de Google, especialmente en tareas que requieren un procesamiento de contexto exhaustivo. Llama 4 Maverick mostró capacidades comparables a las de modelos líderes como GPT-4o de OpenAI, especialmente en tareas de codificación y razonamiento, manteniendo un uso más eficiente de los parámetros. Estos resultados subrayan la eficacia de la arquitectura MoE y el exhaustivo programa de entrenamiento empleado.

Llama 4 Scout

Llama 4 Maverick

Llama 4 Behemot:

Escenarios de aplicación

La versatilidad de la serie Llama 4 permite su aplicación en diversos dominios:

- De Integración Social de Medios:Mejorar las interacciones de los usuarios en plataformas como WhatsApp, Messenger e Instagram a través de funciones avanzadas impulsadas por IA, incluidas recomendaciones de contenido mejoradas y agentes conversacionales.

- Creación de contenidos:Ayudar a los creadores a generar contenido multimodal de alta calidad mediante el procesamiento y la síntesis de texto, imágenes y vídeos, agilizando así el proceso creativo.

- Herramientas educativas:Facilitar el desarrollo de sistemas de tutoría inteligentes que puedan interpretar y responder a diversos formatos de datos, proporcionando una experiencia de aprendizaje más inmersiva.

- Análisis de negocio:Permitir a las empresas analizar e interpretar conjuntos de datos complejos, incluida información textual y visual, para obtener información útil e informar los procesos de toma de decisiones.

La integración de los modelos Llama 4 en las plataformas de Meta ejemplifica su utilidad práctica y su potencial para mejorar las experiencias de los usuarios en diversas aplicaciones.

Consideraciones éticas y estrategia de código abierto

Si bien Meta promociona la serie Llama 4 como de código abierto, las condiciones de licencia incluyen restricciones para entidades comerciales con más de 700 millones de usuarios. Este enfoque ha suscitado críticas por parte de la Iniciativa de Código Abierto, lo que pone de relieve el debate actual sobre el equilibrio entre el acceso abierto y los intereses comerciales en el desarrollo de la IA.

La importante inversión de Meta, que según se informa asciende a 65 mil millones de dólares en infraestructura de IA, subraya el compromiso de la empresa de mejorar las capacidades de IA y mantener una ventaja competitiva en el panorama de IA en rápida evolución.

Conclusión

La introducción de la serie Llama 4 de Meta marca un avance fundamental en inteligencia artificial, mostrando mejoras significativas en procesamiento multimodal, eficiencia y rendimiento. Gracias a diseños arquitectónicos innovadores y una inversión computacional sustancial, estos modelos establecen nuevos referentes en las capacidades de IA. A medida que Meta continúa integrando estos modelos en sus plataformas y explorando nuevos desarrollos, la serie Llama 4 está lista para desempeñar un papel crucial en la configuración del futuro de las aplicaciones y servicios de IA.

Cómo llamar a la API de Llama 4 desde CometAPI

1.Iniciar sesión a cometapi.comSi aún no eres nuestro usuario, por favor regístrate primero.

2.Obtener la clave API de credenciales de acceso De la interfaz. Haga clic en "Agregar token" en el token de API del centro personal, obtenga la clave del token: sk-xxxxx y envíela.

-

Obtenga la URL de este sitio: https://api.cometapi.com/

-

Seleccione Llama 4 (Nombre del modelo: llama-4-disidente; llama-4-explorador) punto final para enviar la solicitud de API y configurar el cuerpo de la solicitud. El método y el cuerpo de la solicitud se obtienen de nuestra documentación de la API del sitio webNuestro sitio web también ofrece la prueba Apifox para su comodidad.

- Para obtener información sobre el modelo publicado en Comet API, consulte https://api.cometapi.com/new-model.

- Para obtener información sobre el precio del modelo en Comet API, consulte https://api.cometapi.com/pricing

| Categoría: | llama-4-disidente | llama-4-explorador |

| Precios de API | Tokens de entrada: $0.48/M tokens | Tokens de entrada: $0.216 / M tokens |

| Tokens de salida: $1.44/M tokens | Tokens de salida: $1.152/M tokens |

- Procesa la respuesta de la API para obtener la respuesta generada. Tras enviar la solicitud a la API, recibirás un objeto JSON con la finalización generada.