Especificaciones técnicas de la API Seed 1.8

| Elemento | Especificación / nota |

|---|---|

| Nombre del modelo / familia | Doubao-Seed-1.8 (Seed1.8) — ByteDance Seed / Volcano Engine |

| Modalidades compatibles | Texto, imágenes, video (capacidades multimodales de VLM), herramientas de audio en el ecosistema (modelos separados para generación de audio/video). |

| Ventana de contexto (texto) | 256K tokens |

| Capacidad de video / visual | Diseñado para el razonamiento con videos largos, admite codificación visual eficiente y grandes presupuestos de tokens de video (la ficha del modelo informa experimentos de tokens de video y benchmarks de video largo). |

| Formatos de entrada | Prompts de texto libre; carga de imágenes (capturas de pantalla, gráficos, fotos); video como fotogramas tokenizados / herramientas de video para inspección de segmentos; carga de archivos (documentos). |

| Formatos de salida | Texto en lenguaje natural, salidas estructuradas (structured-output beta), llamadas a funciones / llamadas a herramientas, código y salidas multimodales mediante orquestación. |

| Modos de pensamiento / inferencia | no_think, think-low, think-medium, think-high — con un equilibrio entre precisión y latencia/costo. |

¿Qué es Doubao Seed 1.8?

Doubao Seed 1.8 es la versión 1.8 del equipo Seed: un modelo unificado LLM+VLM que apunta explícitamente a la agencia generalizada del mundo real, es decir, percepción (imágenes/video), razonamiento, orquestación de herramientas (búsqueda, llamadas a funciones, ejecución de código, GUI grounding) y toma de decisiones en múltiples pasos dentro de un único modelo. El diseño enfatiza modos de “pensamiento” configurables (compensaciones entre latencia y profundidad), codificación visual eficiente y soporte nativo para contexto largo e entradas multimodales, de modo que el modelo pueda operar como asistente/agente autónomo en flujos de trabajo de producción.

Características principales de la API Seed 1.8

- Modelo unificado multimodal y agente. Integra percepción (imagen/video), razonamiento (LLM) y acción (llamadas a herramientas/G U I, ejecución de código) en un único modelo en lugar de una canalización dividida. Esto permite flujos de trabajo de agentes más compactos y menor complejidad de orquestación.

- Contexto ultralargo y manejo de videos largos. Contexto largo (soporte del producto hasta 256k tokens) y benchmarks específicos de video largo (Seed1.8 muestra una sólida eficiencia de tokens en video largo). El modelo admite herramientas de video selectivas (VideoCut) para enfocar el razonamiento en marcas de tiempo.

- Automatización agentiva de GUI y uso de herramientas. Benchmarks y pruebas internas (OSWorld, AndroidWorld, LiveCodeBench, benchmarks de GUI grounding) muestran mejoras en tareas de agente de GUI y automatización en múltiples pasos. El modelo puede emitir comandos de GUI grounding y operar dentro de contextos simulados de SO/web/móvil.

- Modos de pensamiento configurables para controlar latencia/costo. Cuatro modos de inferencia permiten a los desarrolladores ajustar el cómputo en tiempo de prueba para tareas interactivas vs. lotes de alta calidad. Esto es útil para sistemas de producción con presupuestos de latencia estrictos.

- Eficiencia de tokens mejorada (multimodal). Seed 1.8 demuestra mayor eficiencia de tokens en benchmarks multimodales frente a sus predecesores (serie Seed-1.5/1.6), logrando alta precisión con presupuestos de tokens más pequeños en varias tareas de video largo.

- Modos de pensamiento configurables: intercambian profundidad de inferencia vs. latencia/costo con modos distintos (

no_think→think-high) para ajustar el uso en producción interactiva. - Capacidades técnicas

- Token efficiency: Seed1.8 muestra una marcada eficiencia de tokens frente a los predecesores (Seed-1.5/1.6), ofreciendo mayor precisión con presupuestos de tokens más bajos en tareas de video largo (p. ej., logrando precisión competitiva incluso con 32K video tokens). Esto permite menor costo de inferencia para entradas largas.

- Multimodal reasoning & perception: El modelo alcanza SOTA en varias tareas de VQA multiimagen y movimiento/percepción y obtiene segundo lugar o cerca de SOTA en muchos benchmarks de razonamiento multimodal; específicamente supera a su predecesor en casi todas las dimensiones visuales/de video medidas.

- Agentic tool use & GUI grounding: Soporte documentado para GUI grounding y benchmarks de operación basada en pantalla (ScreenSpot-Pro, GUI agenting) con sólidos puntajes de grounding (p. ej., mejoras sobre Seed-1.5-VL en ScreenSpot-Pro).

- Parallel / stepped reasoning: Incrementar el cómputo en tiempo de prueba (pensamiento paralelo) produce ganancias medibles en benchmarks de matemáticas, programación y razonamiento multimodal

Aspectos destacados de benchmarks públicos seleccionados de Seed1.8

- VCRBench (visual commonsense reasoning): Seed1.8 obtuvo 59.8 (Pass@1 reportado en la tabla de la ficha del modelo), una mejora sobre Seed-1.5-VL y competitivo con modelos líderes

- VideoHolmes (video reasoning): Seed1.8 65.5, superando a Seed-1.5-VL y acercándose a modelos competidores de grado profesional.

- MMLB-NIAH (multimodal long-context, 128k): Seed1.8 alcanzó 72.2 Pass@1 a 128k de contexto en MMLB-NIAH, superando a algunos modelos profesionales contemporáneos.

- Motion & Perception suite: SOTA en 5 de 6 tareas evaluadas; ejemplos incluyen TVBench, TempCompass y TOMATO donde Seed1.8 muestra ganancias sustanciales en percepción temporal.

- Agentic workflows: En BrowseComp y otros benchmarks de búsqueda/código con agencia, Seed1.8 a menudo se sitúa cerca o por encima de modelos profesionales competidores

Seed 1.8 vs Gemini 3 Pro / GPT-5.x

- Seed1.8 vs Seed-1.5-VL / Seed-1.6: Mejoras claras en percepción multimodal, eficiencia de tokens para videos largos y ejecución agentiva.

- Seed1.8 vs Gemini 3 Pro / GPT-5.x: En muchos benchmarks multimodales Seed1.8 igual o supera a Gemini 3 Pro (SOTA en varias tareas de VQA / movimiento; mejor en la ejecución a 128k de MMLB-NIAH). Sin embargo, la ficha también muestra áreas donde la familia Gemini mantiene ventajas en ciertas tareas de conocimiento disciplinario, por lo que el orden relativo depende del benchmark.

- Seed-Code variant (Doubao-Seed-Code): especializado para tareas de programación/agentic code (contexto grande para bases de código; benchmarks SWE especializados). Seed1.8 es el modelo multimodal agentivo generalista, mientras que Seed-Code es la variante centrada en programación.

Casos de uso prácticos con la API Seedream 4.5 en CometAPI

- Asistentes de investigación multimodal y análisis de documentos: extraer, resumir y razonar a través de documentos largos, presentaciones y reportes de múltiples páginas.

- Comprensión y monitoreo de videos largos: analítica de seguridad/transmisiones deportivas, resumen de reuniones largas y análisis en streaming donde la eficiencia de tokens de video largo del modelo es relevante.

- Flujos de trabajo agentivos / automatización: escenarios de búsqueda web en múltiples pasos + ejecución de código + extracción de datos (p. ej., análisis competitivo automatizado, planificación de viajes, pipelines de investigación demostrados en benchmarks internos).

- Herramientas para desarrolladores (si usas Seed-Code): análisis de bases de código grandes, asistentes de IDE y ejecución agentiva de código para pruebas y reparación (Seed-Code es la variante especializada recomendada).

- Automatización de GUI y RPA: los benchmarks de grounding de pantalla y agentes de GUI indican que el modelo puede realizar tareas de GUI estructuradas mejor que versiones anteriores de Seed.

Cómo usar la API doubao Seed 1.8 a través de CometAPI

Doubao seed1.8 se ofrece comercialmente mediante CometAPI como una API de inferencia alojada. La API admite cargas multimodales (texto + imágenes + fragmentos de video / marcas de tiempo) y modos de inferencia configurables para equilibrar latencia y cómputo frente a la calidad de la respuesta.

Patrones de llamada: La API admite solicitudes de estilo chat/completion estándar, respuestas en streaming y flujos agentivos donde el modelo emite llamadas a herramientas (búsqueda, ejecución de código, acciones de GUI) e ingiere salidas de herramientas como contexto subsiguiente.

Streaming y manejo de contexto largo: La API admite streaming y cuenta con primitivas de gestión de contexto integradas para sesiones largas (para habilitar contextos de más de 100K / trazas de agentes de múltiples pasos).

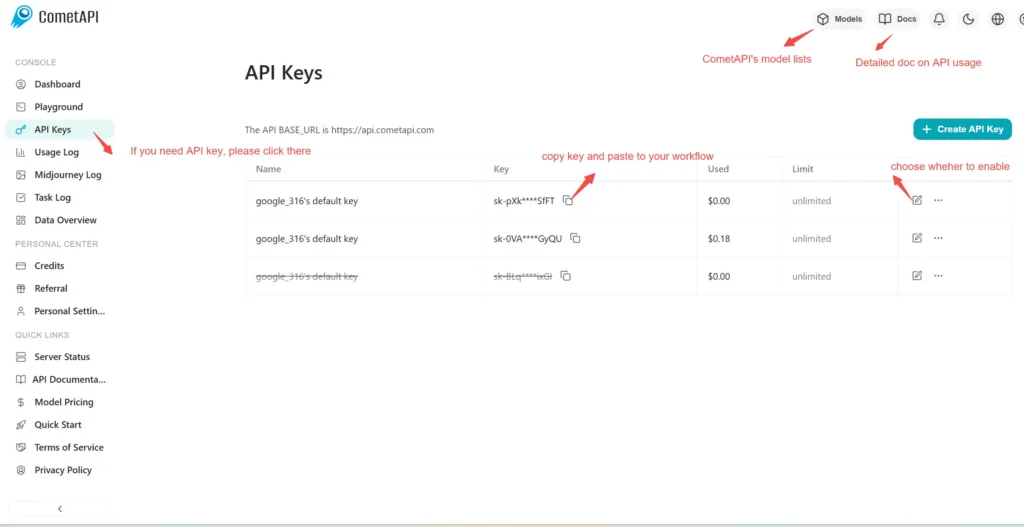

Paso 1: Regístrate para obtener la clave de API

Inicia sesión en cometapi.com. Si aún no eres usuario, regístrate primero. Inicia sesión en tu CometAPI console. Obtén la credencial de acceso (API key) de la interfaz. Haz clic en “Add Token” en el token de API en el centro personal, obtén la clave del token: sk-xxxxx y envíala.

Paso 2: Envía solicitudes a la API doubao Seed 1.8

Selecciona el endpoint “doubao-seed-1-8-251228” para enviar la solicitud a la API y configura el cuerpo de la solicitud. El método y el cuerpo de la solicitud se obtienen en la documentación de la API de nuestro sitio web. Nuestro sitio web también ofrece pruebas en Apifox para tu conveniencia. Reemplaza <YOUR_API_KEY> con tu clave real de CometAPI de tu cuenta. Compatibilidad con las APIs de Chat.

Inserta tu pregunta o solicitud en el campo content—esto es a lo que el modelo responderá. Procesa la respuesta de la API para obtener la respuesta generada.

Paso 3: Recupera y verifica los resultados

Procesa la respuesta de la API para obtener la respuesta generada. Después del procesamiento, la API responde con el estado de la tarea y los datos de salida.