Qué es la API de GPT-5.2

La API de GPT-5.2 es la misma que GPT-5.2 Thinking en ChatGPT. GPT-5.2 Thinking es la variante de nivel intermedio de la familia GPT-5.2 de OpenAI, diseñada para trabajo más profundo: razonamiento de varios pasos, resumen de documentos largos, generación de código de calidad y trabajo profesional del conocimiento en el que la precisión y una estructura útil importan más que el rendimiento bruto. En la API se expone como el modelo gpt-5.2 (Responses API / Chat Completions), y se sitúa entre la variante Instant de baja latencia y la variante Pro, de mayor calidad pero más costosa.

Características principales

- Contexto muy amplio y compactación: ventana efectiva de 400K y herramientas de compactación para gestionar la relevancia en conversaciones y documentos extensos.

- Esfuerzo de razonamiento configurable:

none | medium | high | xhigh(xhighhabilita el máximo cómputo interno para razonamientos complejos).xhighestá disponible en las variantes Thinking/Pro. - Compatibilidad más sólida con herramientas y funciones: llamadas a herramientas de primera clase, gramáticas (CFG/Lark) para restringir salidas estructuradas y comportamientos agénticos mejorados que simplifican automatizaciones complejas de varios pasos.

- Comprensión multimodal: comprensión más rica de imagen + texto e integración en tareas de varios pasos.

- Mejoras de seguridad / manejo de contenido sensible: intervenciones específicas para reducir respuestas no deseadas en áreas como autolesiones y otros contextos sensibles.

Capacidades técnicas y especificaciones (visión del desarrollador)

- Endpoints de API e ID de modelos:

gpt-5.2para Thinking (Responses API),gpt-5.2-chat-latestpara flujos de chat/instantáneos ygpt-5.2-propara el nivel Pro; disponible mediante Responses API y Chat Completions donde se indique. - Tokens de razonamiento y gestión del esfuerzo: la API admite parámetros explícitos para asignar cómputo (esfuerzo de razonamiento) por solicitud; un mayor esfuerzo incrementa la latencia y el costo, pero mejora la calidad de salida en tareas complejas.

- Herramientas de salida estructurada: compatibilidad con gramáticas (Lark / CFG) para restringir la salida del modelo a un DSL o una sintaxis exacta (útil para SQL, JSON, generación de DSL).

- Llamadas paralelas a herramientas y coordinación agéntica: un paralelismo mejorado y una orquestación más limpia de herramientas reducen la necesidad de prompts de sistema elaborados y de arquitecturas multiagente.

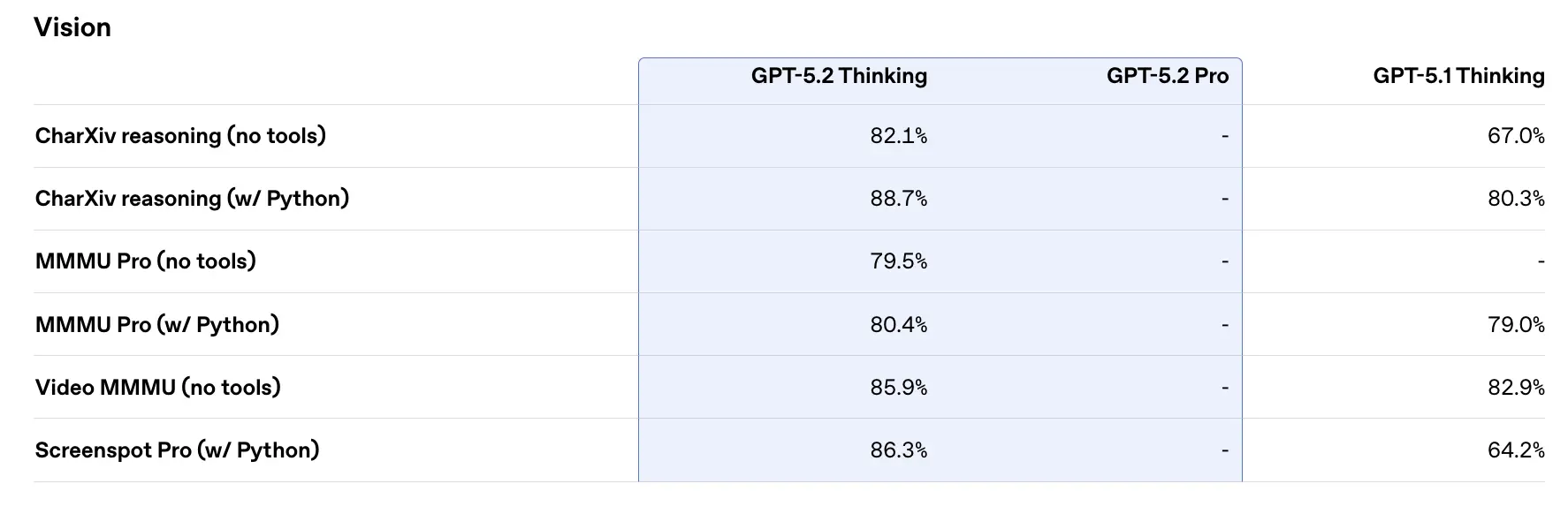

Rendimiento en benchmarks y datos de respaldo

OpenAI publicó una variedad de resultados de benchmarks internos y externos para GPT-5.2. Algunos puntos destacados (cifras reportadas por OpenAI):

- GDPval (44 ocupaciones, trabajo del conocimiento) — GPT-5.2 Thinking “supera o empata a los mejores profesionales de la industria en el 70.9% de las comparaciones”; OpenAI informa que las salidas se produjeron a >11× la velocidad y a <1% del costo de profesionales expertos en sus tareas GDPval (las estimaciones de velocidad y costo se basan en datos históricos). Estas tareas incluyen modelos de hojas de cálculo, presentaciones y videos cortos.

- SWE-Bench Pro (programación) — GPT-5.2 Thinking alcanza ≈55.6% en SWE-Bench Pro y ~80% en SWE-Bench Verified (solo Python), según OpenAI, estableciendo un nuevo estado del arte para la evaluación de generación de código / ingeniería en sus pruebas. Según los ejemplos de OpenAI, esto se traduce en una depuración más fiable y correcciones integrales en la práctica.

- GPQA Diamond (preguntas y respuestas científicas de nivel de posgrado) — GPT-5.2 Pro: 93.2%, GPT-5.2 Thinking: 92.4% en GPQA Diamond (sin herramientas, razonamiento máximo).

- Serie ARC-AGI — En ARC-AGI-2 (un benchmark más difícil de razonamiento fluido), GPT-5.2 Thinking obtuvo 52.9% y GPT-5.2 Pro 54.2% (OpenAI afirma que estas son nuevas marcas de estado del arte para modelos de estilo chain-of-thought).

- Contexto largo (OpenAI MRCRv2) — GPT-5.2 Thinking muestra una precisión cercana al 100% en la variante MRCR de 4 agujas hasta 256k tokens y puntuaciones sustancialmente mejores frente a GPT-5.1 en configuraciones de contexto largo. (OpenAI publicó gráficos y tablas de MRCRv2.)

Comparación con alternativas contemporáneas

- frente a Google Gemini 3 (Gemini 3 Pro / Deep Think): Gemini 3 Pro se ha publicitado con una ventana de contexto de ~1,048,576 (≈1M) tokens y amplias entradas multimodales (texto, imagen, audio, video, PDF), además de sólidas integraciones agénticas a través de Vertex AI / AI Studio. Sobre el papel, la mayor ventana de contexto de Gemini 3 es un diferenciador para cargas de trabajo extremadamente grandes en una sola sesión; las compensaciones incluyen la superficie de herramientas y el ajuste al ecosistema.

- frente a Anthropic Claude Opus 4.5: Opus 4.5 de Anthropic pone énfasis en flujos empresariales de programación/agentes y reporta sólidos resultados en SWE-bench y robustez en sesiones agénticas largas; Anthropic posiciona Opus para automatización y generación de código con una ventana de contexto de 200k e integraciones especializadas con agentes/Excel. Opus 4.5 es un competidor fuerte en automatización empresarial y tareas de código.

Conclusión práctica: GPT-5.2 apunta a un conjunto equilibrado de mejoras (contexto de 400k, salidas de alta cantidad de tokens, mejor razonamiento/programación). Gemini 3 apunta a los contextos más grandes absolutos en una sola sesión (≈1M), mientras que Claude Opus se centra en ingeniería empresarial y robustez agéntica. Elija según el tamaño de contexto, las necesidades de modalidad, el ajuste de funciones/herramientas y las compensaciones de costo/latencia.

Cómo acceder y usar la API de GPT-5.2

Paso 1: Regístrese para obtener una clave API

Inicie sesión en cometapi.com. Si aún no es usuario nuestro, regístrese primero. Inicie sesión en su consola de CometAPI. Obtenga la clave API de credenciales de acceso de la interfaz. Haga clic en “Add Token” en la sección de token API del centro personal, obtenga la clave del token: sk-xxxxx y envíela.

Paso 2: Envíe solicitudes a la API de GPT-5.2

Seleccione el endpoint “gpt-5.2” para enviar la solicitud de API y configure el cuerpo de la solicitud. El método de solicitud y el cuerpo de la solicitud se obtienen de la documentación de API de nuestro sitio web. Nuestro sitio web también proporciona pruebas con Apifox para su comodidad. Reemplace <YOUR_API_KEY> por su clave real de CometAPI de su cuenta. Los desarrolladores llaman a estos mediante los endpoints de Responses / Chat.

Inserte su pregunta o solicitud en el campo content; esto es a lo que responderá el modelo. Procese la respuesta de la API para obtener la respuesta generada.

Paso 3: Recupere y verifique los resultados

Procese la respuesta de la API para obtener la respuesta generada. Después del procesamiento, la API responde con el estado de la tarea y los datos de salida.

Vea también Gemini 3 Pro Preview API