¿Qué es la API de GPT-Image-1.5?

GPT-Image-1.5 es el miembro más reciente de la familia GPT Image de OpenAI y el modelo detrás de la renovada experiencia de Images en ChatGPT. Está diseñado para llevar la generación de imágenes de experimentos novedosos a herramientas creativas de calidad de producción: mayor fotorrealismo, control más fino para ediciones iterativas y una inferencia más rápida para admitir flujos de trabajo interactivos y empresariales.

La API gpt-image-1.5 es un endpoint de modelo de imagen multimodal que acepta una o varias entradas de imagen (identificadores de archivos o bytes) más un prompt de texto y devuelve imágenes generadas o editadas. Admite:

- Generación de texto a imagen (crear a partir de un prompt),

- Edición de imágenes/in-painting/composición (aplicar instrucciones a imágenes existentes; se permiten múltiples entradas de imagen), y

- Flujos de edición iterativos y multi-turno a través de la Responses API (habilita UIs de “ajustar e iterar”).

La API trata los prompts de imagen de forma diferente a los límites anteriores de DALL·E: los modelos de imagen de GPT aceptan prompts de texto significativamente más largos (la pauta de 32k caracteres), lo que hace viables instrucciones complejas y con muchas restricciones.

Funciones principales (prácticas)

- Mejor capacidad de edición/consistencia en múltiples turnos: preserva la apariencia del personaje, la iluminación y los atributos visuales clave a lo largo de ediciones iterativas. Esto hace que “mismo modelo, ediciones repetidas” sea más confiable para flujos como catálogos de productos o activos de marca.

- Mayor rendimiento — mejoras de velocidad de 4× respecto a GPT Image 1, orientadas a reducir la latencia en flujos creativos iterativos.

- Optimizaciones de costo — costos de entrada/salida de imagen reducidos en aproximadamente 20% frente a GPT Image 1, disminuyendo el costo por iteración de imagen para usuarios de alto volumen.

- Composición multiimagen y referencia de estilo — acepta múltiples imágenes de referencia para componer escenas o transferir estilo/iluminación.

- Controles de calidad/fidelidad — parámetros de la API que equilibran velocidad frente a fidelidad (usa menor calidad para generación masiva; mayor calidad para activos de producción).

- Edición multi-turno/integración con Responses API — habilita flujos por pasos (solicita cambios y luego “realiza ajustes” preservando el estado).

Capacidades técnicas

- Límite del prompt de texto (modelos de imagen): hasta 32,000 caracteres (nota: OpenAI documenta esto como la longitud de texto permitida para los modelos de imagen GPT). Úsalo para prompts largos y con muchas restricciones.

- Entradas de imagen: acepta IDs de archivo (preferidos para flujos multi-turno) o bytes sin procesar; se pueden proporcionar múltiples imágenes para composición y referencia.

- Salidas: PNG/JPEG o artefactos de imagen predeterminados de la plataforma devueltos por la API (o como archivos adjuntos dentro de ChatGPT). Las salidas pueden incluir múltiples imágenes candidatas y admitir solicitudes iterativas para refinar un resultado.

- Modos de generación: texto a imagen, edición de imágenes (inpaint/extender con instrucciones) y variantes. La edición multi-turno admite instrucciones del tipo “añadir/quitar/combinar”.

- Edición consciente de las instrucciones: los modelos están optimizados para la fidelidad a las instrucciones (preservando invariantes especificados como “no cambies el logotipo”, “mantén la pose y la iluminación”). Los patrones de ingeniería de prompts (invariantes explícitos repetidos en cada iteración) reducen la deriva semántica.

Rendimiento en benchmarks

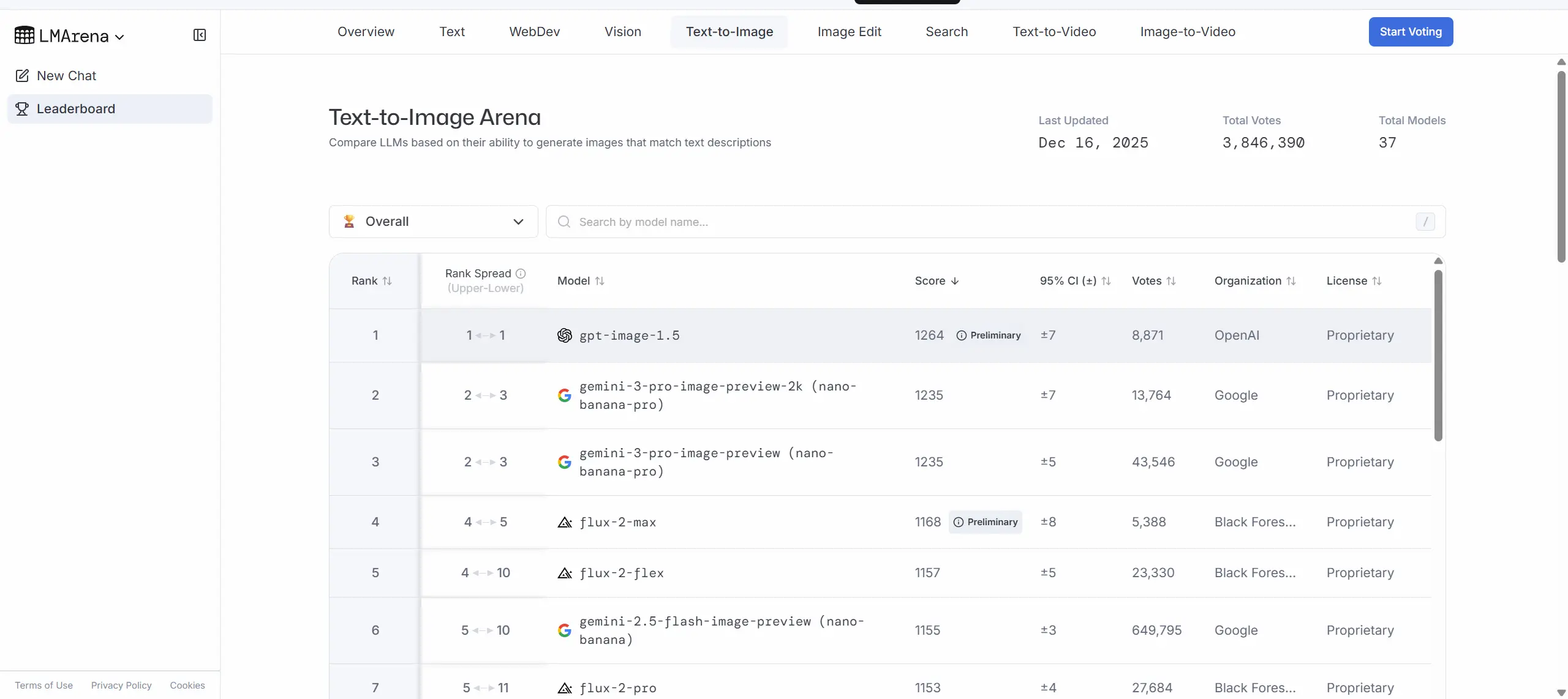

- Posición en rankings: Un informe agregado citó a GPT Image 1.5 encabezando las clasificaciones de texto a imagen con ~1264 puntos en un leaderboard de Artificial Analysis, por delante del siguiente modelo por un margen medible.

- Métricas a nivel de tarea (edición y preservación): un resumen de Microsoft Foundry sobre métricas de evaluación muestra a GPT-Image-1.5 alcanzando un éxito de modificación binaria casi perfecto (100% en un BinaryEval de un solo turno) y sólidas puntuaciones de preservación de rostro (alrededor de 90% en medidas de AuraFace) en su tabla comparativa frente a competidores y modelos anteriores de OpenAI. Esas métricas comparativas sitúan a GPT-Image-1.5 por delante de algunos rivales en preservación y fidelidad de edición.

Cómo se compara GPT-Image-1.5 con sus pares

- Vs. GPT Image 1 (generación anterior de OpenAI): más rápido (hasta 4×), más económico (~20% menos costo de E/S de imagen) y con mayor fidelidad de edición; orientado a pasar de “prototipo/demostración” a flujos de trabajo de imagen “aptos para producción”.

- Vs. Nano Banana Pro de Google / modelos de imagen Gemini: GPT-Image-1.5 y la familia Gemini 3/Nano Banana Pro de Google son rivales cercanos: cada uno tiene fortalezas en diferentes clases de prompts. La comunicación de OpenAI enfatiza la fidelidad de edición y la velocidad de iteración; la oferta de Google ha sido elogiada por realismo a nivel de estudio en algunos ejemplos.

- Vs. Qwen Image y otros modelos abiertos/cerrados: GPT-Image-1.5 supera a Qwen Image en varias métricas de edición y preservación en evaluaciones de un solo turno, pero las diferencias se reducen en pruebas de múltiples turnos u otras específicas de dominio.

En qué destaca GPT-Image-1.5

- Imágenes de productos de comercio electrónico: variantes masivas, cambios de fondo, catálogos de productos consistentes a partir de una sola foto (preservación de marca/logotipo).

- Producción de activos creativos y de marketing: iteraciones rápidas de conceptos, maquetas fotorrealistas, transferencias de estilo controladas.

- Retoque fotográfico y flujos editoriales: pruebas realistas de ropa/peinados, retoque selectivo que preserva la identidad y la iluminación.

- Integración con herramientas de diseño: conéctalo a plataformas de diseño o CMS para variantes de imagen bajo demanda (los controles de fidelidad ayudan al control de costes).

- Pipelines de composición en múltiples pasos: entradas multiimagen permiten componer y generar basándose en referencias para escenas complejas.

Cómo acceder a la API de GPT Image 1.5

Paso 1: Regístrate para obtener la clave de API

Inicia sesión en cometapi.com. Si aún no eres nuestro usuario, regístrate primero. Accede a tu consola de CometAPI. Obtén la clave de API de credenciales de acceso de la interfaz. Haz clic en “Add Token” en el token de API del centro personal, obtén la clave del token: sk-xxxxx y envíala.

Paso 2: Enviar solicitudes a la API de GPT Image 1.5

Selecciona el endpoint “gpt-image-1.5” para enviar la solicitud a la API y establece el cuerpo de la solicitud. El método y el cuerpo de la solicitud se obtienen de la documentación de la API en nuestro sitio web. Nuestro sitio también proporciona pruebas en Apifox para tu comodidad. Reemplaza <YOUR_API_KEY> por tu clave real de CometAPI de tu cuenta. La URL base es Imágenes (https://api.cometapi.com/v1/images/generations) y [Edición de imágenes]

Inserta tu pregunta o solicitud en el campo content—eso es a lo que responderá el modelo. Procesa la respuesta de la API para obtener la respuesta generada.

Paso 3: Recuperar y verificar los resultados

Procesa la respuesta de la API para obtener la respuesta generada. Después del procesamiento, la API responde con el estado de la tarea y los datos de salida.

Consulta también Gemini 3 Pro Preview API