El último avance de Alibaba en inteligencia artificial, Codificador Qwen3Marca un hito significativo en el cambiante panorama del desarrollo de software impulsado por IA. Presentado el 23 de julio de 2025, Qwen3-Coder es un modelo de codificación de código abierto y agente, diseñado para abordar de forma autónoma tareas de programación complejas, desde la generación de código repetitivo hasta la depuración de bases de código completas. Basado en una arquitectura de vanguardia de mezcla de expertos (MoE) y con 480 35 millones de parámetros, de los cuales 3 XNUMX millones se activan por token, el modelo logra un equilibrio óptimo entre rendimiento y eficiencia computacional. En este artículo, exploramos las características distintivas de QwenXNUMX-Coder, examinamos su rendimiento de referencia, desglosamos sus innovaciones técnicas, guiamos a los desarrolladores para su uso óptimo y consideramos la aceptación del modelo y sus perspectivas futuras.

¿Qué es Qwen3-Coder?

Qwen3‑Coder es el modelo de codificación agencial más reciente de la familia Qwen, anunciado oficialmente el 22 de julio de 2025. Diseñado como el modelo de código agencial más completo hasta la fecha, su variante insignia, Qwen3‑Coder‑480B‑A35B‑Instruct, incorpora un total de 480 35 millones de parámetros con un diseño de Mezcla de Expertos (MoE) que activa 256 XNUMX millones de parámetros por token. Admite de forma nativa ventanas de contexto de hasta XNUMX XNUMX tokens y escala hasta un millón de tokens mediante técnicas de extrapolación, lo que satisface la demanda de comprensión y generación de código a escala de repositorio.

Código abierto bajo Apache 2.0

En consonancia con el compromiso de Alibaba con el desarrollo impulsado por la comunidad, Qwen3-Coder se publica bajo la licencia Apache 2.0. Esta disponibilidad de código abierto garantiza la transparencia, fomenta las contribuciones de terceros y acelera su adopción tanto en el ámbito académico como en la industria. Investigadores e ingenieros pueden acceder a ponderaciones preentrenadas y ajustar el modelo para dominios especializados, desde tecnología financiera hasta computación científica.

Evolución desde Qwen2.5

Basándose en el éxito de Qwen2.5-Coder, que ofrecía modelos con parámetros que iban desde 0.5 millones hasta 32 millones y obtenía resultados SOTA en las pruebas de referencia de generación de código, Qwen3-Coder amplía las capacidades de su predecesor mediante una mayor escala, flujos de datos mejorados y nuevos regímenes de entrenamiento. Qwen2.5-Coder se entrenó con más de 5.5 billones de tokens mediante una limpieza de datos meticulosa y la generación de datos sintéticos. Qwen3-Coder mejora este proceso al ingerir 7.5 billones de tokens con una tasa de código del 70 %, aprovechando modelos anteriores para filtrar y reescribir entradas con ruido y lograr una calidad de datos superior.

¿Cuáles son las principales innovaciones que diferencian a Qwen3-Coder?

Varias innovaciones clave distinguen a Qwen3-Coder:

- Orquestación de tareas agenéticasEn lugar de simplemente generar fragmentos, Qwen3-Coder puede encadenar de forma autónoma múltiples operaciones (leer documentación, invocar utilidades y validar resultados) sin intervención humana.

- Presupuesto de pensamiento mejoradoLos desarrolladores pueden configurar cuánta computación se dedica a cada paso del razonamiento, lo que permite un equilibrio personalizable entre velocidad y minuciosidad, lo cual es crucial para la síntesis de código a gran escala.

- Integración perfecta de herramientas:La interfaz de línea de comandos de Qwen3-Coder, “Qwen Code”, adapta protocolos de llamada de funciones y avisos personalizados para integrarse con herramientas de desarrollo populares, lo que facilita la integración en IDE y pipelines de CI/CD existentes.

¿Cómo se desempeña Qwen3-Coder en comparación con sus competidores?

Enfrentamientos de referencia

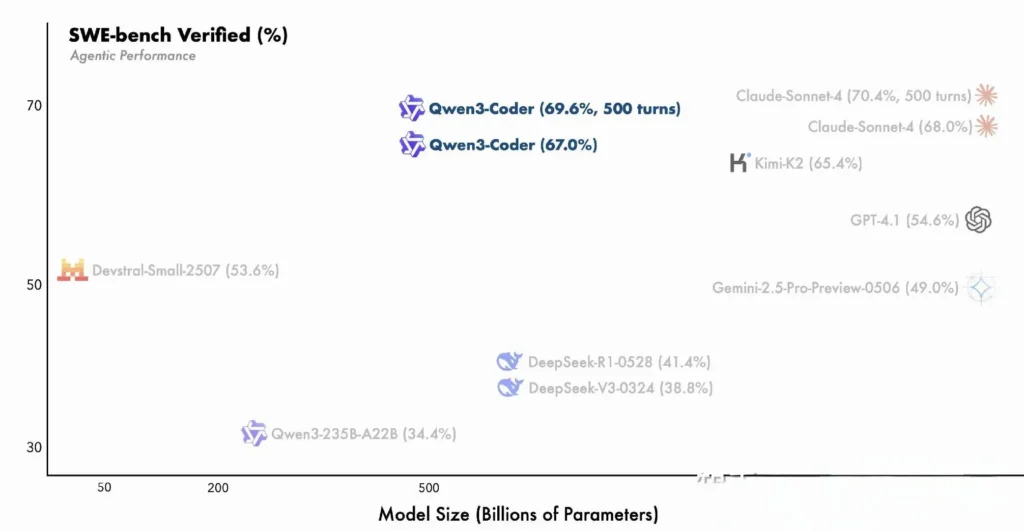

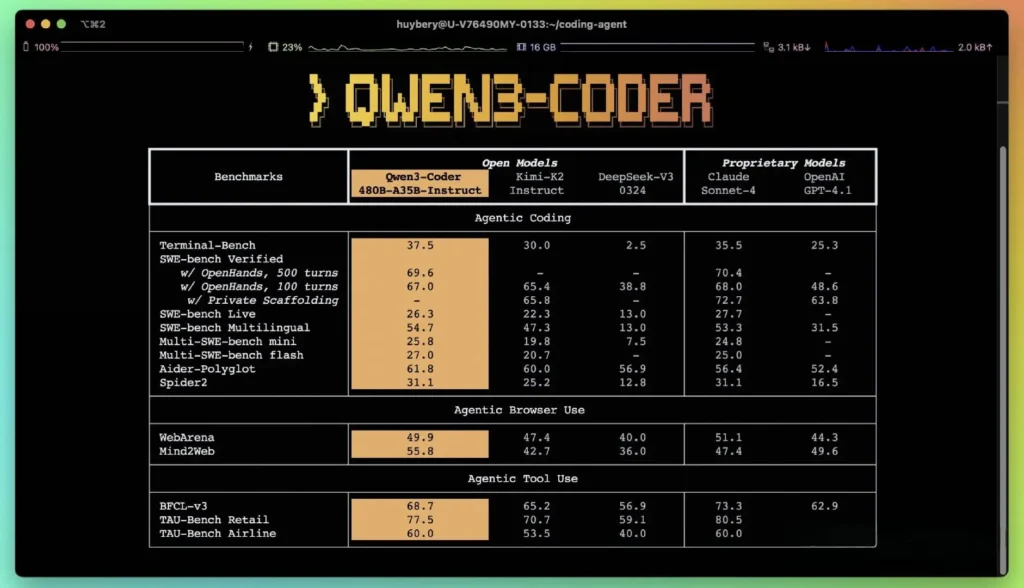

Según las métricas de rendimiento publicadas por Alibaba, Qwen3-Coder supera a las principales alternativas nacionales, como los modelos de estilo códice de DeepSeek y K2 de Moonshot AI, e iguala o supera las capacidades de codificación de las principales ofertas estadounidenses en varios puntos de referencia. En evaluaciones de terceros:

- Aider Políglota:Qwen3-Coder-480B logró una puntuación de 61.8%, lo que ilustra una sólida generación de código multilingüe y razonamiento.

- MBPP y HumanEvalPruebas independientes informan que Qwen3-Coder-480B-A35B supera a GPT-4.1 tanto en corrección funcional como en manejo de indicaciones complejas, particularmente en desafíos de codificación de múltiples pasos.

- La variante con parámetro 480B logró más del 85 % de éxito en la ejecución. Banco SWE Suite verificada: supera tanto al modelo superior de DeepSeek (78 %) como al K2 de Moonshot (82 %), y se acerca mucho a Claude Sonnet 4 con un 86 %.

Comparación con modelos propietarios

Alibaba afirma que las capacidades de agencia de Qwen3-Coder se alinean con las de Claude de Anthropic y GPT-4 de OpenAI en flujos de trabajo de codificación integrales, una hazaña notable para un modelo de código abierto. Los primeros evaluadores informan que su planificación multi-turno, la invocación dinámica de herramientas y la corrección automatizada de errores permiten gestionar tareas complejas, como la creación de aplicaciones web integrales o la integración de pipelines de CI/CD, con mínimas indicaciones humanas. Estas capacidades se ven reforzadas por la capacidad del modelo para autovalidarse mediante la ejecución de código, una característica menos pronunciada en los LLM puramente generativos.

¿Cuáles son las innovaciones técnicas detrás de Qwen3‑Coder?

Arquitectura de mezcla de expertos (MoE)

En el corazón de Qwen3-Coder se encuentra un diseño de MoE de vanguardia. A diferencia de los modelos densos que activan todos los parámetros para cada token, las arquitecturas MoE involucran selectivamente subredes especializadas (expertos) adaptadas a tipos de token o tareas específicas. En Qwen3-Coder, un total de 480 mil millones de parámetros se distribuyen entre múltiples expertos, con solo 35 mil millones de parámetros activos por token. Este enfoque reduce drásticamente los costos de inferencia en más del 60 % en comparación con modelos densos equivalentes, a la vez que mantiene una alta fidelidad en la síntesis y depuración de código.

Modo de pensamiento y modo de no pensamiento

Tomando prestadas las innovaciones de la familia más amplia Qwen3, Qwen3‑Coder integra un inferencia de modo dual marco de referencia:

- Modo de pensamiento asigna un “presupuesto de pensamiento” mayor para tareas de razonamiento complejas de varios pasos, como el diseño de algoritmos o la refactorización de archivos cruzados.

- Modo de no pensar Proporciona respuestas rápidas basadas en el contexto, adecuadas para completar códigos simples y fragmentos de uso de API.

Este cambio de modo unificado elimina la necesidad de hacer malabarismos con modelos separados para tareas optimizadas para chat y tareas optimizadas para razonamiento, lo que agiliza los flujos de trabajo de los desarrolladores.

Aprendizaje por refuerzo con síntesis automatizada de casos de prueba

Una innovación destacada es la ventana de contexto de tokens nativa de 3K de Qwen256-Coder (el doble de la capacidad típica de los principales modelos abiertos) y la compatibilidad con hasta un millón de tokens mediante métodos de extrapolación (p. ej., YaRN). Esto permite al modelo procesar repositorios completos, conjuntos de documentación o proyectos multiarchivo en una sola pasada, preservando las dependencias entre archivos y reduciendo las solicitudes repetitivas. Pruebas empíricas muestran que la expansión de la ventana de contexto produce mejoras, aunque decrecientes, en el rendimiento de tareas a largo plazo, especialmente en escenarios de aprendizaje de refuerzo basados en el entorno.

¿Cómo pueden los desarrolladores acceder y utilizar Qwen3-Coder?

La estrategia de lanzamiento de Qwen3-Coder enfatiza la apertura y la facilidad de adopción:

- Pesos de modelos de código abierto:Todos los puntos de control del modelo están disponibles en GitHub bajo Apache 2.0, lo que permite una transparencia total y mejoras impulsadas por la comunidad.

- **Interfaz de línea de comandos (código Qwen)**La CLI, bifurcada a partir de Google Gemini Code, admite indicaciones personalizadas, llamadas de funciones y arquitecturas de complementos para integrarse perfectamente con los sistemas de compilación e IDE existentes.

- Implementaciones en la nube y localesLas imágenes Docker preconfiguradas y los gráficos Helm de Kubernetes facilitan implementaciones escalables en entornos de nube, mientras que las recetas de cuantificación local (cuantificación dinámica de 2 a 8 bits) permiten una inferencia local eficiente, incluso en GPU básicas.

- Acceso a la API a través de CometAPI:Los desarrolladores también pueden interactuar con Qwen3-Coder a través de puntos finales alojados en plataformas como CometAPI, que ofrecen código abierto(

qwen3-coder-480b-a35b-instruct) y versiones comerciales(qwen3-coder-plus; qwen3-coder-plus-2025-07-22)al mismo precio.La versión comercial tiene una longitud de 1M. - Abrazando la caraAlibaba ha puesto los pesos de Qwen3-Coder y las bibliotecas que los acompañan a disposición de forma gratuita tanto en Hugging Face como en GitHub, empaquetados bajo una licencia Apache 2.0 que permite el uso académico y comercial sin regalías.

Integración de API y SDK a través de CometAPI

CometAPI es una plataforma API unificada que integra más de 500 modelos de IA de proveedores líderes, como la serie GPT de OpenAI, Gemini de Google, Claude de Anthropic, Midjourney, Suno y más, en una única interfaz intuitiva para desarrolladores. Al ofrecer autenticación, formato de solicitudes y gestión de respuestas consistentes, CometAPI simplifica drásticamente la integración de las capacidades de IA en sus aplicaciones. Ya sea que esté desarrollando chatbots, generadores de imágenes, compositores musicales o canales de análisis basados en datos, CometAPI le permite iterar más rápido, controlar costos y mantenerse independiente del proveedor, todo mientras aprovecha los últimos avances del ecosistema de IA.

Los desarrolladores pueden interactuar con Codificador Qwen3 a través de una API compatible con el estilo OpenAI, disponible a través de CometAPI. CometAPI, que ofrecen código abierto(qwen3-coder-480b-a35b-instruct) y versiones comerciales(qwen3-coder-plus; qwen3-coder-plus-2025-07-22) al mismo precio. La versión comercial tiene una longitud de 1 MB. Código de ejemplo para Python (usando el cliente compatible con OpenAI) con prácticas recomendadas que recomiendan ajustes de muestreo de temperatura = 0.7, top_p = 0.8, top_k = 20 y una penalización de repetición de 1.05. La longitud de salida puede alcanzar hasta 65,536 XNUMX tokens, lo que la hace ideal para tareas de generación de código de gran tamaño.

Para comenzar, explore las capacidades de los modelos en el Playground y consultar el Guía de API Para obtener instrucciones detalladas, consulte la sección "Antes de acceder, asegúrese de haber iniciado sesión en CometAPI y de haber obtenido la clave API".

Guía de inicio rápido sobre Hugging Face y Alibaba Cloud

Los desarrolladores ansiosos por experimentar con Qwen3-Coder pueden encontrar el modelo en Hugging Face en el repositorio. Qwen/Qwen3‑Coder‑480B‑A35B‑InstructLa integración se agiliza mediante el transformers biblioteca (versión ≥ 4.51.0 para evitar KeyError: 'qwen3_moe') y clientes Python compatibles con OpenAI. Un ejemplo mínimo:

from transformers import AutoModelForCausalLM, AutoTokenizer

model = AutoModelForCausalLM.from_pretrained("Qwen/Qwen3-480B-A35B-Instruct")

tokenizer = AutoTokenizer.from_pretrained("Qwen/Qwen3-480B-A35B-Instruct")

input_ids = tokenizer("def fibonacci(n):", return_tensors="pt").input_ids

output = model.generate(input_ids, max_length=200, temperature=0.7, top_p=0.8, top_k=20, repetition_penalty=1.05)

print(tokenizer.decode(output))

Definición de herramientas personalizadas y flujos de trabajo de agentes

Una de las características destacadas de Qwen3‑Coder es invocación de herramienta dinámicaLos desarrolladores pueden registrar utilidades externas (linters, formateadores, ejecutores de pruebas) y permitir que el modelo las invoque de forma autónoma durante una sesión de codificación. Esta capacidad transforma a Qwen3-Coder de un asistente de código pasivo a un agente de codificación activo, capaz de ejecutar pruebas, ajustar el estilo del código e incluso implementar microservicios basados en intenciones conversacionales.

¿Qué aplicaciones potenciales y direcciones futuras permite Qwen3-Coder?

Al combinar la libertad del código abierto con un rendimiento de nivel empresarial, Qwen3-Coder sienta las bases para una nueva generación de herramientas de desarrollo basadas en IA. Desde auditorías de código automatizadas y comprobaciones de cumplimiento de seguridad hasta servicios de refactorización continua y asistentes de desarrollo y operaciones basados en IA, la versatilidad del modelo ya inspira tanto a startups como a equipos de innovación internos.

Flujos de trabajo de desarrollo de software

Los primeros usuarios reportan una reducción del 30 al 50 % en el tiempo dedicado a la codificación repetitiva, la gestión de dependencias y el andamiaje inicial, lo que permite a los ingenieros centrarse en tareas de diseño y arquitectura de alto valor. Las suites de integración continua pueden aprovechar Qwen3-Coder para generar automáticamente pruebas, detectar regresiones e incluso sugerir optimizaciones de rendimiento basadas en el análisis de código en tiempo real.

Las empresas juegan

A medida que empresas de los sectores financiero, sanitario y de comercio electrónico integran Qwen3-Coder en sistemas esenciales, la retroalimentación entre los equipos de usuarios y el departamento de I+D de Alibaba acelerará las mejoras, como la optimización específica para cada dominio, protocolos de seguridad mejorados y plugins IDE más robustos. Además, la estrategia de código abierto de Alibaba fomenta las contribuciones de la comunidad global, impulsando un ecosistema dinámico de extensiones, benchmarks y bibliotecas de mejores prácticas.

Conclusión

En resumen, Qwen3-Coder representa un hito en la IA de código abierto para la ingeniería de software: un modelo potente y agente que no solo escribe código, sino que orquesta procesos de desarrollo completos con mínima supervisión humana. Al ofrecer la tecnología de forma gratuita y fácil de integrar, Alibaba democratiza el acceso a herramientas avanzadas de IA y sienta las bases para una era en la que la creación de software se vuelve cada vez más colaborativa, eficiente e inteligente.

Preguntas Frecuentes

¿Qué hace que Qwen3-Coder sea “agencial”?

La IA agéntica se refiere a modelos que pueden planificar y ejecutar tareas de varios pasos de forma autónoma. La capacidad de Qwen3-Coder para invocar herramientas externas, ejecutar pruebas y gestionar bases de código sin intervención humana ejemplifica este paradigma.

¿Qwen3-Coder es adecuado para uso en producción?

Si bien Qwen3-Coder muestra un sólido desempeño en puntos de referencia y pruebas del mundo real, las empresas deben realizar evaluaciones específicas del dominio e implementar medidas de protección (por ejemplo, canales de verificación de salida) antes de integrarlo en flujos de trabajo de producción críticos.

¿Cómo beneficia la arquitectura de mezcla de expertos a los desarrolladores?

MoE reduce los costos de inferencia al activar solo las subredes relevantes por token, lo que permite una generación más rápida y menores gastos de computación. Esta eficiencia es crucial para escalar los asistentes de codificación de IA en entornos de nube.