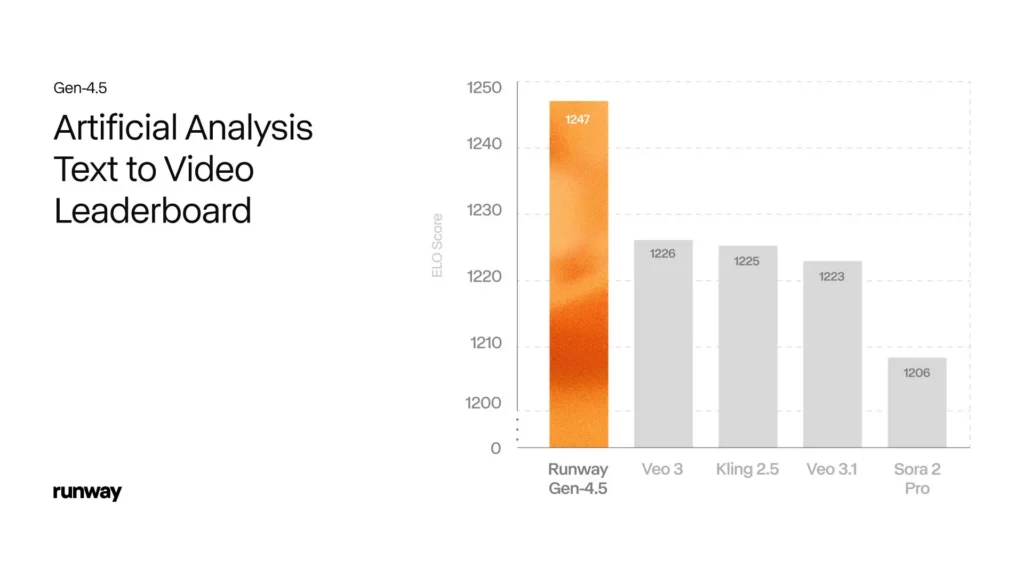

Runway Gen-4.5 es el último modelo insignia de texto a vídeo de la compañía, anunciado el 1 de diciembre de 2025. Se posiciona como una evolución gradual pero significativa de la familia Gen-4, con mejoras enfocadas en la calidad del movimiento, la adherencia inmediata y el realismo temporal/físico, precisamente las áreas que históricamente diferenciaban el vídeo de IA "bueno" del vídeo de IA "creíble". Runway Gen-4.5 lidera la clasificación actual de texto a vídeo de Análisis Artificial (1,247 puntos Elo) y está optimizado para resultados cinematográficos y controlables, aunque aún presenta las limitaciones típicas de la IA generativa, como artefactos de pequeños detalles y errores causales ocasionales.

A continuación, se presenta una mirada profunda, práctica y (cuando sea posible) respaldada por evidencia sobre qué es Gen-4.5, qué hay de nuevo en comparación con Gen-4, cómo se compara con competidores como Veo (3.1) de Google y Sora 2 de OpenAI, señales de rendimiento del mundo real y afirmaciones de referencia, y una discusión franca de limitaciones, riesgos y mejores prácticas.

¿Qué es Runway Gen-4.5?

Runway Gen-4.5 es el modelo más reciente de generación de texto a video de Runway, lanzado como una actualización iterativa pero sustancial de la línea Gen-4 de la compañía. Runway posiciona Gen-4.5 como una "nueva frontera" para la generación de video, destacando tres mejoras principales con respecto a versiones anteriores: precisión física notablemente mejorada (objetos con peso y movimiento realistas), mayor adherencia a las indicaciones (lo que pides es lo que obtienes con mayor fiabilidad) y mayor fidelidad visual en movimiento y tiempo (detalles como el cabello, el tejido y la especularidad de la superficie se mantienen coherentes en todos los fotogramas). Gen-4.5 actualmente lidera las clasificaciones independientes evaluadas por humanos para la evaluación comparativa de texto a video.

¿De dónde surgió Runway Gen-4.5 y por qué es importante?

Los modelos de video de Runway han evolucionado rápidamente desde la Gen-1, pasando por la Gen-3/Alpha hasta la Gen-4. La Gen-4.5 se presenta como una consolidación y optimización de mejoras arquitectónicas, estrategias de datos de preentrenamiento y técnicas de postentrenamiento diseñadas para maximizar la dinámica, la consistencia temporal y la controlabilidad. Para creadores y equipos de producción, estas mejoras buscan que los clips generados por IA sean funcionalmente útiles en la previsualización, el contenido publicitario/de marketing y la producción narrativa de formato corto, reduciendo la sensación de "borrador" que solían presentar los modelos anteriores de texto a video.

4 características principales de Runway Gen-4.5

1) Realismo físico mejorado y dinámica de movimiento.

Runway Gen-4.5 enfatiza un movimiento más fluido y físicamente plausible. Gen-4.5 se centra en el movimiento realista de objetos (peso, inercia, líquidos, tela y colisiones físicamente plausibles), lo que produce secuencias donde las interacciones parecen menos flotantes y más realistas. En las demostraciones y en mi prueba, el modelo muestra trayectorias de objetos mejoradas, mayor realismo en el movimiento de la cámara y menos artefactos flotantes que afectaban a los modelos de video anteriores. Esta es una de las mejoras más destacadas en comparación con Gen-4.

2) Controles de fidelidad visual y estilo

Runway Gen-4.5 amplía los modos de control de Runway (texto a vídeo, imagen a vídeo, vídeo a vídeo, fotogramas clave) y mejora la renderización fotorrealista, la estilización y la composición cinematográfica. Runway afirma que Gen-4.5 puede generar clips fotorrealistas difíciles de distinguir del metraje real en secuencias cortas, especialmente al combinarlos con una buena imagen de referencia o fotogramas clave.

3) Mejor adherencia inmediata y conciencia compositiva.

El modelo demuestra una fidelidad mejorada cuando las indicaciones incluyen múltiples actores, direcciones de cámara o restricciones de continuidad entre escenas; se adhiere a las instrucciones de manera más confiable en comparación con generaciones anteriores. Mayor precisión al seguir indicaciones descriptivas, lo que genera menos elementos alucinantes o irrelevantes en un clip.

4) Mayor detalle visual y estabilidad temporal.

La textura de la superficie, la continuidad del cabello y los filamentos, y la iluminación uniforme en todos los fotogramas han mejorado notablemente. Es menos probable que los personajes y los objetos cambien de apariencia a mitad de un clip. Runway afirma que estas mejoras se lograron conservando el perfil de latencia de Gen-4. Uno de los avances más orientados a la producción es la mejora en el manejo de las expresiones faciales de los personajes y las emociones implícitas en las tomas. Si bien Runway Gen-4.5 no sustituye a los actores profesionales, preserva mejor la continuidad emocional (la expresión de un personaje persiste durante un movimiento de cámara, por ejemplo) y puede generar pistas de interpretación plausibles a partir de directivas compactas como "sonrisa ansiosa, apartar la mirada, respirar con fuerza".

¿Cómo se desempeña Runway Gen-4.5 en pruebas reales y de referencia?

Runway informa una puntuación Elo de 1,247 En la clasificación de texto a video de Análisis Artificial (al momento del anuncio), Gen-4.5 se posicionó en la cima de ese punto de referencia específico al momento del informe. Puntos de referencia como estos utilizan juicios de preferencia humanos o automatizados por pares en múltiples resultados del modelo.

Rendimiento práctico (qué pueden esperar los usuarios)

- Duración y resolución de los clips: La generación 4.5 está optimizada para clips cinematográficos cortos (salidas de una sola toma, generalmente de 4 a 20 s en HD/1080p). Runway priorizó una mayor fidelidad sin añadir latencia en comparación con la generación 4.

- Tiempos y costos de renderizado: El mensaje de Runway es que los costos y la latencia son comparables a los de Gen-4 en todos los niveles de suscripción; los tiempos reales variarán según la resolución elegida, la configuración de calidad y la carga de la cola.

¿En qué se diferencia Runway Gen-4.5 de Gen-4?

Gen-4 estableció las intenciones de producción de Runway: personajes consistentes, modos de control de imagen a video (imagen→video, fotogramas clave, video→video) y un énfasis en los flujos de trabajo del usuario. Gen-4.5 mantiene esa base, pero impulsa... modelado mundial (física, movimiento) y adherencia inmediata Más sin sacrificar el rendimiento. En la práctica, la Gen-4 puede seguir siendo excelente para tareas rápidas y con estilo, y presupuestos más ajustados; la Gen-4.5 es la mejor opción cuando se necesita una dinámica más creíble y un control más preciso.

¿Qué cambió técnicamente (alto nivel)?

Runway Gen-4.5 se presenta como una evolución más que como una reescritura arquitectónica completa. Los materiales de Runway indican que el modelo se beneficia de una mayor eficiencia de los datos previos al entrenamiento y de técnicas posteriores al mismo (p. ej., ajuste preciso específico y regularización temporal). En la práctica, esto se traduce en un mejor modelado de peso y movimiento, escenas multielemento más coherentes y una mejor retención de detalles de alta frecuencia (pelo, tejido de tela) en todos los fotogramas.

Diferencias prácticas que notarán los creadores

- Mejor comportamiento físico: Los objetos obedecen a la masa percibida y los líquidos/fluidos se comportan de manera más plausible.

- Menos rupturas de identidad: Es menos probable que los personajes y los objetos cambien de apariencia a mitad del clip.

- Misma velocidad, mayor calidad: El rendimiento (latencia) de los estados de la pista es comparable al de Gen-4, con una mejora en la calidad. Esto hace que Gen-4.5 sea atractivo para los equipos de producción que no pueden soportar grandes retrasos en el renderizado.

Cuándo elegir Gen-4 vs Gen-4.5

- Use Gen-4 cuando necesita una prueba de concepto más barata y rápida o cuando las tuberías/controles existentes ya están ajustados a ese motor.

- Use Gen-4.5 cuando necesita un realismo mejorado, interacciones complejas de múltiples objetos o resultados de calidad de producción donde la física del movimiento y la precisión rápida son importantes (por ejemplo, visualizaciones de productos, previsualización de efectos visuales, cortometrajes basados en personajes).

Compatibilidad con controles Gen-4. Todos los modos de edición que Runway admite (imagen→video, fotogramas clave, video→video, referencias de actores) se están incorporando a Gen-4.5 para que los creadores puedan reutilizar controles familiares con mejores resultados.

¿Cómo se compara Gen-4.5 con Veo 3.1 y Sora 2?

¿Cómo se compara con Veo 3.1 de Google?

Veo 3.1 es la familia de conversión de texto a vídeo de alta fidelidad de Google (actualizaciones de Veo 3 → 3.1). El modelo es elogiado por su textura cinematográfica, su potente renderizado de estilo y su preciso control del color y la iluminación. Comparaciones independientes indican que Veo 3.1 destaca en escenas ambientadas y estilizadas, y está ampliamente disponible a través de las API de Google. Sin embargo, puede presentar dificultades en la física multiobjeto y la coherencia temporal a largo plazo, en comparación con los mejores competidores especializados. Las primeras pruebas a ciegas y los comentarios de los usuarios sugieren que Runway Gen-4.5 destaca en verosimilitud del movimiento y adherencia a las indicaciones para indicaciones con mucha física, mientras que Veo suele superar en pruebas de escenas individuales estilizadas, pictóricas o cinematográficas.

Hacia dónde tiende Veo a liderar: fidelidad de audio y funciones narrativas estructuradas (Flow/Veo Studio), e integración estrecha en el ecosistema de Google (Gemini API/Vertex AI).

Hacia dónde tiende a conducir Gen-4.5Pruebas de preferencia humana a ciegas para realismo visual, adherencia inmediata y comportamiento de movimiento complejo (según las clasificaciones de Video Arena citadas por Runway). En varias comparaciones públicas a ciegas, Gen-4.5 tiene una ligera ventaja en puntuación Elo sobre las variantes de Veo, aunque el margen y el significado varían según el tipo de contenido.

¿Cómo se compara con Sora 2 de OpenAI?

Sora 2 (OpenAI) Se enfatiza la precisión física, la sincronización del audio (incluyendo diálogos y efectos de sonido) y la controlabilidad. Sora 2 suele destacar en la creación de escenas animadas coherentes con claves narrativas de alto nivel y en flujos de trabajo donde el audio y el diálogo son partes importantes del proceso de generación.

Hacia dónde tiende a conducir Sora 2:generación de audio integrada y sincronización multimodal en ciertas configuraciones; tiende a producir clips muy atmosféricos y orientados a la narrativa.

Hacia dónde tiende a conducir Gen-4.5Según las comparaciones independientes a ciegas citadas por Runway, el realismo visual percibido, la fidelidad de la señal y la consistencia del movimiento. De nuevo, la elección práctica depende de tus valores: si la generación de audio nativo y las herramientas integradas son cruciales, Sora 2 o Veo podrían ser preferibles; si la fidelidad visual pura para escenas complejas es la prioridad, la ventaja de la prueba a ciegas de Gen-4.5 es significativa.

Tabla comparativa práctica (resumen)

| Área | Pista Gen-4.5 | Pista Gen-4 (anterior) | Google Veo 3.1 | OpenAI Sora 2 |

|---|---|---|---|---|

| Liberación / Posicionamiento | Diciembre de 2025 — “Gen-4.5”: mejora en calidad y fidelidad; máxima puntuación de referencia (1,247 Elo) | Gen-4 anterior: un gran paso hacia la consistencia y la capacidad de control | Veo 3.1: el generador de vídeo de Google; audio nativo y opciones de calidad rápida | Sora 2: el modelo insignia de video y audio de OpenAI; enfatiza la precisión física y el audio sincronizado |

| Puntos fuertes | Calidad de movimiento, fidelidad instantánea, imágenes cinematográficas, integración de API | Continuidad de personajes, consistencia en múltiples tomas, controlabilidad. | Salidas rápidas de 8 segundos, generación nativa de audio/diálogos, optimizada para velocidad/UX | Física y realismo, sonido/diálogos sincronizados, controlabilidad. |

| Longitud de salida / formatos | Clips cinematográficos cortos; admite imagen→video, texto→video, fotogramas clave, etc. | Clips cortos; modos de control similares | Vídeos de alta calidad de 8 segundos, opción Veo 3.1 Fast | Salidas 720p/1080p con audio, énfasis en la fidelidad |

| Audio nativo | No es el título principal (el enfoque es la fidelidad visual), pero Runway admite flujos de trabajo de audio a través de herramientas | Generación de audio nativo limitada | Generación de audio nativo (efectos de sonido, diálogos). Enfoque en la calidad del audio. | Los efectos de sonido y audio sincronizados son características explícitas. |

| Limitaciones típicas | Artefactos de pequeños detalles (caras/multitudes), errores causales/de tiempo ocasionales | Artefactos anteriores, más inconsistencia que 4.5 en movimientos | La corta duración es una cuestión de diseño: calidad vs. longitud | Modos de fallo estrechos en escenas complejas; aún en evolución |

- Realismo visual y movimiento: Gen-4.5 > Veo 3.1 ≈ Sora 2 (varía según la escena).

- Audio y sonido nativo:Veo 3.1 ≥ Sora 2 > Runway (Runway tiene herramientas de audio de flujo de trabajo, pero Veo y Sora incorporan una generación de audio nativo más profunda en la productización).

- Controles y ediciónTanto Runway (fotogramas clave, imagen→video, continuidad de referencia) como Veo (Flow Studio) ofrecen un fuerte control; Sora se centra en controles multimodales sincronizados.

- En resumen: Sora 2 es fuerte en continuidad narrativa; Veo 3.1 es fuerte en textura cinematográfica; Gen-4.5 es fuerte en realismo de movimiento y controlabilidad.

¿Qué limitaciones y riesgos concretos persisten con Gen-4.5?

Ningún modelo es perfecto, y Gen-4.5 tiene limitaciones conocidas y riesgos reales que se deben tener en cuenta antes de su adopción.

Limitaciones técnicas

- Física de casos extremos y errores causales: Aunque ha mejorado mucho, el modelo aún produce ocasionalmente errores de secuenciación causal (por ejemplo, un efecto que precede a su causa) y sutiles fallos de permanencia de los objetos cuando las escenas se vuelven muy complejas. Estos son menos frecuentes, pero aún presentes.

- Coherencia de formato largo: Como la mayoría de los modelos actuales de texto a vídeo, Gen-4.5 está optimizado para clips cortos (de segundos de duración). La generación de escenas extensas o secuencias completas aún requiere unión, intervención editorial o flujos de trabajo híbridos.

- Identidad y consistencia a escala: Producir cientos de tomas con exactamente el mismo personaje actuando de manera constante sigue siendo una actividad que requiere mucho flujo de trabajo; Gen-4.5 ayuda, pero no elimina los sistemas de diseño de referencia ni las canalizaciones de activos centralizadas.

Seguridad, mal uso y riesgos éticos

- Riesgo de deepfake/suplantación de identidad: Cualquier generador de video de alta fidelidad aumenta el riesgo de contenido multimedia realista pero engañoso. Las organizaciones deben implementar medidas de seguridad (marcas de agua, políticas de contenido, flujos de verificación de identidad) y monitorear el riesgo de uso indebido.

- Derechos de autor y procedencia del conjunto de datos: La procedencia de los datos de entrenamiento sigue siendo una preocupación más amplia en la industria. Los creadores y titulares de derechos deben ser conscientes de que los resultados pueden reflejar patrones aprendidos de material protegido por derechos de autor, lo que plantea cuestiones legales y éticas sobre la reutilización en contextos comerciales.

- Sesgo y daños representativos: Los modelos generativos pueden reproducir sesgos presentes en los datos de entrenamiento (p. ej., sobrerrepresentación/subrepresentación, representaciones estereotipadas). Siguen siendo necesarias pruebas rigurosas y estrategias de mitigación en el proceso de desarrollo.

Conclusión: ¿Dónde encaja Gen-4.5 en el cambiante panorama del vídeo con IA?

Runway Gen-4.5 representa un avance significativo en el realismo y la controlabilidad de la conversión de texto a video. Actualmente, ocupa un lugar destacado en las clasificaciones de preferencias ciegas independientes, y la comunicación del producto y los informes preliminares de Runway lo posicionan como una actualización práctica para los creadores que necesitan un movimiento más convincente, mayor fidelidad de las indicaciones y una mayor coherencia temporal sin sacrificar la velocidad de generación. Al mismo tiempo, los sistemas de la competencia, como Google (Veo 3.1) y OpenAI (Sora 2), siguen impulsando fortalezas complementarias como el audio integrado, las herramientas de narrativa/historia productizadas y una mayor integración con el ecosistema. La elección de la plataforma adecuada aún depende del proyecto: si se prioriza el realismo visual, el audio nativo, la integración de la plataforma o los controles de gobernanza.

Gen-4.5 se está implementando en planes con precios comparables a Gen-4.

Los desarrolladores pueden acceder Veo 3.1 , sora 2 y Pista/gen4_aleph etc. a través de CometAPI, la última versión del modelo Se actualiza constantemente con el sitio web oficial. Para empezar, explora las capacidades del modelo en el Playground y consultar el Guía de API Para obtener instrucciones detalladas, consulte la sección "Antes de acceder, asegúrese de haber iniciado sesión en CometAPI y de haber obtenido la clave API". CometAPI Ofrecemos un precio muy inferior al oficial para ayudarte a integrarte.

¿Listo para ir?→ Prueba gratuita de gen-4.5 !

Si quieres conocer más consejos, guías y novedades sobre IA síguenos en VK, X y Discord!