Seedance 2.0 es el modelo de generación de video con IA de próxima generación de ByteDance, lanzado oficialmente en marzo de 2026. Admite entradas de texto, imagen, audio y video, puede usar hasta 9 imágenes, 3 clips de video y 3 clips de audio como referencias, y está diseñado para ofrecer control a nivel de director, estabilidad de movimiento y generación conjunta de audio y video. En las clasificaciones de voto ciego actuales de Artificial Analysis, Seedance 2.0 lidera tanto las categorías de texto a video como de imagen a video sin audio, con puntuaciones Elo de 1269 y 1351, respectivamente.

¿Qué es Seedance 2.0?

Seedance 2.0 es el modelo de creación de video de nueva generación de ByteDance Seed. Oficialmente, está construido sobre una arquitectura unificada multimodal de generación conjunta de audio y video que acepta entradas de texto, imagen, audio y video, y está posicionado como una herramienta para creadores con capacidades de referencia y edición inusualmente amplias. Seedance 2.0 fue diseñado para flujos de trabajo de contenido de nivel industrial, con mayor precisión física, realismo, controlabilidad y estabilidad en escenas de movimiento complejo que la versión 1.5 previa. A diferencia de modelos anteriores que se centraban principalmente en texto a video, Seedance 2.0 introduce una tubería de generación multimodal totalmente unificada, que permite:

- Generación de texto a video

- Animación de imagen a video

- Edición de video a video

- Salida sincronizada con audio

Esto la convierte en una de las plataformas de creación de video con IA más completas disponibles en 2026.

¿Por qué importa?

La mayoría de los generadores de video siguen optimizados para un flujo relativamente estrecho: prompt de entrada, clip de salida. Seedance 2.0 va más allá al tratar la generación de video más como el espacio de trabajo de un director. Según ByteDance, puede usar múltiples tipos de referencia a la vez, preservar la consistencia del sujeto, seguir instrucciones detalladas con mayor fidelidad e incluso planificar el lenguaje de cámara de forma más “directorial”. Esa combinación importa porque los problemas más difíciles en la generación de video no son solo estéticos, sino continuidad, coherencia del movimiento y control sobre lo que ocurre a lo largo del tiempo.

¿Qué hay de nuevo y cuáles son las funciones clave en Seedance 2.0?

Generación multimodal unificada

La característica más importante es la capacidad del modelo para razonar conjuntamente sobre varias modalidades. Seedance 2.0 admite hasta 9 imágenes, 3 videos y 3 clips de audio como referencias, junto con instrucciones en lenguaje natural, y puede generar videos de hasta 15 segundos. En términos prácticos, eso significa que puedes guiar no solo el sujeto y la escena, sino también el estilo de movimiento, el movimiento de cámara, los efectos especiales y las señales de audio en una sola pasada de generación.

Control a nivel de director

Seedance 2.0 también se construye en torno a lo que ByteDance describe como control a nivel de director. Los creadores pueden dar forma a la interpretación, la iluminación, las sombras y el movimiento de cámara usando imágenes, audio y video de referencia. El modelo puede preservar una identidad de sujeto estable, reproducir guiones complejos con precisión y elegir un lenguaje de cámara que refleje una especie de “lógica de edición” incorporada. Para los creadores, eso supone un gran paso más allá del texto a video básico.

Edición y extensión, no solo generación

Otra mejora notable es que Seedance 2.0 no se detiene en la generación. Seedance 2.0 incorpora capacidades de edición y extensión de video, permitiendo cambios dirigidos en escenas, personajes, acciones o puntos de la trama específicos, y habilitando tomas de seguimiento continuas. El artículo para desarrolladores también explica que el modelo se puede usar para “continuar rodando” extendiendo un clip en lugar de empezar de nuevo. Eso importa para la eficiencia del flujo de trabajo, porque reduce la necesidad de regenerar una escena completa solo para corregir un segmento.

Mejor manejo del movimiento complejo

Seedance 2.0 es significativamente más fuerte en escenas con múltiples sujetos, interacciones y movimiento complicado. La calidad de generación ha mejorado sustancialmente respecto a la versión 1.5, con mejor precisión física, realismo y controlabilidad. La tasa de uso de Seedance 2.0 en escenas de movimiento difícil alcanza un nivel SOTA en la evaluación interna, al tiempo que reconoce que todavía se necesita mejorar en la estabilidad del detalle fino, el realismo y la vivacidad.

Benchmark de rendimiento

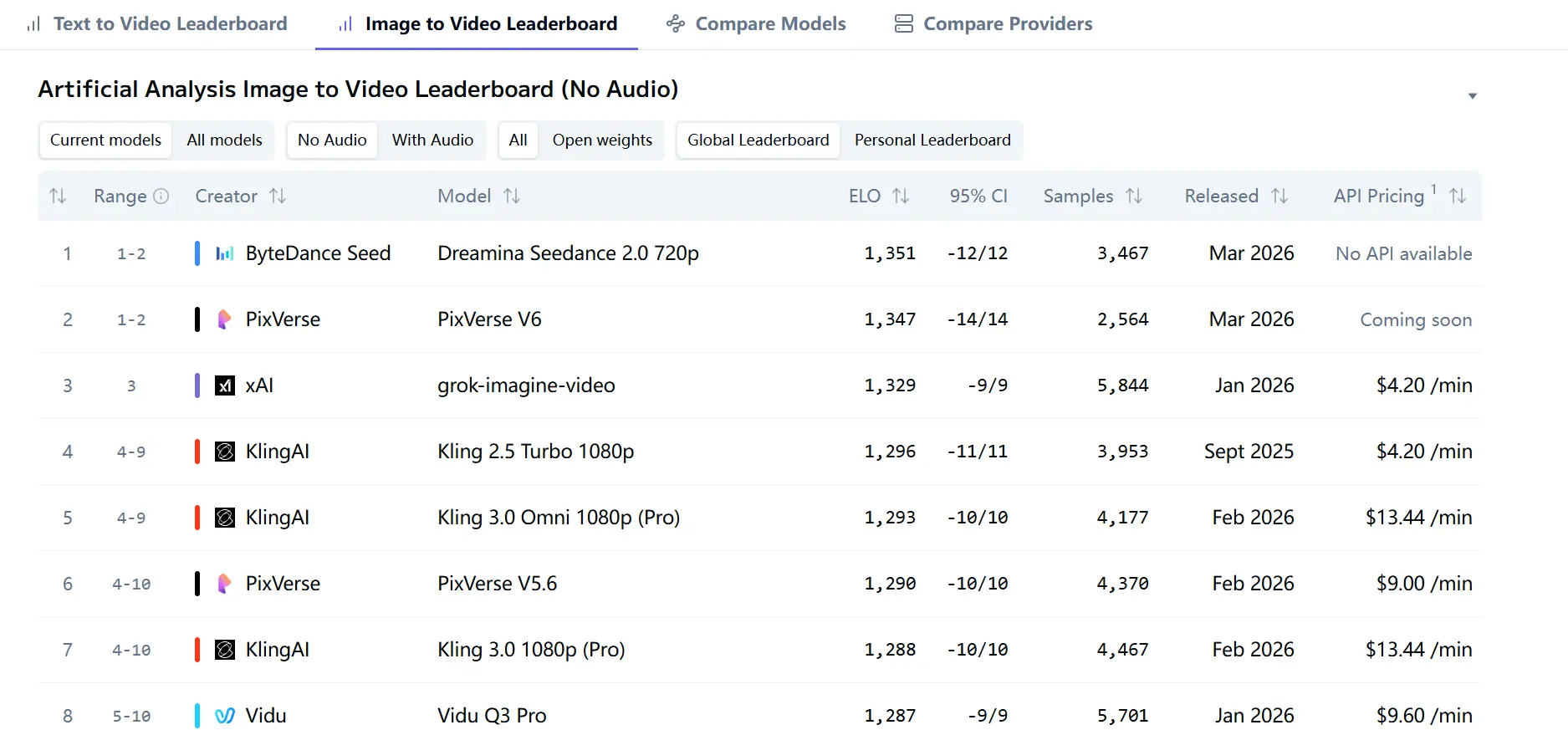

La señal de terceros más sólida en las fuentes revisadas es Artificial Analysis Video Arena. En las páginas actuales del leaderboard, Dreamina Seedance 2.0 720p lidera la Image-to-Video Arena sin audio con una Elo de 1351, y la Text-to-Video Arena sin audio con una Elo de 1269. Las páginas del leaderboard también indican que las clasificaciones provienen de votos ciegos de usuarios, lo cual es importante porque mide la preferencia humana a escala y no solo métricas internas del modelo.

Eso importa porque significa que Seedance 2.0 no solo se está promocionando como capaz; actualmente está siendo preferido por los usuarios en pruebas de comparación directa en dos arenas principales. En texto a video sin audio, lidera a Kling 3.0 1080p (Pro), SkyReels V4, PixVerse V6 y Kling 3.0 Omni 1080p (Pro). En imagen a video sin audio, supera por poco a PixVerse V6 y grok-imagine-video.

Instantánea del rendimiento de Seedance 2.0

| Métrica | Seedance 2.0 |

|---|---|

| Rango imagen a video | Top 15 a nivel global |

| Puntuación ELO | ~1258 |

| Rango texto a video | Top 25 |

| Costo | ~$1.56/min |

| Fortaleza | Equilibrio costo-rendimiento |

👉 Interpretación:

- No siempre es el #1 en calidad bruta

- Pero relación valor-rendimiento excepcional

¿Qué tan bueno es Seedance 2.0, realmente?

Sus mayores fortalezas

Las mayores fortalezas de Seedance 2.0 son claras: maneja mejor el movimiento complejo que muchos modelos de video, admite múltiples modalidades de referencia, ofrece edición y extensión, y actualmente lidera los rankings públicos más visibles en texto a video e imagen a video sin audio. Mejoras en precisión física, realismo y controlabilidad, atributos que son exactamente los que importan cuando un modelo pasa de demos lúdicas a flujos de trabajo profesionales.

Sus limitaciones actuales

ByteDance no presenta a Seedance como perfecto. Todavía hay margen para mejorar la estabilidad del detalle, el realismo y la vivacidad del movimiento, y se señalan desafíos pendientes en la consistencia multi-sujeto, la precisión del renderizado de texto y los efectos de edición complejos.

Mi evaluación

Con base en las fuentes revisadas, Seedance 2.0 se parece menos a una actualización marginal y más a un paso serio hacia un sistema de video listo para producción. Su argumento más sólido no es una sola demo llamativa, sino la combinación de una pila de entrada multimodal más amplia, controles de edición directos, extensión de clips y liderazgo creíble en los leaderboards públicos. Eso lo convierte en uno de los modelos de video más importantes actualmente en el mercado, especialmente para equipos que valoran tanto la controlabilidad como la calidad cinematográfica bruta.

Seedance 2.0 vs Sora 2 vs Veo 3.1

Tabla comparativa (líderes de video con IA en 2026)

| Característica | Seedance 2.0 | Sora 2 | Veo 3.1 |

|---|---|---|---|

| Desarrollador | ByteDance | OpenAI | |

| Tipos de entrada | Texto, imagen, audio, video | Texto | Texto + imagen |

| Generación de audio | ✅ Nativa | ❌ Limitada | ✅ |

| Longitud máx. video | 15–20 sec | ~25 sec | ~8 sec (ampliable) |

| Capacidad de edición | ⭐ Avanzada (basada en referencias) | Moderada | Moderada |

| Clasificación ELO | Top 15–25 | Alta | Alta |

| Eficiencia de costo | ⭐ Alta | Media | Media |

| Uso comercial | Sí | Limitado (marca de agua) | Sí |

| Fortaleza única | Edición multimodal | Narrativa larga | Fidelidad visual |

Puntos clave

- Seedance 2.0 = la mejor edición + flexibilidad multimodal

- Sora 2 = la mejor longitud narrativa

- Veo 3.1 = la mejor fidelidad de imagen a video

En los rankings actuales de Artificial Analysis de texto a video, Seedance 2.0 720p está por delante de Veo 3.1 y Sora 2 Pro en la categoría sin audio. Eso no zanja todos los debates de calidad, porque los modelos difieren en flujo de trabajo, limitaciones de seguridad y empaquetado de producto, pero sí muestra que Seedance 2.0 ha pasado al mismo nivel que las ofertas occidentales más visibles.

La ventaja más evidente de Seedance 2.0 es la amplitud de entrada. ByteDance dice que puede procesar conjuntamente texto, imagen, audio y video, y puede usar hasta 9 imágenes, 3 videos y 3 clips de audio a la vez. La documentación de Sora 2 de OpenAI, en cambio, enumera texto e imagen como entradas y video más audio como salidas, con acceso a través de la app Sora y sora.com; Sora 2 Pro también está disponible para usuarios de ChatGPT Pro en la web. Veo 3.1 de Google se sitúa en un punto intermedio: está construido en torno a la creación guiada por imagen y a la generación de video rica en audio, con hasta 3 imágenes de referencia, extensión de escenas y control del primer y último fotograma.

Cómo acceder y dónde comparar

Si quieres acceder a Sora 2, Veo 3.1 y xx simultáneamente en una sola plataforma, recomiendo CometAPI. El Playgoud de CometAPI proporciona generación directa de video usando solo un comando sencillo o algunas imágenes de referencia. Si quieres configurar tu propia API de generación de video de forma programática, entonces CometAPI vale aún más la pena. Proporciona APIs para Sora 2, Veo 3.1, etc., y actualmente tiene un 20% de descuento.

Cómo usar Seedance 2.0 con CometAPI

Generación de texto a video

Escribe una descripción de tu escena. Cuanto más específica, mejor: incluye movimiento de cámara, iluminación, estado de ánimo y estilo. La fuerte adherencia de Seedance 2.0 al prompt significa que la salida coincide estrechamente con tu intención, lo que la hace fiable para producción de contenido en lugar de prueba y error.

Dentro de CometAPI Playground, puedes introducir prompts y generar videos directamente usando el modelo Seedance 2.0. Esto es especialmente útil para contenido en redes sociales (Reels, TikTok, YouTube Shorts), videos de marca y clips narrativos cortos.

Cómo funciona:

- Abre CometAPI

- Selecciona el modelo Seedance 2.0

- Escribe tu prompt

- Ajusta parámetros (duración, resolución, relación de aspecto)

- Ejecuta el trabajo de generación y espera el resultado

De imagen a video con CometAPI

Sube una imagen estática —como una foto de producto, una ilustración conceptual o un mockup de diseño— y usa las capacidades de imagen a video de Seedance 2.0 a través de CometAPI para animarla.

El resultado es un movimiento suave y consciente del contexto generado a partir de tu entrada visual. Esto es ideal para equipos que ya tienen recursos de diseño y quieren convertirlos en video sin un flujo de producción completo.

Cómo funciona:

- Usa

input_reference(o el campo de carga de archivos equivalente en Playground) - Añade un prompt centrado en el movimiento que describa cómo debe moverse la escena

Ejemplo de prompt:

“La cámara se acerca lentamente hacia el producto, iluminación de estudio suave, reflejos sutiles, sensación de comercial premium”

Generación audiovisual en una sola pasada

En lugar de generar video primero y luego añadir audio por separado, CometAPI admite la tubería nativa de generación audiovisual de Seedance 2.0.

Describiendo tanto lo visual como el sonido en un solo prompt, puedes generar video y audio sincronizados en un solo paso. Esto produce resultados más coherentes e intencionales, además de reducir el tiempo de edición.

Ejemplo de prompt:

“Una playa tranquila al amanecer, olas suaves rompiendo, cálida luz dorada, música ambiental suave con sonidos del mar”

La salida incluye:

- Video generado

- Audio de fondo sincronizado

- Temporización y estado de ánimo alineados de forma natural

Por qué usar CometAPI para Seedance 2.0

- Acceso directo vía API o Playground

- Control sencillo de parámetros (duración, resolución, formato)

- Compatible con flujos de trabajo de texto a video e imagen a video

- Gestión de tareas integrada para generación de video asíncrona

Conclusión

Seedance 2.0 parece un verdadero salto en la generación de video con IA: un sistema multimodal que combina entradas de texto, imagen, audio y video; líder en los leaderboards tanto de texto a video como de imagen a video; y un modelo construido para control de estilo “director” más que para uso casual. Si solo te importa la calidad percibida bruta, la evidencia actual dice que es excepcional.

Empieza a crear con Seedance 2.0 en CometAPI hoy mismo.