Vidu Q3 entró en la conversación a inicios de 2026 como una de las señales más claras de que la generación de video impulsada por IA está pasando de clips cortos y novedosos hacia una narración genuina, con múltiples tomas. En los meses desde su lanzamiento amplio, Vidu Q3 se ha convertido en un elemento básico en flujos de trabajo de creadores, pilotos de investigación y pilotos comerciales —y con razón: lleva la duración, la integración audiovisual y la coherencia de múltiples tomas más lejos que la mayoría de los modelos anteriores, a la vez que ofrece una API orientada a desarrolladores para uso programático.

¿Qué es Vidu Q3?

Vidu Q3 es la última iteración insignia de la arquitectura de modelo de video grande (LVM) de ShengShu Technology. A diferencia de sus predecesores (Vidu 1.0 y 1.5), que requerían flujos separados para la generación visual y la postproducción de audio, Vidu Q3 es un motor generativo “todo en uno”.

El avance central de Vidu Q3 es su capacidad para generar visuales de alta definición y audio de alta fidelidad simultáneamente.[ Al comprender la física del sonido y la luz en conjunto, el modelo elimina el “valle inquietante” de audio desincronizado que se ve a menudo en modelos competidores. Admite hasta 16 segundos de generación continua en resolución nativa 1080p, situándolo como una herramienta lista para producción para cortometrajes, anuncios y narrativas.

¿Cómo funciona Vidu Q3 bajo el capó?

Si bien los detalles de la arquitectura central son propietarios, Vidu se basa en la fusión U-ViT de modelos de difusión y transformers, un diseño conocido por equilibrar la coherencia, la continuidad temporal y la expresividad en la generación de video.

Esta arquitectura híbrida permite que el modelo razone sobre movimiento, sonido y contexto narrativo a lo largo de secuencias extendidas.

6 funciones destacadas de Vidu Q3

1. Generación de duración extendida — ¿hasta dónde puede llegar?

Una de las características principales de Vidu Q3 es la mayor duración en una sola generación. Muchos modelos anteriores se enfocaban en microclips; Q3 extiende intencionalmente la longitud del clip para permitir arcos narrativos simples y secuencias de múltiples tomas sin obligar a los creadores a unir muchos clips diminutos. La documentación de la plataforma y los portales de socios anuncian hasta ~16 segundos de generación nativa en una pasada (las opciones de formato y calidad pueden variar según el proveedor y el plan de la API). Esto importa porque pasar de 4–8 segundos a 16 segundos cambia la forma en que los creadores planifican escenas, escriben beats y marcan los cues de audio.

2. Fidelidad visual y coherencia temporal

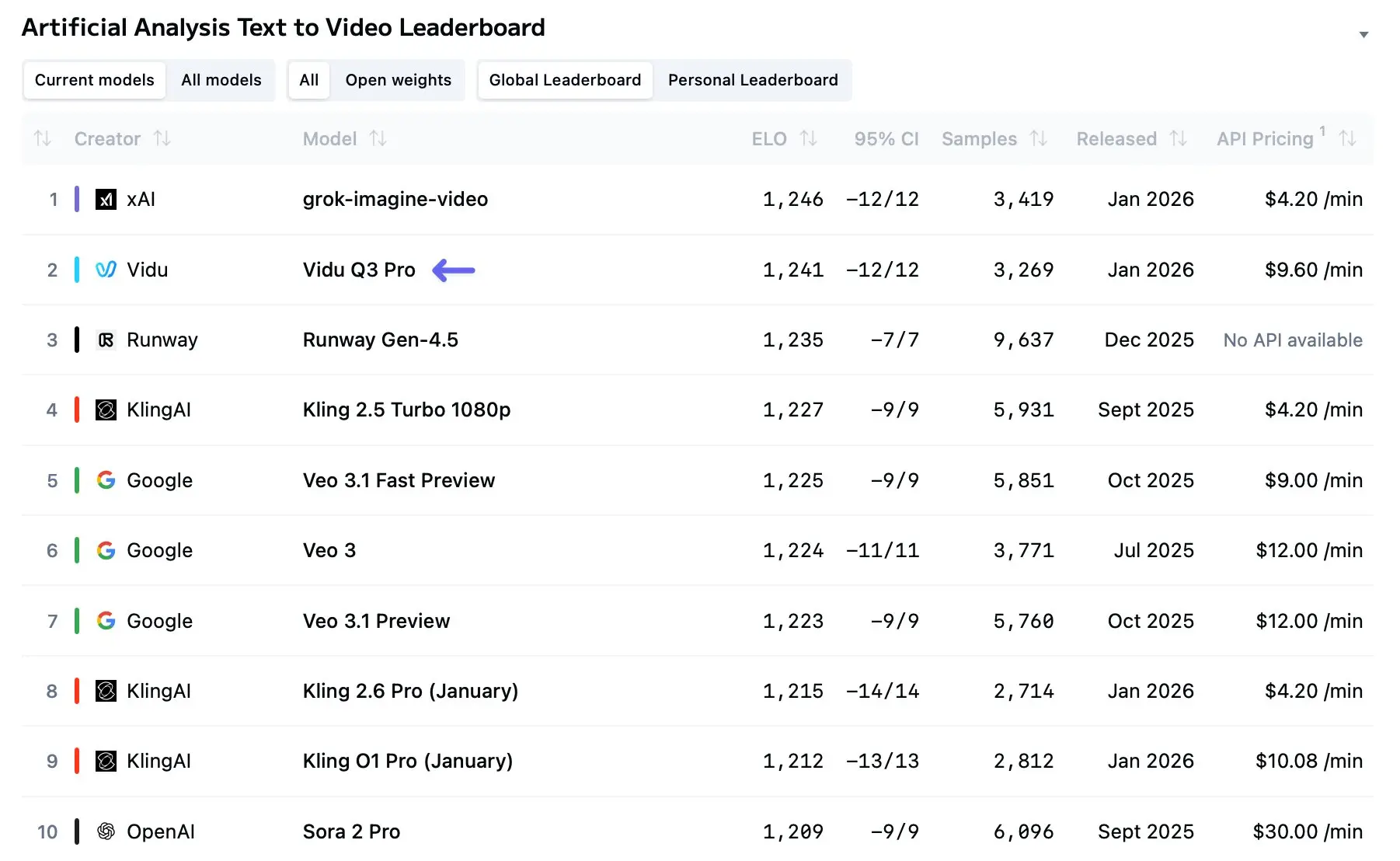

Evaluaciones independientes y benchmarks iniciales muestran que Vidu Q3 produce imágenes más claras y menos distorsiones a nivel de fotograma que los modelos de consumo anteriores. Las mejoras en la arquitectura y la ampliación de datos parecen reducir el parpadeo y mejorar la continuidad del movimiento en clips de menos de 10–16 segundos. Sin embargo, el modelo aún puede tener dificultades con escenas densas y con múltiples sujetos (multitudes, interacciones físicas complicadas) donde la oclusión y el movimiento fino requieren un razonamiento físico sólido. Sitios de rankings comparativos y tablas de clasificación de modelos ya han colocado a Vidu Q3 en posiciones altas en listas de T2V (texto a video), aunque los rankings varían según el benchmark y el conjunto de datos.

3. Generación nativa de audio + video

A diferencia de los sistemas que producen visuales silenciosos y dejan el audio para la postproducción, Vidu Q3 integra la generación de audio dentro del modelo. El resultado es diálogo con sincronización labial, SFX temporizados y música de fondo opcional producidos junto con los fotogramas. Integrar el sonido a nivel de modelo reduce errores de alineación (deriva de sincronización labial, cues fuera de ritmo) y acorta el ciclo de producción para demos, vistas previas y muchas piezas finales de formato corto.

4. Control de cámara inteligente y narrativas de múltiples tomas

Las funciones de “cámara inteligente” de Q3 interpretan prompts para movimientos de cámara (paneos, dolly, tracking) y secuencias de múltiples tomas. En lugar de producir un único punto de vista estático, el modelo puede generar cortes y transiciones planificados para que el clip resultante se perciba como una escena dirigida. Para los creadores, esto cambia la salida de “una imagen compuesta que se mueve” a “una escena corta con múltiples tomas”. Eso mejora la experiencia de visionado y habilita una narración visual más rica en una sola generación.

5. Consistencia multirreferencia y fidelidad de personajes

Vidu (como plataforma) ha invertido en sistemas de “referencia a video” y consistencia multirreferencia que permiten a los creadores subir varias imágenes de referencia para fijar la identidad del personaje a lo largo de los fotogramas. Q3 amplía estas ideas para mantener la apariencia del personaje y la utilería consistentes en múltiples ángulos de cámara y cortes, un requisito básico pero esencial para una salida narrativa coherente. Esto es especialmente útil para anime o proyectos estilizados donde mantener un arte de personaje consistente es crítico.

6. Preparado para desarrolladores: APIs y flujo de trabajo

La suite de modelos de Vidu—incluido Q3—está disponible a través de interfaces web y una API REST programática. Los desarrolladores pueden enviar trabajos de texto a video o imagen+más texto a un endpoint de inferencia, recibir un ID de tarea y consultar los resultados (patrón típico de trabajo asíncrono). La API ofrece parámetros como resolución, relación de aspecto, duración, amplitud de movimiento y un conmutador para la generación de audio. Eso hace que Q3 sea accesible para automatización, flujos por lotes e integración con pipelines editoriales.

¿Cómo se compara Vidu Q3 con Sora 2 y Veo 3.1?

Respuesta corta: Vidu Q3 compite con fuerza en salidas narrativas más largas e integración de audio/video para escenas de 10–20 s, Sora 2 sobresale en realismo físicamente plausible y en integración social, y Veo 3.1 lidera en pulido a nivel de píxel, herramientas de continuidad multiframe e integración de API empresarial. A continuación desglosamos las diferencias en ejes prácticos.

¿Qué modelo es más fuerte en realismo y física: Sora 2 o Vidu Q3?

Sora 2 (OpenAI) se entrenó explícitamente para plausibilidad física y simulación del mundo: sus notas públicas destacan comportamiento físico avanzado, interacciones de objetos precisas y trayectorias de movimiento altamente realistas. Sora 2 también proporciona audio sincronizado e integraciones con apps sociales (incluyendo cameos y una app móvil), lo que lo hace excepcionalmente fuerte para escenas realistas y físicamente coherentes. Si tu briefing exige colisiones precisas, dinámica realista o movimiento humano fotorrealista en tomas cortas y autocontenidas, Sora 2 suele ser superior.

Vidu Q3, por el contrario, está posicionado más como un motor de narración: clips más largos, secuenciación de múltiples tomas y control de cámara de estilo director. Eso no significa que Vidu sacrifique realismo, pero sus avances principales son la continuidad narrativa y la salida audiovisual combinada en lugar de la simulación física pura. Para narración cinematográfica corta (p. ej., una demo de producto de 16 s con cortes y VO), el flujo de trabajo de Q3 suele ser más rápido y simple.

¿Qué modelo es mejor en pulido cinematográfico y alta fidelidad: Veo 3.1 vs Vidu Q3?

Veo 3.1 (Google / DeepMind / Gemini) se ha promocionado como una opción de alta fidelidad y de nivel empresarial con sólidos controles de continuidad, generación nativa de audio y soporte dentro de los stacks de Google Cloud/Vertex/Gemini. Veo 3.1 introdujo funciones avanzadas “ingredients to video”, soporte nativo vertical (9:16) y escalado a altas resoluciones (incluidas capacidades 4K en algunos flujos). Para proyectos que requieren la mayor calidad de píxeles, armonía de color precisa y APIs empresariales sólidas, Veo 3.1 suele ser la elección.

Vidu Q3 se mantiene firme al centrarse en duración extendida + coherencia de historia con múltiples tomas y una productización centrada en creadores (playgrounds web rápidos, orquestación multirreferencia). Si tu prioridad es producir una escena corta dirigida por humanos con múltiples movimientos de cámara y cues de audio integrados (y valoras la duración por encima del pulido absoluto de píxeles), Vidu Q3 es convincente. Para fidelidad fotorrealista pura, Veo 3.1 suele tener la ventaja.

A inicios de 2026, el triunvirato de video con IA lo conforman Sora 2 de OpenAI, Veo 3.1 de Google y Vidu Q3. Así se comparan en un contraste directo:

| Feature | Vidu Q3 | Sora 2 | Veo 3.1 |

|---|---|---|---|

| Max Single Clip Duration | ~16 s | Up to ~25 s (Pro) | 8 s (with narrative stitching features) |

| Native Audio Generation | Yes (integrated) | Yes (experimental) | Yes (advanced) |

| Cinematic Camera Control | Yes (shot aware) | Limited presets | Yes (multi-shot consistency) |

| Multi-shot Narrative | Yes | Yes | Yes |

| Text Rendering in Frames | Yes | Varies | Varies |

| Resolution | 1080p | 1080p | 1080p / 4K in special cases |

| Primary Use Case | Narrative Storytelling, Animation | High-Budget Concept/Film | Youtube Shorts / TikTok |

Análisis:

- Vs. Sora 2: Sora 2 sigue siendo el peso pesado para fidelidad visual pura e imaginación surrealista (“calidad Hollywood”). Sin embargo, Vidu Q3 lo supera en eficiencia de flujo de trabajo gracias al límite de 16 segundos y a una integración de audio superior. Para creadores que necesitan un clip “todo en uno”, Q3 es más rápido.

- Vs. Veo 3.1: Veo 3.1 de Google destaca en velocidad para clips más cortos orientados a redes sociales (4–8 s) e integra profundamente con YouTube. Vidu Q3 apunta más arriba en la cadena de valor, enfocándose en animadores profesionales y cineastas que necesitan tomas más largas y continuas que a Veo le cuesta mantener con consistencia.

¿Qué aplicaciones prácticas habilita Vidu Q3?

Publicidad y marketing de formato corto

Las marcas pueden prototipar conceptos de anuncios de extremo a extremo mucho más rápido: escribir un guion, generar un visual de 16 segundos con VO y SFX sincronizados, iterar en el texto y la composición de las tomas, y producir múltiples doblajes por idioma mediante prompts en distintos idiomas. Para pruebas A/B de creatividades sociales, la reducción del tiempo de entrega es una clara ventaja de negocio. Estudios de caso publicados por las plataformas muestran a marketers usando Vidu Q3 para microanuncios y teasers de producto.

Storyboarding y previsualización para cine y TV

Directores y editores usan clips cortos de IA como previsualizaciones (previz) para bloquear escenas, probar movimientos de cámara y presentar tratamientos. La secuenciación de múltiples tomas y los controles de cámara inteligentes de Vidu Q3 son especialmente útiles aquí: los equipos creativos pueden iterar en el blocking y el diálogo sin el costo de rodajes en locación. Si bien la previz con IA no reemplaza la dirección en set, acorta los ciclos de decisión tempranos.

E-learning y videos explicativos

Departamentos de educación y formación corporativa pueden generar segmentos explicativos animados concisos con narración sincronizada y SFX anotados. Para contenido estandarizado (formación de producto, onboarding), esto reduce la dependencia de casas de producción costosas y acelera las versiones localizadas. La velocidad de publicación y las capacidades nativas de audio hacen que Vidu Q3 sea atractivo para estos casos.

Gaming, arte conceptual y producción indie

Desarrolladores indie y equipos de videojuegos usan clips cinematográficos cortos con IA para tráilers, maquetas de diálogo de NPC o exploración de estilo. El soporte de Vidu Q3 para imágenes de referencia y consistencia de personajes ayuda a mantener la identidad visual de la IP de un juego en tráilers de prototipo. El modelo también se usa para materiales de pitch para asegurar financiación o interés de publishers.

Accesibilidad y localización rápida

Dado que el audio se genera de forma nativa, Vidu Q3 simplifica las versiones multilingües: genera la misma toma con prompts en diferentes idiomas, o pide timbres de voz variados. Esto permite la localización rápida de contenido de marketing o materiales de formación, manteniendo aproximaciones de sincronización labial suficientemente buenas para muchos contextos de formato corto (aunque una coincidencia labial de primer nivel para broadcast aún puede requerir ajuste humano).

¿Es Vidu Q3 el mejor modelo de video con IA en 2026?

Declarar un único “mejor” modelo pierde matices: el ganador depende del caso de uso.

- Para salida fotorrealista, físicamente fundamentada y manejo de seguridad conservador, Sora 2 de OpenAI suele verse como la mejor opción. Enfatiza el realismo y la moderación robusta, haciéndolo atractivo para producciones de alto nivel y empresas aversas al riesgo.

- Para contenido de formato corto integrado a plataformas y optimizado por formato, la salida vertical nativa de Veo 3.1 y las integraciones de Google (YouTube Shorts, Google Photos) lo vuelven singularmente conveniente.

- Para prototipado rápido de audio y video, control narrativo de múltiples tomas y un fuerte equilibrio de funciones de storytelling, Vidu Q3 destaca—especialmente cuando la velocidad de iteración y el audio integrado importan más que el fotorrealismo absoluto. Benchmarks tempranos e informes de proveedores ubican a Vidu Q3 alto en rankings de T2V, y sus funciones lo hacen una elección práctica para marketers, creadores independientes y estudios que prototipan ideas nuevas.

¿Limitaciones y consideraciones?

Si bien Vidu Q3 marca un avance, tiene contrapartidas:

- La duración del clip aún está limitada (~16 s), por lo que narrativas más largas requieren unión de clips o múltiples prompts.

- El costo de recursos puede escalar con la generación en HD y audio complejo.

- Las herramientas de IA aún requieren criterio editorial para refinar y editar salidas hasta productos terminados.

Entonces: Vidu Q3 es un contendiente de primer nivel en 2026, particularmente para creadores que priorizan flujos de trabajo con audio nativo y narración de múltiples tomas. Si es el mejor depende del briefing de producción preciso, las restricciones regulatorias y el pipeline de distribución del usuario.

Conclusión

Vidu Q3 destaca en 2026 como un modelo líder de video con IA capaz de producir clips de audio y video integrados, listos para la narración que conectan la creatividad con las demandas de producción. En comparación con la fuerte cohesión narrativa de Sora 2 y el realismo cinematográfico de Veo 3.1, Vidu Q3 ofrece un conjunto de herramientas equilibrado, ideal para narradores, creadores de contenido y flujos de trabajo comerciales.

A medida que los benchmarks demuestran su alto rendimiento y sus funciones integradas, Vidu Q3 representa un punto de inflexión en la IA generativa de video, haciendo que la producción audiovisual compleja sea más accesible y eficiente.

Los desarrolladores pueden acceder Vidu Q3, Veo 3.1 y Sora 2 vía CometAPI, los modelos más recientes listados corresponden a la fecha de publicación del artículo. Para comenzar, explora las capacidades del modelo en el Playground y consulta la guía de la API para instrucciones detalladas. Antes de acceder, asegúrate de haber iniciado sesión en CometAPI y obtenido la clave de API. CometAPI ofrece un precio mucho más bajo que el precio oficial para ayudarte a integrar.

¿Listo para empezar?→ Regístrate para la generación de video hoy !

Si quieres conocer más consejos, guías y noticias sobre IA síguenos en VK, X y Discord!