GPT-5 d'OpenAI a été lancé début août 2025 et est rapidement devenu disponible via plusieurs canaux de distribution. CometAPI, une passerelle multimodèle qui expose GPT-5 aux côtés de centaines d'autres modèles, est un moyen rapide pour les équipes d'expérimenter GPT-5 sans changer de SDK. Cet article propose une documentation pratique pour vous expliquer. est ce que nous faisons CometAPI propose, how pour appeler GPT-5 via celui-ci, les compromis que vous devez évaluer et les contrôles pratiques de gouvernance et de coûts à mettre en place avant de déplacer les flux de travail critiques vers GPT-5.

Qu'est-ce que GPT-5 et qu'est-ce qui le différencie des modèles précédents ?

GPT-5 est la prochaine famille phare de modèles de langage d'OpenAI, lancée début août 2025. Elle se présente comme un système de raisonnement multimodal unifié combinant des composants rapides non raisonnés, une variante de « raisonnement » plus approfondie (souvent appelée « pensée GPT-5 ») et un routeur qui décide du sous-modèle à utiliser en fonction de la complexité et des outils requis. L'effet net revendiqué par OpenAI : un meilleur raisonnement, des fenêtres contextuelles plus larges et une meilleure prise en charge du codage et des tâches agentiques.

Architecture et fonctionnalités clés

- Système multi-composants : GPT-5 est décrit comme un système qui achemine les requêtes vers différents sous-modèles internes (raisonnement rapide ou approfondi) en fonction des besoins ; les développeurs peuvent demander le modèle de raisonnement via l'API pour des performances maximales.

- Contexte large : La famille de modèles prend en charge des contextes extrêmement vastes (des centaines de milliers de jetons), permettant la gestion en un seul passage de documents longs, de bases de code ou de conversations multi-fichiers.

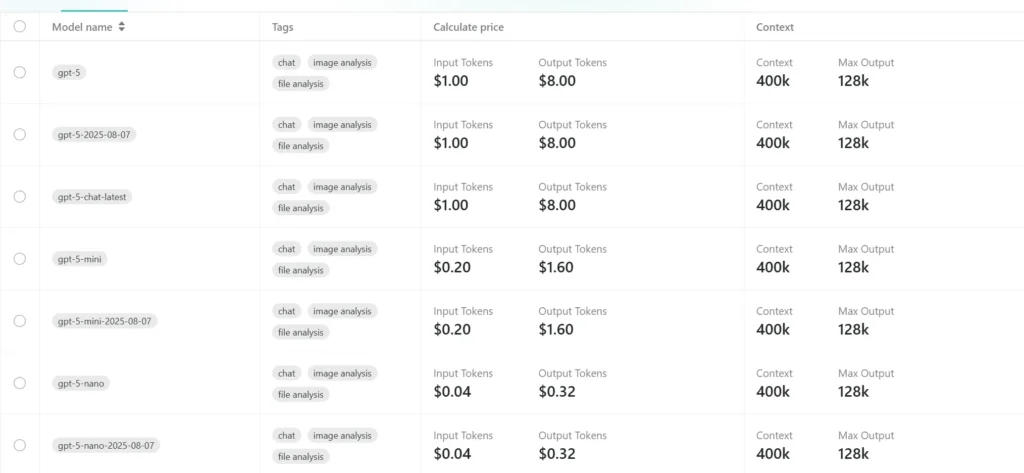

- Famille multi-tailles : OpenAI a publié GPT-5 en plusieurs tailles (standard

gpt-5,gpt-5-mini,gpt-5-nano) afin que les équipes puissent faire des compromis entre la latence, le coût et la puissance de raisonnement.

Qu'est-ce que CometAPI et propose-t-il réellement GPT-5 ?

Une définition rapide

API Comet CometAPI est une plateforme d'agrégation d'API qui offre un accès unifié à des centaines de modèles d'IA (familles GPT d'OpenAI, Anthropic Claude, xAI Grok, modèles d'images, etc.) via une interface REST unique et compatible OpenAI. Cela signifie que les développeurs peuvent changer de fournisseur de modèles en modifiant le nom du modèle plutôt qu'en réécrivant le code réseau. Sur ses pages produits, CometAPI le mentionne explicitement. GPT-5 et variantes apparentées (par exemple, gpt-5, gpt-5-chat-latest, gpt-5-mini) comme points de terminaison disponibles.

Pourquoi les équipes utilisent des passerelles comme CometAPI

Les services de passerelle comme CometAPI sont attrayants car ils vous permettent de :

- Échanger des modèles rapidement sans modifier de grandes quantités de code d'intégration.

- Comparer les prix et acheminer certaines demandes vers des variantes de modèles moins chères ou plus rapides.

- Facturation et journalisation globales sur plusieurs modèles et fournisseurs.

La documentation de CometAPI fournit un chemin de migration simple et un client de style OpenAI (de sorte que votre code OpenAI existant ou « compatible OpenAI » n'a souvent besoin que de modifications mineures).

Comment CometAPI expose-t-il GPT-5 par programmation ?

CometAPI présente un API REST compatible OpenAI surface : une URL de base, Authorization: Bearer <YOUR_KEY>et des corps de requête similaires aux points de terminaison de chat/complétion d'OpenAI. GPT-5 la plateforme documente les noms de modèles tels que gpt-5, gpt-5-miniet gpt-5-nano et les points finaux mentionnés incluent POST https://api.cometapi.com/v1/chat/completions pour les appels de type chat et /v1/responses pour certaines variantes hors chat. Des exemples de configuration (URL de base, format d'en-tête et paramètres de modèle) sont publiés dans Documentation de CometAPI et guides de démarrage rapide.

Modèle typique de point de terminaison et d'authentification

- URL de base :

https://api.cometapi.com/v1(ou le documenté/v1/chat/completionspour discuter et/v1/responsespour certaines variantes non-chat.). - En-tête d'authentification :

Authorization: Bearer sk-xxxxxxxxxxxx(Problèmes CometAPIsk-jetons de style dans le tableau de bord ). - Type de contenu :

application/json. - Paramètre du modèle : set

modelàgpt-5, gpt-5-2025-08-07,gpt-5-chat-latest,gpt-5-miniou autres, se référer à page modèle.

Comment démarrer avec CometAPI et demander GPT-5 ? (étape par étape)

Vous trouverez ci-dessous un flux d’intégration concis et fiable que vous pouvez suivre dès aujourd’hui.

Étape 1 : Inscrivez-vous et obtenez une clé CometAPI

- Allez dans cometapi.com et créer un compte.

- Depuis votre tableau de bord, accédez à Jetons API or Centre personnel → Ajouter un jeton. CometAPI émet un jeton dans

sk-...format. Stockez-le en toute sécurité (n'intégrez pas les clés dans les dépôts publics).

Étape 2 : Choisir la chaîne de modèle

- Sélectionnez le nom du modèle qui correspond à vos besoins (par exemple,

gpt-5,gpt-5-nano-2025-08-07). CometAPI publie souvent plusieurs alias pour chaque modèle afin que vous puissiez choisir des compromis entre précision et coût.

Étape 3 : Faites votre première demande (curl)

Un minimum curl exemple qui suit le modèle compatible OpenAI :

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-YOUR_COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-5",

"messages": [{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"Summarize the benefits of using a model aggregator."}],

"max_tokens": 500,

"temperature": 0.2

}'

Cela reflète la structure de l'API de chat d'OpenAI, mais pointe vers l'URL de base de CometAPI et utilise votre jeton Comet.

Étape 4 : exemple Python (requêtes)

import requests, os

COMET_KEY = os.getenv("COMETAPI_KEY") # set this in your environment

url = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "gpt-5",

"messages": [

{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"List three concrete steps to reduce model hallucination in production."}

],

"max_tokens": 400,

"temperature": 0.1

}

resp = requests.post(url, json=payload, headers=headers, timeout=60)

resp.raise_for_status()

print(resp.json())

remplacer model avec gpt-5-nano ou l'alias exact des documents CometAPI pour les variantes plus petites et moins chères.

Prix en CometAPI

Quelles sont les meilleures pratiques et mesures d’atténuation pratiques pour une utilisation en production ?

Vous trouverez ci-dessous des modèles concrets pour réduire les risques et améliorer la fiabilité lorsque vous utilisez un intermédiaire comme CometAPI.

Commencez avec un petit pilote et exécutez des tests côte à côte

Exécutez des requêtes identiques vers OpenAI (si vous disposez d'un accès direct) et CometAPI pour comparer les résultats, la latence et le coût. Cela révèle les transformations implicites, les filtres de contenu ou les incohérences d'alias de modèle.

Instrument d'observabilité et d'assurance qualité

Enregistrez les invites, les jetons renvoyés (obscurcis pour les informations personnelles identifiables), les latences et les codes d'erreur. Implémentez des tests automatisés pour détecter les taux de dérive des invites et d'hallucinations. Suivez l'utilisation des alias de modèle afin que les migrations soient vérifiables.

Protégez vos clés et faites-les tourner régulièrement

Traitez les jetons CometAPI comme n'importe quel secret d'API : stockez-les dans des gestionnaires de secrets, effectuez une rotation périodique et étendez les jetons aux environnements (dev/stage/prod).

Mettre en œuvre une sécurité à plusieurs niveaux

Utilisez une combinaison de :

- Ingénierie rapide pour réduire les hallucinations (contraintes explicites, sortie structurée).

- Contrôles post-traitement (vérification des faits, listes de blocage, vérifications d'expressions régulières pour les informations personnelles identifiables).

- L'homme dans la boucle pour les sorties à haut risque.

Il s’agit de normes pour les déploiements GPT-5 qui gèrent du contenu critique ou légal.

Quels sont les pièges courants et comment résoudre les problèmes d’accès ?

Piège : « Le modèle n'existe pas / Accès impossible. » Certains développeurs signalent que l'accès aux modèles peut être limité par des étapes de vérification du fournisseur ou de l'organisation lors de l'utilisation d'API de fournisseur direct ; des restrictions similaires peuvent apparaître lorsque les modèles de fournisseur proxy d'agrégateurs sont utilisés. Si vous voyez une erreur « Le modèle n'existe pas » ou une erreur d'autorisation, vérifiez : (a) si votre clé CometAPI est valide et non expirée ; (b) si le nom du modèle demandé correspond exactement à la liste prise en charge par CometAPI ; et (c) si des étapes de vérification ou de facturation supplémentaires sont requises par le fournisseur sous-jacent. En cas d'erreurs d'accès liées à la vérification et d'anomalies de délai d'expiration/d'autorisation, veuillez fournir des informations détaillées à l'équipe de contact pour résolution (e-mail : support@cometapi.com).

Piège : latence ou coût inattendu. Les modes de raisonnement complexes et les contextes étendus entraînent une latence et des dépenses de jetons. max_tokens, Réduire temperature le cas échéant, et préfèrent mini Variantes pour charges de travail à haut débit. Surveillance avec journalisation et alertes.

Note de clôture

CometAPI offre aux équipes un moyen rapide d'expérimenter les variantes de GPT-5 tout en centralisant l'accès aux modèles. Cependant, l'utilisation en production exige la même rigueur que pour tout modèle puissant : clés sécurisées, ingénierie rapide et minutieuse, surveillance des hallucinations et vérification des politiques et des aspects juridiques des charges de travail sensibles. Commencez par un petit pilote, utilisez les tableaux de bord de CometAPI pour mesurer les dépenses en jetons et la latence, et passez à des variantes plus rationnelles uniquement après avoir validé l'exactitude et la sécurité de votre domaine.

Les développeurs peuvent accéder GPT-5 , GPT-5 Nano et GPT-5 Mini via CometAPI (CometAPI recommande /v1/responses), les dernières versions des modèles répertoriées sont celles en vigueur à la date de publication de l'article. Pour commencer, explorez les fonctionnalités du modèle dans le cour de récréation Consultez le guide de l'API pour des instructions détaillées. Avant d'accéder à CometAPI, assurez-vous d'être connecté à CometAPI et d'avoir obtenu la clé API. API Comet proposer un prix bien inférieur au prix officiel pour vous aider à vous intégrer.

Voir aussi Comment utiliser les nouveaux paramètres et outils de GPT-5

FAQ

1. Quelle variante du modèle GPT-5 devez-vous choisir et qu'en est-il des jetons/tarifs ?

CometAPI répertorie plusieurs variantes de GPT-5 (par défaut) gpt-5, des instantanés de discussion comme gpt-5-chat-latest, et des versions plus petites telles que gpt-5-mini/gpt-5-nano). Choisissez selon vos besoins :

gpt-5/gpt-5-chat-latest— capacité complète de chat à usage général, idéale pour la qualité et le raisonnement.gpt-5-mini/gpt-5-nano— un coût et une latence inférieurs pour les tâches à volume élevé ou à faible criticité.

2. Comment concevoir des appels pour des contextes larges et un raisonnement de haute qualité ?

Contexte long : GPT-5 prend en charge de très grandes fenêtres contextuelles. Lors de l'envoi de documents volumineux, fragmentez délibérément les entrées, utilisez l'augmentation de la récupération (base de données vectorielle + fenêtrage contextuel) et limitez le nombre maximal de jetons de sortie afin de maîtriser les coûts.

3. Quelles mesures de sécurité, de confidentialité et de conformité devez-vous appliquer ?

Hygiène des clés API. Conservez les clés dans des variables d'environnement, faites-les tourner régulièrement et définissez leur portée lorsque cela est possible. Ne les enregistrez pas dans des dépôts. (Bonnes pratiques reprises dans les guides du développeur.)

Résidence et confidentialité des données. Veuillez lire la politique de confidentialité et les conditions générales de CometAPI (ainsi que la politique d'OpenAI) avant d'envoyer des données personnelles, de santé ou réglementées sensibles via un agrégateur tiers. Certaines entreprises exigeront des contrats avec des fournisseurs directs ou des instances privées.

Limites de taux et protections de quotas. Implémentez des disjoncteurs, des backoffs exponentiels et des contrôles de quotas en production pour éviter les coûts incontrôlables et les pannes en cascade. Les tableaux de bord CometAPI exposent l'utilisation et les quotas ; utilisez-les pour appliquer des limites programmatiques.