La branche de recherche de ByteDance graine a lancé Seed3D 1.0, un modèle de base 3D haute fidélité à image unique produisant des maillages, des matériaux PBR et des textures alignées prêts à la simulation, des ressources conçues pour s'intégrer directement aux moteurs physiques et aux simulateurs robotiques. Cette version vise à combler un fossé important : la génération de contenu évolutif (contenu visuel diversifié) et la fidélité physique requise par l'IA intégrée et la formation sur simulateur.

Qu'est-ce que ByteDance Seed3D 1.0 ?

Seed3D 1.0 est un modèle de fondation 3D conçu pour convertir une seule image RVB d'un objet ou d'un environnement dans un prêt pour la simulation Ensemble d'actifs 3D : généralement un maillage explicite et étanche, des textures associées avec mappage UV et des paramètres de matériaux de rendu physique (PBR). Le modèle est conçu non seulement pour produire une géométrie et des textures visuellement fidèles, mais aussi pour générer des actifs nécessitant un post-traitement minimal avant leur utilisation dans des simulateurs tels qu'Isaac Sim, Unity ou Unreal Engine pour la robotique, la formation ou la création de mondes virtuels.

Principaux objectifs de conception de haut niveau :

- Entrée d'image unique: supprimez le besoin de matériel de capture ou de numérisation multi-vues.

- Préparation à la simulation: garantir que la topologie, l'échelle et les matériaux PBR sont adaptés à la simulation physique.

- Évolutivité de la scène:permet aux objets générés d'être assemblés automatiquement en scènes cohérentes.

- Intégration ::adaptation minimale aux moteurs physiques courants et aux pipelines d'exécution.

Quelles fonctionnalités offre Seed3D 1.0 ?

Géométrie haute fidélité (mailles étanches)

Seed3D produit géométrie fermée et multiple Conçu pour une gestion précise des collisions et une physique de contact fiable. Le composant géométrique utilise un hybride VAE + transformateur de diffusion pour produire des maillages préservant le niveau de détail et conservant les détails structurels fins tels que les protubérances fines, les trous et le texte. Le pipeline d'extraction de maillage utilise une stratégie double de cubes en marche et d'isosurfaces hiérarchiques pour extraire efficacement des surfaces de haute qualité. ()

Textures photoréalistes et matériaux PBR

Le pipeline de textures produit des cartes d'albédo cohérentes sur plusieurs vues et des textures PBR complètes (albédo, métallisé, rugosité), et peut produire des textures jusqu'à une résolution 4K. Ces cartes sont conçues pour que l'éclairage se comporte physiquement de manière plausible dans les moteurs de rendu. Un module d'inpainting UV complète les zones occultées et assure la cohérence spatiale de l'atlas UV.

Simulation et préparation du pipeline

Les sorties sont exportables vers des formats courants (OBJ/GLB). Les ressources générées sont intentionnellement prêt pour la simulation: ils s'intègrent dans des simulateurs physiques où les maillages de collision et les paramètres de frottement/rigidité peuvent être automatiquement dérivés ou ajustés, permettant une utilisation immédiate dans la robotique ou les moteurs de jeu. Seed3D démontre des flux de travail qui placent les ressources générées dans Isaac Sim pour des expériences de manipulation.

Génération de scènes et assemblage factorisé

Au-delà des objets uniques, Seed3D utilise une approche de génération de scène factorisée où les modèles de langage de vision déduisent des cartes d'agencement (positions, échelles, orientations) et Seed3D synthétise et place les objets en conséquence, permettant une composition de scène cohérente pour les intérieurs et les aménagements urbains.

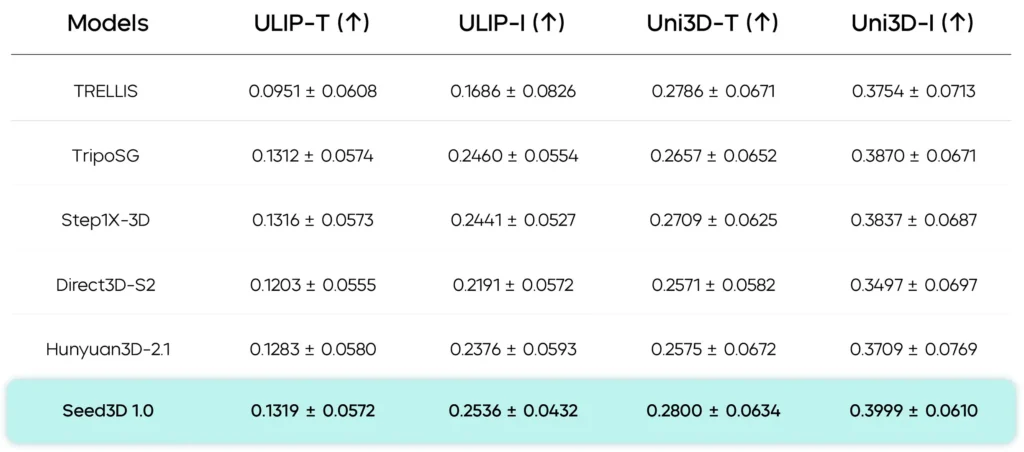

Résultat de l'évaluation des performances

Génération de géométrie

Lors des tests de géométrie, le modèle géométrique à 1.5 milliard de paramètres de Seed3D 1.0 (Seed3D-DiT + VAE) offre une meilleure précision structurelle et des détails plus fins que plusieurs modèles de référence (TRELLIS, TripoSG, Step1X-3D, Direct3D-S2 et des modèles plus volumineux comme Hunyuan3D-2.1). L'architecture de Seed3D, combinant diffusion en espace latent, décodage SDF précis et extraction hiérarchique des maillages, produit des maillages présentant moins d'artefacts et une meilleure préservation de la géométrie haute fréquence (texte, petites protubérances).

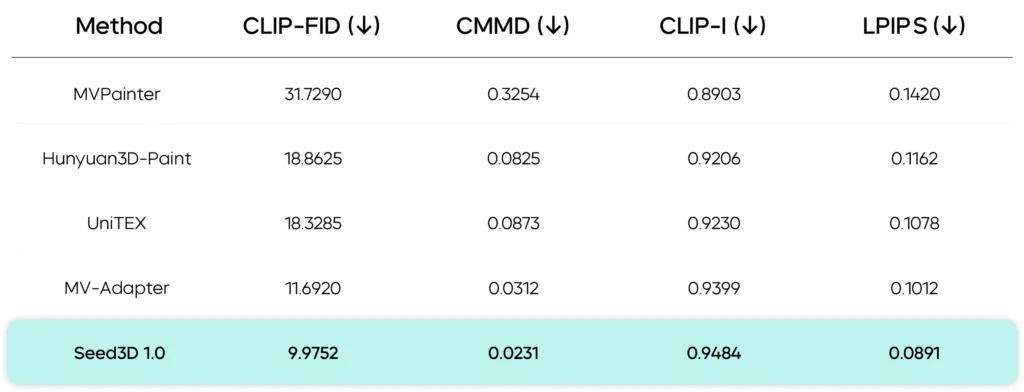

Génération de textures

Pour les estimations de texture et de matériaux, Seed3D constate des gains substantiels en termes d'alignement avec les images de référence et de réalisme des matériaux. La décomposition Seed3D-PBR et l'inpainting Seed3D-UV produisent ensemble des atlas UV qui préservent les détails de texture haute fréquence et fournissent des cartes PBR cohérentes (albédo, métallisation, rugosité) adaptées au rendu physique.

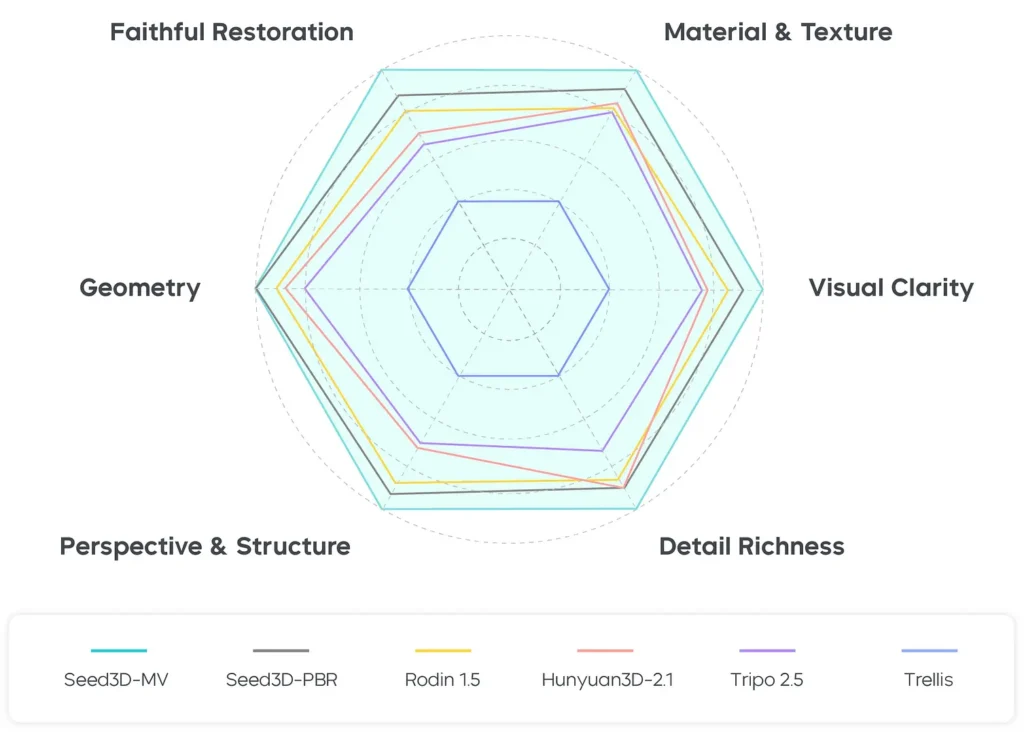

Évaluation humaine (étude utilisateur)

L'article présente une étude utilisateur menée auprès de 14 évaluateurs humains sur un ensemble de 43 images. Les évaluateurs ont comparé plusieurs méthodes sur des critères tels que la clarté visuelle, la fidélité de la restauration, la précision géométrique, la perspective et la structure, le réalisme des matériaux et des textures, et la richesse des détails. Seed3D 1.0 a systématiquement obtenu des notes subjectives plus élevées dans ces catégories, les avantages les plus marqués concernant la géométrie et la qualité des matériaux. L'étude humaine corrobore les critères quantitatifs, montrant une amélioration du réalisme perçu et de la pertinence de la simulation par rapport aux valeurs de référence.

Comment fonctionne Seed3D 1.0 (architecture et pipeline) ?

Seed3D 1.0 se présente comme un système multi-composants combinant des représentations géométriques latentes apprises, un débruitage par transformateur dans l'espace latent, ainsi que des modules de complétion multi-vues et de textures. Sa conception est volontairement modulaire, permettant ainsi l'optimisation et la mise à niveau indépendantes de chaque composant.

Composants majeurs

**Seed3D-VAE (encodeur/décodeur à géométrie latente)**Apprend une représentation latente compacte pour la géométrie 3D (par exemple, TSDF/maillage latent). Le VAE est entraîné à reconstruire une géométrie haute résolution et étanche à partir de codes latents compressés. Cela constitue un goulot d'étranglement efficace pour la phase de génération.

**Seed3D-DiT (transformateur de diffusion pour la géométrie)**Un transformateur de flux rectifié/débruitage (de type DiT) fonctionnant dans l'espace latent de la géométrie apprise. Conditionné à l'intégration d'une image de référence, il débruit de manière itérative les jetons latents en une géométrie latente que le VAE décode en un maillage explicite.

Seed3D-MV (synthèse multi-vues) et Seed3D-UV (complétion de texture):Une fois la géométrie initiale produite, le système synthétise plusieurs vues pour réduire l'ambiguïté d'occlusion, puis complète les cartes UV via un module d'amélioration de la peinture/UV pour produire des textures complètes et cohérentes.

Seed3D-PBR (décomposition matérielle): Décompose les textures générées en cartes PBR (métal, rugosité, cartes normales, etc.) afin que les réponses d'ombrage et de contact physiquement plausibles soient préservées dans la simulation.

Modèle vision-langage pour la factorisation de scènesPour la génération de scènes, le pipeline utilise des VLM pour détecter les objets, prédire les relations spatiales et produire des cartes d'agencement (position, échelle, orientation). Les objets individuels sont générés puis assemblés dans une scène selon la carte d'agencement. ()

Flux d'inférence de haut niveau

- Entrée : image RVB unique → l'encodeur d'image extrait l'intégration visuelle.

- Génération de géométrie : Seed3D-DiT conditionné à l'inclusion débruite les latents de géométrie → Seed3D-VAE décode le maillage (étanche).

- Synthèse multi-vues : générer des vues synthétiques à partir du maillage + pipeline de rendu pour la complétion de la texture.

- UV et texture : Seed3D-UV peint les occlusions et produit des cartes UV complètes → Seed3D-PBR décompose les textures en cartes de matériaux.

- Export : produire un .obj/.gltf avec des textures et des cartes de matériaux, prêt pour les moteurs physiques (maillages de collision, estimation d'échelle par VLM).

Génération de scènes

Seed3D génère non seulement des objets individuels, mais génère également automatiquement des scènes complètes.

Processus de génération :

- Entrée : une image contenant plusieurs objets ;

- Le modèle VLM identifie les objets et les relations spatiales dans l’image ;

- Seed3D génère la géométrie et la texture de chaque objet ;

- Enfin, la disposition spatiale est combinée pour former une scène 3D complète.

Quelles sont les limites et les défis ouverts ?

Seed3D 1.0 est une étape majeure, mais plusieurs limitations subsistent — à la fois intrinsèques à la génération d'images uniques et spécifiques aux contextes de simulation :

- Ambiguïté de la vue unique: déduire une géométrie occluse et une topologie exacte à partir d'une vue est fondamentalement mal posé ; les priors et les statistiques apprises aident, mais des erreurs subsistent pour les régions fortement occluses.

- Exactitude physique à l'échelle:bien que les actifs soient « prêts pour la simulation » selon de nombreuses mesures pratiques, l’estimation précise de la masse/inertie et la dynamique des articulations pour les systèmes articulés complexes nécessitent encore un réglage spécifique au domaine.

- Matériaux rares et microstructure:les matériaux hautement spéculaires, translucides ou anisotropes (par exemple, les métaux brossés, les tissus avec diffusion souterraine) sont plus difficiles à reproduire avec précision à partir d'une seule image.

- Biais des données: les sources de données de formation influencent ce que le modèle capture bien : les objets rares ou les artefacts culturellement spécifiques peuvent être mal reproduits.

- Propriété intellectuelle et éthique:comme pour tous les systèmes génératifs, les créateurs et les organisations doivent prendre en compte la propriété intellectuelle et la provenance lors de la conversion d'images protégées par le droit d'auteur en ressources 3D.

Scénario d'application

Seed3D est explicitement positionné pour IA incarnée et simulation cas d'utilisation, mais les implications s'étendent à plusieurs secteurs :

- Formation en robotique et RLGénération rapide de contenu pour les tests de manipulation, les programmes de formation et les jeux de données randomisés par domaine pour le transfert de la simulation vers le réel. La préparation physique des ressources réduit les frictions de prétraitement.

- Développement de jeux et XR: création accélérée d'actifs pour les prototypes, les accessoires d'arrière-plan ou les scènes entières ; les flux de travail PBR et les textures 4K sont particulièrement utiles pour les expériences haute fidélité.

- Production virtuelle et visualisation: génération rapide d'accessoires et d'éléments d'environnement pour la conceptualisation ou la prévisualisation.

- Pipelines de création de contenu:les concepteurs peuvent passer beaucoup plus rapidement des références 2D (photos, art) aux prototypes 3D, ce qui permet des flux de travail hybrides humain+IA où les artistes peaufinent les résultats. ()

- RechercheGénération à grande échelle de données d'entraînement 3D diversifiées pour les modèles vision-langage-action et autres recherches multimodales. L'article présente explicitement Seed3D comme un outil permettant de faire progresser la recherche sur l'intelligence incarnée et les simulateurs à l'échelle mondiale.

Seed3D peut convertir une seule photo en un objet 3D détaillé adapté à la simulation et à une utilisation interactive, ce qui élargit l'accès à la création de contenu 3D de haute qualité.

Conclusion

Seed3D 1.0 de ByteDance représente une étape importante vers génération 3D évolutive de qualité simulation À partir d'entrées 2D simples. En combinant un pipeline géométrique ciblé (VAE + DiT), une estimation robuste des textures/PBR et une complétion UV, le système produit des ressources à la fois photoréalistes et immédiatement utilisables dans les simulateurs de physique. Cette combinaison résout un obstacle persistant à la recherche en IA intégrée et à de nombreux pipelines appliqués. Les performances SOTA (géométrie et texture) du modèle et ses résultats positifs d'évaluation humaine en font un acteur de premier plan dans le paysage génératif 3D en constante évolution.

Pour commencer

CometAPI est une plateforme d'API unifiée qui regroupe plus de 500 modèles d'IA provenant de fournisseurs leaders, tels que la série GPT d'OpenAI, Gemini de Google, Claude d'Anthropic, Midjourney, Suno, etc., au sein d'une interface unique et conviviale pour les développeurs. En offrant une authentification, un formatage des requêtes et une gestion des réponses cohérents, CometAPI simplifie considérablement l'intégration des fonctionnalités d'IA dans vos applications. Que vous développiez des chatbots, des générateurs d'images, des compositeurs de musique ou des pipelines d'analyse pilotés par les données, CometAPI vous permet d'itérer plus rapidement, de maîtriser les coûts et de rester indépendant des fournisseurs, tout en exploitant les dernières avancées de l'écosystème de l'IA.

Les développeurs peuvent accéder au modèle 3D et à d'autres modèles de ByteDance tels que API Seedream 4.0 via CometAPI, la dernière version du modèle est constamment mis à jour avec le site officiel. Pour commencer, explorez les capacités du modèle dans la section cour de récréation et consultez le Guide de l'API Pour des instructions détaillées, veuillez vous connecter à CometAPI et obtenir la clé API avant d'y accéder. API Comet proposer un prix bien inférieur au prix officiel pour vous aider à vous intégrer.

Prêt à partir ?→ Inscrivez-vous à CometAPI dès aujourd'hui !

Si vous souhaitez connaître plus de conseils, de guides et d'actualités sur l'IA, suivez-nous sur VK, X et Discord!