DeepSeek a officiellement présenté V4 en avant-première comme une famille de modèles open source, et l’actualité ne se limite pas à « une mise à jour de plus ». L’entreprise positionne V4 comme un système à long contexte, adapté aux agents et conçu pour des charges de travail réelles : analyses riches en documents, assistants de codage, agents de recherche et automatisation multi-étapes. La mise à disposition est effective sur le web, l’app et l’API, et la gamme V4 introduit une fenêtre de contexte de 1M de tokens, économique, sur ses services officiels.

Ce qui rend ce lancement particulièrement notable, c’est la combinaison de l’échelle et de l’efficacité. DeepSeek indique que V4-Pro compte 1,6T de paramètres totaux dont 49B actifs, tandis que V4-Flash compte 284B de paramètres totaux dont 13B actifs. Dans le rapport technique, DeepSeek affirme également que l’architecture V4 utilise une attention hybride, un routage MoE et un post-apprentissage conçus pour améliorer le comportement agentique tout en réduisant la charge de calcul liée à l’ultra-long contexte.

Qu’est-ce que DeepSeek V4 ?

DeepSeek-V4 est la toute dernière famille phare en aperçu de l’entreprise, et la version comprend deux variantes publiques : V4-Pro et V4-Flash. DeepSeek décrit V4-Pro comme le modèle plus performant pour les connaissances du monde, les maths, les STEM, le codage et le codage agentique, tandis que V4-Flash est l’option plus réactive et économique qui conserve une grande partie de la qualité de raisonnement et de la capacité de long contexte. V4-Pro devance les modèles ouverts actuels en codage agentique et en connaissances du monde, tandis que V4-Flash est conçu pour la vitesse et un déploiement économique.

V4 utilise une architecture d’attention hybride combinant Compressed Sparse Attention (CSA) et Heavily Compressed Attention (HCA), ainsi que des Manifold-Constrained Hyper-Connections et l’optimiseur Muon. L’entreprise indique également que les modèles ont été pré-entraînés sur plus de 32T de tokens et qu’avec un contexte à 1M, V4-Pro ne nécessite que 27 % des FLOPs d’inférence par token et 10 % du cache KV par rapport à DeepSeek-V3.2. Cette efficacité constitue le véritable message derrière la sortie.

DeepSeek-V4-Pro vs DeepSeek-V4-Flash

DeepSeek-V4-Pro

V4-Pro est le modèle phare pour les utilisateurs qui privilégient la qualité. DeepSeek-V4-Pro offre de meilleures performances en codage agentique, des connaissances du monde plus riches et un raisonnement de classe mondiale, et il devance les modèles ouverts actuels tout en n’étant dépassé que par Gemini-3.1-Pro en connaissances du monde selon la page de lancement. Dans le rapport technique, V4-Pro est le modèle le plus grand de la famille, et DeepSeek-V4-Pro est disponible via les mêmes interfaces compatibles OpenAI et compatibles Anthropic que V4-Flash.

DeepSeek-V4-Flash

V4-Flash est le modèle axé sur l’efficacité ; ses capacités de raisonnement se rapprochent étroitement de V4-Pro, et il se comporte à l’égal de V4-Pro sur des tâches d’agent simples, tout en utilisant une empreinte de paramètres plus petite et des temps de réponse plus rapides. Il prend en charge à la fois les modes avec réflexion et sans réflexion, avec la même longueur de contexte 1M et les mêmes fonctionnalités principales que Pro, mais à un coût bien inférieur.

Lequel choisir ?

Utilisez V4-Pro lorsque la tâche est critique, riche en connaissances ou difficile à vérifier : recherche en entreprise, codage complexe, soutien à la décision multi-étapes, ou tâches où vous souhaitez la réponse la plus solide possible. Utilisez V4-Flash lorsque le débit, la latence ou le coût des tokens comptent davantage que de grappiller les derniers points de performance sur les benchmarks. Ce choix est cohérent avec le positionnement officiel et avec les écarts de performances rapportés entre les deux modèles.

| Item | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| Total parameters | 284B | 1.6T |

| Active parameters | 13B | 49B |

| Context length | 1M | 1M |

| Reasoning modes | Sans réflexion + réflexion | Sans réflexion + réflexion |

| Best fit | Inférence rapide, apps à haut débit, agents sensibles au coût | Raisonnement au plus haut niveau, tâches de codage et de savoir plus difficiles |

| Official API pricing | Hit de cache $0.028 / Miss de cache $0.14 / Sortie $0.28 par 1M tokens | Hit de cache $0.145 / Miss de cache $1.74 / Sortie $3.48 par 1M tokens |

| Max output | 384K | 384K |

CometAPI donne accès à Deepseek v4 Pro et V4 Flash, —20 % moins cher que l’officiel—, plus une commutation transparente entre 500+ modèles (GPT-5.4, Gemini 3.1, etc.) via un unique endpoint compatible OpenAI ou Anthropic Messages.

Benchmarks de performances

DeepSeek-V3.2 vs V4-Flash vs V4-Pro

Dans le tableau de comparaison des modèles de base, V4-Flash et V4-Pro surpassent tous deux DeepSeek-V3.2 sur les benchmarks principaux, V4-Pro prenant généralement la tête. Par exemple, le rapport liste les scores suivants : AGIEval 82.6 / 83.1 vs 80.1 pour V3.2 ; MMLU 88.7 / 90.1 vs 87.8 ; MMLU-Pro 68.3 / 73.5 vs 65.5 ; HumanEval 69.5 / 76.8 vs 62.8 ; et LongBench-V2 44.7 / 51.5 vs 40.2 pour V3.2, où le nombre du milieu correspond à V4-Flash et le dernier à V4-Pro.

| Benchmark | DeepSeek-V3.2-Base | DeepSeek-V4-Flash-Base | DeepSeek-V4-Pro-Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU-Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench-V2 (EM) | 40.2 | 44.7 | 51.5 |

Source : rapport technique DeepSeek-V4, Table 1.

Le schéma est simple : Flash réduit l’écart avec Pro, mais Pro reste le modèle général le plus fort. Cela fait de V4-Flash le choix par défaut pratique pour de nombreux systèmes de production, tandis que V4-Pro est le modèle à privilégier lorsque la qualité de réponse importe plus que le coût ou la latence.

Comparaisons avec les modèles occidentaux : où se situe V4

Dans une évaluation humaine sur des tâches de bureau en chinois, le rapport indique que DeepSeek-V4-Pro-Max a surpassé Claude Opus 4.6-Max, avec un taux de non-perte de 63 %. DeepSeek-V4-Pro « surpasse significativement » Claude Sonnet 4.5 et se rapproche de Claude Opus 4.5 sur un benchmark de codage R&D.

| Domaine d’évaluation | Résultat DeepSeek | Comparaison avec modèles occidentaux | Ce que cela suggère |

|---|---|---|---|

| Tâches de bureau en chinois | V4-Pro-Max, taux de non-perte 63 % | vs Claude Opus 4.6-Max | Solides performances sur des tâches professionnelles pratiques |

| Benchmark de codage R&D | V4-Pro-Max taux de réussite 67 | vs Claude Sonnet 4.5 à 47 ; Opus 4.5 à 70 ; Opus 4.6 Thinking à 80 | Compétitif face aux modèles de pointe, surtout par rapport aux systèmes de la gamme Sonnet |

Ce n’est pas « numéro un en tout », mais c’est déjà à un niveau qui « doit être sérieusement évalué ».

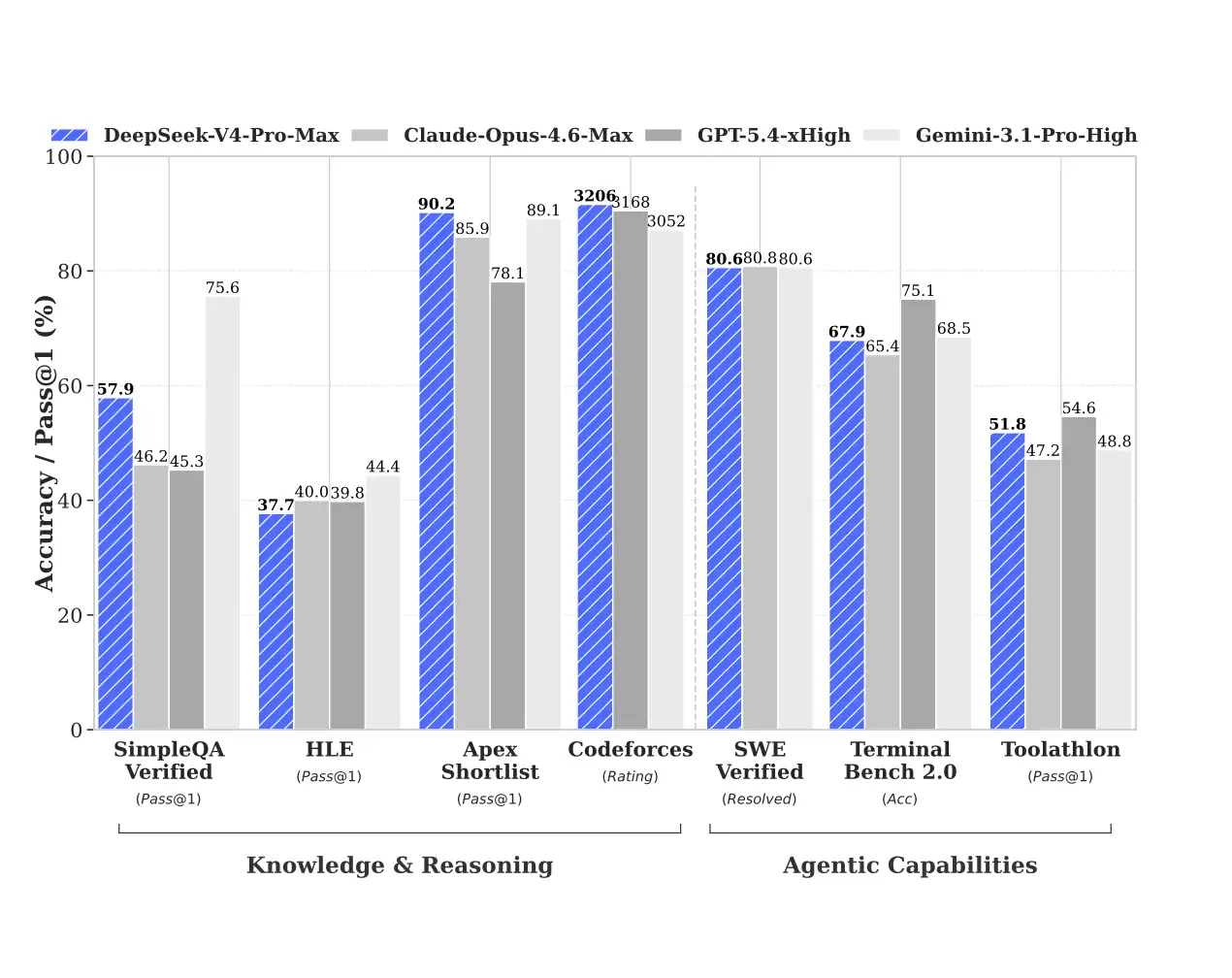

Le rapport technique de DeepSeek compare V4-Pro-Max à Claude Opus 4.6 Max, GPT-5.4 xHigh et Gemini 3.1 Pro High dans le même tableau. Les résultats ne sont pas simplistes : les modèles occidentaux fermés restent très performants sur certains aspects de connaissances et d’inférence ; cependant, V4-Pro-Max est très solide en code, longs contextes et certaines tâches d’agent. Autrement dit, on n’en est plus à un récit unidimensionnel de « alternatives domestiques », mais à la question de « ce qui convient le mieux à votre scénario ».

En termes de connaissances et de capacités de raisonnement, il est au niveau de Opus 4.6 Max, GPT-5.4 xHigh et Gemini 3.1 Pro High. Toutefois, il est légèrement en retrait en capacités agentiques, sans que l’écart soit majeur.

DeepSeek-V4-Pro-Max est très compétitif dans les scénarios orientés code et à long contexte, tandis que les modèles occidentaux restent extrêmement forts sur plusieurs benchmarks de raisonnement pur et de connaissances. C’est la bonne façon de lire cette sortie : DeepSeek V4 s’inscrit clairement dans la conversation de pointe, mais le leadership sur les benchmarks dépend toujours des tâches.

Comment accéder à DeepSeek V4

1) Utiliser le site et l’application officiels

DeepSeek indique que V4 Preview est disponible dès maintenant sur web, app et API. Pour les utilisateurs classiques, le moyen le plus simple reste l’interface de chat officielle, où le modèle est accessible via Expert Mode ou Instant Mode.

2) Utiliser l’API

Je recommande vivement CometAPI pour accéder à Deepseek V4, car il offre les meilleurs prix et des avantages d’agrégation.

Les noms de modèle sont :

deepseek-v4-flashdeepseek-v4-pro

DeepSeek indique également que les anciens noms

deepseek-chatetdeepseek-reasonerseront dépréciés et correspondent actuellement aux modes sans réflexion et avec réflexion de V4-Flash jusqu’au 2026-07-24. C’est important pour la planification de migration si vous avez déjà des intégrations plus anciennes en production.

- Inscrivez-vous sur CometAPI et récupérez votre clé API.

- Utilisez le SDK Python OpenAI standard (ou tout client compatible) avec une base URL personnalisée :

Voici un exemple propre utilisant le format officiel compatible OpenAI :

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "Vous êtes un assistant utile."},

{"role": "user", "content": "Résumez les avantages d’un contexte à un million de tokens."}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

Ce schéma de requête suit le guide de démarrage rapide : définissez la base URL, choisissez deepseek-v4-pro ou deepseek-v4-flash, et activez la réflexion lorsque vous avez besoin d’un raisonnement plus poussé.

Comment utiliser efficacement DeepSeek V4

Pour les workflows de longs documents, le meilleur schéma consiste à garder le contexte propre et structuré. La fenêtre de 1M de tokens est un avantage majeur, mais le modèle fonctionne toujours mieux lorsque l’entrée est organisée en sections, extraits sources, instructions de tâche et contraintes de sortie explicites. C’est la manière la plus naturelle d’exploiter la capacité de long contexte mise en avant par DeepSeek.

Pour les workflows de code et d’agents, commencez avec V4-Flash pour itérer rapidement, puis passez à V4-Pro pour l’exécution finale ou les étapes les plus difficiles. Cette approche correspond au positionnement officiel : Flash est l’option efficace, Pro est le modèle le plus fort, et les deux partagent la même surface d’API et la même longueur de contexte.

Mot de la fin

DeepSeek-V4 est notable parce qu’il combine simultanément quatre éléments recherchés par le marché : long contexte, fort raisonnement, disponibilité ouverte et tarification agressive. L’essentiel n’est pas seulement que DeepSeek a publié un autre modèle, mais que l’entreprise cherche à rendre l’IA de pointe économiquement utilisable en production. Pour les équipes qui évaluent leur prochain pari en IA, c’est un signal à tester, pas à ignorer.

Pour les équipes qui construisent sur plusieurs fournisseurs, c’est exactement le type de sortie qui mérite d’être benchmarkée dans votre propre pile. CometAPI peut être la couche pratique pour comparer DeepSeek-V4 aux autres modèles de pointe sans obliger votre équipe produit à reconstruire l’intégration à chaque évolution du marché.