Fin août 2025, Google (DeepMind) a publié Image Flash Gemini 2.5 — largement surnommé « nano-banane » — un modèle de génération et d'édition d'images à faible latence et de haute qualité, intégré à l'application Gemini, à Google AI Studio, à l'API Gemini et à CometAPI. Il est conçu pour produire des images photoréalistes, préserver la cohérence des caractères entre les modifications, fusionner plusieurs images d'entrée et effectuer des modifications précises et localisées grâce à des invites en langage naturel. Le modèle est disponible en préversion et en version préliminaire et figure déjà en tête des classements d'images (LMArena) tout en étant livré avec des mécanismes de sécurité (filigrane SynthID et filtres au niveau du produit).

Qu'est-ce que Gemini 2.5 Flash Image (alias « Nano Banana ») ?

Image Flash Gemini 2.5 — surnommée de manière ludique Nano Banane — est le dernier modèle de génération et d'édition d'images de Google DeepMind au sein de la famille Gemini. Annoncé fin août 2025, ce modèle se présente comme une version préliminaire qui intègre des modifications plus fidèles, la fusion multi-images, une meilleure cohérence des personnages (permettant de reconnaître la même personne, le même animal ou le même objet lors de plusieurs modifications) et une génération d'images à faible latence à l'ensemble des outils multimodaux de Gemini. Il est disponible via l'API Gemini, Google AI Studio, les applications mobiles/web Gemini et Vertex AI pour les entreprises.

Origine et dénomination

Le surnom « nano banana » est devenu viral sur les réseaux sociaux et les classements communautaires après que les premiers testeurs et participants de LMArena ont utilisé un nom fruité. Google a confirmé le lien et a adopté publiquement ce nom ludique dans ses publications de développement et de produit. Le nom officiel du produit est : Image Flash Gemini 2.5 et vous verrez généralement l'identifiant du modèle utilisé dans le code et les appels d'API (pour une utilisation en aperçu, il apparaît par exemple comme gemini-2.5-flash-image-preview).

Quelles sont les principales fonctionnalités de Gemini 2.5 Flash Image ?

Que signifie réellement « cohérence des caractères » ?

L’une des fonctionnalités phares est cohérence des caractèresVous pouvez demander au modèle de réutiliser le même sujet (personne, animal, mascotte ou produit) dans plusieurs montages ou nouvelles scènes, tout en préservant les caractéristiques visuelles distinctives (visage/forme, palette de couleurs, signes distinctifs). Cela corrige une faiblesse courante des modèles d'image antérieurs : les modifications ultérieures produisaient des personnes/objets visuellement plausibles, mais sensiblement différents. Les développeurs peuvent ainsi créer des workflows pour les catalogues de produits, la narration épisodique ou la génération d'éléments de marque avec moins de corrections manuelles.

Quels autres contrôles d’édition sont inclus ?

L'image Flash Gemini 2.5 prend en charge :

- Modifications locales ciblées via des invites en langage clair (supprimer un objet, changer de tenue, retoucher la peau, supprimer un élément d'arrière-plan).

- Fusion multi-images: combiner jusqu'à trois images d'entrée en une seule composition cohérente (par exemple, placer un produit de l'image A dans la scène B tout en préservant l'éclairage).

- Contrôles de style et de format: instructions photoréalistes, attributs de l'appareil photo et de l'objectif, rapport hauteur/largeur et sorties stylisées (illustration, autocollant, etc.).

- Connaissances du monde autochtone: le modèle exploite les connaissances plus larges de la famille Gemini pour effectuer des modifications sémantiquement conscientes (par exemple, comprendre ce qu'impliquent « l'éclairage de la Renaissance » ou « le passage piéton de Tokyo »).

Qu'en est-il de la vitesse, du coût et de la disponibilité ?

L'image Flash Gemini 2.5 fait partie de la gamme Flash de Gemini 2.5. Elle est optimisée pour une faible latence et un coût réduit, tout en conservant une qualité élevée. Google a présenté en avant-première les tarifs des jetons de sortie d'image et en a annoncé la disponibilité via l'API et AI Studio ; les entreprises peuvent y accéder via Vertex AI. Lors de l'annonce, le tarif publié pour l'image Flash Gemini 2.5 était le suivant : 30 $ par 1 million de jetons de sortie, avec un exemple de coût par image indiqué comme 1290 jetons de sortie ≈ $0.039 par image.

Comment fonctionne Gemini 2.5 Flash Image sous le capot ?

Architecture et approche de formation

Gemini 2.5 Flash Image hérite de l'architecture de la famille Gemini 2.5 : une architecture de type « mélange d'experts » (MoE) clairsemée avec un apprentissage multimodal combinant texte, image, audio et autres données. Google a entraîné Flash Image sur de très grands corpus multimodaux filtrés et affiné le modèle pour les tâches d'image (génération, édition, fusion) et le comportement de sécurité. L'apprentissage a été exécuté sur la structure TPU de Google et évalué à l'aide de mesures automatiques et de jugement humain.

Édition axée sur la conversation

À un niveau élevé, le modèle utilise le conditionnement contextuel : lorsque vous fournissez une ou plusieurs images accompagnées d'invites textuelles, le modèle encode l'identité visuelle du sujet dans sa représentation interne. Lors des modifications ultérieures ou de la création de nouvelles scènes, il conditionne la génération sur cette représentation afin de préserver les attributs visuels souhaités (géométrie du visage, identifiants clés des vêtements ou des produits, palettes de couleurs). Concrètement, cela est implémenté dans le pipeline de contenu multimodal exposé par l'API Gemini : vous envoyez les images de référence avec les instructions de modification et le modèle renvoie les images modifiées (ou plusieurs images candidates) en une seule réponse.

Filigrane et provenance

Google intègre des filtres de sécurité et de politique de contenu à l'image Flash Gemini 2.5. Cette version met l'accent sur l'évaluation et le red-teaming, les étapes de filtrage automatisées, le réglage fin supervisé et l'apprentissage par renforcement pour le suivi des instructions, tout en minimisant les sorties nuisibles. Les sorties incluent un filigrane SynthID invisible permettant d'identifier ultérieurement les images produites ou modifiées par le modèle comme générées par l'IA.

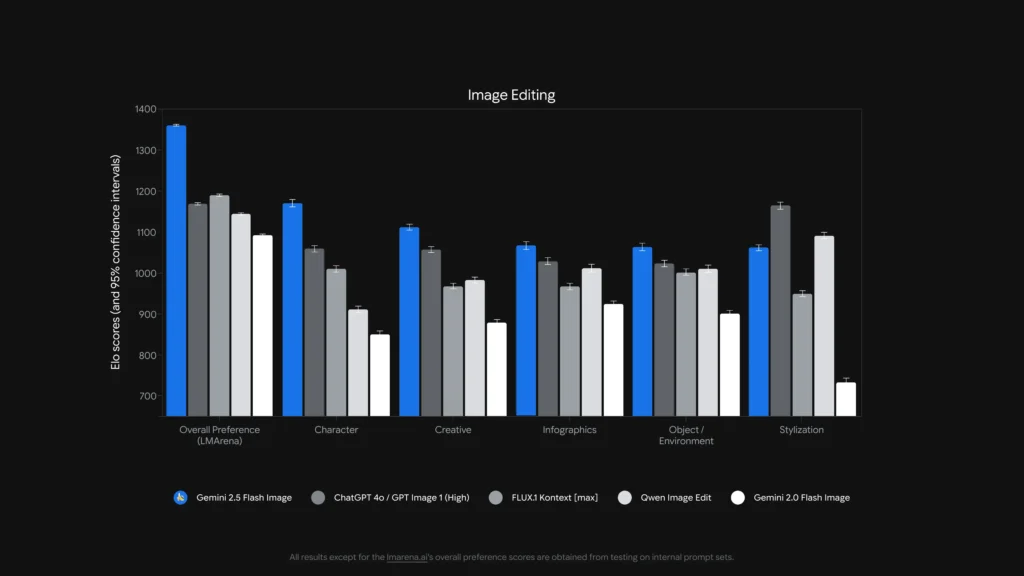

Quelles sont ses performances ? (Données de référence)

Image Flash Gemini 2.5 (commercialisée sous le nom de « nano-banane » dans certains contextes d'analyse comparative) atteinte #1 dans les classements Image Edit et Text-to-Image de LMArena Fin août 2025, avec de larges avances en termes d'ELO et de préférence par rapport aux concurrents dans les comparaisons rapportées. Je cite les résultats d'évaluation humaine de LMArena et GenAI-Bench, qui montrent les meilleurs scores de préférence pour les tâches de conversion de texte en image et d'édition d'images.

Comparaison texte-image

| Benchmark de capacité | Image Gemini Flash 2.5 | Imagen 4 Ultra 06-06 | ChatGPT 4o / Image GPT 1 (haute) | FLUX.1 Contexte | Image Gemini Flash 2.0 |

|---|---|---|---|---|---|

| Préférence globale (LMArena) | 1147 | 1135 | 1129 | 1075 | 988 |

| Qualité visuelle (GenAI-Bench) | 1103 | 1094 | 1013 | 864 | 926 |

| Alignement texte-image (GenAI-Bench) | 1042 | 1053 | 1046 | 937 | 922 |

Édition d'image

| Benchmark de capacité | Image Gemini Flash 2.5 | ChatGPT 4o / Image GPT 1 (haute) | FLUX.1 Contexte | Édition d'image Qwen | Image Gemini Flash 2.0 |

|---|---|---|---|---|---|

| Préférence globale (LMArena) | 1362 | 1170 | 1191 | 1145 | 1093 |

| Personnage | 1170 | 1059 | 1010 | 911 | 850 |

| Conception | 1112 | 1057 | 968 | 983 | 879 |

| Infographies | 1067 | 1029 | 967 | 1012 | 925 |

| Objet / Environnement | 1064 | 1023 | 1002 | 1010 | 901 |

| Recontextualisation du produit | 1128 | 1032 | 943 | 1009 | 888 |

| Stylisation | 1062 | 1165 | 949 | 1091 | 733 |

Que signifient ces repères dans la pratique ?

Les benchmarks nous disent deux choses : (1) le modèle est compétitif en termes de génération photoréaliste et (2) il se démarque édition Tâches où la cohérence des caractères et le respect des consignes sont importants. Les classements de préférences humaines indiquent que les utilisateurs ayant consulté les résultats de Gemini ont attribué une note élevée au réalisme et à l'alignement avec les instructions dans de nombreuses consignes évaluées. Cependant, les limites connues (risque d'hallucination sur des détails factuels précis, rendu de texte long dans les images, cas limites de transfert de style) sont explicites ; les benchmarks sont donc une indication, et non une garantie.

Que pouvez-vous faire avec Gemini 2.5 Flash Image (cas d'utilisation) ?

Gemini 2.5 Flash Image est spécifiquement conçu pour les applications de création, de productivité et d'imagerie appliquée. Voici quelques exemples d'utilisations courantes et émergentes :

Maquettes de produits rapides et commerce électronique

Glissez des photos de produits dans des scènes, générez des images de catalogue cohérentes dans tous les environnements ou changez de couleurs/tissus pour une gamme de produits, tout en préservant l'identité du produit. Les fonctionnalités de fusion multi-images et la cohérence des caractères et des produits rendent cette solution attrayante pour les workflows de catalogue.

Retouche photo et modifications ciblées

Supprimez des objets, corrigez des imperfections, changez de vêtements/accessoires ou ajustez l'éclairage grâce à des instructions en langage naturel. La fonction d'édition localisée permet aux non-experts d'effectuer des retouches professionnelles à l'aide de commandes conversationnelles.

Storyboarding et narration visuelle

Placez le même personnage dans différentes scènes et conservez une apparence cohérente (utile pour les bandes dessinées, les storyboards ou les pitch decks). Les modifications itératives permettent aux créateurs d'affiner l'ambiance, le cadrage et la continuité narrative sans recréer les éléments de A à Z.

Éducation, diagrammes et prototypage de conception

Grâce à sa capacité à combiner des invites textuelles et des images, et à sa connaissance du monde, ce modèle permet de générer des diagrammes annotés, des visuels pédagogiques ou des maquettes rapides pour des présentations. Google propose même des modèles dans AI Studio pour des cas d'utilisation tels que les maquettes immobilières et la conception de produits.

Comment utiliser l'API Nano Banana ?

Vous trouverez ci-dessous des extraits pratiques adaptés de Documentation de l'API CometAPI et la documentation de l'API de Google. Ils illustrent les flux courants : texte à image et image + texte en image (édition) en utilisant le SDK officiel GenAI ou le point de terminaison REST.

Remarque : dans la documentation de CometAPI, le nom du modèle d'aperçu apparaît comme suit :

gemini-2.5-flash-image-previewLes exemples ci-dessous font écho aux exemples officiels du SDK (Python et JavaScript) et à un exemple REST curl ; adaptez les clés et les chemins de fichiers à votre environnement.

Exemple de boucle REST de CometAPI

Utilisez le service officiel de Gemini generateContent Point de terminaison pour la génération de texte en image. Placez l'invite de texte dans contents.parts[].text.Exemple (shell Windows, en utilisant ^ pour la continuation de la ligne) :

curl --location --request POST "https://api.cometapi.com/v1beta/models/gemini-2.5-flash-image-preview:generateContent" ^

--header "Authorization: sk-xxxx" ^

--header "User-Agent: Apifox/1.0.0 (https://apifox.com)" ^

--header "Content-Type: application/json" ^

--header "Accept: */*" ^

--header "Host: api.cometapi.com" ^

--header "Connection: keep-alive" ^

--data-raw "{ "contents": [{

"parts": [

{"text": "A photorealistic macro shot of a nano-banana on a silver fork, shallow depth of field"}

]

}]

}'}"

| grep -o '"data": "*"' \

| cut -d'"' -f4 \

| base64 --decode > gemini-generated.png

La réponse contient des octets d'image base64 ; le pipeline ci-dessus extrait les "data" chaîne et la décode en gemini-generated.png.

Ce point de terminaison prend en charge la génération « image à image » : téléchargez une image d'entrée (au format Base64) et recevez une nouvelle image modifiée (également au format Base64).Exemple :

curl --location --request POST "https://api.cometapi.com/v1beta/models/gemini-2.5-flash-image-preview:generateContent" ^

--header "Authorization: sk-xxxx" ^

--header "User-Agent: Apifox/1.0.0 (https://apifox.com)" ^

--header "Content-Type: application/json" ^

--header "Accept: */*" ^

--header "Host: api.cometapi.com" ^

--header "Connection: keep-alive" ^

--data-raw "{ \"contents\": } ], \"generationConfig\": { \"responseModalities\": }}"

**Description :**Tout d’abord, convertissez votre fichier image source en une chaîne Base64 et placez-le dans inline_data.data. N'incluez pas de préfixes tels que data:image/jpeg;base64,.La sortie est également située dans candidates.content.parts et comprend : une partie texte facultative (description ou invite). La partie image comme inline_data (OÙ data est le Base64 de l'image de sortie). Pour plusieurs images, vous pouvez les ajouter directement, par exemple :

{

"inline_data": {

"mime_type": "image/jpeg",

"data": "iVBORw0KGgo...",

"data": "iVBORw0KGgo..."

}

}

Vous trouverez ci-dessous des exemples de développement adaptés de la documentation officielle et du blog de Google. Remplacez les identifiants et les chemins d'accès aux fichiers par les vôtres.

Python (style SDK officiel)

from google import genai

from PIL import Image

from io import BytesIO

client = genai.Client()

prompt = "Create a picture of a nano banana dish in a fancy restaurant with a Gemini theme"

# Text-to-Image

response = client.models.generate_content(

model="gemini-2.5-flash-image-preview",

contents=,

)

for part in response.candidates.content.parts:

if part.text is not None:

print(part.text)

elif part.inline_data is not None:

image = Image.open(BytesIO(part.inline_data.data))

image.save("generated_image.png")

Il s'agit de l'extrait Python canonique de la documentation Google (ID du modèle d'aperçu affiché). Le même modèle d'appel SDK prend en charge l'édition d'images et d'invites (transmettre une image comme l'une des options). contents).Plus de détails se référer à docteur Gémeaux

Conclusion

Si votre produit nécessite une génération d'images robuste et à faible latence et, surtout, édition fiable avec cohérence du sujetGemini 2.5 Flash Image est désormais une option de production à évaluer : elle allie une qualité d'image de pointe à des API conçues pour l'intégration des développeurs (AI Studio, Gemini API et Vertex AI). Évaluez attentivement les limites actuelles du modèle (texte fin dans les images, certains cas limites de stylisation) et mettez en œuvre des mesures de protection pour une utilisation responsable.

Pour commencer

CometAPI est une plateforme d'API unifiée qui regroupe plus de 500 modèles d'IA provenant de fournisseurs leaders, tels que la série GPT d'OpenAI, Gemini de Google, Claude d'Anthropic, Midjourney, Suno, etc., au sein d'une interface unique et conviviale pour les développeurs. En offrant une authentification, un formatage des requêtes et une gestion des réponses cohérents, CometAPI simplifie considérablement l'intégration des fonctionnalités d'IA dans vos applications. Que vous développiez des chatbots, des générateurs d'images, des compositeurs de musique ou des pipelines d'analyse pilotés par les données, CometAPI vous permet d'itérer plus rapidement, de maîtriser les coûts et de rester indépendant des fournisseurs, tout en exploitant les dernières avancées de l'écosystème de l'IA.

Les développeurs peuvent accéder Image Flash Gemini 2.5(Liste des API Nano Banana Comet gemini-2.5-flash-image-preview/gemini-2.5-flash-image (entrées de style dans leur catalogue.) via CometAPI, les dernières versions des modèles répertoriées sont celles à la date de publication de l'article. Pour commencer, explorez les fonctionnalités du modèle dans la section cour de récréation et consultez le Guide de l'API Pour des instructions détaillées, veuillez vous connecter à CometAPI et obtenir la clé API avant d'y accéder. API Comet proposer un prix bien inférieur au prix officiel pour vous aider à vous intégrer.