Le Gemini 3.1 Pro est désormais disponible sur CometAPI, et vous pouvez commencer à l’utiliser via les services de CometAPI — à un prix de lancement plus abordable que le prix officiel. CometAPI met déjà à disposition la famille Gemini 3 et fournit une voie compatible OpenAI pour appeler ces modèles depuis une passerelle unifiée ; cela permet d’expérimenter rapidement les modèles Gemini avec les SDK OpenAI existants

Qu’est-ce que Gemini 3.1 Pro ? (Pourquoi est-ce important ?)

Gemini 3.1 Pro désigne une révision ponctuelle / itération en aperçu au sein de la famille Gemini-3 — la même famille de modèles phare de Google qui alimente Gemini 3 Pro et les variantes « Flash ». Les versions Gemini 3.x se concentrent sur un raisonnement multimodal plus profond (texte + images + vidéo), des fenêtres de contexte/tokens plus élevées, une génération de code améliorée (« vibe coding » et workflows d’agents) et des améliorations incrémentales de performance/efficacité par rapport à la sortie initiale de Gemini 3 Pro. La famille Gemini 3 est désormais largement disponible via les API et les offres cloud de Google.

Principaux points techniques (ce que le modèle apporte)

- Entrées multimodales : texte + images + (dans certaines variantes) vidéo/audio.

- Fenêtres de contexte très longues (interactions à l’échelle des documents et du code jusqu’à ~1M tokens dans les variantes prises en charge).

- Outils pour agents et améliorations de codage — conçus pour des agents autonomes, des intégrations IDE et des tâches de code complexes.

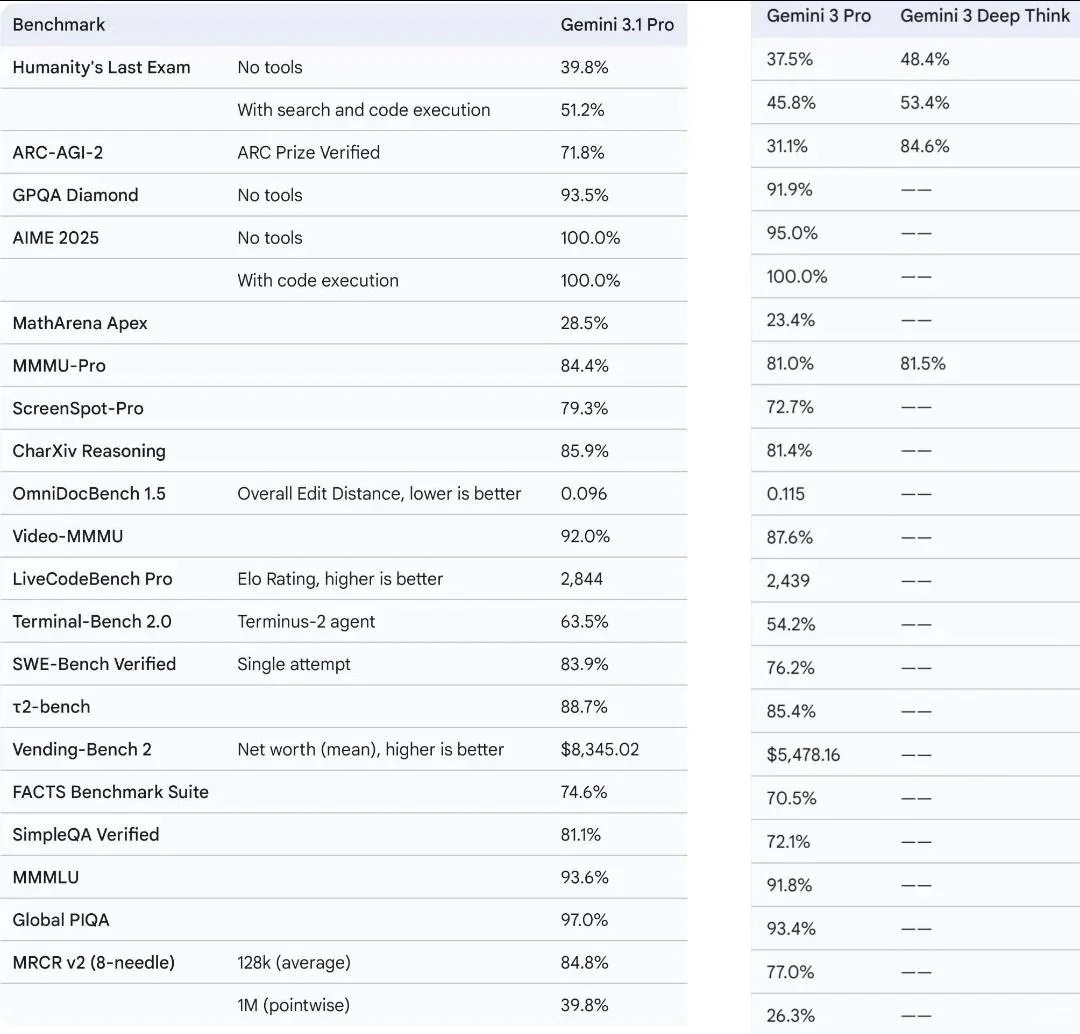

Benchmark de Gemini 3.1 Pro

Les résultats de benchmark pour Gemini 3.1 Pro sont les suivants : AIME 2025 : 100% (y compris exécution de code) ; SWE-Bench Verified : 83.9% ; ARC-AGI-2 : 71.8% ; LiveCodeBench Pro : 2844 ; Elo Terminal-Bench 2.0 : 63.5% ; MMMLU : 93.6%. Pour référence, Gemini 3 Pro a obtenu 76.2% sur SWE-Bench. C’est un bond en avant majeur. 84% sur SWE, c’est énorme.

Comparé à Gemini 3.0 pro :

Sur les 23 benchmarks fournis, Gemini 3.1 Pro affiche une amélioration moyenne d’environ 17.5%.

Cependant, comme l’illustrent les captures d’écran, les véritables « différences » se situent dans les domaines suivants:

Les améliorations les plus significatives ne portent pas sur la « collecte de faits », mais sur le raisonnement complexe et la fiabilité dans les longs contextes : ARC-AGI-2 (+130.9%) : c’est l’amélioration la plus importante. ARC mesure la capacité du modèle à apprendre de nouvelles compétences (intelligence fluide) à la volée, plutôt que de s’appuyer sur des données d’entraînement. L’augmentation de 31.1% à 71.8% indique un changement architectural majeur dans la façon dont le modèle « pense ».

Vending-Bench 2 (+52.3%) : Ce benchmark suit la « valeur nette » d’un agent dans son environnement. Le saut observé montre que la version 3.1 surpasse significativement les autres versions en matière de planification, d’exécution de tâches multi-étapes et de gestion efficace des « outils ».

Contexte long (MRCR v2 1 million points) : Alors que le contexte standard (128,000 tokens) offre une amélioration de performances de 10%, le bond allant jusqu’à 51.3% à 1 million de tokens montre que la version 3.1 est plus stable et précise lorsqu’elle traite des volumes massifs de données.

CometAPI propose-t-elle Gemini 3 / 3 Pro / 3.1 ?

Oui — CometAPI liste publiquement la famille Gemini 3 (les entrées Gemini 3.1 Pro et les chaînes de modèles associées) dans son catalogue de modèles et ses supports marketing, et présente une voie d’intégration compatible OpenAI (clé API unique + base_url) pour appeler les modèles. CometAPI fournit des exemples qui utilisent un client OpenAI pointé vers https://api.cometapi.com/v1 et des noms de modèles dans le champ model. Cela signifie que vous pouvez souvent appeler les modèles de la famille Google Gemini via CometAPI avec un code client de type OpenAI familier. Gemini 3.1 pro est désormais proposé via la place de marché unifiée et le bac à sable de CometAPI.

Étape par étape : liste de contrôle rapide pour démarrer

- Créez un compte CometAPI et obtenez une clé API (CometAPI propose souvent une clé gratuite / une période d’essai).

- Depuis la console de CometAPI ou le catalogue de modèles, confirmez le nom exact du modèle (gemini-3.1-pro-preview).

- Utilisez le point de terminaison compatible OpenAI de CometAPI (

base_url) et définissez le paramètremodelsur l’alias de modèle du catalogue. - Commencez par des prompts de test, vérifiez la latence/le coût, puis faites monter en charge avec des limites de taux et des contrôles d’ingénierie (timeouts, logique de retry, streaming, etc.).

Avant d’accéder, veuillez vous assurer que vous êtes connecté à CometAPI et que vous avez obtenu la clé API. CometAPI offre un prix bien inférieur au prix officiel pour vous aider à intégrer.

Prêt à démarrer ? → Inscrivez-vous à Gemini 3.1 pro dès aujourd’hui !

Si vous souhaitez davantage de conseils, de guides et d’actualités sur l’IA, suivez-nous sur VK, X et Discord !