La famille Gemini 3 de Google fin 2025 comprend désormais deux modèles aux positionnements distincts pour les développeurs et les utilisateurs avancés : Gemini 3 Flash — optimisé pour le débit brut, la faible latence et l’efficacité coût — et Gemini 3 Pro — optimisé pour le raisonnement multimodal le plus profond, les plus grandes fenêtres de contexte et les plafonds de benchmarks les plus élevés. Concrètement, Flash est conçu pour repousser la frontière du « flux productif » pour les applications à haute fréquence et interactives ; Pro est conçu pour maximiser l’intelligence par requête unique et gérer des entrées multimodales très larges ou complexes. Les compromis sont simples et mesurables : Flash offre une latence nettement plus faible et des coûts par token sensiblement plus bas tout en conservant une grande partie des capacités de raisonnement de Gemini 3 ; Pro offre les meilleurs scores de benchmarks, les modes les plus avancés (par ex., Deep Think) et des capacités plus larges avec garde-fous de sécurité, au prix d’une latence et d’un coût plus élevés.

Qu’est-ce que Gemini 3 Flash ?

(Et quels problèmes est-il conçu pour résoudre ?)

Gemini 3 Flash est le nouveau membre « speed-first » de la famille Gemini 3 de Google. Annoncé et déployé à la mi-décembre 2025, Flash est explicitement optimisé pour la faible latence, l’efficacité en tokens et une large accessibilité : il est devenu le modèle par défaut dans l’application Gemini et l’AI Mode dans Google Search, et il est accessible aux développeurs via la Gemini API, Google AI Studio, Vertex AI et la Gemini CLI. Les objectifs de conception affichés sont d’apporter un « raisonnement de niveau Pro » à la vitesse de Flash et à un prix sensiblement plus bas afin que les cas d’usage à haute fréquence et interactifs (assistants de codage, applications multimodales en temps réel, AI Mode de la recherche, interactions CLI en direct) puissent fonctionner à l’échelle.

Forces clés de Flash

- Latence et débit : conçu pour des temps de réponse courts et des taux de requêtes élevés (Google le présente comme le modèle le plus rapide de la famille Gemini 3).

- Efficience en tokens : Google affirme que Flash utilise moins de tokens pour des tâches équivalentes par rapport aux générations Flash/Pro précédentes, réduisant le coût par requête.

- Capacités multimodales et agentiques : bien que « léger », Flash conserve le raisonnement multimodal de Gemini 3 (texte, image, audio, vidéo) et prend en charge des capacités agentiques d’appel d’outils.

Qu’est-ce que Gemini 3 Pro ?

Gemini 3 Pro est le modèle phare « depth-first » de la famille Gemini 3 de Google. Il est positionné pour les charges de travail de raisonnement les plus difficiles : recherche approfondie, planification à long horizon, workflows agentiques multi-étapes, grands codebases, et tâches où le dernier incrément de précision ou de fiabilité compte matériellement. Pro privilégie la fidélité du raisonnement, l’intégration d’outils (appels de fonctions en streaming, appel d’outils robuste) et de très grandes fenêtres de contexte (Google annonce des paliers à haut nombre de tokens pour Pro). Pro est disponible pour les abonnés payants (Google AI Pro / Ultra tiers) et via des API d’entreprise.

Forces clés de Pro

- Profondeur de raisonnement et stabilité : ajusté pour le raisonnement multi-étapes et des modes de défaillance plus faibles sur des benchmarks complexes.

- Prise en charge de grands contextes : ciblé pour les workflows nécessitant de très longues fenêtres de contexte (synthèse multi-documents, dépôts entiers, gros PDF).

- Fonctionnalités d’entreprise et appel d’outils : prise en charge plus riche de différents schémas d’outils, intégrations d’ancrage et de récupération pour des systèmes agentiques de production.

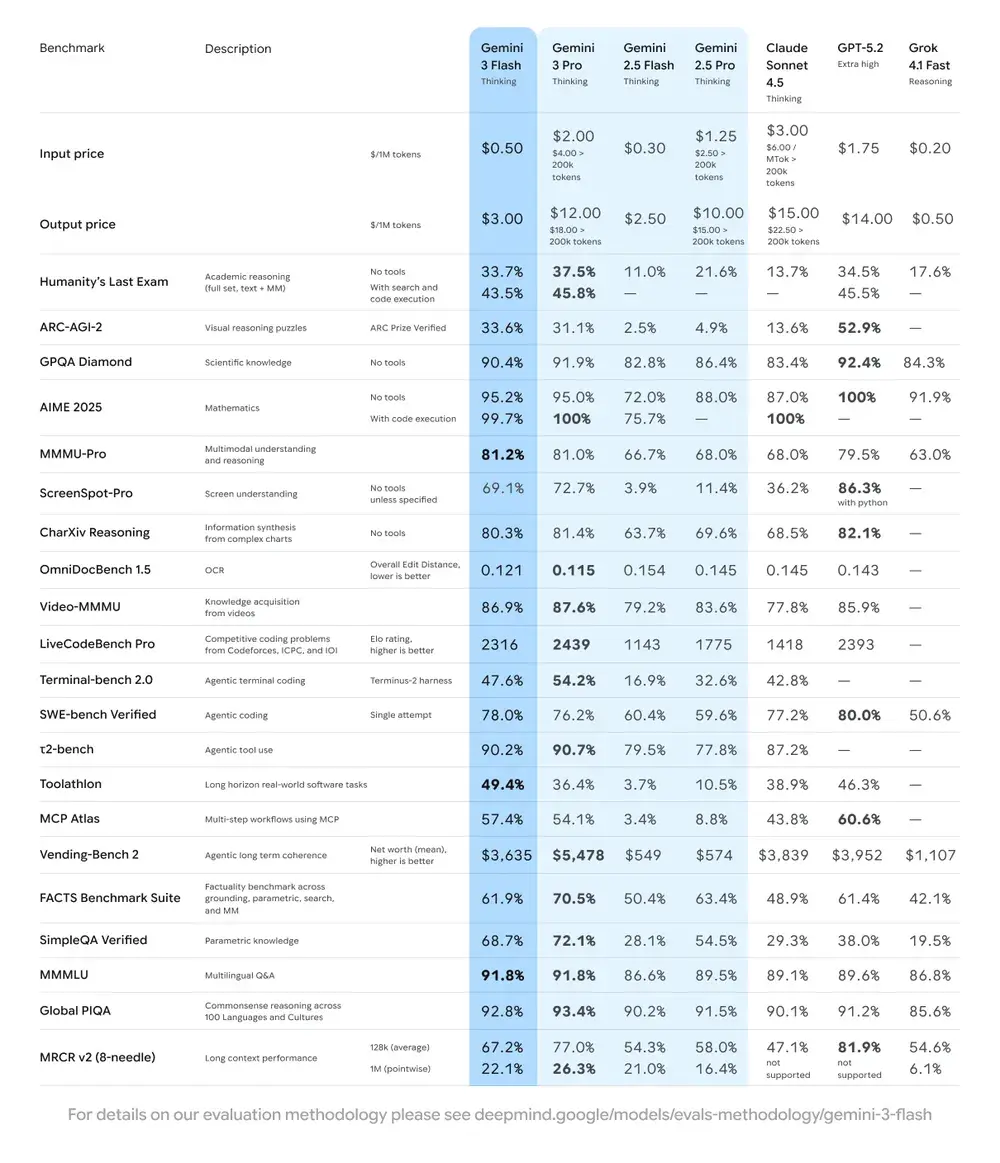

Comment Gemini 3 Flash et Gemini 3 Pro se comportent-ils sur les benchmarks ?

Flash obtient d’excellents résultats pour de nombreuses tâches réelles de développement/agentiques (comblant souvent l’écart avec Pro), et sur certains benchmarks de codage dépasse même Pro — tandis que Pro reste la référence pour les tâches de raisonnement les plus difficiles et la synthèse en contexte long.

Benchmarks où Pro mène

- GPQA Diamond (sciences niveau master/doctorat) : Pro ≈ 91,9% (pouvant atteindre ≈ 93,8% avec Deep Think sur certaines exécutions), démontrant des performances de premier plan sur des ensembles de questions scientifiques de niveau master/doctorat.

- Terminal-Bench 2.0 (tâches agentiques sur terminal) : Pro : 54,2% — un avantage net sur les tests d’utilisation d’outils/exploitation du terminal comparé aux modèles antérieurs et à de nombreux pairs. C’est un indicateur clé pour les automatisations agentiques de code/terminal.

- ARC-AGI-2 (raisonnement visuel abstrait) : Pro montre des améliorations significatives par rapport aux versions Gemini précédentes (par ex., Pro 31,1% vs 4,9% auparavant ; Deep Think augmente encore ces résultats). Ce sont de grands gains relatifs, même si les pourcentages absolus restent modestes pour les tâches les plus difficiles.

Benchmarks où Flash excelle ou rivalise bien

- GPQA / MMMU / tâches pratiques : Des rapports précoces montrent que Flash produit des scores de type GPQA très élevés sur de nombreuses exécutions (des rapports mentionnent GPQA Diamond ≈ 90,4% et MMMU Pro ≈ 81,2% dans la presse), démontrant que Flash s’approche du niveau de précision de Pro sur un large éventail de tâches tout en étant beaucoup plus rapide et moins coûteux.

- Codage et tâches courtes : Flash peut être plus rapide et parfois même surpasser Pro sur des tâches de codage rapides à un seul tour ou des évaluations courtes grâce à une latence plus faible et une efficience en tokens ; Flash obtient de meilleurs scores sur certains tests de codage tout en coûtant beaucoup moins par exécution. Ces résultats communautaires sont précoces et varient selon les bancs de test.

Ce que les chiffres impliquent pour la profondeur de raisonnement

- Plafonds absolus : Gemini 3 Pro fixe toujours les plafonds les plus élevés sur les benchmarks les plus difficiles (par ex., LMArena Elo, Humanity’s Last Exam avec Deep Think). Cela signifie que si vous exigez le dernier incrément de précision sur les problèmes les plus durs (recherche niveau doctorat, raisonnement scientifique inédit, précision mathématique maximale), Pro est le choix le plus sûr.

- Efficience de Pareto : Gemini 3 Flash réduit l’écart sur de nombreuses tâches pratiques (QA, codage, extraction multimodale) tout en offrant de grands gains de vitesse/coût. Pour de nombreuses tâches en production où la réactivité et le débit priment, Flash représente un meilleur compromis coût-performance.

- Un score ≠ une supériorité universelle. Les benchmarks capturent le comportement sur des tâches curatorées. Les excellents chiffres de Flash sur SWE-bench/codage montrent qu’il est optimisé pour des tâches structurées et agentiques et bénéficie probablement d’une architecture et de réglages de décodage alignés avec les charges de travail de codage courantes.

- La latence et le coût modifient le compromis pratique. Si un modèle est légèrement meilleur en précision absolue mais 3× plus lent et 6× plus coûteux à faire tourner, Flash devient souvent le choix judicieux pour les systèmes de production où la réactivité et le coût comptent. Gemini 3 Flash étant environ 3× plus rapide qu’un référentiel Gemini 2.5 Pro antérieur tout en maintenant une haute qualité de raisonnement.

Gemini 3 Flash vs Gemini 3 Pro : Tarification et spécifications

Résumé technique du modèle

- Fenêtre de contexte (entrée) : Gemini 3 Pro et Gemini 3 Flash sont annoncés avec jusqu’à 1 000 000 tokens de fenêtre de contexte d’entrée ; Pro annonce en outre 64k en sortie et des variantes image spécialisées avec leurs propres fenêtres. (Remarque : le comportement réel des interfaces web et les limites de débit peuvent différer selon les produits ; voir « Mises en garde » ci-dessous.)

- Entrées multimodales prises en charge : texte, images, audio, vidéo et PDF pour Pro et Flash (avec des capacités image/vidéo exposées via Google AI Studio / API / Vertex).

- Modes spéciaux : Pro prend en charge Deep Think et des fonctionnalités agentiques réservées à Pro (Google Antigravity / tooling) et est utilisé pour des charges de travail à sécurité renforcée. Flash prend en charge des niveaux de raisonnement configurables et des sorties structurées mais est optimisé pour la faible latence et le coût.

Tarification développeur/API (paliers de tarification publiés — par 1M tokens)

(Les valeurs ci-dessous proviennent de la Gemini API / documentation des modèles publiées pour la famille Gemini 3. Elles reflètent les prix de préversion publiés par 1M tokens en entrée/sortie ; consultez la facturation pour les tarifs de production exacts qui vous seront facturés.)

gemini-3-flash-preview (Flash):

- Input : $0.50 per 1M tokens

- Output : $3.00 per 1M tokens.

gemini-3-pro-preview (Pro)

- Tier A (<200k tokens context) : $2 / $12 per 1M tokens (input / output)

- Tier B (>200k tokens context or heavy contexts) : $4 / $18 per 1M tokens — la tarification augmente pour les très grands contextes.

Signification pratique : pour une utilisation de tokens équivalente dans la bande courante (<200k tokens), Flash coûte environ 4× moins par token en entrée et 4× moins en sortie que Pro dans les prix de préversion publiés. Pour les grands contextes (>200k), les coûts de Pro peuvent être sensiblement plus élevés.

CometAPI fournit un accès API à Gemini 3 Flash et Gemini 3 Pro, et le prix de l’API est remisé.

Tarification grand public / abonnement (application Gemini / offres Google AI)

Google AI Pro (l’offre grand public/avancés qui débloque les fonctionnalités de Gemini 3 Pro dans l’application Gemini et l’intégration workspace) est publiée à $19.99 per month (disponibilité et conversions de devise locale applicables). Google propose également des paliers « AI Ultra » avec des limites plus élevées à un coût mensuel bien supérieur pour un accès de niveau entreprise

Gemini 3 Flash vs Gemini 3 Pro : raisonnement et compréhension multimodale

Profondeur de raisonnement : Pro vs Flash

Gemini 3 Pro est systématiquement présenté comme le modèle au raisonnement le plus profond. Sur des benchmarks de sciences de niveau master/doctorat (GPQA Diamond) et des benchmarks d’utilisation agentique d’outils (Terminal-Bench 2.0), Pro affiche des scores au niveau de l’état de l’art (par ex., GPQA Diamond ≈ 91,9% pour Pro avec des améliorations via Deep Think jusqu’à 93,8% sur certaines exécutions). Ces chiffres placent Pro devant de nombreux concurrents sur des tâches complexes et spécifiques à un domaine.

Agentique, codage et synthèse multimodale : les choix architecturaux et le réglage de Gemini 3 Flash lui permettent de très bien performer sur certains benchmarks de codage et de raisonnement structuré, et dans de nombreuses tâches réelles, la différence visible par l’utilisateur par rapport à Pro est faible — surtout lorsque les contrôles d’API de « niveau de réflexion » sont ajustés. Des tests indépendants précoces et des articles de presse montrent que Gemini 3 Flash égale ou dépasse Pro sur certains benchmarks agentiques de codage. Mais cela ne signifie pas que Gemini 3 Flash égale Gemini 3 Pro sur tous les scénarios de recherche longue ou de raisonnement à forte ambiguïté.

Flash, en revanche, est optimisé pour équilibrer qualité et vitesse. Gemini 3 Flash offre un raisonnement élevé pour la majorité des tâches quotidiennes sans égaler la performance de pointe de Pro sur les problèmes académiques ou multi-étapes les plus difficiles. Le compromis est explicite : des réponses plus rapides avec des chaînes de raisonnement légèrement plus courtes.

Performances multimodales (images/vidéo/audio)

Flash et Pro dans la famille Gemini 3 prennent en charge les entrées multimodales (images, vidéo, audio). Gemini 3 Flash prend en charge un très grand nombre d’images par prompt (jusqu’à 900 images par prompt selon le contexte), des limites de taille de fichier pour les chargements inline (par ex., 7 MB par fichier inline, jusqu’à 30 MB depuis Cloud Storage pour certains déploiements), ainsi que des limites explicites de type/MIME/résolution, ce qui indique que l’interface multimodale de Flash est de niveau production et destinée à un usage intensif. Les forces multimodales de Gemini 3 Pro apparaissent sur des benchmarks nécessitant du raisonnement visuel et l’intégration d’outils pour l’exécution de code/terminal. Pour les tâches de raisonnement visuel les plus complexes, Gemini 3 Pro garde un avantage ; pour la synthèse multimédia à haut débit et les tâches de vision plus simples, Flash peut être plus économique et plus rapide.

Exemples de contrastes sur benchmarks

Raisonnement visuel (ARC-AGI-2) : Gemini 3 Pro montre de grands gains vs Gemini 2.5 Pro et surpasse de nombreux pairs, signalant que les améliorations d’architecture de Pro renforcent spécifiquement le raisonnement visuel abstrait. Gemini 3 Flash obtient de bons scores sur des tâches multimodales pratiques mais n’égale pas Pro sur les casse-têtes visuels les plus difficiles.

Comment se comparent-ils en vitesse brute — Gemini 3 Flash est-il vraiment plus rapide ?

Gemini 3 Flash peut offrir jusqu’à ~3× plus de débit / une latence plus faible par rapport aux référentiels Flash/Pro précédents (les déclarations comparent généralement Flash à Gemini 2.5 Pro ou aux modèles Pro de génération précédente). Cet avantage de vitesse est l’argument central de Gemini 3 Flash : fournir des réponses « de niveau Pro » à la latence de Flash. Gemini 3 Flash dépasse fréquemment Pro sur les tâches sensibles au débit (par ex., prompts de codage courts, latence par tour de chat) tout en restant compétitif sur de nombreux benchmarks qui mesurent la précision par unité de temps.

Tokens, tokens de « réflexion » et mise en cache

Google distingue les tokens d’entrée (ce que vous envoyez), les tokens de sortie (ce que le modèle renvoie, y compris les tokens de « réflexion » internes dans certains modes) et les coûts de mise en cache de contexte. Flash est optimisé pour utiliser moins de tokens de réflexion pour de nombreuses tâches (~30% de moins que 2.5 Pro pour des tâches comparables), ce qui réduit le coût effectif par requête résolue dans de nombreux scénarios pratiques. La tarification et l’usage de tokens de Pro reflètent des passes de raisonnement internes plus profondes qui peuvent augmenter l’usage de tokens et le coût, surtout pour de très grands contextes.

Comment interpréter « plus rapide » en pratique

Chat interactif : Gemini 3 Flash paraîtra plus vif ; utilisez-le pour des interfaces conversationnelles où l’expérience dépend de réponses en deçà de la seconde.

Tâches lourdes et longues : pour des chaînes de pensée longues et coûteuses en calcul, où les tokens de réflexion s’accumulent, le raisonnement plus profond de Gemini 3 Pro peut nécessiter plus de calcul et donc une latence plus élevée. Dans certains scénarios agentiques, les passes internes supplémentaires de Pro (par ex., modes Deep Think) peuvent délibérément prendre plus de temps pour atteindre des réponses de meilleure qualité.

Quels sont les cas d’usage réels et les recommandations ?

Choisissez Gemini 3 Flash si vous avez besoin de :

- Chat interactif à haut débit et faible latence (applications grand public, bots de support, recherche conversationnelle).

- Résumés multimodaux bon marché et rapides (vidéo, lots d’images) où la vitesse de réponse et le débit comptent plus que le sommet absolu du raisonnement multi-étapes.

- Tests A/B en masse, assistants in‑product et autocomplétion de code où les itérations courtes par appel dominent.

Choisissez Gemini 3 Pro si vous avez besoin de :

- Q&R scientifique de pointe, résolution de problèmes de math/physique où une fiabilité de niveau master/doctorat est requise.

- Systèmes agentiques qui doivent opérer des terminaux, effectuer des étapes outillées, exécuter et déboguer du code, ou orchestrer des chaînes d’outils multi-étapes (les forces de Pro sur Terminal-Bench comptent ici).

- Charges de travail où l’amélioration incrémentale de précision ou de raisonnement non verbal vaut l’augmentation de coût en tokens et de latence.

Schéma de déploiement hybride (bonne pratique concrète)

De nombreuses équipes de production adoptent des stratégies à deux modèles :

- Front door = Gemini 3 Flash : servir la plupart des utilisateurs interactifs avec Flash pour la réactivité et le contrôle des coûts.

- Escalate = Pro : router les requêtes de recherche longue, les exécutions agentiques spécialisées ou les « escalades » vers Pro, éventuellement après un premier passage avec Flash pour cadrer le problème. Ce schéma équilibre coût, latence et précision.

Conclusion

Gemini 3 Flash et Gemini 3 Pro ne sont pas simplement « plus rapide vs plus intelligent » au sens binaire — ce sont des compromis d’ingénierie sur les axes vitesse/latence, coût et raisonnement. Flash repousse la frontière pratique pour les charges de travail interactives à haut débit en offrant une grande partie des capacités de raisonnement de Gemini 3 à une fraction du coût et de la latence ; Pro préserve et étend le plafond de raisonnement de niveau recherche, la fidélité multimodale et l’entreprise

Les développeurs peuvent accéder à Gemini 3 Pro API et Gemini 3 Flash via CometAPI. Pour commencer, explorez les capacités des modèles de CometAPI dans le Playground et consultez le guide de l’API pour des instructions détaillées. Avant l’accès, veuillez vous assurer que vous êtes connecté à CometAPI et que vous avez obtenu la clé API. CometAPI propose un prix bien inférieur au tarif officiel pour vous aider à intégrer.

Prêt à démarrer ? → Free trial of Gemini 3 !