Gemini 3 Pro (Preview) est le tout nouveau modèle phare de raisonnement multimodal de Google/DeepMind au sein de la famille Gemini 3. Il est présenté comme leur « modèle le plus intelligent à ce jour », conçu pour le raisonnement approfondi, des workflows axés sur les agents, la programmation avancée et la compréhension multimodale à long contexte (texte, images, audio, vidéo, code et intégrations d’outils).

Fonctionnalités clés

- Modalités : texte, image, vidéo, audio, PDF (et sorties d’outils structurées).

- Agents/outillage : appels de fonctions intégrés, recherche comme outil, exécution de code, contexte d’URL, et prise en charge de l’orchestration d’agents multi‑étapes. Un mécanisme de « thought‑signature » préserve le raisonnement multi‑étapes entre les appels.

- Programmation et « vibe coding » : optimisé pour la génération de front‑end, la création d’interfaces interactives et la programmation axée sur des agents (il arrive en tête des classements pertinents rapportés par Google). Il est présenté comme leur modèle de « vibe coding » le plus performant à ce jour.

- Nouveaux contrôles pour développeurs :

thinking_level(low|high) pour arbitrer entre coût/latence et profondeur de raisonnement, etmedia_resolutionpour régler la fidélité multimodale par image ou par frame vidéo. Ces paramètres aident à équilibrer performances, latence et coût.

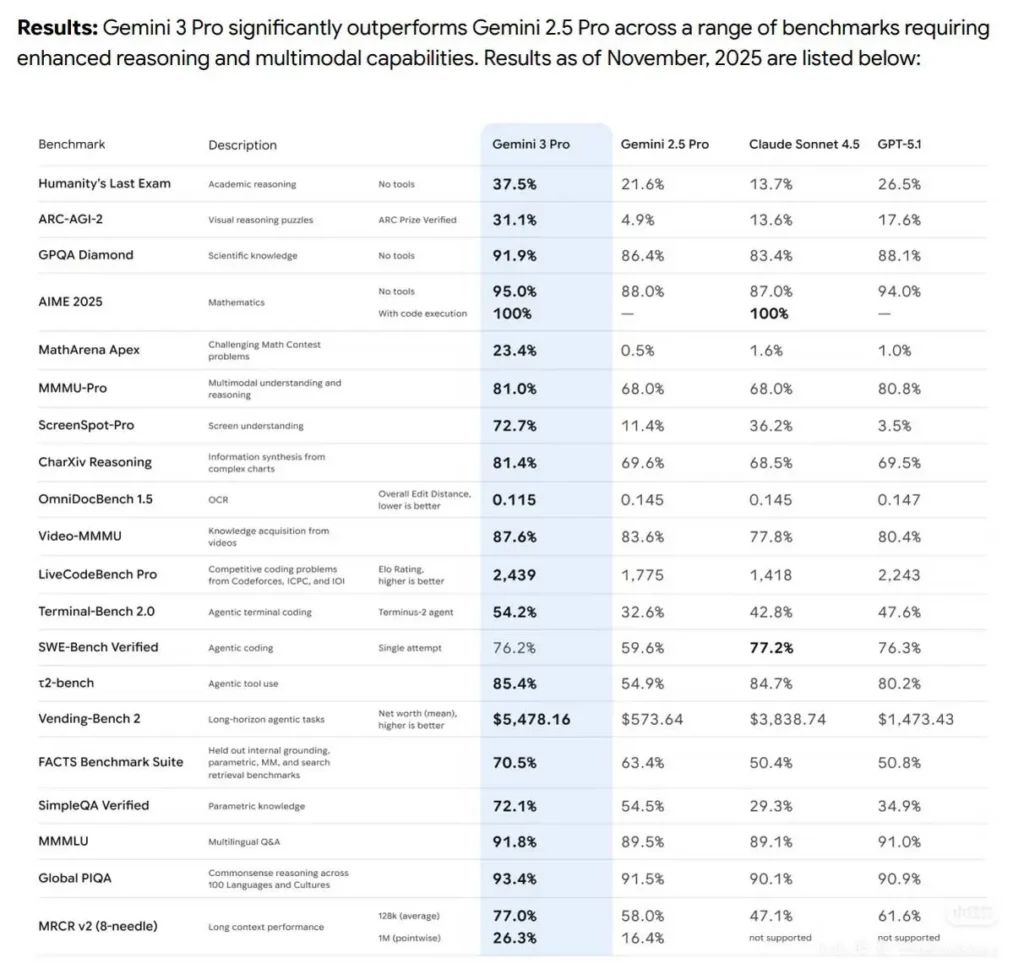

Performances aux benchmarks

- Gemini3Pro a obtenu la première place sur LMARE avec un score de 1501, dépassant les 1484 points de Grok-4.1-thinking et devançant également Claude Sonnet 4.5 et Opus 4.1.

- Il a également pris la première place dans l’arène de programmation WebDevArena avec un score de 1487.

- Sur Humanity’s Last Exam (raisonnement académique), il a atteint 37.5 % (sans outils) ; sur GPQA Diamond (science), 91.9 % ; et dans la compétition mathématique MathArena Apex, 23.4 %, établissant un nouveau record.

- En capacités multimodales, il atteint 81 % sur MMMU-Pro ; et 87.6 % sur Video‑MMMU (compréhension vidéo).

Détails techniques et architecture

- Paramètre « thinking level » : Gemini 3 expose un contrôle

thinking_levelpermettant aux développeurs d’arbitrer entre profondeur du raisonnement interne et latence/coût. Le modèle interprètethinking_levelcomme une allocation relative de raisonnement multi‑étapes interne, plutôt qu’une garantie stricte de jetons. La valeur par défaut est généralementhighpour Pro. Il s’agit d’un nouveau contrôle explicite permettant d’ajuster la planification multi‑étapes et la profondeur de la chaîne de raisonnement. - Sorties structurées et outils : le modèle prend en charge les sorties JSON structurées et peut être combiné aux outils intégrés (ancrage sur Google Search, contexte d’URL, exécution de code, etc.). Certaines fonctionnalités combinant sorties structurées et outils sont réservées à l’aperçu pour

gemini-3-pro-preview. - Intégrations multimodales et orientées agents : Gemini 3 Pro est explicitement conçu pour des workflows agentiques (outillage + multiples agents sur code/terminaux/navigateur).

- Accepte des entrées texte, image, vidéo, audio et PDF ; sortie texte.

Limitations et points d’attention connus

- Factualité imparfaite — des hallucinations restent possibles. Malgré les progrès importants revendiqués par Google, une vérification étayée et un examen humain restent nécessaires dans les contextes à forts enjeux (juridique, médical, financier).

- Les performances sur les très longs contextes varient selon la tâche. La prise en charge d’une fenêtre d’entrée de 1M est une capacité avérée, mais l’efficacité empirique peut diminuer sur certains benchmarks à des longueurs extrêmes (baisses ponctuelles observées à 1M sur certains tests de long contexte).

- Compromis coût et latence. Les contextes volumineux et un

thinking_levelélevé augmentent le calcul, la latence et le coût ; des paliers tarifaires s’appliquent selon les volumes de jetons. Utilisezthinking_levelet des stratégies de découpage pour maîtriser les coûts. - Sécurité et filtres de contenu. Google continue d’appliquer des politiques de sécurité et des couches de modération ; certains contenus et actions restent restreints ou déclencheront des modes de refus.

Comparaison de Gemini 3 Pro Preview avec d’autres modèles de pointe

Comparaison de haut niveau (aperçu → qualitative) :

Par rapport à Gemini 2.5 Pro : des améliorations franches en raisonnement, utilisation d’outils orientés agents et intégration multimodale ; gestion de contexte bien plus vaste et meilleure compréhension des longs formats. DeepMind montre des gains réguliers sur le raisonnement académique, la programmation et les tâches multimodales.

Par rapport à GPT-5.1 et Claude Sonnet 4.5 (d’après leurs rapports) : sur le panel de benchmarks de Google/DeepMind, Gemini 3 Pro est présenté comme en tête sur plusieurs métriques agentiques, multimodales et de long contexte (voir Terminal‑Bench, MMMU‑Pro, AIME). Les résultats comparatifs varient selon la tâche.

Cas d’usage typiques et à forte valeur

- Résumé et Q/R sur de grands documents/livres : la prise en charge de longs contextes le rend attractif pour les équipes juridiques, de recherche et de conformité.

- Compréhension et génération de code à l’échelle d’un dépôt : l’intégration aux chaînes d’outillage de développement et un raisonnement amélioré facilitent les refactorings à grande échelle et les workflows de revue de code automatisée.

- Assistants produits multimodaux : workflows image + texte + audio (support client ingérant captures d’écran, extraits d’appels et documents).

- Génération et édition de médias (photo → vidéo) : les fonctionnalités antérieures de la famille Gemini incluent désormais des capacités photo→vidéo de type Veo/Flow ; la préversion laisse entrevoir une génération multimédia plus poussée pour des prototypes et des workflows médias.

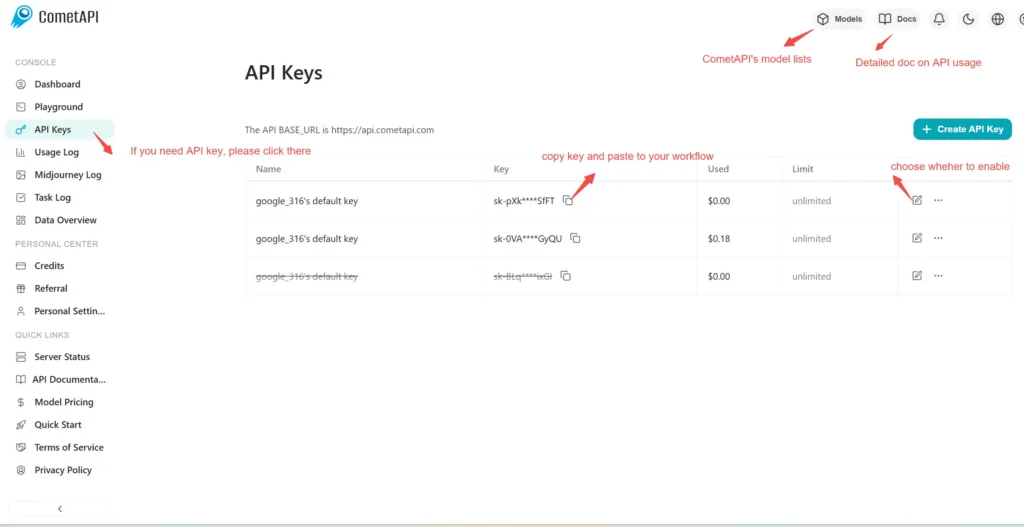

Comment appeler l’API gemini-3-pro-preview depuis CometAPI

Tarification de Gemini 3 Pro Preview sur CometAPI, 20 % de réduction par rapport au prix officiel :

| Jetons en entrée | $1.60 |

| Jetons en sortie | $9.60 |

Étapes requises

- Connectez-vous à cometapi.com. Si vous n’êtes pas encore utilisateur, inscrivez‑vous d’abord.

- Connectez-vous à votre console CometAPI.

- Récupérez la clé API d’accès. Cliquez sur « Add Token » dans la section API token de votre espace personnel, obtenez la clé de jeton : sk-xxxxx et validez.

Méthode d’utilisation

- Sélectionnez l’endpoint «

gemini-3-pro-preview» pour envoyer la requête API et définissez le corps de la requête. La méthode et le corps de requête sont disponibles dans la documentation API de notre site. Notre site fournit également un test Apifox pour votre commodité. - Remplacez <YOUR_API_KEY> par votre clé CometAPI réelle issue de votre compte.

- Insérez votre question ou demande dans le champ content — c’est à cela que le modèle répondra.

- . Traitez la réponse de l’API pour obtenir la réponse générée.

CometAPI fournit une API REST entièrement compatible — pour une migration sans friction. Détails clés pour Chat :

- URL de base : v1/chat/completions

- Noms de modèles :

gemini-3-pro-preview - Authentification : en-tête

Bearer YOUR_CometAPI_API_KEY - Content-Type :

application/json.

Voir aussi GPT-5.1 API