Google DeepMind a officiellement publié Gemma 4 le 2 avril 2026, marquant une étape majeure pour l’IA open source. Cette famille de modèles délivre une intelligence de niveau « frontier » par paramètre, bâtie sur les mêmes recherches et technologies qui alimentent Gemini 3. Contrairement aux versions antérieures de Gemma avec des licences personnalisées, Gemma 4 est livrée sous une licence Apache 2.0 entièrement permissive, autorisant l’usage commercial, la modification et la redistribution sans restriction.

Gemma 4 se distingue par ses capacités multimodales (entrées texte + image sur toutes les tailles, plus l’audio sur les modèles edge), la prise en charge native du raisonnement avancé et des workflows agentiques, des fenêtres de contexte longues jusqu’à 256K tokens, et une optimisation pour tout, des smartphones et du Raspberry Pi jusqu’aux GPU haut de gamme. Il prend en charge plus de 140 langues et met l’accent sur l’efficacité, rendant une IA puissante accessible sur le matériel grand public et edge sans dépendance au cloud.

CometAPI fournit d’excellentes API de modèles open source et propriétaires.

Qu’est-ce que Gemma 4 ?

Gemma 4 est la toute dernière famille de grands modèles de langage multimodaux ouverts (LLMs) de Google DeepMind, conçue pour le raisonnement avancé, les workflows d’IA agentique, et le déploiement efficace sur appareil. Il maximise « l’intelligence par paramètre » en tirant parti d’insights issus des recherches propriétaires sur Gemini 3, tout en restant entièrement open-weight et open source.

Principales avancées par rapport aux versions précédentes de Gemma :

- Multimodalité native : compréhension texte + image (tous les modèles), avec prise en charge de l’audio sur les petites variantes edge.

- Mode de réflexion configurable : raisonnement pas à pas avec sortie structurée <|think|>.

- Appels de fonctions et utilisation d’outils natifs : idéal pour les agents autonomes.

- Contexte étendu : jusqu’à 256K tokens sur les plus grands modèles.

- Architecture d’attention hybride : combine fenêtre coulissante locale et attention globale pour l’efficacité et la performance en long contexte.

- Per-Layer Embeddings (PLE) dans les petits modèles et cache KV partagé pour économiser la mémoire.

- Large support multilingue : pré-entraîné sur des données couvrant plus de 140 langues avec une sensibilité aux nuances culturelles.

Publiée sous Apache 2.0, Gemma 4 supprime les restrictions de licence qui limitaient l’adoption en entreprise. Les développeurs peuvent désormais ajuster, déployer et commercialiser sans friction—en faisant un concurrent direct des écosystèmes pleinement ouverts tels que Llama et Qwen.

Gemma 4 vise des matériels variés : appareils edge (téléphones, IoT, Raspberry Pi, Jetson Nano) pour une IA hors ligne à faible latence, et stations de travail/GPU pour des serveurs locaux haute performance. Cette conception « local-first » privilégie la confidentialité, la réduction des coûts et l’inférence sans latence.

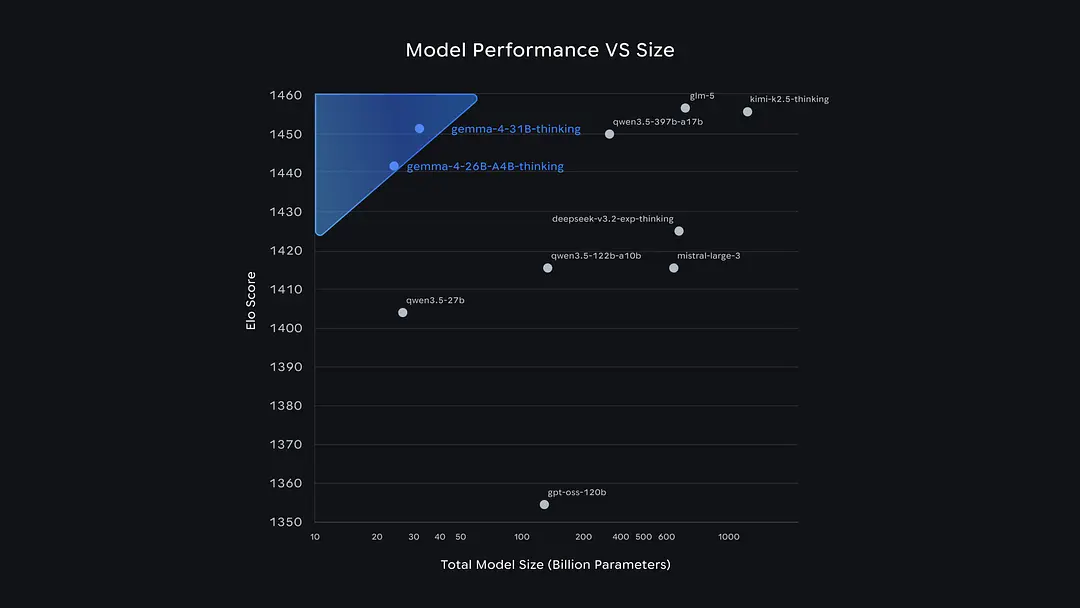

Les modèles open source qui la devancent sur le classement Arena proviennent principalement d’équipes chinoises. Gemma 4 n’est pas très différente de Qwen 3.5 et de GLM-5, mais elle diffère sensiblement de GPT-OSS-120B d’OpenAI.

Les développeurs peuvent désormais trouver GLM-5, Qwen 3.5, etc. sur CometAPI.

Les quatre versions de Gemma 4

Google a publié Gemma 4 en quatre tailles soigneusement optimisées, chacune équilibrant performances, efficacité et scénarios de déploiement. Deux utilisent des architectures denses avec des Per-Layer Embeddings (PLE) innovants pour l’efficacité edge ; l’une est une Mixture-of-Experts (MoE) pour des performances élevées à coût de paramètres actifs réduit ; et l’une est un modèle dense porte-étendard.

| Modèle | Architecture | Paramètres totaux | Paramètres actifs (MoE) | Paramètres effectifs | Longueur de contexte | Modalités | Matériel cible |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | Dense + PLE | ~5.1B (incl. embeddings) | N/A | 2.3B | 128K | Texte, Image, Audio | Smartphones, Raspberry Pi, IoT edge |

| Gemma 4 E4B | Dense + PLE | ~8B (incl. embeddings) | N/A | 4.5B | 128K | Texte, Image, Audio | Appareils mobiles, GPU légers, Jetson |

| Gemma 4 26B A4B | MoE (8 actifs / 128 au total + 1 partagé) | 25.2B | 3.8B–4B | N/A | 256K | Texte, Image | Stations de travail, GPU grand public, serveurs locaux |

| Gemma 4 31B | Dense | 30.7B | N/A | N/A | 256K | Texte, Image | GPU haut de gamme (tient sur un seul H100/A100 en FP16) |

Gemma 4 E2B et E4B (optimisés pour l’edge) : utilisent PLE pour ajouter une spécialisation par couche avec un surcoût de paramètres minimal. Idéal pour les appareils à batterie ou contraints en mémoire. L’encodeur audio (Conformer de style USM, ~300M paramètres) permet la reconnaissance de la parole et la traduction.

Gemma 4 26B A4B (MoE) : n’active qu’environ ~4B de paramètres pendant l’inférence malgré une taille totale de plus de 25B. Offre des performances proches du 31B pour un coût de calcul bien moindre—parfait pour une montée en charge rentable.

Gemma 4 31B (Dense) : le porte-étendard pour une capacité maximale. Tient sur un seul GPU 80GB en pleine précision et figure parmi les meilleurs modèles ouverts dans les classements.

Tous les modèles incluent des variantes instruction-tuned (“-it”) optimisées pour le chat, le raisonnement et l’usage d’outils, ainsi que des versions de base pré-entraînées pour le fine-tuning. Les deux grands modèles adoptent des approches différentes : le 31B Dense vise la qualité ultime et constitue la meilleure base pour le fine-tuning ; le 26B MoE privilégie la vitesse, n’activant que 3.8 milliards de paramètres pendant l’inférence, ce qui se traduit par une génération de mots bien plus rapide, avec une qualité globale légèrement inférieure.

Les deux petits modèles, E2B et E4B, sont spécialement conçus pour les téléphones mobiles et les appareils IoT : ils peuvent fonctionner entièrement hors ligne, économisant mémoire et énergie. De plus, ces petits modèles possèdent une capacité que les grands n’ont pas : l’entrée audio native, permettant la reconnaissance vocale directe.

Capacités clés de Gemma 4

Gemma 4 excelle dans les domaines qui comptent le plus pour les applications d’IA réelles :

1. Raisonnement avancé et mode « Thinking »

Raisonnement pas à pas configurable via des invites système ou enable_thinking=True. Produit des balises structurées <|think|> suivies des réponses finales. Améliore considérablement les performances sur les tâches complexes sans fine-tuning supplémentaire.

2. Compréhension multimodale

- Vision : détection d’objets (boîtes englobantes JSON), OCR (multilingue), analyse de documents/PDF, compréhension de graphiques, compréhension d’interface utilisateur, reconnaissance d’écriture manuscrite et gestion d’images à résolution variable (budgets de tokens : 70–1120 tokens).

- Vidéo : jusqu’à 60 secondes (traitement à 1 fps).

- Audio (E2B/E4B uniquement) : reconnaissance automatique de la parole (ASR) et traduction parole-texte (max 30s).

- Entrées entrelacées : mélangez texte, images et audio dans n’importe quel ordre.

3. Workflows agentiques et appel de fonctions

La prise en charge native de l’usage d’outils permet des agents autonomes pour la planification multi-étapes, les appels d’API, la navigation dans les applications et l’exécution de tâches. Excellente performance sur τ2-bench (usage d’outils agentiques).

4. Programmation et outils développeur

Génération de code, complétion, débogage et compréhension de référentiels de niveau exceptionnel. Prend en charge des sorties structurées JSON pour une intégration sans heurts. Il obtient 80.0% (31B) sur LiveCodeBench v6, se positionnant comme un assistant de programmation « local-first » adapté aux scénarios de développement hors ligne.

5. Contexte long et multilingue

Gère de manière fiable 128K–256K tokens (testé sur MRCR needle-in-haystack). Pré-entraîné sur des données diverses jusqu’à la date de coupure de janvier 2025, avec de solides performances interlinguistiques. Ce n’est pas qu’une traduction multilingue ; c’est un entraînement natif couvrant plus de 140 langues.

Données de benchmark : décomposition des performances de Gemma 4

Gemma 4 fixe de nouveaux standards pour les modèles ouverts. Les variantes 31B et 26B obtiennent des scores autrefois réservés à des systèmes propriétaires bien plus grands, tandis que les modèles edge surpassent le grand prédécesseur Gemma 3.

Résultats complets des benchmarks (modèles instruction-tuned)

| Benchmark | Catégorie | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B (no think) |

|---|---|---|---|---|---|---|

| MMLU Pro | Raisonnement et connaissances | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (sans outils) | Math | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | Sciences de niveau master | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2 (moy.) | Utilisation d’outils agentiques | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | Programmation | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | Programmation compétitive | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | Raisonnement multimodal | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH-Vision | Math + Vision | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2 (8-needle, 128K) | Contexte long | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

Points clés :

- Progrès massif par rapport à Gemma 3 : le modèle 31B passe de 20.8% à 89.2% sur AIME (math) et de 29.1% à 80.0% sur LiveCodeBench.

- Efficacité MoE : le 26B A4B approche le 31B tout en utilisant bien moins de calcul à l’inférence.

- Domination edge : E4B et E2B dépassent Gemma 3 27B sur de nombreux indicateurs, malgré une taille 6–10x plus petite.

- Classements : le 31B obtient ~1452 sur Arena AI (texte) ; le 26B A4B ~1441. La variante 26B dépasserait des modèles bien plus grands comme Qwen 3.5 397B en préférence utilisateur et en programmation.

Les benchmarks de vision et d’audio confirment une solide performance multimodale dès la sortie de boîte, sans fine-tuning spécialisé.

Écosystème et prise en charge des outils

Gemma 4 bénéficie d’une intégration immédiate et étendue :

- Hugging Face : prise en charge dès le premier jour avec

transformers,pipeline("any-to-any"), GGUF, ONNX et des processeurs multimodaux. - Runtimes locaux : Ollama, Llama.cpp (LM Studio, Jan), MLX (Apple Silicon avec TurboQuant), Mistral.rs (Rust), Transformers.js (inférence navigateur WebGPU).

- Fine-tuning : TRL, Unsloth, PEFT, Vertex AI, et prise en charge complète des jeux de données multimodaux.

- Optimisation matérielle : NVIDIA RTX/DGX Spark/Jetson (via TensorRT-LLM), outils Google AI Edge, et déploiement sur appareil Android/iOS.

- Cadres d’agents : OpenClaw, Hermes, Pi, et tests de simulation CARLA.

- Cloud/Studio : Google AI Studio pour des essais rapides ; Kaggle Models pour le téléchargement.

Cet écosystème rend Gemma 4 déployable en quelques minutes sur ordinateurs portables, serveurs ou appareils edge.

Limites et sécurité :

- Date de coupure des données d’entraînement : janvier 2025 (pas de connaissances en temps réel sans outils).

- Audio limité à la parole (pas de musique) ; vidéo plafonnée à 60s.

- Un risque d’hallucinations subsiste—utilisez le mode thinking et la vérification.

- Sécurité : filtrage rigoureux et évaluations conformes aux Google AI Principles ; les développeurs doivent ajouter des garde-fous spécifiques à l’application.

Pourquoi Gemma 4 compte en 2026

Gemma 4 démocratise l’IA de pointe. En combinant intelligence multimodale, capacités agentiques et liberté Apache 2.0 avec une efficacité indépendante du matériel, il permet aux développeurs et aux entreprises de créer des solutions d’IA sécurisées, privées et économiques à l’échelle. La percée de l’intelligence par paramètre—particulièrement visible sur les modèles edge surpassant les anciens modèles ouverts phares—annonce une IA véritablement ubiquitaire.

Qu’il s’agisse d’exécuter un modèle 2B sur un téléphone ou un 31B puissant en local, Gemma 4 prouve que l’IA open source a rattrapé (et dans de nombreux cas dépassé) les alternatives fermées en utilité pratique.