L’évolution rapide de l’intelligence artificielle (IA) a donné naissance à des modèles linguistiques avancés qui transforment divers secteurs. OpenAILe GPT-4 et son successeur, le GPT-4o, représentent des étapes importantes dans cette évolution. Cet article propose une comparaison approfondie de ces deux modèles, examinant leurs caractéristiques, leurs performances et leur adéquation à différentes applications.

Qu'est-ce que GPT-4?

GPT-4, lancé le 14 mars 2023, est un modèle de langage multimodal de grande taille capable de traiter des entrées texte et image pour générer des sorties textuelles de type humain. Il a marqué une avancée substantielle par rapport à ses prédécesseurs en améliorant la créativité et la collaboration dans des tâches telles que la composition de chansons, l'écriture de scénarios et l'adaptation au style d'écriture de l'utilisateur. GPT-4 est accessible via l'abonnement et l'API ChatGPT Plus d'OpenAI, et est intégré à Copilot de Microsoft.

Qu’est-ce que GPT-4o ?

GPT-4o (« o » pour « omni »), lancé en mai 2024, a étendu les capacités de GPT-4 en introduisant des fonctionnalités multilingues et multimodales. Ce modèle peut traiter et générer du texte, des images et de l'audio, offrant un raisonnement en temps réel sur ces formats. GPT-4o est conçu pour être plus rapide et plus économique que ses prédécesseurs, offrant une intelligence de niveau GPT-4 avec des performances améliorées pour le texte, la voix et la vision. La génération d'images de GPT-4o excelle notamment dans le rendu précis du texte et le suivi précis des invites, exploitant sa base de connaissances et le contexte de chat inhérents.

Quelles sont les principales différences entre GPT-4 et GPT-4o ?

Comprendre les distinctions fondamentales entre GPT-4 et GPT-4o est essentiel pour sélectionner le modèle approprié pour des tâches spécifiques.

Calendrier de publication et données de formation

- GPT-4:Lancé en 2023, GPT-4 a été formé sur des données jusqu'en septembre 2021.

- GPT-4o:Lancé en 2024, GPT-4o bénéficie de données de formation jusqu'en octobre 2023, offrant une base de connaissances plus actuelle.

Capacités multimodales

- GPT-4: Principalement conçu pour les interactions textuelles avec une prise en charge limitée des entrées d'image.

- GPT-4o:Un modèle omni capable de traiter et de générer du texte, des images, de l'audio et de la vidéo, permettant des applications plus polyvalentes.

Fenêtre de contexte et limites de jetons

- GPT-4: Prend en charge une fenêtre de contexte d'entrée de 8,192 8,192 jetons et peut générer jusqu'à XNUMX XNUMX jetons par requête.

- GPT-4o:Offre une fenêtre de contexte considérablement plus grande de 128,000 16,384 jetons et peut produire jusqu'à XNUMX XNUMX jetons dans une seule réponse, facilitant des sorties plus étendues et plus cohérentes.

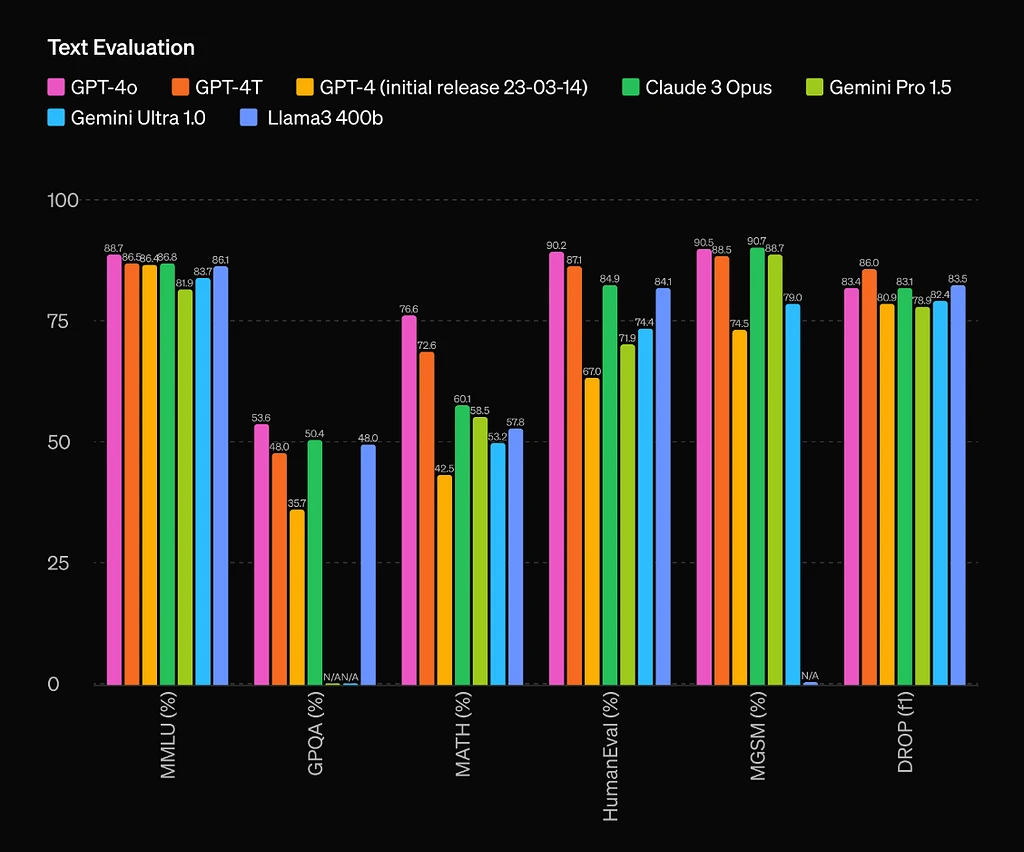

Comment se comparent les performances et l’efficacité ?

Les mesures de performance et les considérations de coût sont essentielles lors de l’évaluation des modèles d’IA en vue de leur déploiement.

Vitesse et latence

- GPT-4:Connu pour ses résultats détaillés et nuancés, mais avec des temps de réponse plus longs en raison d'un traitement interne complexe.

- GPT-4o:Génère du texte jusqu'à deux fois plus vite que GPT-4, avec des temps de réponse moyens de 320 millisecondes, comparables à la vitesse de conversation humaine.

Efficacité des coûts

- GPT-4:Coûts opérationnels plus élevés, avec des jetons d'entrée au prix de 30 $ par million et des jetons de sortie à 60 $ par million.

- GPT-4o:Plus rentable, facturant 2.50 $ par million de jetons d'entrée et 10 $ par million de jetons de sortie, ce qui le rend environ 7.2 fois moins cher que GPT-4.

Quelles sont les capacités multimodales du GPT-4o ?

La capacité du GPT-4o à gérer plusieurs formes d'entrée et de sortie de données le distingue de son prédécesseur.

Traitement de la vision et de l'audio

GPT-4o peut interpréter et générer des réponses basées sur des images et des entrées audio, permettant des applications telles que :

- Interprétation des images: Décrire le contenu visuel, aider aux tâches nécessitant une analyse visuelle.

- Interaction audio: S'engager dans des dialogues vocaux, améliorant l'expérience utilisateur dans les applications d'IA conversationnelles.

Interaction en temps réel

Le modèle prend en charge les interactions en temps réel, permettant aux utilisateurs d'interrompre et de recevoir des réponses immédiates, créant ainsi des conversations plus dynamiques et naturelles.

Comment se comportent-ils en matière de compréhension et de génération du langage ?

Les deux modèles présentent de fortes capacités de traitement du langage, mais il existe des différences notables.

Compétence multilingue

- GPT-4: Démontre une grande maîtrise de l'anglais et des tâches liées au code.

- GPT-4o:Montre des améliorations significatives dans la gestion des langues non anglaises, le rendant plus adapté aux applications mondiales.

Raisonnement et créativité

- GPT-4:Excelle dans les tâches créatives avancées et les scénarios de résolution de problèmes complexes.

- GPT-4o:Tout en conservant de solides capacités de raisonnement, il met l'accent sur l'efficacité et la rapidité, en s'adressant aux applications nécessitant des réponses rapides et contextuelles.

Quelles sont les applications pratiques et les cas d’utilisation ?

Le choix entre GPT-4 et GPT-4o dépend des exigences spécifiques de l'application.

Scénarios appropriés pour GPT-4

- Recherche approfondie:Idéal pour les tâches nécessitant une analyse complète et une génération de contenu détaillée.

- Creative Writing:Excelle dans la production de récits nuancés et sophistiqués.

Scénarios appropriés pour GPT-4o

- Support client en temps réel:Sa vitesse et ses capacités multimodales améliorent les interactions des utilisateurs.

- Communication multilingue:Efficace pour les applications ciblant des groupes démographiques linguistiques divers.

- Création de contenu multimédia:Capable de générer et d’interpréter diverses formes de contenu multimédia.

Quelles sont les limites et les défis de chaque modèle ?

Limites de GPT-4

Malgré ses avancées, GPT-4 présente des limites, notamment des biais sociaux, des hallucinations et une sensibilité aux sollicitations adverses. OpenAI est conscient de ces difficultés et continue de travailler à les résoudre grâce à des recherches et des mises à jour continues.

Les défis du GPT-4o

Bien que GPT-4o améliore de nombreux aspects de GPT-4, il peut compromettre la précision en raison de taux d'interaction plus élevés. Des utilisateurs ont signalé des cas où GPT-4o présente des hallucinations plus fréquentes que GPT-4, ce qui indique un compromis entre vitesse et précision.

Voir aussi Accès gratuit et illimité à ChatGPT-4o : est-ce possible ?

Conclusion

GPT-4 et GPT-4o représentent des étapes importantes dans l'évolution de l'intelligence artificielle, chacune offrant des atouts et des capacités uniques. GPT-4 offre une base solide grâce à son traitement multimodal et à ses capacités de raisonnement avancées, ce qui la rend adaptée aux tâches complexes et nuancées. À l'inverse, GPT-4o s'appuie sur cette base en améliorant l'efficacité, en intégrant de multiples formes de saisie et en réduisant les coûts opérationnels, ce qui en fait la solution idéale pour les applications nécessitant des interactions rapides et des contraintes budgétaires.

À mesure que l'IA évolue, il est essentiel de comprendre les différences entre des modèles comme GPT-4 et GPT-4o pour sélectionner l'outil le plus adapté à des applications spécifiques. Ces deux modèles contribuent au développement des capacités de l'IA, offrant des solutions diversifiées pour divers secteurs et cas d'utilisation.

Utilisez le API GPT-4o dans CometAPI

CometAPI donne accès à plus de 500 modèles d'IA, y compris des modèles multimodaux open source et spécialisés pour le chat, les images, le code, etc. Grâce à lui, l'accès aux principaux outils d'IA comme Claude, OpenAI, Deepseek et Gemini est disponible via un abonnement unique et unifié. Vous pouvez utiliser l'API de CometAPI pour créer de la musique et des illustrations, générer des vidéos et créer vos propres flux de travail.

API Comet proposer un prix bien inférieur au prix officiel pour vous aider à intégrer API GPT-4o (Nom du modèle : gpt-4o ;gpt-4o-all), et recevez 1 $ sur votre compte après votre inscription et votre connexion ! Bienvenue pour découvrir CometAPI. CometAPI est un service payant.API GPT-4o Dans CometAPI, la tarification est structurée comme suit :

- Jetons d'entrée : 2 $/M jetons

- Jetons de sortie : 8 $/M jetons