au 15 décembre 2025, les informations publiques indiquent que Google’s Gemini 3 Pro (aperçu) et OpenAI’s GPT-5.2 fixent tous deux de nouveaux jalons en raisonnement, multimodalité et gestion de longs contextes — mais empruntent des voies d’ingénierie différentes (Gemini → MoE clairsemé + contexte immense ; GPT-5.2 → conceptions denses/à « routage », compaction et modes de raisonnement xhigh) et arbitrent donc entre victoires maximales aux benchmarks vs. prédictibilité d’ingénierie, outillage et écosystème. Lequel est « meilleur » dépend de votre besoin principal : les applications agentiques multimodales à contexte extrême penchent vers Gemini 3 Pro ; l’outillage développeur d’entreprise stable, des coûts prévisibles et une disponibilité API immédiate favorisent GPT-5.2.

Qu’est-ce que GPT-5.2 et quelles sont ses principales fonctionnalités ?

GPT-5.2 est la version du 11 décembre 2025 de la famille GPT-5 d’OpenAI (variantes : Instant, Thinking, Pro). Il est présenté comme le modèle le plus performant de l’entreprise pour le « travail de connaissance professionnel » — optimisé pour les feuilles de calcul, présentations, raisonnement long-contexte, appels d’outils, génération de code et tâches de vision. OpenAI a rendu GPT-5.2 disponible aux utilisateurs payants de ChatGPT et via l’API OpenAI (Responses API / Chat Completions) sous des noms de modèles tels que gpt-5.2, gpt-5.2-chat-latest et gpt-5.2-pro.

Variantes du modèle et cas d’utilisation prévus

- gpt-5.2 / GPT-5.2 (Thinking) — meilleur pour le raisonnement complexe en plusieurs étapes (la variante par défaut « Thinking » utilisée dans la Responses API).

- gpt-5.2-chat-latest / Instant — latence plus faible pour l’assistance quotidienne et les usages de chat.

- gpt-5.2-pro / Pro — fidélité / fiabilité maximale pour les problèmes les plus difficiles (calcul supplémentaire, prend en charge

reasoning_effort: "xhigh").

Caractéristiques techniques clés (côté utilisateur)

- Améliorations en vision et multimodalité — meilleur raisonnement spatial sur les images et compréhension vidéo améliorée lorsqu’il est associé à des outils de code (outil Python), plus la prise en charge d’outils de type interpréteur de code pour exécuter des extraits.

- Effort de raisonnement configurable (

reasoning_effort: none|minimal|low|medium|high|xhigh) pour arbitrer latence/coût vs. profondeur.xhighest nouveau pour GPT-5.2 (et pris en charge sur Pro). - Gestion améliorée du long contexte et fonctions de compaction pour raisonner sur des centaines de milliers de tokens (OpenAI rapporte de bons scores MRCRv2 / métriques long-contexte).

- Appels d’outils avancés et workflows agentiques — meilleure coordination multi-tour, orchestration d’outils améliorée dans une architecture de type « méga-agent unique » (OpenAI met en avant les performances sur le benchmark Tau2).

Qu’est-ce que Gemini 3 Pro Preview ?

Gemini 3 Pro Preview est le modèle d’IA générative le plus avancé de Google, publié dans le cadre de la famille Gemini 3 en novembre 2025. Le modèle met l’accent sur la compréhension multimodale — capable de comprendre et synthétiser texte, images, vidéo et audio — et propose une large fenêtre de contexte (~1 million de tokens) pour gérer de vastes documents ou bases de code.

Google positionne Gemini 3 Pro comme l’état de l’art en profondeur et nuances de raisonnement, et il sert de moteur central pour de nombreux outils développeurs et d’entreprise, dont Google AI Studio, Vertex AI et des plateformes de développement agentique comme Google Antigravity.

À ce jour, Gemini 3 Pro est en aperçu — ce qui signifie que les fonctionnalités et l’accès continuent de s’étendre, mais le modèle affiche déjà de très bons résultats sur la logique, la compréhension multimodale et les workflows agentiques.

Caractéristiques techniques et produit clés

- Fenêtre de contexte : Gemini 3 Pro Preview prend en charge une entrée de 1,000,000 tokens (et jusqu’à 64k tokens en sortie), ce qui est un avantage pratique majeur pour ingérer des documents, livres ou transcriptions vidéo extrêmement volumineux en une seule requête.

- Fonctionnalités d’API : paramètre

thinking_level(low/high) pour arbitrer latence vs. profondeur de raisonnement ; paramètresmedia_resolutionpour contrôler la fidélité multimodale et l’usage de tokens ; ancrage recherche, contexte fichier/URL, exécution de code et appel de fonctions pris en charge. Les signatures de réflexion et la mise en cache du contexte aident à maintenir l’état sur des workflows multi-appels. - Mode Deep Think / raisonnement supérieur : une option « Deep Think » ajoute une passe de raisonnement supplémentaire pour pousser les scores sur les problèmes difficiles. Google publie Deep Think comme une voie de très haute performance distincte pour les problèmes complexes.;

- Prise en charge multimodale native : entrées texte, image, audio et vidéo avec un fort ancrage à la recherche et aux intégrations produit (scores Video-MMMU et autres benchmarks multimodaux mis en avant).

Aperçu rapide — GPT-5.2 vs Gemini 3 Pro

Tableau comparatif compact avec les faits les plus importants (sources citées).

| Aspect | GPT-5.2 (OpenAI) | Gemini 3 Pro (Google / DeepMind) |

|---|---|---|

| Fournisseur / positionnement | OpenAI — mise à niveau phare GPT-5.x axée sur le travail de connaissance professionnel, le code et les workflows agentiques. | Google DeepMind / Google AI — génération Gemini phare axée sur le raisonnement multimodal à très long contexte et l’intégration d’outils. |

| Principales variantes du modèle | Instant, Thinking, Pro (et commutation Auto entre elles). Pro ajoute un effort de raisonnement plus élevé. | Famille Gemini 3 incluant Gemini 3 Pro et modes Deep-Think ; focus multimodal / agentique. |

| Fenêtre de contexte (entrée/sortie) | Capacité d’entrée totale ~400,000 tokens ; jusqu’à 128,000 tokens de sortie / raisonnement (conçu pour documents & bases de code très longs). | Jusqu’à ~1,000,000 tokens d’entrée/fenêtre de contexte (1M) avec jusqu’à 64K tokens de sortie |

| Forces / focus clés | Raisonnement long-contexte, appels d’outils agentiques, codage, tâches structurées de bureau (feuilles de calcul, présentations) ; mises à jour sécurité/système. | Compréhension multimodale à grande échelle, raisonnement + composition d’images, contexte très large + mode de raisonnement « Deep Think », intégrations produits Google. |

| Capacités multimodales & image | Meilleure vision et ancrage multimodal ; optimisé pour l’usage d’outils et l’analyse de documents. | Génération d’images haute fidélité + composition avec raisonnement, édition multi-référence et rendu de texte lisible. |

| Latence / interactivité | Le fournisseur met en avant une inférence plus rapide et une meilleure réactivité (latence plus faible que les modèles GPT-5.x précédents) ; plusieurs paliers. | Google met en avant un service « Flash »/serving optimisé et des vitesses interactives comparables ; le mode Deep Think échange latence contre profondeur de raisonnement. |

| Différenciateurs notables | Niveaux d’effort de raisonnement (medium/high/xhigh), appels d’outils améliorés, génération de code de haute qualité, grande efficacité de tokens. | Contexte 1M tokens, ingestion multimodale native puissante (vidéo/audio), mode de raisonnement « Deep Think », intégrations serrées aux produits Google (Docs/Drive/NotebookLM). |

| Meilleurs usages typiques (court) | Analyse de longs documents, workflows agentiques, projets de code complexes, automatisation d’entreprise (feuilles de calcul/rapports). | Projets multimodaux extrêmement vastes, workflows agentiques à long horizon nécessitant 1M de contexte, pipelines image + raisonnement avancés. |

Comment GPT-5.2 et Gemini 3 Pro se comparent-ils sur le plan architectural ?

Architecture de base

- Benchmarks / évaluations de travail réel : GPT-5.2 Thinking a atteint 70,9 % de victoires/égalités sur GDPval (évaluation de travail de connaissance sur 44 métiers) et de grands gains sur les benchmarks d’ingénierie et de mathématiques vs les précédents GPT-5. Améliorations majeures en code (SWE-Bench Pro) et QA scientifique (GPQA Diamond).

- Outils & agents : prise en charge native renforcée de l’appel d’outils, exécution Python et workflows agentiques (recherche documentaire, analyse de fichiers, agents data science). 11x plus rapide / <1 % du coût vs des experts humains pour certaines tâches GDPval (mesure de valeur économique potentielle, 70,9 % vs. ~38,8 % auparavant), et gains concrets en modélisation de feuilles de calcul (+9,3 % sur une tâche d’analyste junior en banque d’investissement vs GPT-5.1).

- Gemini 3 Pro : Transformer Sparse Mixture-of-Experts (MoE). Le modèle active un petit ensemble d’experts par token, permettant une capacité totale de paramètres extrêmement grande avec un calcul par token sous-linéaire. Google précise dans sa fiche modèle que le design MoE clairsemé contribue fortement au profil de performance. Cette architecture rend possible d’augmenter beaucoup la capacité sans coût d’inférence linéaire.

- GPT-5.2 (OpenAI) : OpenAI continue d’utiliser des architectures de type Transformer avec des stratégies de routing/compaction dans la famille GPT-5 (un « routeur » déclenche différents modes — Instant vs Thinking — et l’entreprise documente des techniques de compaction et de gestion de tokens pour les longs contextes). GPT-5.2 met l’accent sur l’entraînement et l’évaluation pour « réfléchir avant de répondre » et la compaction pour les tâches à long horizon plutôt que d’annoncer un MoE clairsemé classique à grande échelle.

Implications des architectures

- Compromis latence & coût : les modèles MoE comme Gemini 3 Pro peuvent offrir une capacité de pointe par token plus élevée tout en maintenant un coût d’inférence plus bas pour de nombreuses tâches, car seul un sous-ensemble d’experts s’active. Ils peuvent toutefois complexifier le service et l’ordonnancement (équilibrage d’experts au démarrage à froid, E/S). L’approche de GPT-5.2 (dense/à routage avec compaction) favorise une latence prévisible et une ergonomie développeur — surtout intégrée aux outils établis d’OpenAI comme Responses, Realtime, Assistants et les APIs batch.

- Passage à l’échelle du long contexte : la capacité d’entrée 1M tokens de Gemini permet d’alimenter nativement des documents extrêmement longs et des flux multimodaux. Les ~400k de contexte combiné (entrée+sortie) de GPT-5.2 restent massifs et couvrent la plupart des besoins d’entreprise, mais sont inférieurs à la spécification 1M de Gemini. Pour de très grands corpus ou des transcriptions vidéo de plusieurs heures, la spécification de Gemini apporte un avantage clair.

Outils, agents et infrastructure multimodale

- OpenAI : intégration poussée pour l’appel d’outils, l’exécution Python, les modes de raisonnement « Pro » et des écosystèmes agentiques payants (ChatGPT Agents / intégrations d’entreprise). Forte focalisation sur les workflows centrés code et la génération de feuilles de calcul/diapositives comme sorties de premier plan.

- Google / Gemini : ancrage intégré à Google Search (fonction payante optionnelle), exécution de code, contexte URL et fichier, et contrôles explicites de la résolution média pour arbitrer tokens vs. fidélité visuelle. L’API propose

thinking_levelet d’autres réglages pour moduler coût/latence/qualité.

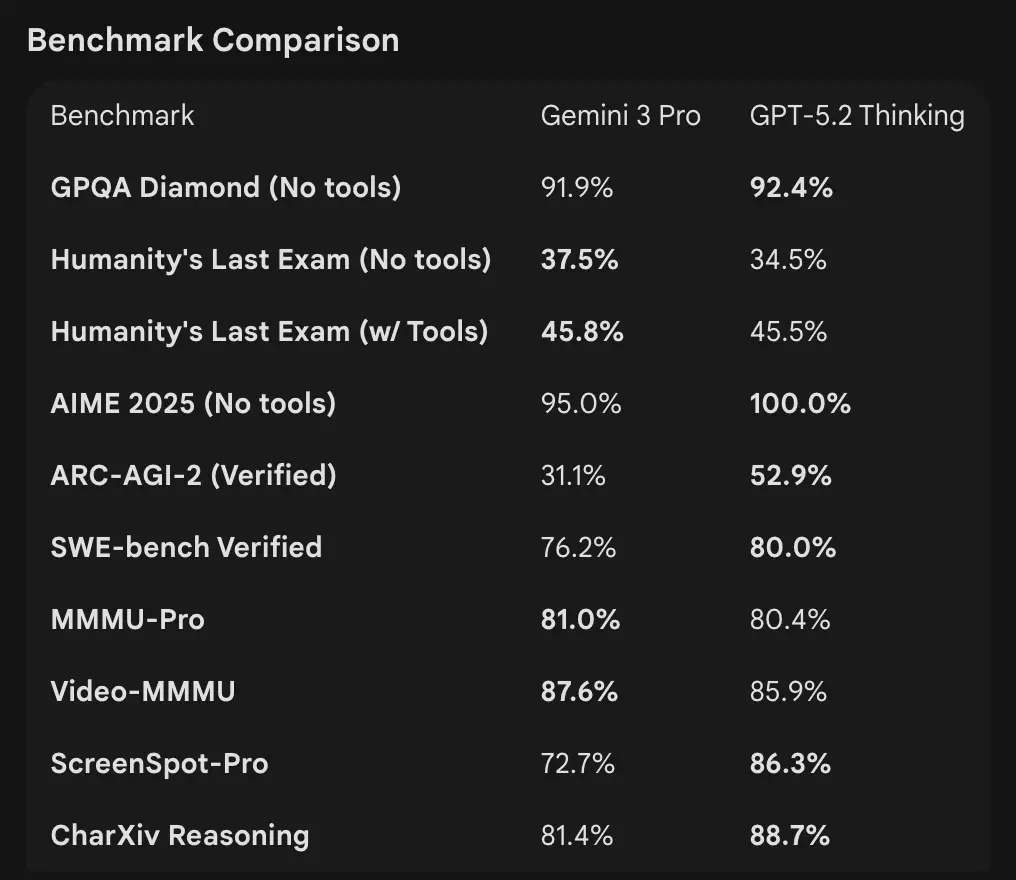

Comment les chiffres de benchmark se comparent

Fenêtres de contexte et gestion des tokens

- Gemini 3 Pro Preview : 1,000,000 tokens en entrée / 64k tokens en sortie (fiche modèle Pro preview). Date de coupure des connaissances : janvier 2025 (Google).

- GPT-5.2 : OpenAI démontre de solides performances long-contexte (scores MRCRv2 de 4k à 256k sur des tâches « aiguille dans la botte de foin » avec >85–95 % sur de nombreux réglages) et utilise des fonctions de compaction ; les exemples publics de contexte indiquent des performances robustes même à très grand contexte mais OpenAI liste des fenêtres spécifiques par variante (et met l’accent sur la compaction plutôt que sur un seul nombre 1M). Pour l’API, les noms de modèles sont

gpt-5.2,gpt-5.2-chat-latest,gpt-5.2-pro.

Benchmarks de raisonnement et agentiques

- OpenAI (sélection) : Tau2-bench Telecom 98,7 % (GPT-5.2 Thinking), forts gains en usage d’outils multi-étapes et tâches agentiques (OpenAI met en avant la consolidation de systèmes multi-agents en un « méga-agent »). GPQA Diamond et ARC-AGI montrent des sauts par rapport à GPT-5.1.

- Google (sélection) : Gemini 3 Pro : LMArena 1501 Elo, MMMU-Pro 81 %, Video-MMMU 87,6 %, GPQA élevé et scores Humanity’s Last Exam ; Google démontre aussi une planification long-horizon robuste via des exemples agentiques.

Outils & agents:

GPT-5.2 : prise en charge intégrée renforcée pour l’appel d’outils, l’exécution Python et les workflows agentiques (recherche documentaire, analyse de fichiers, agents data science). 11x plus rapide / <1 % du coût vs des experts humains pour certaines tâches GDPval (mesure de valeur économique potentielle, 70,9 % vs. ~38,8 % auparavant), et gains concrets en modélisation de feuilles de calcul (p. ex., +9,3 % sur une tâche d’analyste junior en banque d’investissement vs GPT-5.1).

Interprétation : les benchmarks sont complémentaires — OpenAI met l’accent sur des benchmarks de travail de connaissance réel (GDPval) montrant que GPT-5.2 excelle sur des tâches de production comme les feuilles de calcul, les diapositives et des séquences agentiques longues. Google met en avant les classements de raisonnement brut et des fenêtres de contexte monolithiques extrêmement grandes. Ce qui compte le plus dépend de votre charge : les pipelines d’entreprise agentiques et longs documents favorisent la performance GDPval prouvée de GPT-5.2 ; l’ingestion de contexte massif (par ex., des corpus vidéo entiers / des livres complets en un seul passage) favorise la fenêtre d’entrée 1M de Gemini.

Comment se comparent les capacités multimodales ?

Entrées & sorties

- Gemini 3 Pro Preview : prend en charge les entrées texte, image, vidéo, audio, PDF et des sorties texte ; Google fournit des contrôles

media_resolutiongranulaires et un paramètrethinking_levelpour régler le coût vs. la fidélité en multimodal. Plafond de sortie 64k tokens ; entrée jusqu’à 1M tokens. - GPT-5.2 : prend en charge des workflows vision et multimodaux riches ; OpenAI met en avant un meilleur raisonnement spatial (étiquettes estimées de composants d’image), la compréhension vidéo (scores Video MMMU) et une vision assistée par outils (l’outil Python sur les tâches de vision améliore les scores). GPT-5.2 souligne que les tâches vision + code complexes bénéficient fortement lorsque le support d’outils (exécution de code Python) est activé.

Différences pratiques

Granularité vs. ampleur : Gemini expose une série de réglages multimodaux (media_resolution, thinking_level) pour permettre aux développeurs d’ajuster les compromis par type de média. GPT-5.2 met en avant l’usage intégré des outils (exécuter Python dans la boucle) pour combiner vision, code et transformations de données. Si votre cas d’usage implique fortement la vidéo + l’analyse d’images avec des contextes extrêmement larges, la revendication 1M de Gemini est convaincante ; si vos workflows nécessitent d’exécuter du code dans la boucle (transformations de données, génération de feuilles de calcul), l’outillage code et la convivialité agentique de GPT-5.2 peuvent être plus pratiques.

Qu’en est-il de l’accès API, des SDK et de la tarification ?

OpenAI GPT-5.2 (API & tarification)

- API :

gpt-5.2,gpt-5.2-chat-latest,gpt-5.2-provia Responses API / Chat Completions. SDK établis (Python/JS), guides cookbook et écosystème mûr. - Tarifs (publics) : $1.75 / 1M tokens d’entrée et $14 / 1M tokens de sortie ; les remises de cache (90 % pour les entrées mises en cache) réduisent le coût effectif pour les données répétées. OpenAI met en avant l’efficacité en tokens (prix par token plus élevé mais moins de tokens nécessaires pour atteindre un seuil de qualité).

Gemini 3 Pro Preview (API & tarification)

- API :

gemini-3-pro-previewvia Google GenAI SDK et points de terminaison Vertex AI/GenerativeLanguage. Nouveaux paramètres (thinking_level,media_resolution) et intégration avec les ancrages Google et outils. - Tarifs (aperçu public) : Environ $2 / 1M tokens d’entrée et $12 / 1M tokens de sortie pour les paliers d’aperçu en dessous de 200k tokens ; des frais additionnels peuvent s’appliquer pour l’ancrage Search, Maps, ou d’autres services Google (la facturation de l’ancrage Search commence le 5 janv. 2026).

Utiliser GPT-5.2 et Gemini 3 via CometAPI

CometAPI est une passerelle / API agrégatrice : une unique API REST au format OpenAI qui donne un accès unifié à des centaines de modèles de nombreux fournisseurs (LLM, modèles image/vidéo, modèles d’embedding, etc.). Au lieu d’intégrer de multiples SDK, CometAPI permet d’appeler des endpoints au format OpenAI (chat/completions/embeddings/images) tout en changeant de modèle ou de fournisseur sous le capot.

Les développeurs peuvent profiter simultanément des modèles phares de deux entreprises différentes via CometAPI sans changer de fournisseur, et les prix de l’API sont plus abordables, généralement avec 20 % de réduction.

Exemple : extraits API rapides (copier-coller pour essayer)

Ci-dessous des exemples minimaux à exécuter. Ils reflètent les guides de démarrage publiés par les fournisseurs (OpenAI Responses API + client Google GenAI). Remplacez $OPENAI_API_KEY / $GEMINI_API_KEY par vos clés.

GPT-5.2 — Python (OpenAI Responses API, raisonnement réglé sur xhigh pour les problèmes difficiles)

# Python (requires openai SDK that supports responses API)from openai import OpenAIclient = OpenAI(api_key="YOUR_OPENAI_API_KEY")resp = client.responses.create( model="gpt-5.2-pro", # gpt-5.2 or gpt-5.2-pro input="Summarize this 50k token company report and output a 10-slide presentation outline with speaker notes.", reasoning={"effort": "xhigh"}, # deeper reasoning max_output_tokens=4000)print(resp.output_text) # or inspect resp to get structured outputs / tokens

Notes : reasoning.effort vous permet d’arbitrer coût vs. profondeur. Utilisez gpt-5.2-chat-latest pour un style chat Instant. La documentation OpenAI montre des exemples pour responses.create.

GPT-5.2 — curl (simple)

curl https://api.openai.com/v1/responses \ -H "Authorization: Bearer $OPENAI_API_KEY" \ -H "Content-Type: application/json" \ -d '{ "model": "gpt-5.2", "input": "Write a Python function that converts a PDF with tables into a normalized CSV with typed columns.", "reasoning": {"effort":"high"} }'

(Inspectez le JSON pour output_text ou des sorties structurées.)

Gemini 3 Pro Preview — Python (client Google GenAI)

# Python (google genai client) — example from Google docsfrom google import genaiclient = genai.Client(api_key="YOUR_GEMINI_API_KEY")response = client.models.generate_content( model="gemini-3-pro-preview", contents="Find the race condition in this multi-threaded C++ snippet: <paste code here>", config={ "thinkingConfig": {"thinking_level": "high"} })print(response.text)

Notes : thinking_level contrôle la délibération interne du modèle ; media_resolution peut être défini pour les images/vidéos. Des exemples REST et JS figurent dans le guide développeur Gemini de Google.;

Gemini 3 Pro — curl (REST)

curl "https://generativelanguage.googleapis.com/v1beta/models/gemini-3-pro-preview:generateContent" \ -H "x-goog-api-key: $GEMINI_API_KEY" \ -H "Content-Type: application/json" \ -X POST \ -d '{ "contents": [{ "parts": [{"text": "Explain the race condition in this C++ code: ..."}] }], "generationConfig": {"thinkingConfig": {"thinkingLevel": "high"}} }'

La documentation de Google inclut des exemples multimodaux (image inline data, media_resolution).

Quel modèle est « meilleur » — recommandations pratiques

Il n’y a pas de « vainqueur » universel ; choisissez plutôt selon le cas d’usage et les contraintes. Ci-dessous un court tableau de décision.

Choisissez GPT-5.2 si :

- Vous avez besoin d’une intégration étroite avec des outils d’exécution de code (écosystème d’interpréteur/outils d’OpenAI) pour des pipelines de données programmatiques, la génération de feuilles de calcul ou des workflows de code agentiques. OpenAI met en avant des améliorations de l’outil Python et l’usage d’un méga-agent agentique.

- Vous privilégiez l’efficacité en tokens selon les déclarations du fournisseur et souhaitez une tarification OpenAI par token explicite et prévisible avec de fortes remises sur les entrées mises en cache (utile pour les workflows batch/production).

- Vous voulez l’écosystème OpenAI (intégration produit ChatGPT, partenariats Azure / Microsoft, et outillage autour de Responses API et Codex).

Choisissez Gemini 3 Pro si :

- Vous avez besoin d’entrées multimodales extrêmes (vidéo + images + audio + PDF) et souhaitez un modèle unique acceptant nativement toutes ces entrées avec une fenêtre d’entrée de 1,000,000 tokens. Google le commercialise explicitement pour les longues vidéos, les pipelines gros documents + vidéo, et les cas d’usage interactifs Search/AI Mode.&

- Vous construisez sur Google Cloud / Vertex AI et voulez une intégration étroite avec l’ancrage Google Search, l’approvisionnement Vertex, et les APIs du client GenAI. Vous bénéficierez des intégrations produits Google (Search AI Mode, AI Studio, outillage agentique Antigravity).

Conclusion : lequel est meilleur en 2026 ?

Dans l’« affrontement » GPT-5.2 vs. Gemini 3 Pro Preview, la réponse est fonction du contexte :

- GPT-5.2 domine le travail de connaissance professionnel, la profondeur analytique et les workflows structurés.

- Gemini 3 Pro Preview excelle en compréhension multimodale, intégrations écosystème et tâches à grand contexte.

Aucun modèle n’est « meilleur » universellement — leurs forces répondent à des exigences réelles différentes. Les adopteurs avisés doivent faire correspondre le choix du modèle aux cas d’usage spécifiques, aux contraintes budgétaires et à l’alignement écosystémique.

Ce qui est clair en 2026, c’est que la frontière de l’IA a nettement progressé, et GPT-5.2 comme Gemini 3 Pro repoussent les limites de ce que les systèmes intelligents peuvent accomplir en entreprise et au-delà.

Si vous voulez essayer dès maintenant, explorez les capacités de GPT-5.2 et Gemini 3 Pro sur CometAPI dans le Playground et consultez le guide de l’API pour des instructions détaillées. Avant d’y accéder, assurez-vous de vous être connecté à CometAPI et d’avoir obtenu la clé API. CometAPI propose un prix bien inférieur au tarif officiel pour faciliter votre intégration.

Prêt à démarrer ?→ Essai gratuit de GPT-5.2 et Gemini 3 Pro !

Si vous souhaitez