Grok 3 et o3 représentent la nouvelle frontière de la modélisation en langage étendu, issue de deux des laboratoires d'IA les plus suivis aujourd'hui. Alors que xAI et OpenAI se disputent la suprématie en matière de raisonnement, de multimodalité et d'impact concret, comprendre les différences entre Grok 3 et o3 est crucial pour les développeurs, les chercheurs et les entreprises qui envisagent de les adopter. Cette comparaison approfondie explore leurs origines, leurs innovations architecturales, leurs performances de référence, leurs applications pratiques et leurs propositions de valeur, vous aidant à déterminer le modèle le mieux adapté à vos objectifs.

Quelles sont les origines et les délais de sortie de Grok 3 et o3 ?

Comprendre la genèse et les visions derrière Grok 3 et o3 ouvre la voie à l’appréciation de la manière dont chaque modèle a été positionné dans le paysage de l’IA.

Qu'est-ce que Grok 3

La série Grok de xAI a débuté comme un chatbot non protégé et sans règles sur X (anciennement Twitter). Grok 2.0 a introduit l'intégration FLUX.1, mais Grok 3 marque un tournant : il est explicitement présenté comme un « Agents de raisonnement » offrant une expertise approfondie dans les domaines de la finance, du codage et de l'extraction de textes juridiques. La vision d'Elon Musk privilégie le débat ouvert et la réduction des contraintes de contenu, permettant à Grok 3 de générer des informations controversées ou non filtrées lorsque cela est nécessaire. Le mode « Big Brain » exploite des passes de calcul supplémentaires, imitant la délibération humaine, et un nouveau moteur DeepSearch analyse les données Web et X en temps réel pour un contexte précis.

La série Grok de xAI a été conçue pour dépasser les agents conversationnels et s'ouvrir au raisonnement autonome. Grok 3, dévoilé en version bêta le 19 février 2025, a été présenté comme « notre modèle le plus avancé à ce jour », alliant des modules de raisonnement avancés à des connaissances pré-entraînées approfondies pour prendre en charge des dialogues et des tâches plus approfondis et contextuels. Elon Musk a souligné que Grok 3 « surpasse tous ses concurrents actuels en IA », notamment GPT-4o, Gemini et Claude d'Anthropic, le présentant comme un défi direct aux offres d'OpenAI.

Qu'est-ce que o3

La série o d'OpenAI remonte aux premières expériences d'enchaînement d'étapes de raisonnement avant de générer des réponses. Le 16 avril 2025, OpenAI a officiellement lancé o3 en même temps qu'o4-mini, soulignant leur capacité à « réfléchir plus longtemps avant de répondre » et à invoquer de manière agentive des outils et API externes, des fonctionnalités essentielles pour les flux de travail complexes et multimodaux. Sam Altman a salué o3, affirmant son intelligence de génie, témoignant de sa confiance dans la capacité du modèle à s'attaquer à des tâches traditionnellement réservées à des opérateurs humains experts.

La série O d'OpenAI a évolué suite à l'introduction de la chaîne de pensée privée par O1 fin 2024. L'architecture d'O3 conserve les fondations du transformateur, mais planifie les étapes d'inférence pour « penser » en interne avant de produire des réponses. Des sessions d'accès anticipé, de décembre 2024 à janvier 2025, ont permis de recueillir les commentaires des chercheurs en sécurité et d'affiner les paramètres afin d'équilibrer la latence et la précision du raisonnement. O3-mini, destiné aux applications sensibles aux coûts, maintient des objectifs de latence similaires à O1-mini tout en améliorant les capacités STEM. O3, réservé aux utilisateurs Pro et Entreprise, augmente le temps d'inférence pour les tâches complexes, incarnant ainsi la philosophie de développement incrémental mais soucieuse de la sécurité d'OpenAI.

En quoi leurs architectures de modèles et leurs stratégies de formation diffèrent-elles ?

Bien que les deux modèles s’appuient sur des fondations de transformateur, ils divergent en termes d’échelle, de mécanismes de raisonnement et d’intégrations multimodales.

Architecture de base

- Grok 3: Conserve une structure de transformateur à grande échelle, enrichie de couches de raisonnement sur mesure conçues pour séquencer explicitement les étapes inférentielles. Cette architecture vise à reproduire une chaîne de pensée humaine, mais à l'échelle de la machine.

- o3: Implémente un paradigme de raisonnement « agentique » dans lequel le modèle alloue dynamiquement l'effort de calcul sur plusieurs passes (faible, moyenne ou élevée) pour optimiser le compromis entre la latence de réponse et la profondeur de l'analyse.

Données de formation et échelle

- Grok 3:Selon xAI, Grok 3 a été formé sur environ 200,000 XNUMX GPU sur plusieurs semaines, englobant un mélange de texte à l'échelle du Web, de référentiels de code et d'ensembles de données multimédias organisés pour permettre une compréhension à la fois linguistique et visuelle.

- o3:S'appuyant sur le vaste corpus de données web et sous licence d'OpenAI, la formation d'o3 intègre également l'apprentissage par renforcement à partir du retour d'information humain (RLHF), spécialement conçu pour les tâches de raisonnement de haut niveau. Bien qu'OpenAI n'ait pas divulgué le nombre de GPU, les notes de version soulignent une mise à l'échelle efficace pour prendre en charge un niveau d'API destiné aux chercheurs et aux entreprises.

Capacités multimodales

- Grok 3:La version bêta a présenté des fonctionnalités de génération d'images et de recherche approfondie, suggérant que xAI vise un modèle unifié capable à la fois de comprendre et de créer du contenu visuel à côté du texte.

- o3: Prend en charge l'intégration complète des outils, permettant des appels en chaîne native aux API d'image, d'exécution de code et de base de connaissances d'OpenAI, offrant ainsi une approche modulaire de la multimodalité plutôt qu'un modèle monolithique tout-en-un.

Échelle du modèle, allocation des calculs et passes de raisonnement

L'affirmation de Grok 3 selon laquelle il dispose de « 10 fois plus de calcul » que Grok 2 s'appuie sur l'apprentissage par renforcement à grande échelle pour permettre une correction itérative des erreurs en quelques secondes ou minutes, les résultats étant agrégés par consensus à 64 % pour améliorer la précision. Cette approche reflète les méthodes d'ensemble : 64 réponses candidates sont générées et les plus fréquentes sont sélectionnées. O3, en revanche, intègre la chaîne de pensée comme étape de planification interne, évitant ainsi l'échantillonnage externe mais augmentant le calcul interne par jeton. La profondeur de raisonnement d'O3 est ajustée dynamiquement : les requêtes plus simples nécessitent moins d'étapes de « réflexion », tandis que les invites complexes déclenchent des délibérations internes plus longues.

Quel modèle offre des performances de référence supérieures ?

Références académiques et de codage

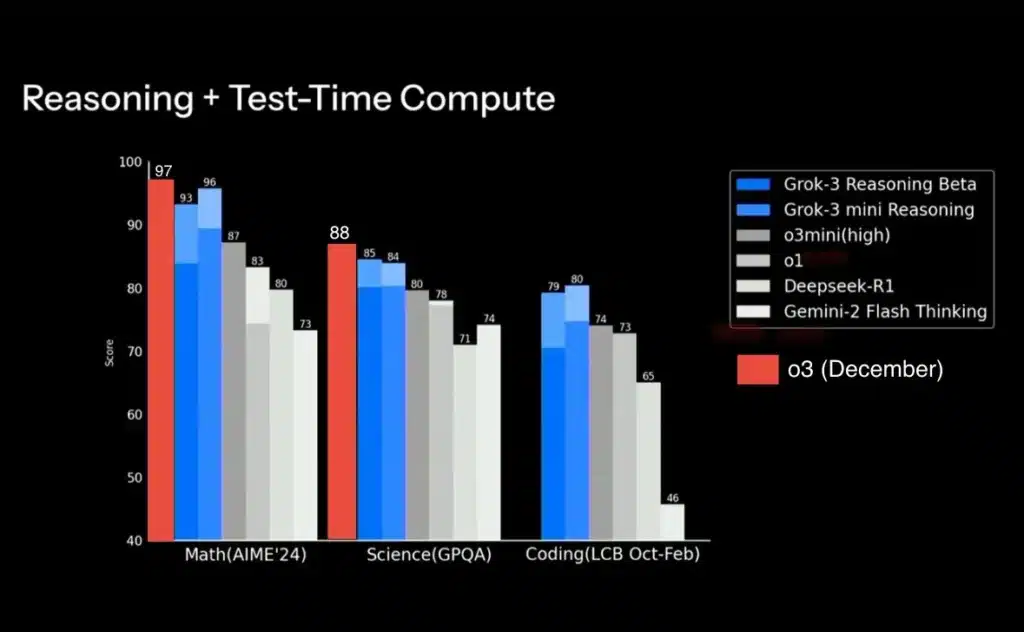

Lors du test de raisonnement mathématique AIME 2025, la méthode « consensus@3 » de Grok 64 a atteint une précision de 89.2 %, légèrement supérieure aux 3 % d'O87.3-mini-high lors du même examen. Lors des épreuves de codage, O3 a obtenu un Elo Codeforces de 2727 3, surpassant à la fois Grok 2500 (Elo estimé à environ 3 2300) et OXNUMX-mini (Elo à environ XNUMX XNUMX).

Préférences des utilisateurs du monde réel et tests contradictoires

xAI rapporte un score Elo Chatbot Arena de 1402 3 pour Grok 2 (testé contre des adversaires humains et IA), surpassant le score de 1203 3 de Grok 91 (x.ai). Les évaluations internes d'OpenAI montrent qu'O1 atteint un taux de satisfaction utilisateur de 3 % dans les études comparatives par rapport à O3, avec des gains notables dans les indicateurs de « profondeur d'explication » d'OpenAI. Cependant, des audits indépendants ont remis en question la méthodologie de référence de xAI, qui surreprésente les avantages de l'échantillonnage consensuel de Grok XNUMX sans variantes comparables pour OXNUMX, soulignant la nécessité de protocoles d'évaluation standardisés.

Dans quelles applications du monde réel ces modèles excellent-ils ?

Au-delà des repères, les tâches du monde réel illustrent la manière dont chaque modèle peut générer de la valeur dans tous les secteurs.

Flux de travail créatifs et de recherche

- Grok 3Les premiers critiques ont salué sa fonction de « recherche approfondie », qui permet de trouver des références académiques pointues et de générer des plans détaillés pour des contenus exigeants, tels que des articles techniques et des sujets d'écriture créative. La génération d'images intégrée permet également des cycles d'idéation fluides combinant texte et visuels.

- o3:Les développeurs exploitent son raisonnement multi-passes pour prototyper des modules logiciels complexes, déboguer des extraits de code et générer des visualisations de données via des appels en chaîne, rationalisant ainsi les flux de travail de recherche de bout en bout sans quitter l'environnement API.

Tâches scientifiques et de laboratoire

- Grok 3:Bien que la version bêta de xAI n'ait pas été testée de manière approfondie dans des contextes de laboratoire, son noyau de raisonnement amélioré est prometteur pour la génération d'hypothèses et les revues de littérature, réduisant potentiellement le temps que les scientifiques consacrent à l'exploration préliminaire des données.

- o3: Éprouvé dans le dépannage en virologie contrôlée, o3 peut contribuer à la conception de protocoles, à l'analyse des erreurs et à l'interprétation des données, agissant efficacement comme un assistant de laboratoire virtuel. Cependant, les organisations doivent mettre en place une gouvernance stricte pour atténuer les risques de biosécurité.

Quels écosystèmes et intégrations favorisent l’adoption ?

Grok 3 : intégration X et informations en temps réel

Grok 3 est profondément intégré aux offres Premium+ et SuperGrok de X, offrant des expériences de chatbot intégrées à l'application, des aperçus en mode vocal et un accès aux API d'entreprise via docs.x.ai. DeepSearch et bientôt DeeperSearch permettent aux professionnels d'interroger en temps réel les opinions sociales, les documents juridiques ou les données financières directement sans quitter X. Cependant, les lacunes en matière de modération de contenu ont suscité la controverse lorsque Grok 3 a généré de la désinformation ou du contenu offensant, incitant xAI à suggérer les prochaines couches de protection.

O3 : Déploiement multiplateforme et centré sur le développeur

OpenAI a déployé O3 sur ChatGPT (Plus, Pro, Enterprise) et les terminaux API, ainsi que sur des intégrations avec Microsoft Azure et GitHub Copilot. Les développeurs exploitent la chaîne de pensée d'O3 via des indicateurs SDK, permettant des passes de raisonnement sélectives par cas d'utilisation. La disponibilité gratuite d'O3-mini pour tous les utilisateurs de ChatGPT (avec des limites de débit) démocratise l'accès, tandis que les abonnés Pro débloquent le niveau de raisonnement « élevé ». Le téléchargement de fichiers et d'images étend encore l'applicabilité d'O3 à l'analyse de documents et aux réponses visuelles aux questions.

Comment les modèles de tarification se comparent-ils ?

Tarification centrée sur le modèle de xAI

L'API d'entreprise de Grok 3 a été lancée en avril 3 à 15 $ par million de jetons d'entrée et 2025 $ par million de jetons de sortie, avec des réductions pour les engagements de volume. Grok 3 mini est proposé à environ la moitié de ces tarifs, destiné aux projets à petit budget. Les utilisateurs X Premium+ paient 40 $/mois pour un accès prioritaire, tandis que les abonnés SuperGrok bénéficient d'une prime non divulguée pour des requêtes Grok « illimitées ».

La stratégie d'accès à plusieurs niveaux d'OpenAI

OpenAI intègre O3-mini dans les formules ChatGPT Plus (20 $/mois) et Pro (30 $/mois) : les utilisateurs de la formule Plus bénéficient d'un raisonnement de niveau intermédiaire, tandis que la formule Pro permet d'accéder au niveau supérieur sans frais supplémentaires. Les appels API O3 coûtent 6 $ par million de jetons, soit le double du tarif O1, mais la moitié du prix du jeton de sortie de Grok 3, ce qui reflète l'engagement d'OpenAI à équilibrer coûts et capacités. Cette approche par niveaux simplifie la budgétisation pour les startups et les chercheurs, mais au détriment d'un contrôle précis des niveaux de raisonnement exposés par xAI.

Grok 3 vs O3 : lequel choisir ?

Comparaison des performances : vitesse, évolutivité et fiabilité

| Mesure des performances | o3 | Grok 3 |

|---|---|---|

| Le temps de réponse | Moyenne de 120 ms sous charge | Moyenne de 90 ms sous charge |

| Évolutivité | Mise à l'échelle horizontale avec Kubernetes | Mise à l'échelle verticale avec mise en cache optimisée |

| Fiabilité de disponibilité | 99.95% SLA | 99.9% SLA |

| Débit (requêtes/sec) | 5000+ | 4500+ |

| Latence de traitement des données | 150 ms (mode batch) | 80 ms (streaming en temps réel) |

Le choix entre Grok 3 et o3 dépend des exigences spécifiques, des priorités stratégiques et de la tolérance au risque.

Recommandations basées sur des cas d'utilisation

- Pour une recherche approfondie et une créativité multimodale:Les capacités intégrées d'image et de recherche approfondie de Grok 3 le rendent idéal pour les agences de contenu, les studios de design et les institutions universitaires à la recherche d'un carnet de croquis tout-en-un pour l'idéation et le prototypage.

- Pour les flux de travail et les chaînes d'outils d'entreprise:L'intégration des outils agentiques d'o3 et l'accès immédiat aux API conviennent aux équipes logicielles, aux analystes financiers et aux laboratoires scientifiques qui nécessitent une augmentation modulaire et fiable au sein des pipelines existants.

Utiliser Grok 3 et O3 dans CometAPI

API Comet proposer un prix bien inférieur au prix officiel pour vous aider à intégrer API O3 (nom du modèle : o3/ o3-2025-04-16) et API Grok 3 (nom du modèle : grok-3;grok-3-latest;), et vous recevrez 1 $ sur votre compte après votre inscription et votre connexion ! Bienvenue pour vous inscrire et découvrir CometAPI.

Pour commencer, explorez les capacités du modèle dans le Playground et consultez le Guide de l'API Pour des instructions détaillées, veuillez noter que certains développeurs devront peut-être vérifier leur organisation avant d'utiliser le modèle.

La tarification dans CometAPI est structurée comme suit :

| Catégorie | API O3 | Grok 3 |

| Tarification des API | o3/ o3-2025-04-16 Jetons d'entrée : 8 $/M jetons Jetons de sortie : 32 $/M jetons | grok-3;grok-3-latest Jetons d'entrée : 1.6 $/M jetons Jetons de sortie : 6.4 $/M jetons grok-3-fast Jetons d'entrée : 4 $/M jetons Jetons de sortie : 20 $/M jetons |

Conclusion

Grok 3 et O3 incarnent les frontières actuelles du raisonnement IA. Grok 3 mise sur le calcul brut, l'intégration ouverte aux réseaux sociaux et des résultats non filtrés, s'adressant aux utilisateurs expérimentés et aux entreprises en quête d'informations en temps réel. O3, quant à lui, incarne une approche mesurée de la chaîne de pensée intégrée, une prise en charge étendue des plateformes et une tarification échelonnée favorisant une adoption généralisée. En fin de compte, le choix dépend des exigences du projet : Grok 3 excelle dans les environnements dynamiques et riches en données, tandis qu'O3 offre cohérence, sécurité et maturité de l'écosystème. À mesure que xAI et OpenAI peaufinent leurs modèles, les utilisateurs peuvent s'attendre à des avancées continues en termes de précision, d'efficacité et de multimodalité, façonnant la prochaine génération d'assistants IA.