Luma AI est devenu l'un des outils les plus prisés de la création de contenu grand public et prosommateur : une application et un service cloud qui convertit les photos et vidéos de smartphone en NeRF 3D photoréalistes et, grâce à ses modèles Dream Machine / Ray2, génère des images et de courtes vidéos à partir de textes ou d'images. Mais la rapidité est l'une des premières questions pratiques que se posent les créateurs : combien de temps prendront réellement une capture, un rendu ou une génération vidéo ?

Combien de temps faut-il à Luma AI pour générer un clip Dream Machine (texte → vidéo) ?

Temps de référence officiels

Les pages produits et le centre d'apprentissage de Luma fournissent des délais de référence rapides pour leurs pipelines de génération d'images et de courtes vidéos : les lots d'images sont mesurés en dizaines de secondes et les courtes vidéos en quelques secondes à quelques minutes dans des conditions normales pour les utilisateurs payants et les benchmarks internes. Ces mesures officielles reflètent les exécutions optimisées du modèle sur l'infrastructure de Luma (pile Ray2 / Dream Machine) et constituent les meilleurs résultats pour les clips courts et de petite taille.

Plages réelles auxquelles vous devez vous attendre

Cas limites / niveau gratuit ou charge de pointe:les utilisateurs gratuits ou les périodes de forte demande ont produit des attentes de heures ou des tâches bloquées en file d'attente jusqu'à ce que la capacité soit libérée ; les fils de discussion de la communauté documentent des attentes de plusieurs heures pendant les périodes de pointe ou les pannes. Si une faible latence est essentielle, tenez compte de cette variabilité et envisagez des options payantes ou prioritaires.

Petits clips sociaux (5 à 15 secondes): dans de nombreux cas, l'étape de génération à elle seule peut suffire moins d'une minute à quelques minutes pour les utilisateurs payants pendant une charge normale — mais le temps total d'horloge peut être plus long lorsque vous incluez les étapes de mise en file d'attente, de prétraitement et de streaming/exportation.

Clips plus détaillés ou plus longs (20 à 60 secondes): ceux-ci peuvent prendre quelques minutes à quelques dizaines de minutes, en particulier si vous demandez une résolution plus élevée, des mouvements de caméra complexes ou un perfectionnement itératif. Les avis de tiers et les témoignages d'utilisateurs indiquent des temps de traitement typiques. 5 à 30 minutes bande pour des vidéos courtes plus complexes.

Combien de temps faut-il à Luma AI pour produire une capture 3D (capture NeRF / Genie / Téléphone) ?

Flux de travail de capture 3D typiques et leurs profils temporels

Les outils de capture 3D de Luma (l'application mobile et les fonctionnalités de type Genie) transforment un ensemble de photos ou une vidéo enregistrée en un modèle 3D ou un maillage texturé de type NeRF. Contrairement aux courts clips de Dream Machine, la reconstruction 3D est plus complexe : elle doit intégrer de nombreuses images, estimer les poses de caméra, optimiser la géométrie volumétrique et synthétiser les textures. Des tutoriels publics et des guides pratiques sont disponibles. des temps de traitement réels allant de quelques minutes à plusieurs heures, selon la longueur et la qualité de la capture. Un exemple de tutoriel fréquemment cité montre 30 minutes à une heure pour une capture modérée ; d'autres types de capture (longues promenades, images haute résolution) peuvent prendre plus de temps.

Gammes représentatives

- Numérisations rapides d'objets/produits (20 à 80 photos, capture courte): quelques minutes à environ 30 minutes.

- Captures à l'échelle de la pièce ou de la promenade (des centaines à des milliers d'images): 30 minutes à plusieurs heures, en fonction de la taille de l'entrée et de la fidélité de l'exportation finale.

- Exportations haute fidélité pour les moteurs de jeu (maillages, textures haute résolution): ajouter du temps supplémentaire pour la génération de maillage, la retopologie et la cuisson — cela peut pousser les tâches dans le heures.

Pourquoi la 3D prend plus de temps que les vidéos courtes

La reconstruction 3D est itérative et nécessite une optimisation importante : le modèle affine les champs volumétriques et les prédictions de texture sur de nombreuses images, ce qui nécessite des calculs intensifs. Le backend de Luma parallélise une grande partie de ce travail, mais l'ampleur des calculs par tâche reste supérieure à celle d'une simple génération de courte vidéo.

Quels sont les principaux facteurs qui affectent le temps de traitement de Luma AI ?

Choix du modèle et du pipeline (Ray2, Photon, Genie, Modify Video)

Les différents modèles et fonctionnalités de Luma sont conçus pour des compromis différents : Ray2 et Dream Machine privilégient la génération de vidéos photoréalistes avec un retour interactif à faible latence, tandis que Photon et Genie sont optimisés pour l'amélioration d'images ou la reconstruction 3D et peuvent être plus lourds de par leur conception. Choisir un modèle avec des paramètres de fidélité plus élevés augmentera le temps de calcul. La documentation officielle et l'API décrivent plusieurs points de terminaison et indicateurs de qualité du modèle qui affectent l'exécution.

Taille et complexité des entrées

- Nombre de cadres / photos: plus d'entrées = plus d'étapes d'optimisation.

- Résolution: des résolutions de sortie plus élevées et des entrées à résolution plus élevée augmentent le temps de traitement.

- Durée du clip demandé: les clips plus longs nécessitent davantage de contrôles de rendu et de cohérence de mouvement.

Niveau de compte, mise en file d'attente et priorité

Les abonnements payants et les clients Entreprise/API bénéficient souvent de tarifs prioritaires ou plus élevés. Les utilisateurs de l'offre gratuite constatent généralement des temps d'attente plus longs lorsque le système est sous tension. Les rapports de la communauté le confirment : les forfaits payants réduisent généralement les temps d'attente et améliorent le débit.

Charge du système et heure de la journée

Les discussions d'utilisateurs réels montrent que les délais de génération peuvent augmenter considérablement aux heures de pointe ou lors des lancements de fonctionnalités majeures. L'équipe de Luma met constamment à jour l'infrastructure (voir les journaux des modifications) pour gérer les problèmes de capacité, mais des retards passagers persistent.

Temps de réseau/téléchargement et périphérique client

Pour les flux de capture, la vitesse de téléchargement et les performances de l'appareil sont importantes : les téléchargements de capture volumineux de plusieurs gigaoctets augmentent les délais de traitement. La documentation de Luma indique les tailles maximales de fichier et recommande les meilleures pratiques de capture pour minimiser les transferts de données inutiles.

Comment puis-je estimer le temps de travail à l'avance et réduire l'attente ?

Liste de contrôle d'estimation rapide

- Classez votre travail: image, vidéo courte (<15s), vidéo plus longue (>15s) ou capture 3D.

- Compter les entrées: nombre de photos / durée de la vidéo (secondes) / taille du fichier de capture.

- Décider de la qualité: basse, standard ou haute fidélité — fidélité supérieure = temps de calcul plus long.

- Vérifier le niveau du compte: gratuit vs payant vs entreprise ; tenir compte des files d'attente probables.

- Exécutez un court test: créez une tâche de test de 5 à 10 secondes pour recueillir une base de référence réelle.

Conseils pratiques pour accélérer le débit

- Utiliser les modèles de capture recommandés (mouvement de caméra fluide, éclairage cohérent) pour une reconstruction plus rapide. Le centre d'apprentissage et les pages de l'application mobile de Luma présentent les meilleures pratiques de capture.

- Réduire la taille de l'entrée lorsque cela est acceptable : recadrez, sous-échantillonnez ou rognez les images avant de les télécharger pour réduire le temps et les coûts de traitement.

- Choisissez des préréglages de qualité inférieure pour les brouillons, puis finalisez en haute qualité uniquement une fois que vous êtes satisfait de la composition.

- Planifiez des trajets lourds en dehors des heures de pointe si vous le pouvez ; les rapports de la communauté indiquent que les files d'attente diminuent en dehors des heures de pointe.

- Envisagez les options API/entreprise si vous avez besoin d'évolutivité et d'un SLA prévisible ; l'API et le journal des modifications de Luma montrent les investissements continus en matière de performances et de nouveaux points de terminaison comme Modify Video pour rationaliser les flux de travail.

Comment les chiffres de synchronisation de Luma se comparent-ils à ceux d'autres outils ?

Comparer les services d'images/vidéos génératives ou NeRF est complexe, car chaque fournisseur optimise ses performances en fonction de différents compromis (qualité, vitesse et coût). Pour la génération d'images et de vidéos très courtes, la Dream Machine de Luma, notamment avec Ray2 Flash, offre une latence interactive inférieure à la minute, comparable à celle des principaux services génératifs grand public. Pour la capture NeRF de scènes complètes et la création de modèles 3D haute fidélité, les besoins en cloud computing et les temps de mise en file d'attente sont plus élevés que pour les générateurs d'images rapides : prévoyez des variations plus importantes et planifiez en conséquence. La documentation des partenaires et les articles de tiers indiquent généralement minutes pour des rendus courts et simples et des heures (ou imprévisiblement plus longtemps) pour des pipelines 3D complexes.

Verdict final — combien de temps vont Luma prend pour my emploi?

Il n'existe pas de chiffre unique adapté à chaque utilisateur ou à chaque tâche. Utilisez ces ancrages pragmatiques pour estimer :

- Génération d'images (Dream Machine) : ~20 à 30 secondes par petit lot sous charge normale.

- Génération de courtes vidéos (Dream Machine / Ray2) : des dizaines de secondes à quelques minutes pour les clips courts ; Ray2 Flash peut être considérablement plus rapide sur les flux pris en charge.

- Capture 3D → NeRF : très variable. Meilleur cas: minutes pour un petit objet et un calcul léger ; pire des cas (signalé) : Plusieurs heures, voire plusieurs jours, en cas de forte demande ou de captures très volumineuses. Si vous avez besoin de délais précis, souscrivez à des forfaits prioritaires/d'entreprise ou effectuez des tests pilotes de préproduction et prévoyez des marges de sécurité dans votre planning.

Pour commencer

CometAPI est une plateforme d'API unifiée qui regroupe plus de 500 modèles d'IA provenant de fournisseurs leaders, tels que la série GPT d'OpenAI, Gemini de Google, Claude d'Anthropic, Midjourney, Suno, etc., au sein d'une interface unique et conviviale pour les développeurs. En offrant une authentification, un formatage des requêtes et une gestion des réponses cohérents, CometAPI simplifie considérablement l'intégration des fonctionnalités d'IA dans vos applications. Que vous développiez des chatbots, des générateurs d'images, des compositeurs de musique ou des pipelines d'analyse pilotés par les données, CometAPI vous permet d'itérer plus rapidement, de maîtriser les coûts et de rester indépendant des fournisseurs, tout en exploitant les dernières avancées de l'écosystème de l'IA.

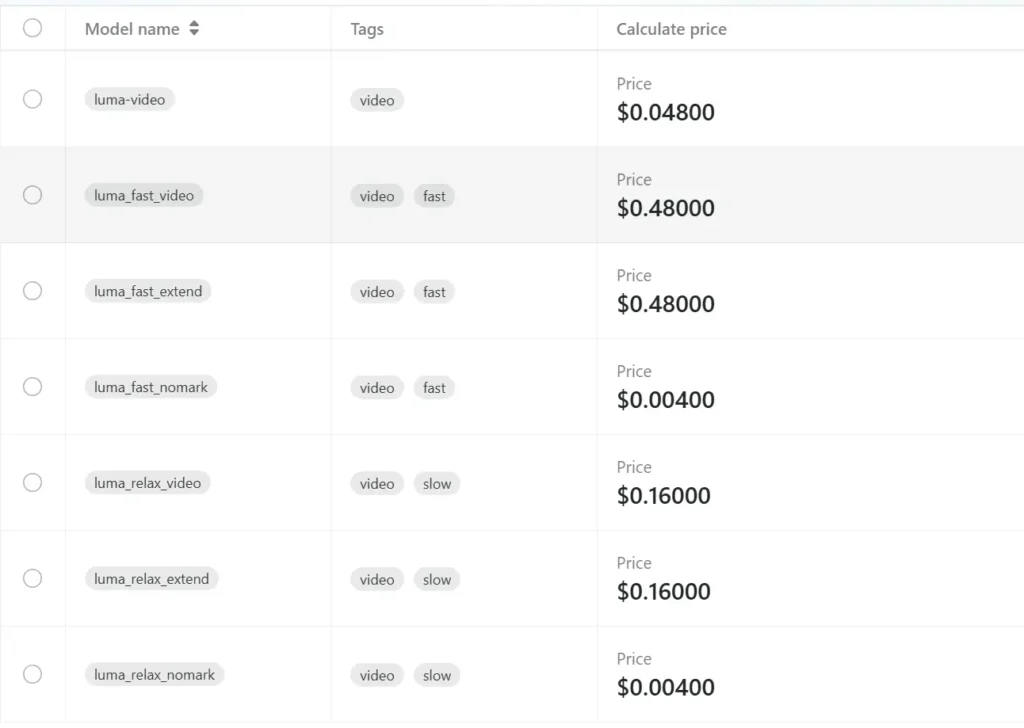

Les développeurs peuvent accéder API Luma à travers API CometLes dernières versions des modèles répertoriés sont celles en vigueur à la date de publication de l'article. Pour commencer, explorez les fonctionnalités du modèle dans la section cour de récréation et consultez le Guide de l'API Pour des instructions détaillées, veuillez vous connecter à CometAPI et obtenir la clé API avant d'y accéder. API Comet proposer un prix bien inférieur au prix officiel pour vous aider à intégrer :