GPT-5.5 Instant représente la dernière mise à niveau d’OpenAI pour l’intelligence du quotidien qui alimente ChatGPT. Publié le 5 mai 2026, il remplace GPT-5.3 Instant comme modèle par défaut pour des centaines de millions d’utilisateurs. Il fournit des réponses plus intelligentes et plus précises avec une réduction significative des hallucinations, tout en conservant l’expérience « instantanée » à faible latence attendue par les utilisateurs.

Pour les développeurs, entrepreneurs, créateurs de SaaS et équipes d’entreprise, cette mise à niveau du modèle ouvre de nouvelles possibilités d’intégration IA fiable sans sacrifier la vitesse ni faire exploser les coûts. Ce guide complet couvre tout, de l’accès rapide à ChatGPT à l’utilisation d’API de niveau production, avec des exemples pratiques et des stratégies d’optimisation.

Qu’est-ce que GPT-5.5 Instant et pourquoi c’est important

GPT-5.5 Instant est la variante rapide et efficace, optimisée pour les interactions quotidiennes, les réponses augmentées par la recherche, l’analyse d’images et le rappel de contexte personnalisé. Il alimente l’expérience ChatGPT par défaut tout en offrant des améliorations mesurables par rapport à son prédécesseur.

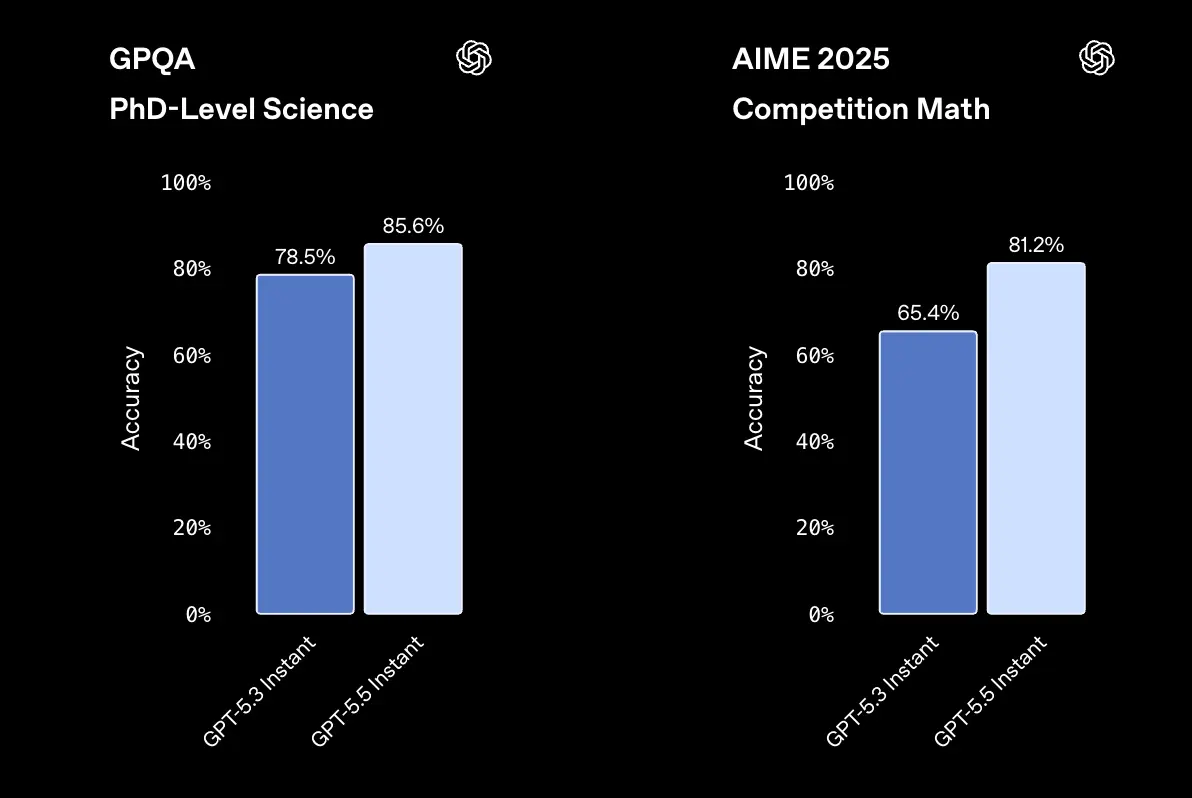

Principales améliorations (soutenues par les évaluations d’OpenAI) :

- GPT-5.5 Instant a produit 52.5% de déclarations hallucinées en moins que GPT-5.3 Instant sur des invites à forts enjeux

- 37.3% de réduction des affirmations inexactes dans des conversations difficiles.

- Meilleures performances en analyse photo/image, en questions STEM et dans la capacité à savoir quand invoquer la recherche web.

- Des réponses plus concises, naturelles et personnalisées, avec une meilleure gestion du contexte issu des discussions passées, des fichiers et de Gmail connecté.

Contrairement aux variantes plus lourdes GPT-5.5 (Thinking/Pro) conçues pour le raisonnement profond et les tâches agentiques complexes, GPT-5.5 Instant privilégie la vitesse et la fiabilité pour un usage général tout en offrant des gains de capacité substantiels.

GPT-5.5 Instant vs. GPT-5.5 vs. modèles précédents : tableau comparatif

| Feature/Model | GPT-5.5 Instant (Default) | GPT-5.5 (Full/Thinking) | GPT-5.3 Instant (Previous) |

|---|---|---|---|

| Primary Strength | Speed + Reliability | Deep Reasoning & Agents | General Use |

| Latency | Lowest | Higher | Low |

| Hallucination Reduction | 52.5% fewer (high-stakes) | Highest | Baseline |

| Personalization | Excellent (memory search) | Strong | Good |

| Image/STEM Performance | Significantly Improved | Superior | Good |

| API Pricing (approx.) | Competitive via providers | $5/$30 per M tokens | Lower |

| Best For | Chat, quick tasks, apps | Complex workflows | Legacy |

Quand choisir Instant : Applications quotidiennes, bots de support client, génération de contenu et interfaces sensibles à la latence.

Essentiellement, GPT-5.5 Instant et GPT-5.5 Thinking partagent la même architecture sous-jacente. La différence réside dans la profondeur de raisonnement, pas dans le niveau de connaissances. Les utilisateurs payants peuvent utiliser GPT-5.5 Thinking, tandis que les utilisateurs gratuits peuvent utiliser un quota limité de GPT-5.5 Instant sur ChatGPT.

Pour plus d’informations, veuillez consulter la présentation de GPT-5.5 et son mécanisme.

Comment accéder à GPT-5.5 Instant dans ChatGPT

Si vous utilisez ChatGPT directement, GPT-5.5 Instant est le modèle par défaut pour tous les utilisateurs connectés. OpenAI indique qu’il est en cours de déploiement pour tous les utilisateurs de ChatGPT et qu’il remplace GPT-5.3 Instant comme modèle par défaut. Cela signifie que de nombreux utilisateurs n’ont pas besoin de changer quoi que ce soit manuellement pour bénéficier de la nouvelle expérience Instant.

Pour les utilisateurs payants, ChatGPT propose un sélecteur de modèles permettant de choisir manuellement GPT-5.5 Instant ou GPT-5.5 Thinking (pour les utilisateurs payants, GPT‑5.3 Instant restera disponible pendant trois mois). Le centre d’aide d’OpenAI indique que les utilisateurs Plus, Pro et Business ont accès au sélecteur, tandis que GPT-5.5 Pro est réservé aux offres Pro, Business, Enterprise et Edu.

Les utilisateurs gratuits peuvent toujours utiliser GPT-5.5 dans ChatGPT, mais avec des limites d’utilisation. OpenAI indique que les comptes du palier Free peuvent envoyer jusqu’à 10 messages avec GPT-5.5 toutes les 5 heures, tandis que les utilisateurs Plus et Go peuvent envoyer jusqu’à 160 messages toutes les 3 heures. Après avoir atteint la limite, les discussions basculent vers la version mini de GPT-5.5 jusqu’à la réinitialisation de la limite. Les équipes Pro et Business ne basculeront pas et pourront continuer à utiliser GPT-5.5.

Si vous utilisez l’édition Pro ou Enterprise et souhaitez comparer les performances d’Instant et de Thinking sur une tâche réelle, ouvrez deux onglets côte à côte, épinglez un onglet pour chacun et entrez les mêmes invites dans les deux. La différence est particulièrement notable pour les tâches impliquant un raisonnement implicite en plusieurs étapes, car Thinking explore différentes branches de raisonnement avant de répondre. Pour le chat quotidien, Instant est plus rapide sur les réponses initiales.

Parcours d’accès pratique à ChatGPT

Pour la plupart des utilisateurs, le parcours est simple :

- Connectez-vous à ChatGPT.

- Utilisez l’expérience Instant par défaut.

- Sur les offres payantes, ouvrez le sélecteur de modèles si vous souhaitez choisir manuellement GPT-5.5 Instant.

- Ne passez à GPT-5.5 Thinking que lorsque la tâche nécessite réellement un raisonnement plus profond.

C’est le chemin côté utilisateur. Pour les équipes produit, la vraie question est de savoir comment opérationnaliser la même qualité dans votre propre application. C’est là que l’API entre en jeu.

Fonctionnalités avancées

- Mémoire et personnalisation : Le modèle s’appuie intelligemment sur l’historique de conversation, les fichiers téléversés et Gmail (lorsqu’il est connecté). Il décide quand la personnalisation apporte de la valeur.

- Analyse d’images : Téléversez des photos pour un raisonnement visuel amélioré.

- Intégration de la recherche web : Automatique lorsque nécessaire pour des informations à jour.

Astuce pro : Démarrez de nouvelles discussions pour une expérience par défaut la plus propre. Utilisez des instructions personnalisées dans les paramètres pour un ton et un contexte cohérents entre les sessions.

Comment accéder à GPT-5.5 Instant et l’utiliser via l’API

L’accès direct à l’API OpenAI utilise des alias de modèles comme chat-latest . chat-latest pointe vers le dernier modèle Instant actuellement utilisé dans ChatGPT. De nombreuses équipes préfèrent des fournisseurs unifiés comme CometAPI pour des coûts plus bas, des limites de débit plus élevées et une intégration simplifiée sur plusieurs modèles.

Dans l’API, GPT-5.5 Instant et GPT-5.5 Thinking se regroupent sous un identifiant de modèle unique : gpt-5.5. Il n’existe pas d’endpoint séparé gpt-5.5-instant. À la place, vous contrôlez la profondeur de raisonnement via le paramètre reasoning_effort, qui accepte minimal, low, medium ou high. Définir reasoning_effort: "minimal" est l’équivalent API le plus proche de l’expérience Instant dans ChatGPT.

GPT-5.5 est disponible via deux endpoints :

- Responses API (

/v1/responses) : l’endpoint recommandé pour les nouvelles intégrations, avec prise en charge de premier ordre des outils, des sorties structurées et du streaming. - Chat Completions API (

/v1/chat/completions) : l’endpoint hérité, conservé pour la compatibilité ascendante.

Configuration API pas à pas avec CometAPI (recommandée pour la plupart des équipes)

1. Inscription et récupération de votre clé API

- Visitez CometAPI.com et créez un compte.

- Accédez à la console/tableau de bord pour générer une clé API (commence par

sk-).

2. Exemple d’intégration basique (Python)

from openai import OpenAI

import os

client = OpenAI(

api_key=os.getenv("COMETAPI_KEY"), # Your CometAPI key

base_url="https://api.cometapi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.5", # or specific alias

messages=[

{"role": "system", "content": "You are a helpful, concise assistant."},

{"role": "user", "content": "Explain how GPT-5.5 Instant improves factuality."}

],

temperature=0.7,

max_tokens=500

)

print(response.choices[0].message.content)

3. Réponse en streaming pour une meilleure UX

stream = client.chat.completions.create(

model="gpt-5.5",

messages=[...],

stream=True

)

for chunk in stream:

if chunk.choices[0].delta.content is not None:

print(chunk.choices[0].delta.content, end="")

Les exemples en JavaScript, cURL et autres langages suivent des schémas de compatibilité similaires avec les SDK OpenAI.

Paramètres API clés pour GPT-5.5 Instant

- temperature : 0.0–1.0 (plus faible pour les tâches factuelles).

- reasoning_effort (si pris en charge dans certaines variantes) : low/medium pour un bon équilibre.

- tools/function calling : entièrement pris en charge pour les workflows agentiques.

- Vision : transmettez des URL d’images ou du base64 pour des invites multimodales.

Bonnes pratiques pour de meilleurs résultats

GPT-5.5 n’est pas un modèle « on écrit une invite vague et on croise les doigts ». Je recommande fortement une approche de prompting orientée résultat : précisez le résultat attendu, les critères de succès, les contraintes, les effets secondaires et le format de sortie. La documentation conseille également de réduire les consignes étape par étape, sauf si le processus lui-même fait partie des exigences du produit. En pratique, cela signifie décrire la destination plutôt que de micro-gérer chaque tournant.

Les sorties structurées sont un autre levier important. OpenAI recommande d’utiliser des sorties structurées au lieu de décrire le schéma dans l’invite, en particulier pour les systèmes de niveau production qui ont besoin d’une validation automatique et d’un parsage en aval plus fiable. C’est important pour les produits SaaS, car moins votre application passe de temps à nettoyer la sortie du modèle, plus votre UX devient stable.

Liste de contrôle de prompting pour GPT-5.5 Instant

Rédigez des invites qui :

- Énoncent clairement l’objectif.

- Définissent des critères d’acceptation.

- Mentionnent le format requis.

- Limite les instructions inutiles.

- Laissent au modèle la latitude de choisir la meilleure démarche.

Guide sur l’effort de raisonnement

OpenAI indique que medium est le paramètre par défaut et recommandé pour un équilibre, que low peut bien fonctionner pour de nombreuses charges de travail, que none convient aux tâches critiques en latence qui n’exigent pas de raisonnement, et que high ou xhigh doivent être réservés aux tâches où l’évaluation montre un gain de qualité mesurable. Ce conseil est subtil mais important : plus de raisonnement n’est pas automatiquement meilleur, surtout lorsque la tâche a des critères d’arrêt faibles ou un accès trop ouvert aux outils.

Un schéma de production utile

Pour le support client, les assistants de connaissance internes et l’automatisation de workflows, une configuration robuste est :

- Responses API pour l’état de la conversation

- Sorties structurées pour un parsage prévisible

- Effort de raisonnement ajusté selon le cas d’usage

- Mise en cache des prompts pour les préfixes répétés

- Outils hébergés là où ils s’intègrent au workflow

Cette combinaison fait que GPT-5.5 ressemble moins à un simple modèle de chat et davantage à un moteur de production.

Stratégies d’optimisation des coûts

- Mettre en cache les prompts/réponses courants.

- Utiliser des sorties structurées (mode JSON) pour un parsage fiable.

- Surveiller l’usage de tokens et choisir judicieusement les niveaux d’effort.

- Acheminer les requêtes simples vers des modèles plus légers et escalader vers Instant/GPT-5.5 selon les besoins.

Exemples d’implémentation pas à pas

1) Workflow ChatGPT

La façon la plus simple d’utiliser GPT-5.5 Instant est directement dans ChatGPT. Connectez-vous, laissez l’expérience Instant par défaut gérer le travail courant et passez au sélecteur de modèles sur les offres payantes si vous devez choisir manuellement GPT-5.5 Instant ou GPT-5.5 Thinking. OpenAI indique que l’expérience Instant par défaut est déjà optimisée pour les questions de recherche d’information, les guides, la rédaction technique et la traduction.

C’est l’option adaptée aux fondateurs, opérateurs et chefs de produit qui ont besoin de réponses rapides sans écrire de code. C’est aussi le meilleur endroit pour évaluer si le ton et la factualité de GPT-5.5 améliorent vos workflows typiques avant d’investir dans une intégration.

2) Workflow API direct

Pour le développement produit, utilisez la voie API. La documentation d’OpenAI indique de mettre à jour le slug du modèle vers gpt-5.5, d’utiliser la Responses API pour le raisonnement et l’usage d’outils, et de définir reasoning.effort de manière intentionnelle. La documentation mentionne également la mise en cache des prompts, les sorties structurées et la gestion multi-tours comme des composants clés d’une bonne intégration.

Une séquence d’implémentation pratique ressemble à ceci :

- Commencez avec une base d’invite neuve.

- Définissez le modèle sur

gpt-5.5. - Utilisez la Responses API.

- Ajoutez des sorties structurées si l’application nécessite des réponses lisibles par machine.

- Réglez

reasoning.effortselon vos objectifs de latence et de qualité. - Évaluez le comportement de bout en bout avant la mise en production.

3) Workflow de passerelle unifiée avec CometAPI

CometAPI se présente comme une plateforme d’agrégation d’API unifiée de style OpenAI, offrant l’accès à plus de 500 modèles d’IA via une interface unique, une seule clé API et une facturation à l’usage. Elle met en avant une friction d’intégration réduite, une seule authentification et la possibilité de changer de modèles sans ré-authentification ni travail de migration majeur.

Pour les équipes qui construisent des produits multi-modèles, cela compte. Au lieu d’enfermer votre pile dans l’intégration d’un seul fournisseur, une approche passerelle vous permet de standardiser la gestion des requêtes, de simplifier les expérimentations fournisseurs et de réduire la charge de maintenance liée à la prolifération de SDK spécifiques aux modèles.

CometAPI Avantages : tarification nettement inférieure (par ex., ~20% de réduction vs. l’officiel), une clé API pour 500+ modèles, limites de débit généreuses et un playground pour les tests. Idéal pour les startups qui montent en puissance sur des fonctionnalités IA sans factures OpenAI immédiatement élevées.

Si vous souhaitez connaître les changements de prix de GPT-5.5, voici une analyse détaillée des décompositions tarifaires de GPT-5.5.

FAQ

1. Comment accéder à GPT-5.5 Instant dans ChatGPT ?

GPT-5.5 Instant est le modèle par défaut pour tous les utilisateurs connectés, et les offres payantes peuvent sélectionner manuellement GPT-5.5 Instant ou GPT-5.5 Thinking via le sélecteur de modèles.

2. GPT-5.5 Instant est-il disponible dans l’API ?

OpenAI indique que GPT-5.5 Instant est en cours de déploiement dans l’API sous chat-latest, tandis que la documentation des modèles API utilise gpt-5.5 comme slug côté développeur.

3. Quelle est la différence entre GPT-5.5 Instant et GPT-5.5 Thinking ?

GPT-5.5 Instant est le modèle rapide et à faible latence, optimisé pour l’usage quotidien et ChatGPT. Les variantes GPT-5.5 (et Pro) offrent un raisonnement plus profond pour des tâches complexes et multi-étapes, avec une latence et un coût plus élevés. OpenAI indique que Thinking suit mieux les étapes précédentes et peut afficher un court préambule avant que le raisonnement ne commence.

4. Quelle API dois-je utiliser avec GPT-5.5 ?

OpenAI recommande la Responses API pour le raisonnement, l’appel d’outils et les cas d’usage multi-tours.

5. Quel réglage d’effort de raisonnement choisir pour commencer ?

OpenAI recommande de commencer avec medium, puis de tester low pour les charges sensibles à la latence, ou high et xhigh uniquement lorsque l’évaluation montre un gain de qualité mesurable.

6. GPT-5.5 peut-il gérer des workflows fortement outillés ?

Oui. OpenAI indique que GPT-5.5 est particulièrement utile sur de larges surfaces d’outils, des workflows de service multi-étapes et des tâches d’agent de longue durée, avec une meilleure précision dans la sélection des outils et l’utilisation des arguments.

7. Pourquoi une équipe utiliserait-elle CometAPI au lieu d’aller en direct ?

CometAPI se présente comme une passerelle unifiée de style OpenAI, avec une clé API unique, l’accès à 500+ modèles et une friction d’intégration moindre lors du changement de fournisseur.

Conclusion et prochaines étapes

GPT-5.5 Instant élève la barre de l’IA accessible et fiable. Que vous amélioriez les workflows ChatGPT ou que vous construisiez la prochaine génération de produits alimentés par l’IA, maîtriser son accès et son utilisation est essentiel.

Prêt à intégrer ? Commencez avec CometAPI pour un accès instantané à GPT-5.5 Instant et à toute la famille GPT-5.5 à des tarifs compétitifs. Inscrivez-vous gratuitement, explorez le playground et déployez en quelques minutes avec une compatibilité familière avec les SDK OpenAI.