En 2025–2026, le paysage des outils d’IA a continué de se consolider : les API passerelles (comme CometAPI) se sont étendues pour offrir un accès de style OpenAI à des centaines de modèles, tandis que les applications LLM destinées aux utilisateurs finaux (comme AnythingLLM) ont continué d’améliorer leur fournisseur “Generic OpenAI” afin de permettre aux applications de bureau et aux applications local-first d’appeler n’importe quel endpoint compatible OpenAI. Cela rend aujourd’hui simple le routage du trafic d’AnythingLLM via CometAPI et permet de bénéficier du choix de modèles, de l’acheminement par coût et de la facturation unifiée — tout en continuant d’utiliser l’interface locale d’AnythingLLM et ses fonctionnalités RAG/agents.

Qu’est-ce qu’AnythingLLM et pourquoi voudriez-vous le connecter à CometAPI ?

Qu’est-ce qu’AnythingLLM ?

AnythingLLM est une application d’IA open source, tout‑en‑un, ainsi qu’un client local/cloud pour créer des assistants de chat, des workflows de génération augmentée par la recherche (RAG) et des agents pilotés par LLM. Elle offre une interface soignée, une API pour développeurs, des fonctionnalités d’espaces de travail/agents, et la prise en charge des LLM locaux et cloud — conçue pour être privée par défaut et extensible via des plugins. AnythingLLM expose un fournisseur Generic OpenAI qui lui permet de dialoguer avec des API de LLM compatibles OpenAI.

Qu’est-ce que CometAPI ?

CometAPI est une plateforme commerciale d’agrégation d’API qui expose 500+ modèles d’IA au travers d’une interface REST de style OpenAI et d’une facturation unifiée. En pratique, elle vous permet d’appeler des modèles de multiples fournisseurs (OpenAI, Anthropic, variantes Google/Gemini, modèles image/audio, etc.) via les mêmes endpoints https://api.cometapi.com/v1 et une seule clé API (format sk-xxxxx). CometAPI prend en charge les endpoints standard de type OpenAI tels que /v1/chat/completions, /v1/embeddings, etc., ce qui facilite l’adaptation des outils prenant déjà en charge les API compatibles OpenAI.

Pourquoi intégrer AnythingLLM avec CometAPI ?

Trois raisons pratiques :

- Choix de modèles et souplesse vis‑à‑vis des fournisseurs : AnythingLLM peut utiliser « n’importe quel LLM compatible OpenAI » via son wrapper Generic OpenAI. Pointer ce wrapper vers CometAPI donne un accès immédiat à des centaines de modèles sans modifier l’UI ni les flux d’AnythingLLM.

- Optimisation des coûts/opérations : L’utilisation de CometAPI vous permet de changer de modèles (ou de basculer vers des modèles moins chers) de façon centralisée pour maîtriser les coûts, et de conserver une facturation unifiée au lieu de jongler avec plusieurs clés de fournisseur.

- Expérimentation plus rapide : Vous pouvez réaliser des tests A/B entre différents modèles (p. ex.

gpt-4o,gpt-4.5, variantes de Claude, ou des modèles multimodaux open source) via la même interface AnythingLLM — utile pour les agents, les réponses RAG, les résumés et les tâches multimodales.

Environnement et conditions à préparer avant l’intégration

Exigences système et logicielles (haut niveau)

- Un poste de travail ou un serveur exécutant AnythingLLM (Windows, macOS, Linux) — installation desktop ou instance auto‑hébergée. Vérifiez que vous utilisez une version récente exposant les paramètres LLM Preferences / AI Providers.

- Un compte CometAPI et une clé API (le secret au format

sk-xxxxx). Vous utiliserez ce secret dans le fournisseur Generic OpenAI d’AnythingLLM. - Une connectivité réseau depuis votre machine vers

https://api.cometapi.com(aucun pare‑feu ne doit bloquer le HTTPS sortant). - Optionnel mais recommandé : un environnement Python ou Node moderne pour les tests (Python 3.10+ ou Node 18+), curl, et un client HTTP (Postman / HTTPie) pour vérifier rapidement CometAPI avant de le brancher à AnythingLLM.

Conditions spécifiques à AnythingLLM

Le fournisseur LLM Generic OpenAI est la voie recommandée pour les endpoints qui imitent la surface de l’API d’OpenAI. La documentation d’AnythingLLM avertit que ce fournisseur est orienté développeurs et que vous devez comprendre les paramètres que vous fournissez. Si vous utilisez le streaming ou si votre endpoint ne le prend pas en charge, AnythingLLM inclut un réglage pour désactiver le streaming pour Generic OpenAI.

Liste de contrôle sécurité et opérations

- Traitez la clé CometAPI comme tout autre secret — ne la validez pas dans des dépôts ; stockez‑la dans les trousseaux du système ou des variables d’environnement lorsque c’est possible.

- Si vous prévoyez d’utiliser des documents sensibles dans le cadre du RAG, assurez‑vous que les garanties de confidentialité de l’endpoint répondent à vos exigences de conformité (consultez la documentation/les conditions de CometAPI).

- Déterminez des limites de tokens et de fenêtre de contexte pour éviter des factures incontrôlées.

Comment configurer AnythingLLM pour utiliser CometAPI (étape par étape) ?

Voici une séquence d’étapes concrètes — suivie d’exemples de variables d’environnement et d’extraits de code pour tester la connexion avant d’enregistrer les paramètres dans l’interface d’AnythingLLM.

Étape 1 — Obtenir votre clé CometAPI

- Inscrivez‑vous ou connectez‑vous sur CometAPI.

- Accédez à « API Keys » et générez une clé — vous obtiendrez une chaîne de type

sk-xxxxx. Gardez‑la secrète.

Étape 2 — Vérifier le fonctionnement de CometAPI avec une requête rapide

Utilisez curl ou Python pour appeler un endpoint simple de chat completion afin de confirmer la connectivité.

Exemple curl

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-xxxxx" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-4o",

"messages": ,

"max_tokens": 50

}'

Si cela renvoie un code 200 et une réponse JSON avec un tableau choices, votre clé et votre réseau fonctionnent. (La documentation de CometAPI présente la surface et les endpoints de type OpenAI).

Exemple Python (requests)

import requests

url = "https://api.cometapi.com/v1/chat/completions"

headers = {"Authorization": "Bearer sk-xxxxx", "Content-Type": "application/json"}

payload = {

"model": "gpt-4o",

"messages": ,

"max_tokens": 64

}

r = requests.post(url, json=payload, headers=headers, timeout=15)

print(r.status_code, r.json())

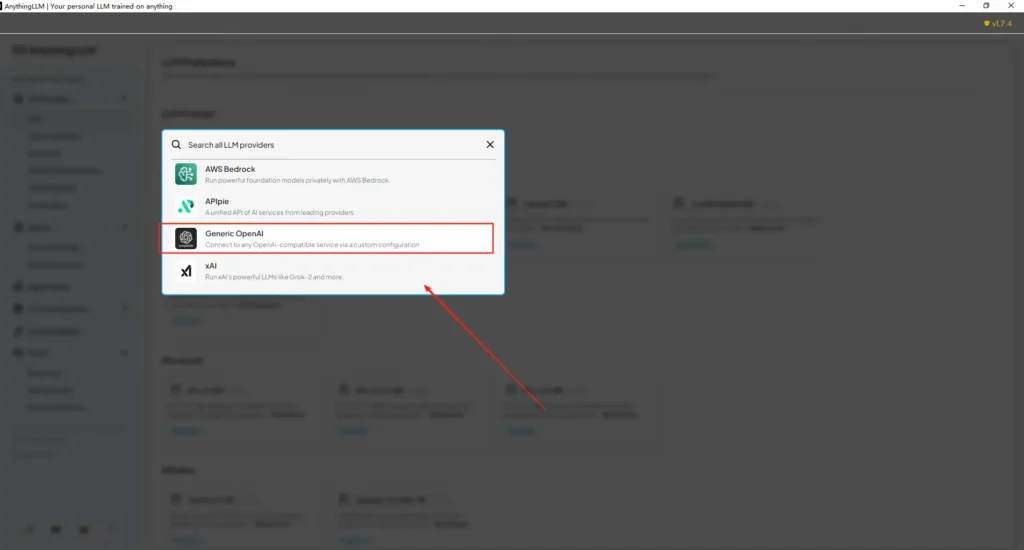

Étape 3 — Configurer AnythingLLM (UI)

Ouvrez AnythingLLM → Settings → AI Providers → LLM Preferences (ou chemin similaire selon votre version). Utilisez le fournisseur Generic OpenAI et renseignez les champs comme suit :

Configuration de l’API (exemple)

• Entrez dans le menu des paramètres d’AnythingLLM, et trouvez LLM Preferences sous AI Providers.

• Sélectionnez Generic OpenAI comme fournisseur de modèle, saisissezhttps://api.cometapi.com/v1dans le champ URL.

• Collez lesk-xxxxxde CometAPI dans le champ de clé API. Renseignez la fenêtre de contexte de tokens et Max Tokens en fonction du modèle choisi. Vous pouvez aussi personnaliser les noms de modèles sur cette page, par exemple en ajoutant le modèlegpt-4o.

Étape 4 — Définir les noms de modèles et les limites de tokens

Sur le même écran de paramètres, ajoutez ou personnalisez les noms de modèles exactement tels que publiés par CometAPI (par ex. gpt-4o, minimax-m2, kimi-k2-thinking) afin que l’interface d’AnythingLLM puisse présenter ces modèles aux utilisateurs. CometAPI publie des chaînes de modèles pour chaque fournisseur.

Étape 5 — Tester dans AnythingLLM

Démarrez une nouvelle conversation ou utilisez un espace de travail existant, sélectionnez le fournisseur Generic OpenAI (si vous en avez plusieurs), choisissez l’un des noms de modèle CometAPI que vous avez ajoutés, et lancez une invite simple. Si vous obtenez des complétions cohérentes, l’intégration est en place.

Comment AnythingLLM utilise ces paramètres en interne

Le wrapper Generic OpenAI d’AnythingLLM construit des requêtes de type OpenAI (/v1/chat/completions, /v1/embeddings), de sorte qu’une fois l’URL de base renseignée et la clé CometAPI fournie, AnythingLLM achemine de manière transparente les conversations, les appels d’agents et les requêtes d’embeddings via CometAPI. Si vous utilisez les agents d’AnythingLLM (les flux @agent), ils hériteront du même fournisseur.

Quelles sont les bonnes pratiques et les écueils possibles ?

Bonnes pratiques

- Utiliser des réglages de contexte adaptés au modèle : Alignez la fenêtre de contexte de tokens et Max Tokens d’AnythingLLM sur le modèle choisi dans CometAPI. Un mauvais appariement entraîne des troncatures inattendues ou des appels échoués.

- Sécuriser vos clés API : Stockez les clés CometAPI dans des variables d’environnement et/ou un gestionnaire de secrets/Kubernetes ; ne les validez jamais dans git. AnythingLLM stockera les clés dans ses paramètres locaux si vous les saisissez dans l’UI — considérez le stockage de l’hôte comme sensible.

- Commencer avec des modèles plus petits/moins coûteux pour les phases d’essai : Utilisez CometAPI pour tester des modèles à moindre coût en développement, et réservez les modèles premium pour la production. CometAPI met explicitement en avant le basculement selon les coûts et la facturation unifiée.

- Surveiller l’usage et définir des alertes : CometAPI fournit des tableaux de bord d’usage — définissez des budgets/alertes pour éviter les mauvaises surprises.

- Tester les agents et outils de façon isolée : Les agents d’AnythingLLM peuvent déclencher des actions ; testez‑les avec des invites sûres et d’abord sur des instances de staging.

Pièges courants

- Conflits entre l’UI et le fichier

.env: En auto‑hébergement, les paramètres de l’UI peuvent écraser les changements du.env(et inversement). Vérifiez le fichier généré/app/server/.envsi tout revient en arrière après un redémarrage. La communauté signale des réinitialisations deLLM_PROVIDER. - Incohérences de noms de modèle : L’utilisation d’un nom de modèle indisponible sur CometAPI provoquera une erreur 400/404 côté passerelle. Confirmez toujours les modèles disponibles dans la liste CometAPI.

- Limites de tokens et streaming : Si vous avez besoin de réponses en streaming, vérifiez que le modèle CometAPI le prend en charge (et que votre version d’AnythingLLM le supporte). Certains fournisseurs diffèrent dans la sémantique du streaming.

Quels cas d’usage concrets cette intégration permet-elle ?

Génération augmentée par la recherche (RAG)

Utilisez les chargeurs de documents d’AnythingLLM + une base vectorielle avec des LLM CometAPI pour produire des réponses contextuelles. Vous pouvez expérimenter avec des modèles d’embeddings économiques + des modèles de chat plus coûteux, ou tout conserver sur CometAPI pour une facturation unifiée. Les flux RAG d’AnythingLLM sont une fonctionnalité intégrée majeure.

Automatisation par agents

AnythingLLM prend en charge les workflows @agent (parcourir des pages, appeler des outils, exécuter des automatisations). Acheminer les appels LLM des agents via CometAPI vous donne le choix des modèles pour les étapes de contrôle/interprétation sans modifier le code des agents.

Tests A/B multi‑modèles et optimisation des coûts

Basculez de modèle par espace de travail ou par fonctionnalité (p. ex. gpt-4o pour les réponses de production, gpt-4o-mini pour le développement). CometAPI rend les changements de modèle triviaux et centralise les coûts.

Pipelines multimodaux

CometAPI propose des modèles image, audio et spécialisés. La prise en charge multimodale d’AnythingLLM (via ses fournisseurs) combinée aux modèles de CometAPI permet des flux de légendage d’images, de synthèse multimodale ou de transcription audio via la même interface.

Conclusion

CometAPI continue de se positionner comme une passerelle multi‑modèles (500+ modèles, API de type OpenAI) — ce qui en fait un partenaire naturel pour des applications comme AnythingLLM qui prennent déjà en charge un fournisseur Generic OpenAI. De même, le fournisseur Generic d’AnythingLLM et ses options de configuration récentes rendent la connexion à de telles passerelles simple. Cette convergence simplifie l’expérimentation et la migration vers la production fin 2025.

Comment commencer avec Comet API

CometAPI est une plateforme d’API unifiée qui agrège plus de 500 modèles d’IA de fournisseurs majeurs — tels que la série GPT d’OpenAI, Gemini de Google, Claude d’Anthropic, Midjourney, Suno, et bien d’autres — au sein d’une interface unique et adaptée aux développeurs. En offrant une authentification cohérente, un formatage des requêtes uniforme et une gestion standardisée des réponses, CometAPI simplifie considérablement l’intégration de capacités d’IA dans vos applications. Que vous construisiez des chatbots, des générateurs d’images, des compositeurs de musique ou des pipelines d’analytique pilotés par les données, CometAPI vous permet d’itérer plus vite, de maîtriser les coûts et de rester indépendant des fournisseurs — tout en profitant des dernières avancées de l’écosystème de l’IA.

Pour commencer, explorez les capacités des modèles de CometAPI dans le Playground et consultez le guide de l’API pour des instructions détaillées. Avant d’y accéder, assurez‑vous de vous être connecté à CometAPI et d’avoir obtenu la clé API. CometAPI propose un tarif bien inférieur au prix officiel pour faciliter votre intégration.

Prêt à vous lancer ? → Inscrivez‑vous à CometAPI dès aujourd’hui !

Pour plus d’astuces, de guides et d’actualités sur l’IA, suivez‑nous sur VK, X et Discord !