Anthropic a lancé Claude Opus 4.5 fin novembre 2025 en tant que modèle de classe Opus plus performant et plus efficace, destiné à l’ingénierie logicielle professionnelle, aux workflows agentiques et aux tâches de longue haleine. Il est disponible via la plateforme développeur d’Anthropic ainsi que via CometAPI, et il introduit de nouveaux contrôles API (notamment le paramètre effort), de meilleurs outils d’utilisation de l’ordinateur, une réflexion étendue, ainsi que des améliorations d’efficacité des tokens qui comptent en production.

Vous trouverez ci-dessous une présentation pratique et professionnelle : ce qui a changé, comment obtenir l’accès, comment utiliser les nouveaux contrôles (effort, réflexion étendue, utilisation d’outils, fichiers/utilisation de l’ordinateur), des conseils sur les coûts et l’optimisation, les considérations de sécurité/gouvernance, ainsi que des schémas d’intégration concrets.

Qu’est-ce exactement que Claude Opus 4.5 et pourquoi est-ce important ?

Claude Opus 4.5 est le plus récent membre de la famille de modèles de classe Opus d’Anthropic (sorti les 24–25 novembre 2025), axé sur une capacité maximale de raisonnement et de programmation, tout en améliorant l’efficacité des tokens et en offrant de nouveaux contrôles API pour équilibrer coût et exhaustivité. Anthropic présente Opus 4.5 comme le « modèle le plus intelligent » qu’elle ait publié, visant les tâches complexes d’ingénierie logicielle, les agents de longue durée, l’automatisation de tableurs/Excel et les tâches nécessitant un raisonnement soutenu en plusieurs étapes.

Quelles sont les principales nouveautés d’Opus 4.5 ?

Anthropic a conçu Opus 4.5 pour améliorer la profondeur du raisonnement et le comportement agentique, tout en donnant aux développeurs un meilleur contrôle sur les compromis coût/latence. Les points forts de cette version sont :

- Paramètre Effort (bêta) : un réglage API de premier plan qui contrôle la quantité de « budget de réflexion » que Claude consacre à une requête (généralement

low,medium,high). Il influence le raisonnement, les appels d’outils et les tokens internes de « réflexion », afin que vous puissiez ajuster la vitesse par rapport à l’exhaustivité requête par requête, plutôt que de changer de modèle. Il s’agit d’une capacité emblématique d’Opus 4.5. - Meilleure orchestration des agents et des outils : meilleure précision dans le choix des outils, appels d’outils mieux structurés et workflow de résultats d’outils plus robuste pour créer des agents et des pipelines en plusieurs étapes. Anthropic fournit une documentation et des conseils SDK pour le flux de « tool use ».

- Efficacité en tokens / coûts — Anthropic indique jusqu’à ~50 % de réduction de l’utilisation des tokens pour certains workflows par rapport à Sonnet 4.5, ainsi que moins d’erreurs d’appels d’outils et moins d’itérations pour les tâches d’ingénierie complexes.

- Capacités multimodales renforcées : améliorations globales des performances visuelles, de raisonnement et mathématiques.

- Fenêtre de contexte étendue à 200K tokens, prenant en charge des conversations longues et profondes ainsi que des analyses documentaires complexes.

Quelles capacités pratiques ont été améliorées ?

Amélioration des performances

- Meilleure orchestration des agents et des outils : meilleure précision dans le choix des outils, appels d’outils mieux structurés et workflow de résultats d’outils plus robuste pour créer des agents et des pipelines en plusieurs étapes. Anthropic fournit une documentation et des conseils SDK pour le flux de « tool use ». Une meilleure gestion du contexte, des assistants de compaction pour les longues exécutions d’agents, et des SDK d’outils natifs pour enregistrer et valider les outils signifient qu’Opus 4.5 est mieux adapté à la création d’agents fonctionnant sans supervision pendant de nombreuses étapes.

- Capacités multimodales renforcées : améliorations globales des performances visuelles, de raisonnement et mathématiques.

- Fenêtre de contexte étendue à 200K tokens, prenant en charge des conversations longues et profondes ainsi que des analyses documentaires complexes.

Codage et travail de longue durée

Opus 4.5 continue de s’appuyer sur des benchmarks pour les tâches de codage ; il réduit le nombre d’itérations et les erreurs d’appels d’outils pendant les tâches longues (migration de code, refactorisation, débogage en plusieurs étapes). Les premiers retours et la system card d’Anthropic signalent de meilleures performances soutenues sur les benchmarks d’ingénierie ainsi que des gains d’efficacité spectaculaires dans les pipelines pilotés par outils.

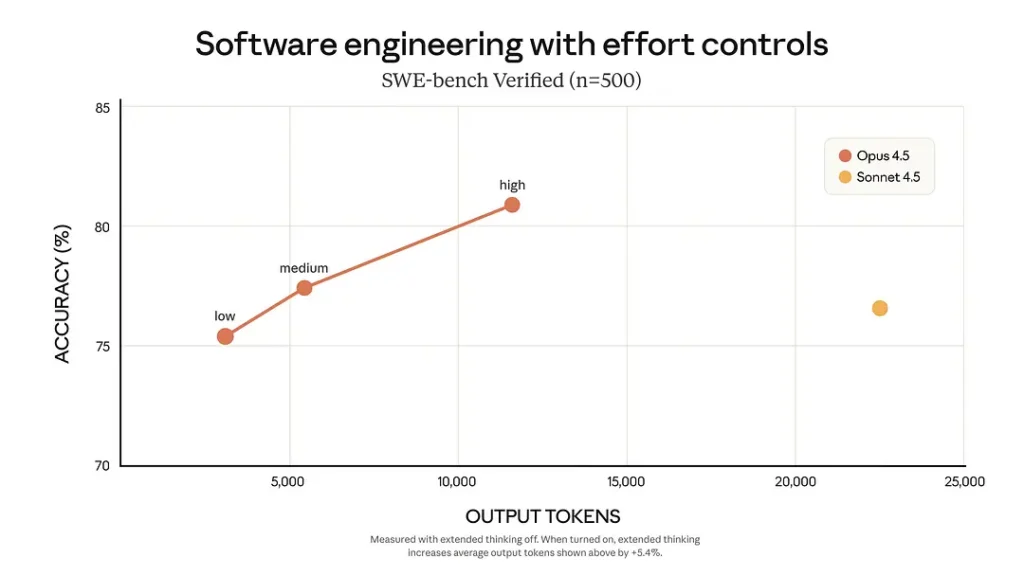

Dans SWE-bench , Opus 4.5 affiche des scores de premier plan sur les benchmarks d’ingénierie logicielle (Anthropic mentionne un score de 80,9 % sur SWE-bench Verified dans les documents de lancement), et les clients rapportent des améliorations en débogage, modifications multi-fichiers et tâches de code de longue haleine.

Coût et efficacité

Anthropic a conçu Opus 4.5 pour améliorer la profondeur du raisonnement et le comportement agentique tout en donnant aux développeurs un meilleur contrôle sur les compromis coût/latence :

- Réduction de prix par rapport à opus 4.1 : 5 $ (entrée) / 25 $ (sortie) par million de tokens.

- Amélioration de l’utilisation des tokens : réduction moyenne de 50–75 % de la consommation tout en maintenant les performances.

- un réglage API de premier plan qui contrôle la quantité de « budget de réflexion » que Claude consacre à une requête (généralement

low,medium,high). Il influence le raisonnement, les appels d’outils et les tokens internes de « réflexion », afin que vous puissiez ajuster la vitesse par rapport à l’exhaustivité requête par requête, plutôt que de changer de modèle. Il s’agit d’une capacité emblématique d’Opus 4.5 (Comparé à Sonnet 4.5 : Effort Medium → 76 % de tokens en moins, performances comparables ; Effort High → amélioration de performance de 4,3 %, réduction de 48 % de l’utilisation des tokens).

Comment accéder à l’API Claude Opus 4.5 et l’utiliser ?

Comment puis-je obtenir l’accès et les clés ?

- Créez un compte développeur Anthropic / Claude. Inscrivez-vous sur le portail développeur Claude/Anthropic et créez une clé API via la Console (des flux organisation/admin existent pour les équipes). L’API Messages est le point d’entrée principal pour les interactions de type chat/assistant.

- Partenaires cloud : Opus 4.5 est également disponible via les principales places de marché cloud Google Vertex AI, CometAPI(plateforme d’agrégation d’API IA, nécessite d’utiliser sa propre authentification)), Dans CometAPI, vous pouvez accéder à l’API Claude opus 4.5 via le format Anthropic Messages et le format Chat.

Comment dois-je authentifier mes requêtes ?

Utilisez des bearer tokens standards : incluez un en-tête Authorization: Bearer $_API_KEY avec chaque appel API. Les requêtes sont en JSON sur HTTPS ; l’API Messages accepte une liste de messages structurés (system + user + assistant).

Démarrage rapide — Python (SDK officiel)

Installez le SDK :

pip install anthropic

Exemple minimal (synchrone) :

import os

from anthropic import Anthropic

# attend ANTHROPIC_API_KEY dans l’environnement

client = Anthropic(api_key=os.environ)

resp = client.messages.create(

model="claude-opus-4-5-20251101",

messages=,

max_tokens=512,

)

print(resp.content.text) # le SDK renvoie des blocs de contenu structurés

Cet appel utilise l’identifiant canonique du modèle Opus 4.5. Pour les endpoints gérés par le fournisseur (Vertex, CometAPI, Foundry), suivez la documentation du fournisseur pour construire le client et fournir l’URL et la clé du fournisseur (par ex., https://api.cometapi.com/v1/messages pour CometAPI).

Démarrage rapide — Python (CometAPI)

Vous devez vous connecter à CometAPI et obtenir une clé.

curl

--location

--request POST 'https://api.cometapi.com/v1/messages' \

--header 'Authorization: Bearer ' \

--header 'Content-Type: application/json' \

--data-raw '{ "model": "claude-opus-4-5-20251101", "max_tokens": 1000, "thinking": { "type": "enabled", "budget_tokens": 1000 }, "messages": }'

Comment utiliser le nouveau paramètre effort et la réflexion étendue ?

Qu’est-ce que le paramètre effort et comment le définir ?

Le paramètre effort est un contrôle API de premier plan introduit avec Opus 4.5 qui ajuste la quantité de calcul interne et de budget de tokens que le modèle consacre à produire sa sortie. Les valeurs typiques sont low, medium et high. Utilisez-le pour équilibrer latence et coût en tokens par rapport à l’exhaustivité :

low— réponses rapides et économes en tokens pour l’automatisation à fort volume et les tâches routinières.medium— équilibre qualité/coût pour un usage en production.high— analyse approfondie, raisonnement en plusieurs étapes, ou lorsque la précision est primordiale.

Anthropic a introduit effort pour Opus 4.5 (bêta). Vous devez inclure un en-tête bêta (par ex., effort-2025-11-24) et spécifier output_config: { "effort": "low|medium|high" } (exemple ci-dessous). high est le comportement par défaut. Réduire l’effort diminue l’utilisation des tokens et la latence, mais peut modestement réduire l’exhaustivité. Utilisez-le pour les tâches à haut débit ou sensibles à la latence.

Exemple :

# Exemple utilisant l’API messages bêta montrée dans la documentation Anthropic

from anthropic import Anthropic

import os

client = Anthropic(api_key=os.getenv("ANTHROPIC_API_KEY"))

response = client.beta.messages.create(

model="claude-opus-4-5-20251101",

betas=, # en-tête bêta requis

messages=,

max_tokens=1500,

output_config={"effort": "medium"} # low | medium | high

)

print(response)

Quand utiliser quoi : utilisez low pour les pipelines automatisés (par ex. catégorisation d’e-mails), medium pour les assistants standards, et high pour la génération de code, la recherche approfondie ou les tâches sensibles au risque. Anthropic met en avant ce paramètre comme un contrôle clé pour Opus 4.5.

Dans le test SWE-bench :

- en mode Medium Effort : les performances sont comparables à Sonnet 4.5, mais les tokens de sortie sont réduits de 76 % ;

- en mode High Effort : les performances dépassent celles de Sonnet 4.5 d’environ 4,3 points de pourcentage, et les tokens sont réduits de 48 %.

Qu’est-ce que la réflexion étendue et comment l’invoquer ?

La réflexion étendue (également appelée « extended thinking » ou « thinking blocks ») permet au modèle d’effectuer des chaînes intermédiaires de pensée ou un raisonnement pas à pas tout en préservant ou résumant éventuellement les blocs de réflexion internes. L’API Messages prend en charge ce comportement et Anthropic a ajouté des contrôles pour préserver les blocs de réflexion précédents afin que les agents multi-tours puissent réutiliser un raisonnement antérieur sans répéter une recomputation coûteuse. Utilisez la réflexion étendue lorsque la tâche nécessite une planification en plusieurs étapes, une résolution de problèmes de longue haleine ou une orchestration d’outils.

Comment intégrer des outils et créer des agents avec Opus 4.5 ?

L’un des principaux points forts d’Opus 4.5 est l’amélioration du tool use : définissez des outils dans votre client, laissez Claude décider quand les appeler, exécutez l’outil, puis renvoyez le tool_result — Claude utilisera ces résultats dans sa réponse finale. Anthropic fournit des SDK Agent qui vous permettent d’enregistrer des fonctions d’outils typées (par ex. run_shell, call_api, search_docs) que Claude peut découvrir et appeler pendant la réflexion étendue. La plateforme convertit les définitions d’outils en fonctions appelables que le modèle peut invoquer et dont il peut recevoir les résultats. C’est ainsi que vous construisez des workflows agentiques en toute sécurité (avec des entrées/sorties contrôlées).

Vous trouverez ci-dessous un schéma pratique et un exemple Python de bout en bout.

Schéma d’utilisation des outils (conceptuel)

- Le client fournit les métadonnées

toolsavec le nom, la description et le schéma JSON (input_schema). - Le modèle renvoie un bloc

tool_use(l’instruction structurée du modèle pour appeler un outil particulier avec des entrées spécifiques). Dans la réponse API,stop_reasonpeut êtretool_use. - Le client exécute l’outil (votre code appelle l’API externe ou la fonction locale).

- Le client envoie un message de suivi avec

role:"user"et un bloc de contenutool_resultcontenant les sorties de l’outil. - Le modèle consomme le résultat de l’outil et renvoie la réponse finale ou d’autres appels d’outils.

Ce flux permet un contrôle sécurisé côté client sur ce que le modèle exécute (le modèle propose des appels d’outils ; vous contrôlez l’exécution).

Exemple de bout en bout — Python (outil météo simple)

# 1) Définir les métadonnées des outils et envoyer la requête initiale

from anthropic import Anthropic

import os, json

client = Anthropic(api_key=os.environ)

tools = [

{

"name": "get_weather",

"description": "Retourne la météo actuelle pour une ville donnée.",

"input_schema": {"type":"object","properties":{"city":{"type":"string"}},"required":}

}

]

resp = client.messages.create(

model="claude-opus-4-5-20251101",

messages=,

tools=tools,

max_tokens=800,

)

# 2) Vérifier si Claude veut appeler un outil

stop_reason = resp.stop_reason # champ SDK

if stop_reason == "tool_use":

# Extraire l’appel d’outil (le format varie selon le SDK ; ceci est schématique)

tool_call = resp.tool_calls # p. ex. {"name":"get_weather", "input":{"city":"Tokyo"}}

tool_name = tool_call

tool_input = tool_call

# 3) Exécuter l’outil côté client (ici : simulation)

def get_weather(city):

# Remplacez cette simulation par un véritable appel à une API météo

return {"temp_c": 12, "condition": "Partly cloudy"}

tool_result = get_weather(tool_input)

# 4) Renvoyer tool_result à Claude

follow_up = client.messages.create(

model="claude-opus-4-5-20251101",

messages=[

{"role":"user", "content":[{"type":"tool_result",

"tool_use_id": resp.tool_use_id,

"content": json.dumps(tool_result)}]}

],

max_tokens=512,

)

print(follow_up.content.text)

else:

print(resp.content.text)

Comment structurer vos agents pour plus de fiabilité ?

- Assainissez les entrées des outils (évitez les injections via les prompts).

- Validez les sorties des outils avant de les renvoyer au modèle (vérifications de schéma).

- Limitez le périmètre des outils (principe du moindre privilège).

- Utilisez des assistants de compaction (des SDK Anthropic) pour garder un contexte gérable sur les longues exécutions.

Comment concevoir les prompts et structurer les messages pour Opus 4.5 ?

Quels rôles de messages et quelles stratégies de préremplissage fonctionnent le mieux ?

Utilisez un schéma en trois parties :

- System (role: system) : instructions globales — ton, garde-fous, rôle.

- Assistant (optionnel) : exemples prédéfinis ou contenu d’amorçage.

- User (role: user) : la requête immédiate.

Préremplissez le message system avec des contraintes (format, longueur, politique de sécurité, schéma JSON si vous souhaitez une sortie structurée). Pour les agents, incluez les spécifications des outils et des exemples d’utilisation afin qu’Opus 4.5 puisse appeler correctement ces outils.

Comment utiliser la compaction du contexte et le prompt caching pour économiser des tokens ?

- Compaction du contexte : compressez les parties plus anciennes d’une conversation en résumés concis que le modèle peut toujours utiliser. Opus 4.5 prend en charge l’automatisation de la compaction du contexte sans perdre les blocs de raisonnement critiques.

- Prompt caching : mettez en cache les réponses du modèle pour les prompts répétés (Anthropic fournit des schémas de prompt caching pour réduire latence/coût).

Ces deux fonctionnalités réduisent l’empreinte en tokens des interactions longues et sont recommandées pour les workflows agentiques de longue durée et les assistants en production.

Gestion des erreurs et bonnes pratiques

Vous trouverez ci-dessous des recommandations pragmatiques de fiabilité et de sécurité pour l’intégration en production avec Opus 4.5.

Fiabilité et nouvelles tentatives

- Gérez les limitations de débit (HTTP 429) avec un backoff exponentiel et du jitter (commencez à 500–1000 ms).

- Idempotence : pour les appels LLM non mutatifs, vous pouvez relancer en toute sécurité, mais soyez prudent dans les workflows où le modèle déclenche des effets de bord externes (appels d’outils) — dédupliquez en suivant

tool_use_idou vos propres identifiants de requête. - Stabilité du streaming : gérez les flux partiels et reconnectez-vous proprement ; en cas d’interruption, il est préférable de relancer toute la requête ou de reprendre à l’aide de l’état au niveau applicatif pour éviter des interactions d’outils incohérentes.

Sécurité et sûreté

- Prompt injection et sécurité des outils : n’autorisez jamais le modèle à exécuter directement des commandes shell arbitraires ou du code sans validation. Validez toujours les entrées des outils et assainissez les sorties. Le modèle propose des appels d’outils ; votre code décide de les exécuter ou non. La system card et la documentation d’Anthropic décrivent les contraintes d’alignement et les niveaux de sécurité — suivez-les pour les domaines à haut risque.

- Gestion des données et conformité : traitez les prompts et les entrées/sorties d’outils contenant des PII ou des données réglementées conformément à votre politique juridique/de conformité. Utilisez les contrôles VPC/entreprise du fournisseur si vous avez des exigences strictes en matière de résidence des données ou d’audit (Bedrock / Vertex / Foundry proposent des options entreprise).

Observabilité et contrôle des coûts

- Journalisez les métadonnées de requête/réponse (pas le contenu sensible brut, sauf si autorisé) — nombre de tokens, niveau

effort, latence, identifiant du modèle et fournisseur. Ces métriques sont essentielles pour l’attribution des coûts et le débogage. - Utilisez effort pour contrôler le coût par appel : privilégiez

loweffort pour les résumés routiniers ou les endpoints à fort QPS ; utilisezhigheffort pour le débogage approfondi ou les investigations. Surveillez la qualité par rapport à la consommation de tokens afin de choisir les valeurs par défaut pour différents endpoints.

Conclusion — Quand (et comment) choisir Opus 4.5 ?

Claude Opus 4.5 est un choix naturel lorsque votre produit a besoin de :

- raisonnement approfondi en plusieurs étapes (longues chaînes logiques, recherche ou débogage),

- orchestration robuste d’agents/d’outils (workflows complexes invoquant des API externes), ou

- assistance au code de niveau production sur de larges bases de code.

Sur le plan opérationnel, utilisez effort pour ajuster les budgets par appel ; appuyez-vous sur le schéma d’utilisation des outils pour conserver la sécurité d’exécution et choisissez un partenaire cloud (ou l’API Anthropic directe) en fonction de vos besoins de conformité. Évaluez avec votre propre corpus : les chiffres des fournisseurs (SWE-bench, etc.) sont des signaux utiles, mais votre tâche réelle et vos données déterminent le ROI. Pour la sécurité, suivez la system card d’Opus 4.5 et placez des garde-fous autour de l’exécution des outils et du traitement des PII.

Les développeurs peuvent accéder à l’API Claude Opus 4.5 via CometAPI. Pour commencer, explorez les capacités du modèle de CometAPI dans le Playground et consultez le guide API pour des instructions détaillées. Avant d’y accéder, veuillez vous assurer que vous vous êtes connecté à CometAPI et que vous avez obtenu la clé API. CometAPI propose un prix bien inférieur au prix officiel pour vous aider à intégrer.

Prêt à démarrer ?→ Inscrivez-vous à CometAPI dès aujourd’hui !

Si vous souhaitez connaître plus d’astuces, de guides et d’actualités sur l’IA, suivez-nous sur VK, X et Discord !