Le 5 février 2026, Anthropic a dévoilé Claude Opus 4.6, le nouveau porte-étendard de la famille Claude. Opus 4.6 mise encore davantage sur le travail de connaissance à long terme et les workflows logiciels agentiques : il est livré avec une fenêtre de contexte bêta de 1,000,000 jetons, une coordination multi-agents affinée appelée Agent Teams, et un système de raisonnement adaptatif (Adaptive Thinking) régulé par un contrôle effort. Le modèle est disponible via la Claude Developer Platform et des API d’agrégation tierces (par exemple, CometAPI) et est présenté comme une mise à niveau plug-and-play pour de nombreux cas d’usage de Claude.

Qu’est-ce que Claude Opus 4.6

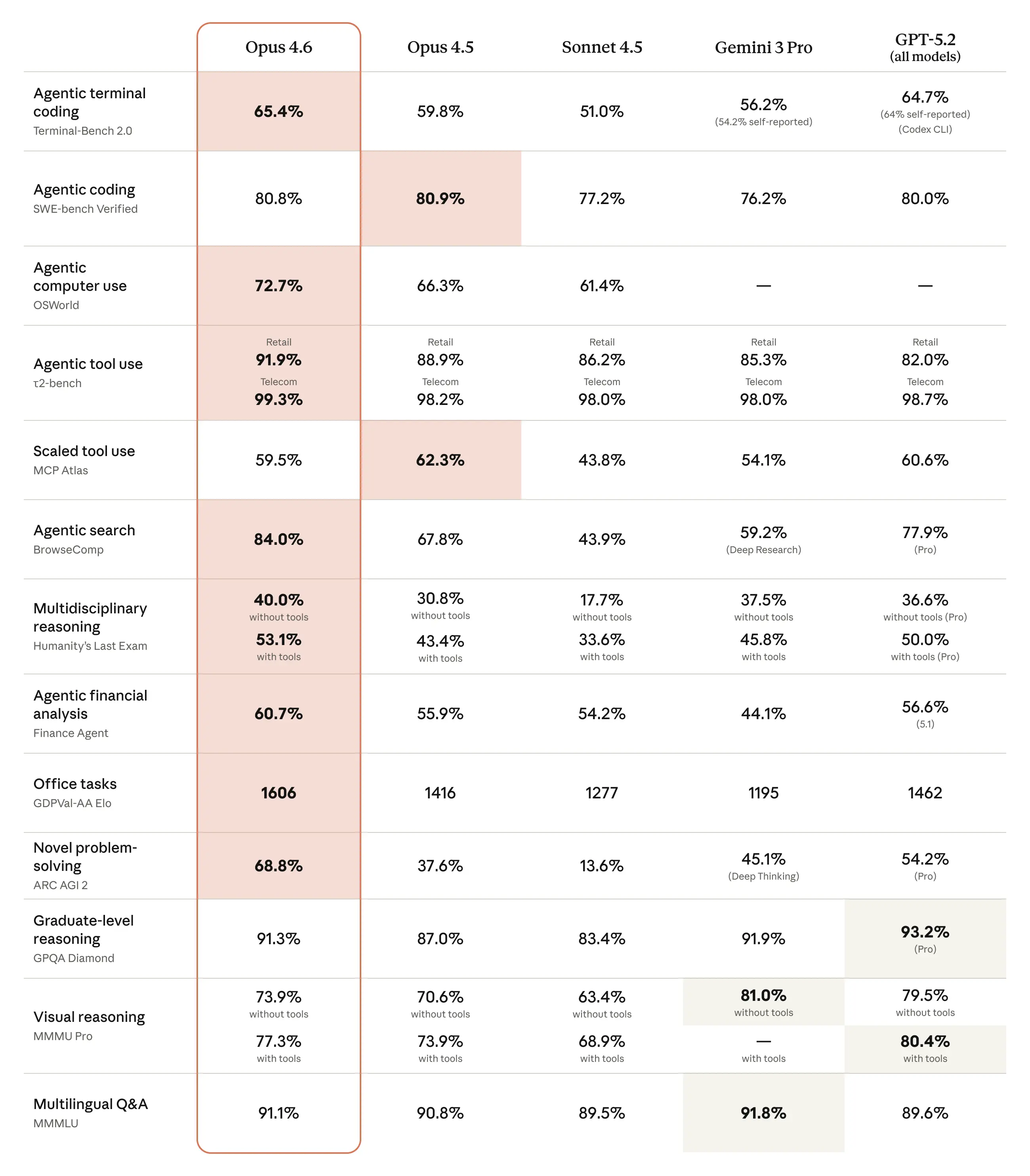

Claude Opus 4.6 est le dernier modèle de classe Opus d’Anthropic, présenté comme leur modèle le plus performant à ce jour pour le codage, les workflows agentiques et le raisonnement sur de longs contextes. Cette version privilégie les tâches « agentiques » de longue durée (pensez aux migrations de code en plusieurs étapes, aux refactorisations multi-fichiers, ou à des agents de recherche coordonnés), le traitement intensif de documents et les intégrations entreprise. Anthropic décrit Opus 4.6 comme une quasi mise à niveau “drop-in” depuis 4.5, mais avec plusieurs changements de comportement et de capacités importants pour les implémenteurs.

Capacités clés de Claude Opus 4.6 à connaître immédiatement

- Fenêtre de contexte de 1M de jetons (bêta) : Opus 4.6 introduit une fenêtre de contexte très large (Anthropic la propose en bêta), permettant au modèle de voir et raisonner sur des documents extrêmement volumineux ou des bases de code entières en une seule session. Cela rend des tâches telles que des refactorisations de référentiel complet, de longues revues juridiques et des synthèses multi-documents bien plus pratiques.

- Agent Teams : Opus 4.6 étend les capacités d’agents en permettant des groupes coordonnés d’agents (Agent Teams) — plusieurs agents Claude travaillant en parallèle sur des sous-tâches différentes et partageant l’état. L’objectif est d’aider les systèmes à décomposer des problèmes difficiles (p. ex., un agent dédié à la création de tests, un autre au refactoring, un troisième à l’assurance qualité) et à coordonner leurs sorties.

- Adaptive Thinking (niveaux d’effort) : Au lieu d’un simple interrupteur binaire « thinking », Opus 4.6 expose plusieurs niveaux d’effort (p. ex., low/medium/high/max) qui échangent latence et coût contre un enchaînement de pensée plus profond et un raisonnement plus délibératif. Anthropic expose également des mécanismes de contrôle comme la compaction de contexte pour gérer efficacement de longues conversations.

- Budget de jetons de sortie de 128K : Opus 4.6 double le budget de sortie maximum précédent (64K → 128K) afin que le modèle puisse fournir des sorties plus longues et soutenues sans troncature — utile pour des rapports en plusieurs parties ou de la génération de code couvrant de nombreux fichiers. Le streaming est recommandé pour de si grandes sorties.

Parmi les améliorations pratiques figurent de meilleures compétences en codage et en débogage, ainsi que des options de mode/priorité conçues pour les workflows d’entreprise et intégrés (l’intégration Copilot est déjà en cours de déploiement dans des endroits comme GitHub Copilot).

Pourquoi ces fonctionnalités comptent (aperçu rapide)

- La fenêtre 1M de jetons réduit le besoin de cycles de récupération répétés ou de l’assemblage de nombreux documents en plusieurs appels — vous pouvez conserver davantage de contexte dans un seul appel, ce qui simplifie la logique applicative pour de nombreux workflows à forte intensité de connaissances.

- Agent Teams change l’architecture : au lieu d’un assistant monolithique unique, vous concevez de petits agents spécialistes qui collaborent — parallélisation plus facile, responsabilité plus claire, et potentiellement meilleure fiabilité sur les tâches complexes.

- Adaptive Thinking vous offre des réglages prévisibles pour arbitrer entre temps et qualité. C’est essentiel pour les systèmes de production où latence, déterminisme et coût sont des contraintes.

Comment appeler Claude Opus 4.6 via CometAPI — étape par étape

Utiliser CometAPI pour appeler Opus 4.6

De nombreuses équipes préfèrent une passerelle multi-modèles unifiée (lorsque vous souhaitez normaliser le code client entre fournisseurs). CometAPI est l’un de ces fournisseurs qui expose de nombreux modèles via une interface compatible OpenAI ; et le format de messages d’Anthropic est également fourni (lorsque vous avez besoin des capacités de compression spécifiques à l’API d’Anthropic et souhaitez utiliser Claude Code via CometAPI). Les exemples ci-dessous montrent des schémas pour un usage en production : authentification, choix du modèle, activation des fonctionnalités de long contexte, streaming et contrôles des coûts. (Ajustez les noms et en-têtes pour correspondre au registre de modèles du fournisseur si Comet modifie les identifiants de modèle.)

Pour commencer (liste de contrôle développeur)

- inscrivez-vous sur CometAPI, obtenez une

COMET_API_KEY, et définissez lebase_urldu client surhttps://api.cometapi.com/v1(Comet propose des clients et exemples compatibles OpenAI). La console de Comet liste les modèles disponibles et tout indicateur spécifique au fournisseur que vous pouvez transmettre. - Décidez à l’avance des paramètres de capacités :

thinking: {type: "adaptive"}, niveau deoutput_config.effort,max_tokens(budget de sortie), streaming pour les grandes sorties, et si la compaction de contexte est souhaitée.

API Claude (pseudo style Python) :

import anthropic

import os

# Récupérez votre clé CometAPI depuis https://api.cometapi.com/console/token et collez-la ici

COMETAPI_KEY = os.environ.get("COMETAPI_KEY") or "<YOUR_COMETAPI_KEY>"

BASE_URL = "https://api.cometapi.com"

client = anthropic.Anthropic(

base_url=BASE_URL,

api_key=COMETAPI_KEY,

)

message = client.messages.create(

model="claude-opus-4-6",

max_tokens=1024,

messages=[{"role": "user", "content": "Bonjour, Claude"}],

)

print(message.content[0].text)

Via CometAPI (exemple de shim compatible OpenAI) :

# Exemple utilisant un client de type OpenAI pointé vers CometAPI

from openai import OpenAI # ou client compatible

client = OpenAI(api_key="COMET_KEY", base_url="https://api.cometapi.com/v1")

resp = client.responses.create(

model="claude-opus-4-6",

reasoning={"type":"adaptive"}, # si le shim prend en charge le même nom de paramètre

output_config={"effort":"medium"},

messages=[{"role":"user","content":"Générez un plan de migration pour ce monorepo."}]

)

print(resp.output_text)

Remarque : les noms de paramètres dans les wrappers CometAPI varient selon le SDK. CometAPI documente un modèle d’intégration simple et accepte généralement

model="claude-opus-4-6"; consultez la documentation CometAPI pour le mappage exact des champs et tout ajustement requis de la forme de la requête.

Bonnes pratiques et utilisation

Agent Teams : modèles de conception et courte recette

Quand utiliser Agent Teams : refactorisations de grandes bases de code, traitement de documents en plusieurs étapes, et workflows qui se prêtent naturellement à des agents spécialistes distincts (p. ex., architecte, implémenteur, relecteur).

Schéma simple Agent Teams :

- Agent orchestrateur reçoit la tâche globale et la découpe en sous-tâches.

- Agents exécutants (chacun une instance de Claude) sont lancés avec des invites ciblées et des critères de succès explicites.

- Travail en parallèle : les exécutants tournent en parallèle avec des contextes indépendants ; les résultats sont renvoyés à l’orchestrateur.

- Fusion & revue : l’orchestrateur compacte les sorties, exécute une passe de synthèse et une vérification finale de sécurité/revue (en utilisant

effort=maxpour la passe finale si nécessaire).

Conseils pratiques :

- Donnez à chaque sous-agent une invite système stricte et un

max_tokensborné pour éviter des coûts incontrôlés. - Utilisez CometAPI ou un framework d’orchestration pour gérer les appels parallèles et les reprises.

- Utilisez la compaction de contexte pour l’historique de l’orchestrateur afin de préserver les décisions sans payer le prix de l’historique complet mot à mot.

Gestion du contexte : gérer de grandes entrées et la fenêtre de 1M de jetons

- Préférez une ingestion structurée : alimentez les documents en segments (métadonnées du document + blocs de contenu). Conservez des points d’ancrage (titres de documents, index) et demandez au modèle de citer les sources par index. C’est plus robuste que de coller des fichiers bruts.

- Utilisez la compaction de contexte (là où disponible) pour de longues sessions interactives : laissez le modèle résumer les tours plus anciens afin de ne pas épuiser le budget de jetons tout en conservant les faits saillants. Anthropic propose la compaction comme capacité bêta.

- Si vous avez besoin d’un rappel déterministe, stockez les artefacts canoniques dans votre propre DB et référencez-les par ID plutôt que de réinjecter des fichiers entiers à chaque requête. Utilisez le modèle pour résumer ou extraire uniquement les portions nécessaires pour une étape donnée.

Compromis entre coût, latence et qualité — utiliser effort et autres réglages

- Effort : le contrôle le plus efficace pour équilibrer coût vs. capacité. Commencez avec

mediumpour les systèmes de production qui exigent de l’efficacité ; utilisezhighoumaxpour des audits critiques, des revues finales ou des tâches de synthèse complexes.lowest utile pour la récupération de routine ou les courtes questions/réponses. De nombreuses équipes rapportent d’excellentes économies en utilisantmediumpar défaut et en n’augmentanteffortque lorsque nécessaire. - Batch et cache : utilisez la mise en cache des prompts pour les questions répétées et le traitement par lot pour de nombreuses petites tâches similaires afin de réduire les coûts de réingestion de jetons. La plateforme d’Anthropic et les fournisseurs tiers prennent en charge la mise en cache/pour le traitement par lots.

- Streaming et sorties en morceaux : lorsque vous demandez des sorties très volumineuses (génération de code longue, brouillons de livres), utilisez le streaming pour réduire la pression mémoire et permettre une acceptation/abandon anticipée.

Réflexions finales — là où Opus 4.6 change le calcul des développeurs

Opus 4.6 marque une avancée nette vers la création de workflows agentiques larges et durables sans assembler de nombreuses requêtes courtes. La fenêtre de 1M de jetons et Agent Teams débloquent de nouvelles catégories d’applications (automatisation de grandes bases de code, longues revues juridiques/financières, assistants de recherche multi-documents), mais elles déplacent également l’accent de la conception d’invites micro-optimisées vers la conception de systèmes : comment vous stockez les artefacts, orchestrez les spécialistes, mesurez et maîtrisez les coûts, et surveillez le comportement des agents.

Les développeurs peuvent accéder à Opus 4.6 via CometAPI dès maintenant. Pour commencer, explorez les capacités du modèle dans le Playground et consultez le guide API pour des instructions détaillées. Avant d’y accéder, veuillez vous assurer que vous avez bien connecté votre compte CometAPI et obtenu la clé API. CometAPI propose un prix bien inférieur au prix officiel pour vous aider à intégrer.

Prêt à démarrer ?→ Inscrivez-vous à openclaw dès aujourd’hui !

Si vous souhaitez davantage de conseils, de guides et d’actualités sur l’IA, suivez-nous sur VK, X et Discord !

.png&w=3840&q=75)