Doubao Seed 1.8 — membre de la famille Doubao de ByteDance et de la lignée de recherche Seed — attire l’attention pour avoir été conçu comme un modèle multimodal « agentique » avec une gestion de très grands contextes et une meilleure prise en charge des outils/agents.

Pour les développeurs et les entreprises, la question immédiate n’est plus « À quel point est-il intelligent ? » mais « Comment construire avec ? ». Je vais approfondir dans cet article les spécifications techniques, les structures tarifaires et les stratégies d’implémentation pratiques de l’API Doubao Seed 1.8.

Qu’est-ce que Doubao Seed 1.8 ?

Doubao Seed 1.8 est le dernier modèle phare de la famille « Doubao » (anciennement Skylark) de ByteDance. Contrairement à ses prédécesseurs, qui se concentraient principalement sur la fluidité conversationnelle et la génération de contenu, Seed 1.8 a été entraîné avec un objectif spécifique : l’exécution autonome de tâches.

Le modèle introduit une architecture unifiée qui intègre la perception multimodale (Vision, Audio, Vidéo) avec l’exécution d’actions (utilisation d’outils, navigation GUI). Cela permet au modèle d’agir comme un travailleur numérique capable de naviguer dans des systèmes d’exploitation, de parcourir le web et de gérer des workflows complexes sans supervision humaine constante.

La philosophie « Seed »

La désignation « Seed » dans le nom de version met en évidence son rôle de « graine » fondatrice pour les applications agentiques. Il est conçu pour croître vers des cas d’usage spécifiques — qu’il s’agisse d’un assistant de programmation capable de déboguer un environnement en direct ou d’un agent de service client pouvant naviguer dans une base CRM pour traiter des remboursements.

Quelles fonctionnalités « qualité de vie » et pour développeurs existent ?

- Mise en cache du contexte et préremplissage/continuation pour rendre les workflows longs moins coûteux et plus rapides.

- Sortie en streaming pour des réponses progressives (utile pour les interfaces de chat ou les retours d’agent en temps réel).

- Appels d’agent/outils : primitives plus riches pour invoquer des outils, interagir avec des interfaces graphiques et orchestrer des flux multi-étapes (y compris le chaînage de contexte de type “previous_response_id”).

- Planification à long horizon : optimisé pour les tâches nécessitant de nombreuses étapes séquentielles (par ex., explorer plusieurs sites et consolider les résultats), avec une stabilité et des trajectoires de raisonnement améliorées.

Statistiques clés de la version (janvier 2026) :

- Date de sortie : 18 décembre 2025

- Model ID :

doubao-seed-1-8-251228 - Architecture : Mixture-of-Experts clairsemé (MoE) avec optimisation agentique native

- Accès : CometAPI

Pourquoi ByteDance / Volcengine a construit Seed1.8 et qu’est-ce qui le différencie ?

Quel problème cherche-t-il à résoudre ?

Seed1.8 cible un manque réel : des modèles capables d’agir à travers plusieurs modalités et environnements (pages web, vidéos, interfaces graphiques, API d’outils) plutôt que de simplement répondre à des invites isolées. Les priorités de conception rapportées par l’équipe sont (1) une perception multimodale robuste, (2) des appels d’outils/instruments fiables et (3) un raisonnement efficace pour des tâches longues et multi-étapes (p. ex., planification, agrégation multi-sites, navigation GUI). Seed1.8 accomplit des tâches complexes et multi-étapes nécessitant l’enchaînement de compréhension visuelle, de recherche et d’utilisation d’outils.

En quoi cela diffère-t-il des versions Doubao/Seed antérieures ?

Plutôt que de simplement affiner l’échelle brute du modèle, Seed1.8 introduit des changements d’architecture et de système qui améliorent la performance « agentique » : meilleure gestion du contexte, meilleure compréhension des longues vidéos à faible cadence (prise en charge de très longues durées vidéo avec inspection à cadence élevée assistée par outils) et optimisations offrant une puissance de raisonnement similaire avec moins de tokens dans certains paliers (selon des retours communautaires précoces). Ces compromis rendent le modèle plus rentable pour des charges de travail d’agents persistants.

3 fonctionnalités clés et capacités multimodales

Doubao Seed 1.8 se distingue par trois piliers : multimodalité extrême, raisonnement agentique et gestion native du contexte.

1. Compréhension visuelle et vidéo haute fidélité

Alors que de nombreux modèles souffrent de « zones d’ombre » en analyse vidéo, Seed 1.8 introduit une percée en compréhension de longues vidéos.

- Analyse sur 1280 images : le modèle peut traiter jusqu’à 1280 images vidéo en un seul passage, soit le double de la capacité du modèle Vision V1.5 précédent. Cela lui permet de « regarder » l’enregistrement d’une réunion de 30 minutes ou un flux de sécurité et d’en extraire des détails spécifiques (par ex. « À quel horodatage le présentateur est-il passé à la diapositive financière ? »).

- Logique à faible fréquence d’images : pour des vidéos extrêmement longues, le modèle utilise une technique d’échantillonnage parcimonieux optimisée pour maintenir le contexte sans faire exploser les coûts en tokens.

2. Mode « réflexion » (raisonnement profond)

Dans le sillage de la tendance lancée par les séries o1/o3 d’OpenAI, Seed 1.8 inclut un mode « réflexion » configurable. Lorsqu’il est activé via l’API, le modèle engage un processus de « chaîne de pensée » avant de produire une réponse finale. C’est particulièrement efficace pour :

- Mathématiques complexes : résolution de problèmes de calcul différentiel/intégral ou statistiques à étapes multiples.

- Architecture de code : planifier une architecture microservices avant d’écrire des fonctions spécifiques.

- Énigmes logiques : traiter des requêtes impliquant des contraintes diverses (par ex., planifier les shifts de 50 employés avec des disponibilités conflictuelles).

3. UI-TARS et interaction avec les interfaces graphiques

Une fonctionnalité unique de Seed 1.8 est son intégration native avec UI-TARS (User Interface Tool-Augmented Reasoning System). Cela donne au modèle des « yeux » et des « mains » pour les interfaces informatiques.

- Ancrage visuel : le modèle peut regarder une capture d’écran d’une interface logicielle et identifier les coordonnées des boutons, champs de saisie et menus.

- Génération d’actions : il peut générer des commandes de niveau OS (clic, glisser, saisir) pour opérer des logiciels, alimentant les nouvelles fonctionnalités « Auto-operate » de ByteDance dans les outils d’entreprise.

Comment se comporte-t-il sur les benchmarks ?

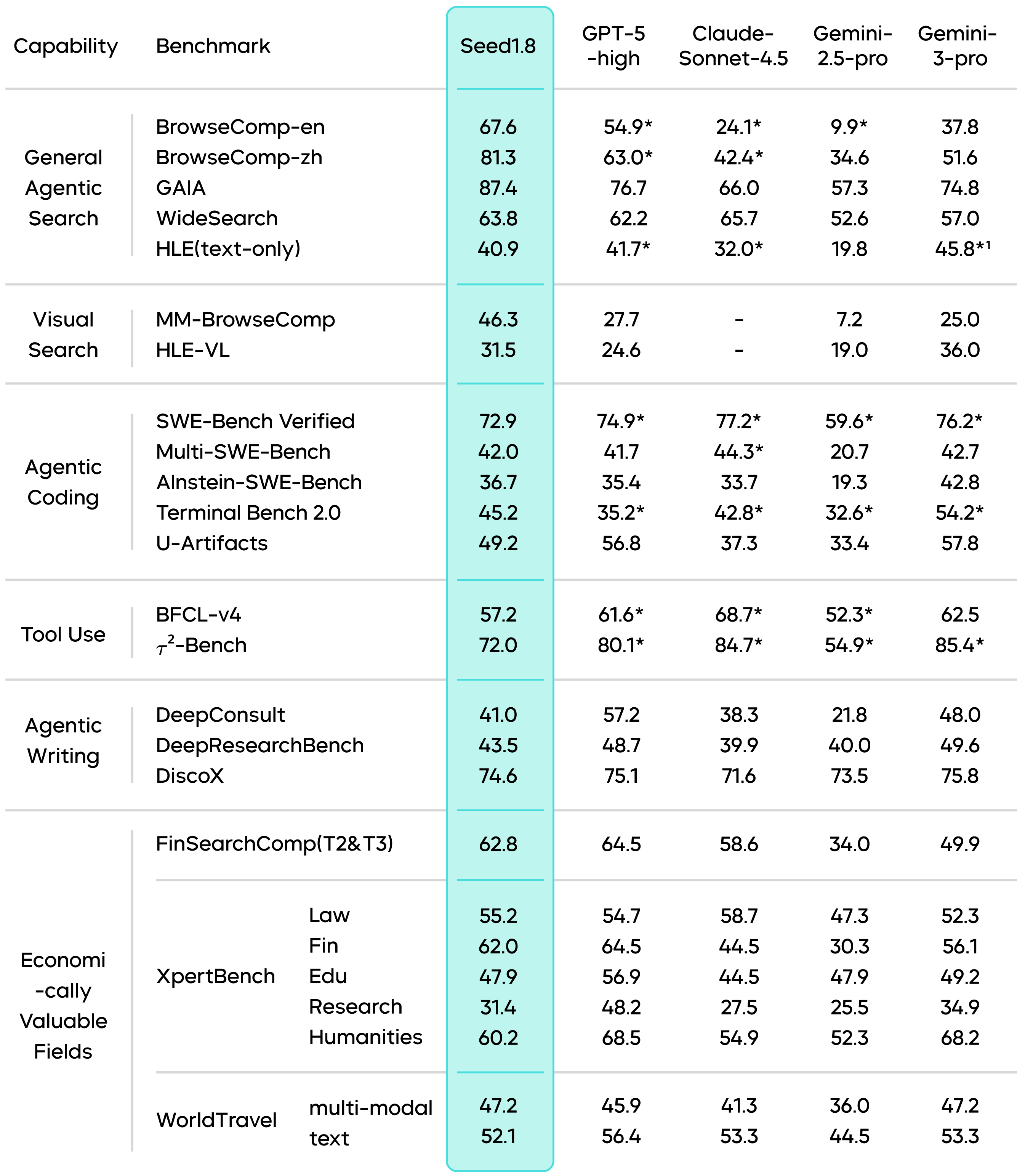

La communauté IA a rigoureusement testé Seed 1.8 depuis sa bêta. Les premiers benchmarks dressent le portrait d’un modèle qui dépasse sa catégorie, en particulier en utilisation d’outils et en code.

Benchmarks « agentiques »

- BrowseComp-en : sur ce benchmark, qui évalue la capacité d’une IA à naviguer sur le web et synthétiser l’information, Seed 1.8 a obtenu 67,6 %, surpassant à ce qu’on rapporte le GPT-4o standard et devançant Claude 3.5 Sonnet en efficacité de navigation.

- SWE-bench (génie logiciel) : Seed 1.8 présente un taux de réussite élevé pour la résolution d’issues GitHub. Sa capacité à « lire » la structure des fichiers d’un dépôt et à comprendre les dépendances lui permet de proposer des correctifs syntaxiquement corrects et contextuellement valides.

Analyse comparative

| Metric | Doubao Seed 1.8 | Gemini 3 Flash | GPT-4o |

|---|---|---|---|

| Context Window | 256k | 1M+ | 128k |

| Video Understanding | 1280 Frames | High | Moderate |

| Reasoning (Math/Logic) | Very High (Thinking Mode) | High | Very High |

| GUI Operation | Native (UI-TARS) | Tool-based | Tool-based |

| Pricing (Input) | ~¥0.80 / 1M | Low | High |

Remarque : Les scores de benchmark sont basés sur les chiffres rapportés lors de la Force Conference et sur des tests indépendants à janvier 2026.

Seed1.8 atteint des scores state-of-the-art sur plusieurs benchmarks d’agents et de recherche (par ex., meilleur score GAIA dans leur comparaison ; performances solides sur BrowseComp et WideSearch), démontrant une capacité de décision en conditions réelles.

Comment les développeurs peuvent-ils accéder à l’API et l’utiliser ?

L’accès à Doubao Seed 1.8 est simple, principalement via la plateforme CometAPI.

Voici un guide pas à pas pour intégrer l’API dans votre flux de travail.

Étape 1 : Créer un compte CometAPI

Accédez au site CometAPI et enregistrez un compte. La page Seed 1.8 décrit le modèle lui-même.

Étape 2 : Accéder à la console CometAPI

Dans la console CometAPI, activez le service du modèle et créez une API Key / Access Key avec les permissions d’invocation du modèle. Allez dans Gestion des clés API de la console et générez une nouvelle clé. Conservez-la en sécurité ; elle commence par sk-... (ou similaire).

Étape 3 : Sélectionner le modèle et créer un endpoint

Dans l’écran de sélection du modèle :

- Model : sélectionnez

Doubao-Seed-1.8(recherchez l’étiquettedoubao-seed-1-8-251228). - Endpoint Name : donnez un nom unique à votre endpoint (par ex.,

ep-20260112-xyz).

Étape 4 : Effectuer votre première requête

L’API Doubao est entièrement compatible avec le format du SDK OpenAI, ce qui facilite la migration.

Vous devez simplement changer les paramètres base_url et model.

Exemple Python (avec le SDK OpenAI) :

python

from openai import OpenAI

# [...](asc_slot://start-slot-53)Initialize client with Volcano Engine config

client = OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.cometapi.com/v1"

)

# Call the model

response = client.chat.completions.create(

model="doubao-seed-1-8-251228",

messages=[

{

"role": "system",

"content": "You are Doubao Seed 1.8, an expert AI agent."

},

{

"role": "user",

"content": "Analyze the attached video context and explain the user's intent."

}

],

# Enable Thinking Mode (if available for your endpoint)

# extra_body={"thinking_mode": "enable"}

)

print(response.choices[0].message.content)

Utilisation avancée : appels d’outils et multimodalité

Pour exploiter les capacités agentiques, vous définissez des outils selon le schéma JSON standard.

Pour l’entrée Image/Vidéo, vous pouvez transmettre des chaînes encodées en base64 ou des URLs dans la liste content, à l’instar de GPT-4 Vision.

python

# Multimodal Input Example

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "What is happening in this image?"},

{

"type": "image_url",

"image_url": {

"url": ""

}

}

]

}

]

Conclusion :

Seed 1.8 apporte de solides capacités pour les applications agentiques, multimodales et à long contexte — c’est un excellent choix lorsque votre charge de travail exige une perception, une planification et une action intégrées sur de longs documents ou médias. Cependant, la valeur d’ingénierie réelle dépend des schémas d’usage : besoins de latence, volumes de tokens et capacité à orchestrer efficacement cache, recherche et chaînes d’outils.

Les développeurs sont encouragés à se connecter à CometAPI dès aujourd’hui, réclamer leurs jetons gratuits et commencer à semer les graines de la prochaine génération d’applications IA.

Les développeurs peuvent accéder au modèle Doubao seed 1.8 API via CometAPI. Pour commencer, explorez les capacités du modèle de CometAPI dans le Playground et consultez le guide de l’API pour des instructions détaillées. Avant d’y accéder, assurez-vous d’être connecté à CometAPI et d’avoir obtenu la clé API. CometAPI propose un prix bien inférieur au tarif officiel pour vous aider à intégrer.

Prêt à démarrer ?→ Essai gratuit de Doubao seed 1.8 !