MiniMax-M2.5 est un nouveau grand modèle de langage de MiniMax, axé sur la productivité, optimisé pour le codage, l’utilisation d’outils agentiques et les workflows bureautiques. Vous pouvez l’appeler via sa plateforme MiniMax native ou via des agrégateurs d’API tels que CometAPI. Vous n’avez besoin que d’obtenir la clé API CometAPI pour utiliser l’API, car Minimax-M2.5 prend également en charge le format de chat.

Qu’est-ce que MiniMax-M2.5 ?

MiniMax-M2.5 est la dernière version majeure de MiniMax : une évolution de la famille M2 que l’entreprise positionne comme un modèle polyvalent, capable d’agir en agent, avec des performances particulièrement fortes en génération de code, utilisation d’outils et raisonnement multi-étapes. La famille M2.5 a été annoncée pour février 2026 et inclut la version standard M2.5 et des variantes « highspeed » optimisées pour une latence plus faible tout en conservant les mêmes capacités de base. La famille M2.5 a amélioré les scores de benchmark dans les évaluations d’ingénierie logicielle et affiche un meilleur comportement lors des interactions avec des outils externes (recherche, agents, etc.).

L’éditeur présente M2.5 comme une amélioration par rapport aux versions M2.x précédentes, avec un raisonnement renforcé, une meilleure génération de code et une fiabilité accrue des appels d’outils. Les notes de version publiques de MiniMax début février 2026 ont qualifié M2.5 d’étape importante : affinement de l’instruction tuning, compréhension du code renforcée et gains mesurables sur plusieurs benchmarks centrés sur le code. La version inclut :

- Un modèle M2.5 standard (mettant l’accent sur la précision et le raisonnement).

- Une variante M2.5-highspeed avec une latence plus faible pour des workflows interactifs côté développeur.

- Des directives explicites et des options de facturation pour un « Coding Plan » destiné aux usages intensifs de génération de code.

Principaux points techniques

- Architecture : MoE (nombre total de paramètres élevé avec un sous-ensemble actif bien plus petit à l’inférence), permettant un compromis coût/performance optimal pour les tâches lourdes.

- Atouts : performances de codage de pointe, raisonnement multi-tours, gestion de longs contextes et intégrations avec agents/outils.

- Variantes : MiniMax publie des déclinaisons (par ex.

MiniMax-M2.5etM2.5-highspeed) ajustées pour le débit vs la latence.

Pourquoi cela compte aujourd’hui : de nombreuses équipes construisant des outils développeurs, des assistants de programmation et des automatisations agentiques recherchent un modèle capable de raisonner sur plusieurs tours, d’appeler des outils en toute sécurité et de produire du code de haute qualité. M2.5 — de par ses choix d’architecture et d’entraînement — est explicitement commercialisé pour ces scénarios.

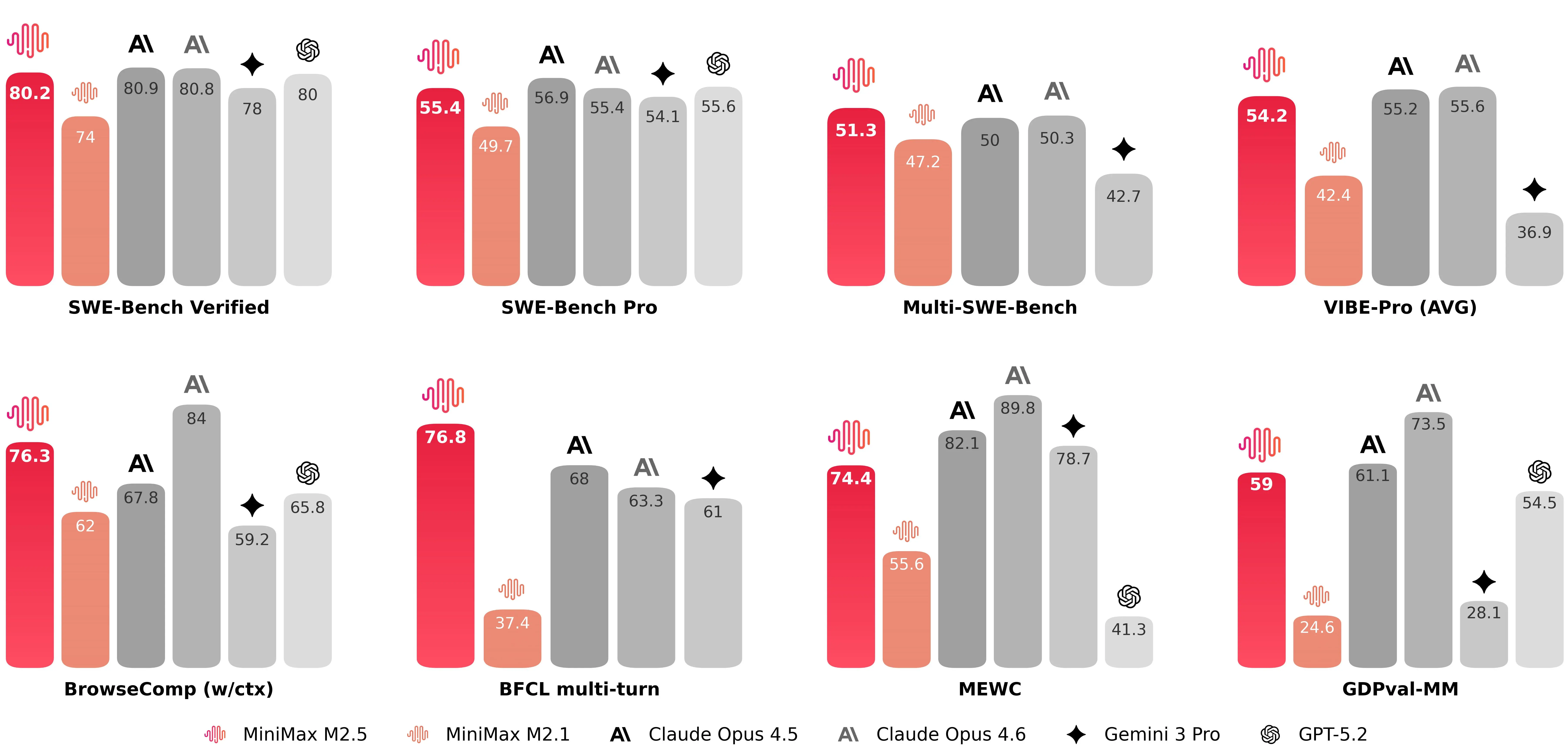

Évaluation comparative de MiniMax-M2.5

Position de M2.5 sur les benchmarks spécifiques au code

MiniMax-M2.5 obtenant 80.2% sur SWE-Bench Verified, ainsi que de bonnes notes sur les benchmarks multi‑tâches de codage et ceux augmentés par la navigation (chiffres notables publiés par l’entreprise : 51.3% sur Multi-SWE-Bench et 76.3% sur BrowseComp lorsque la gestion de contexte est activée). Ces chiffres placent M2.5 parmi les modèles publics les plus performants pour la génération de code et la résolution de problèmes au lancement. Le lancement de MiniMax-M2.5 confirme que M2.5 rivalise avec le haut du panier des modèles de codage.

Pour les développeurs, l’avantage est double :

- Taux de réussite au premier essai plus élevé : moins de cycles de correctifs, moins de débogage manuel et une charge de « babysitting » réduite pour les agents de codage autonomes.

- Meilleure couverture full‑stack : M2.5 est décrit comme prenant en charge des workflows full‑stack sur des applications desktop, mobiles et des chaînes d’outils multiplateformes, ce qui signifie qu’il vise à générer non seulement des extraits, mais des solutions cohérentes multi‑fichiers et des scripts de build.

Conçu pour des workflows agentiques

M2.5 est décrit comme « nativement conçu pour des scénarios d’agents ». Concrètement, cela signifie que l’architecture et le régime d’entraînement priorisent :

- La fidélité des invocations d’outils : émettre des appels d’API ou exécuter des commandes shell/SQL avec la syntaxe et les paramètres corrects.

- Le changement de contexte et la mémoire : continuer une opération multi‑étapes interrompue sans perdre l’état précédemment calculé.

- La manipulation de fichiers : produire et modifier des formats bureautiques courants de manière programmatique (par exemple, générer un PowerPoint puis le réviser sur demande).

Augmentation par recherche et navigation

Lorsqu’il est couplé à des couches de navigation ou de récupération, M2.5 obtient des scores nettement améliorés sur les benchmarks de navigation, reflétant de meilleures performances dans l’intégration d’informations externes et de citations dans les sorties. Cela rend M2.5 adapté aux outils qui doivent récupérer du contenu à jour, vérifier les résultats d’API ou augmenter la génération de code avec des données réelles (par exemple, récupérer la dernière documentation SDK et l’utiliser correctement lors de la génération). Ces capacités comptent pour les équipes construisant des fonctionnalités « agentiques » comme la QA automatisée, des chaînes CI ou des assistants pilotés par documents.

Comment utiliser l’API MiniMax-2.5 (via CometAPI) ?

CometAPI est une plateforme d’agrégation d’API qui expose des centaines de modèles via une surface REST unique compatible OpenAI. Étant donné que l’interface de CometAPI reflète les endpoints chat/completions d’OpenAI, vous pouvez souvent réutiliser des clients de style OpenAI existants en changeant api_base et la clé API. Si vous préférez ne pas intégrer directement la plateforme MiniMax (pour des raisons comme la facturation unifiée, les tests A/B multi‑modèles ou l’abstraction fournisseur), vous pouvez appeler MiniMax-M2.5 via la surface « chat » de CometAPI. La plateforme CometAPI fournit un format de requête cohérent, un SDK et un bac à sable web — et expose des noms et paramètres par modèle (vous sélectionnez donc la chaîne provider/modèle exacte lors de l’appel).

Ci‑dessous, un guide concis et pratique pour appeler MiniMax-M2.5 via CometAPI, avec des exemples en curl et Python.

Quelles sont les étapes de base pour commencer ?

- Créez un compte CometAPI et obtenez une clé API. (CometAPI fournit un playground et des SDK pour tester les modèles.)

- Consultez la liste des modèles CometAPI ou le playground CometAPI pour trouver le nom exact du modèle pour MiniMax-M2.5.

- Effectuez une requête POST authentifiée avec le paramètre

modeldéfini sur le modèle MiniMax sélectionné et une charge utile suivant le schéma chat/completion de CometAPI. - Ajustez les paramètres (temperature, max_tokens, messages système, streaming) selon votre workflow.

Authentification et bases des endpoints

- URL de base :

https://api.cometapi.com/v1(des chemins de type OpenAI tels que/chat/completionssont pris en charge). - En-tête :

Authorization: Bearer YOUR_COMETAPI_KEY - Content-Type :

application/json - Champ Model : utilisez exactement la chaîne de modèle du catalogue CometAPI (exemples :

"minimax-m2.5"

Exemple 1 — curl rapide (REST, style OpenAI)

# Replace $COMETAPI_KEY with your CometAPI key

curl -s -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer $COMETAPI_KEY" \

-H "Content-Type: "application/json" \

-d '{

"model": "minimax-m2.5",

"messages": [

{"role":"system","content":"You are a concise, safety-conscious coding assistant."},

{"role":"user","content":"Refactor this synchronous Python function to async and add basic error handling:\n\n```\ndef fetch(user_id):\n resp = http_get(f\"https://api.example.com/users/{user_id}\")\n return resp.json()\n```"}

],

"max_tokens": 800,

"temperature": 0.0,

"stream": false

}'

Notes :

- Utilisez exactement la chaîne du modèle telle qu’indiquée dans le catalogue CometAPI ; s.

stream: trueest pris en charge pour le streaming des sorties (gérez les événements envoyés par le serveur ou les réponses fragmentées si vous souhaitez des tokens partiels).

Exemple 2 — Python (requests) pour un chat completion

import os, requests

COMET_KEY = os.environ.get("COMETAPI_KEY") # recommended

URL = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "minimax-m2.5", # or "minimax/minimax-m2.5" — verify Comet's model page

"messages": [

{"role": "system", "content": "You are a helpful engineer who returns clear, tested code."},

{"role": "user", "content": "Write a pytest for the following function that asserts edge cases..."}

],

"temperature": 0.1,

"max_tokens": 1000,

}

r = requests.post(URL, json=payload, headers=headers, timeout=120)

r.raise_for_status()

out = r.json()

print(out["choices"][0]["message"]["content"])

Exemple 3 — Utiliser litellm / intégration CometAPI (couche de commodité Python)

CometAPI est pris en charge par plusieurs SDK et adaptateurs communautaires. La documentation liteLLM montre un flux compact où vous définissez COMETAPI_KEY et appelez le modèle par son nom. Idéal pour le prototypage :

import os

from litellm import completion

os.environ["COMETAPI_KEY"] = "your_cometapi_key_here"

messages = [{"role":"user", "content":"Explain async/await in Python in 3 bullets."}]

resp = completion(model="minimax-m2.5", messages=messages)

print(resp.choices[0].message.content)

Les intégrations Litellm / Comet offrent des utilitaires pratiques (streaming, async, paramètre api_key explicite) qui reflètent de nombreux schémas des SDK OpenAI existants.

Comment concevoir des prompts et des messages système pour M2.5

Soyez explicite sur le rôle et les contraintes

Donnez à M2.5 un rôle système clair lorsque vous demandez du code. Exemple :

{"role": "system","content": "You are MiniMax M2.5, an assistant specialized in robust, readable, and well-documented code. Use Python 3.11 conventions, include type hints, and provide brief unit tests."}

Utilisez une décomposition en étapes pour les problèmes complexes

- Demandez un plan de conception.

- Demandez les signatures d’interface.

- Demandez l’implémentation et les tests.

Cela réduit le risque d’hallucination et produit des sorties modulaires et révisables.

Température, max_tokens et sécurité

- Pour du code déterministe : réglez

temperatureproche de 0.0. - Pour une conception exploratoire :

temperatureentre 0.2 et 0.5 peut faire émerger des approches créatives. - Gardez

max_tokensgénéreux pour de grands refactorings ou de longues suites de tests.

Demandez des tests unitaires et du raisonnement

Quand vous demandez du code, demandez aussi des tests unitaires et une courte explication de l’algorithme. Cela aide à détecter des bogues subtils et à obtenir des artefacts exécutables dès le premier essai.

Inférence longue durée et suivi d’état

Le modèle M2.5 propose un excellent mécanisme de suivi d’état, assurant efficacement la continuité et la direction de la pensée sur de longues séquences temporelles en se concentrant à chaque fois sur un nombre limité d’objectifs plutôt que de tout traiter en parallèle. M2.5 est doté de fonctionnalités sensibles au contexte, permettant une exécution efficace des tâches et une gestion du contexte optimisée.

Conseils pratiques d’utilisation de M2.5 en production

MiniMax-M2.5 est ajusté pour les enchaînements multi‑étapes et le code. Voici des conseils pratiques, fondés sur l’expérience, pour obtenir les meilleurs résultats en production.

Ingénierie de prompts et messages système

- Utilisez des messages système explicites pour le rôle et les contraintes. Pour les tâches de code, indiquez l’environnement d’exécution/frameworks de test requis (par ex., « Renvoyez un pytest compatible Python 3.11 »).

- Fournissez du contexte : pour des travaux agentiques ou multi‑étapes, fournissez des métadonnées d’étapes et des descriptions d’outils sous forme de JSON structuré ou de listes à puces. M2.5 répond bien aux entrées structurées car il est optimisé pour l’usage d’outils.

Appels de fonctions/outils

- Si vous utilisez CometAPI comme passerelle pour les appels d’outils, assurez-vous que vos champs supplémentaires (par ex.,

function_calldans le style OpenAI) correspondent aux attentes de CometAPI/du modèle. Confirmez la prise en charge du modèle sur la page Comet, car la sémantique des outils peut varier selon le fournisseur. - Pour une orchestration robuste, découpez les grandes tâches en appels plus petits et maintenez des points de contrôle déterministes. M2.5 suit très bien les instructions multi‑étapes, mais vous obtiendrez le comportement le plus fiable en validant après chaque étape.

Température, max_tokens et contrôle des coûts

- Pour la génération ou le refactoring de code, fixez une

temperaturebasse (0.0–0.2) et utilisezmax_tokensselon la taille de sortie attendue. - Pour des prompts exploratoires, augmentez

temperaturemais surveillez l’usage de tokens. En routant via CometAPI, comparez les tarifs par fournisseur et les règles de repli — CometAPI liste les prix par token par instance de modèle dans son catalogue.

Fenêtre de contexte et documents longs

- Les variantes M2.5 prennent souvent en charge de longs contextes (vérifiez la spécification du modèle pour la longueur). Pour des documents très longs, segmentez et résumez — puis fournissez les résumés et les segments pertinents, plutôt qu’envoyer des fichiers entiers en une seule requête.

Sécurité, contenu toxique et réduction des hallucinations

- Utilisez des garde‑fous : messages système, validateurs externes et suites de tests (par ex., tests unitaires pour le code généré) réduisent les risques.

- Validez les références externes : si le modèle cite des faits ou du code du web, vérifiez‑les de manière programmatique avant de faire confiance ou de livrer ces résultats.

Quels sont les écueils courants et comment les éviter

Écueil : Trop faire confiance à une seule sortie du modèle

Atténuation : Exécutez des tests, des vérifications statiques et, pour la logique critique, demandez plusieurs complétions indépendantes et comparez. CometAPI permet de basculer entre plusieurs modèles, et vous pouvez passer de l’un à l’autre à tout moment en utilisant le format chat d’OpenAI.

Écueil : Utiliser une température élevée pour du code en production

Atténuation : Gardez une temperature basse ; si vous avez besoin d’alternatives créatives, demandez plusieurs variantes à faible température ou demandez au modèle d’expliquer les différences.

Écueil : Ignorer la gestion des versions du modèle

Atténuation : Suivez les noms de modèles et les chaînes de fournisseur dans vos manifestes de déploiement. Lors du passage de MiniMax-M2.5 à MiniMax-M2.5-highspeed ou à un autre fournisseur, traitez‑le comme un changement de version et exécutez des tests de régression.

Recommandations finales et attentes réalistes

MiniMax-M2.5 représente une avancée notable pour les LLMs axés code et agents — il promet une forte génération de code, un raisonnement multi‑tours et un comportement sûr vis‑à‑vis des outils. Si vos priorités d’équipe sont de construire des outils développeurs robustes, des frameworks d’agents ou des assistants de code, M2.5 mérite une place dans votre matrice de comparaison. Utiliser CometAPI comme passerelle unifiée peut accélérer l’expérimentation et vous permettre de changer de fournisseur ou d’A/B tester des modèles sans réécrire toute votre intégration.

Quelques enseignements pragmatiques :

- Prototyper rapidement avec le playground de CometAPI, puis verrouillez les identifiants de modèle dans le code.

- Utilisez une température basse, demandez des tests et des explications, et exécutez toujours une validation automatisée.

- Traitez le modèle comme un co‑développeur puissant — mais pas infaillible : appliquez une relecture humaine, des pipelines CI et de la télémétrie.

Les développeurs peuvent accéder à MInimax-M2.5 via CometAPI dès maintenant. Pour commencer, explorez les capacités du modèle dans le Playground et consultez le guide API pour des instructions détaillées. Avant d’accéder, assurez‑vous de vous être connecté à CometAPI et d’avoir obtenu la clé API. CometAPI propose un prix bien inférieur au tarif officiel pour vous aider à intégrer.

Prêt à démarrer ?→ Inscrivez‑vous à M2.5 dès aujourd’hui !

Si vous souhaitez plus d’astuces, de guides et d’actualités sur l’IA, suivez‑nous sur VK, X et Discord !