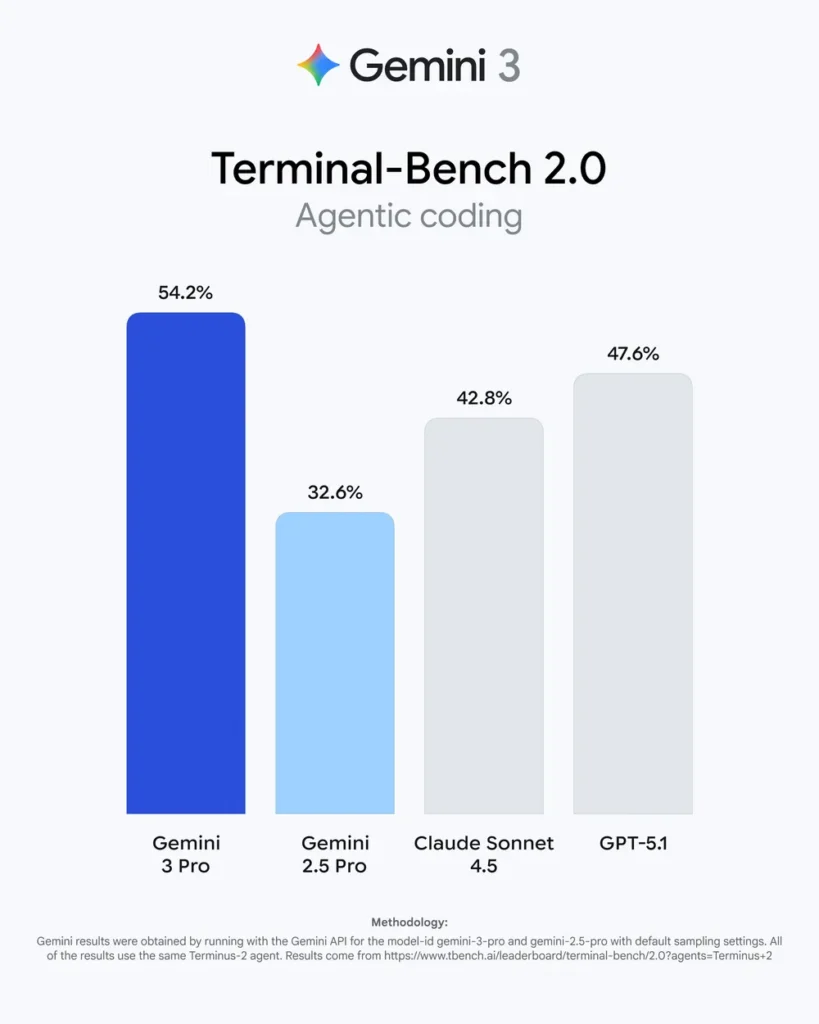

Google vient d’inaugurer l’ère Gemini 3 en publiant en aperçu Gemini 3 Pro, et les premiers signaux sont sans ambiguïté : il s’agit d’une avancée majeure en raisonnement multimodal, en agents de programmation et en compréhension de long contexte. Le modèle est présenté comme le modèle de raisonnement et multimodal le plus performant de Google à ce jour, optimisé pour les workflows agentiques, le codage, les tâches à long contexte et la compréhension multimodale. Il est livré avec un nouveau mode de raisonnement « Deep Think », affiche des améliorations spectaculaires sur les benchmarks d’agents/code (Terminal-Bench 2.0 annoncé à 54,2 %), et est immédiatement utilisable via Google AI Studio, l’API (intégrations Vertex AI) et des outils développeurs comme Google Antigravity.

What is Gemini 3 Pro Preview?

Gemini 3 est présenté par Google comme le membre de nouvelle génération, le plus intelligent, de la famille Gemini — axé sur un raisonnement plus profond, une compréhension multimodale plus riche (texte, images, vidéo, audio, code) et un meilleur comportement agentique (des modèles qui planifient et agissent avec des outils).

Headline features

- Compréhension multimodale native — conçu pour accepter et raisonner simultanément sur du texte, des images, de l’audio et de la vidéo (y compris des entrées longues/vidéo). Idéal pour mêler documents, captures d’écran, transcriptions et vidéo.

- Fenêtre de contexte énorme (jusqu’à ~1 000 000 jetons) — peut ingérer/garder en contexte des documents extrêmement longs, de vastes bases de code ou des heures de transcriptions dans une seule session. C’est un argument clé pour la recherche approfondie, la relecture de code et la synthèse multi‑documents.

- Capacité agentique / utilisation d’outils — conçue pour alimenter des agents autonomes capables d’appeler des outils, d’opérer des terminaux, de gérer des plans de tâches et d’orchestrer des workflows multi‑étapes (utilisée dans Google Antigravity et d’autres intégrations IDE). Cela le rend particulièrement performant pour le codage, l’orchestration et l’automatisation multi‑étapes.

- Raisonnement et programmation renforcés — Google présente Gemini 3 Pro comme son meilleur modèle « de réflexion » pour les tâches de raisonnement complexe, de mathématiques et de code (benchmarks améliorés et performances terminal/outils accrues).

What’s new in Gemini 3 Pro compared with Gemini 2.5 Pro and others?

Which capabilities improved the most?

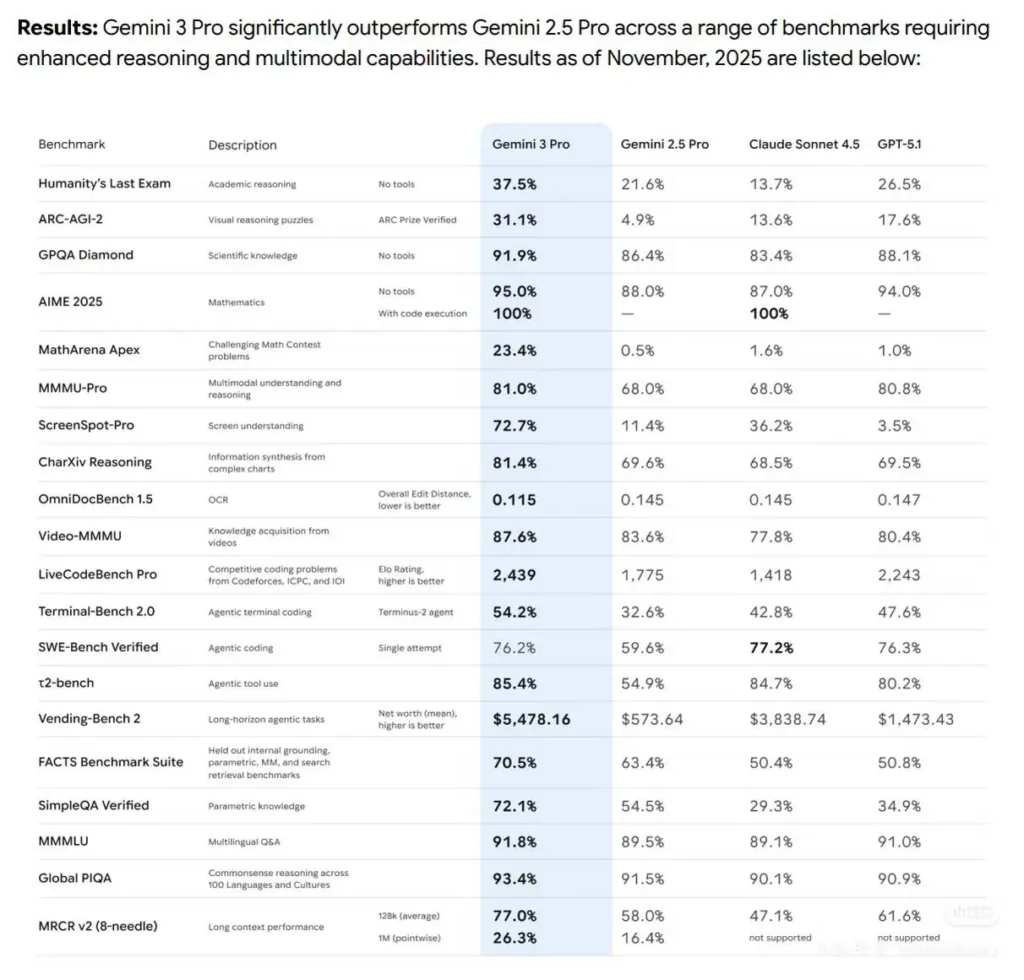

Gemini 3 Pro est présenté comme une avancée majeure en raisonnement (mathématique et scientifique), en raisonnement spatial/visuel multimodal et en utilisation d’outils. Google met en avant des gains nets par rapport à Gemini 2.5 Pro dans des suites de benchmarks et dans des tâches agentiques réelles telles que le codage et l’automatisation via terminal. Exemples de métriques phares publiées par l’équipe :

| Benchmark / tâche | Gemini 3 Pro (rapporté) | Gemini 2.5 Pro (rapporté) | Écart absolu (pp) |

|---|---|---|---|

| Humanity’s Last Exam (raisonnement académique, sans outils) | 37,5 % | 21,6 % | +15,9. |

| GPQA Diamond (QA scientifique/factuelle) | 91,9 % | 86,4 % | +5,5. |

| AIME 2025 (mathématiques, sans outils) | 95,0 % | 88,0 % | +7,0. |

| AIME avec exécution de code | 100,0 % | (2.5 Pro : — ) | — (3 Pro atteint le score parfait avec exécution). |

| ARC-AGI-2 (casse-têtes de raisonnement visuel) | 31,1 % | 4,9 % | +26,2 — très fort gain multimodal. |

| SimpleQA Verified (connaissances paramétriques) | 72,1 % | 54,5 % | +17,6. |

Ces chiffres indiquent que Gemini 3 Pro est optimisé pour le raisonnement multi‑étapes, l’utilisation d’outils complexes et des tâches multimodales étroitement intégrées (par ex., combiner des images vidéo, le raisonnement sur graphiques et la génération de code).

Agentic-first developer tooling: Antigravity

Pour démontrer les workflows agentiques, Google a lancé Antigravity — un IDE « agent‑first » qui utilise Gemini 3 Pro comme fondation pour des workflows de codage multi‑agents. Antigravity permet aux agents d’interagir directement avec un éditeur, un terminal et un navigateur, et de produire des « Artifacts » (listes de tâches, captures d’écran, enregistrements de navigation) qui documentent les actions des agents — répondant ainsi aux enjeux de traçabilité et de reproductibilité dans le développement agentique. Cela rend Gemini 3 Pro bien plus pratique pour des workflows développeurs réels que les modèles centrés uniquement sur la génération de texte.

Better tool use and coding

Google rapporte des améliorations spectaculaires sur un benchmark centré terminal (Terminal-Bench 2.0) qui mesure la capacité d’un modèle à opérer un ordinateur via le terminal : Gemini 3 Pro obtient 54,2 % à ce test — un grand bond par rapport aux versions précédentes de Gemini — indiquant de réels progrès en utilisation autonome d’outils et en génération de code.

Surtout lorsqu’on lui demande d’exécuter des scripts, d’orchestrer des outils ou de gérer des tâches développeur multi‑étapes. En pratique, cela signifie moins d’hallucinations lors de l’exécution de commandes, une meilleure gestion des erreurs et une capacité accrue à se remettre d’étapes échouées.

How does Gemini 3 Pro perform on benchmarks

Google a publié une large suite de comparaisons de benchmarks dans l’article de blog Gemini 3 couvrant le raisonnement NLP classique, la compréhension multimodale, la génération de code et l’utilisation d’outils agentiques. Chiffres clés reportés directement par Google :

- LMArena : Gemini 3 Pro a obtenu 1501 Elo, un classement de tête sur ce leaderboard compétitif (mesure du raisonnement général/qualité des réponses en confrontations pair‑à‑pair).

- MMMU-Pro (benchmark multimodal) : 81 % — une hausse importante vs les modèles précédents.

- Video-MMMU : 87,6 % sur des tâches multimodales conscientes de la vidéo.

- SimpleQA Verified : 72,1 %, indiquant des améliorations en QA factuelle pour des entrées complexes.

- WebDev Arena : 1487 Elo (développement Web / raisonnement de code).

- Terminal-Bench 2.0 & SWE-bench Verified : fortes progressions en utilisation d’outils agentiques et en performance d’agents de code.

- Deep Think : gains supplémentaires sur les tests de plus haute difficulté (par ex., Humanity’s Last Exam passe de 37,5 % à 41,0 % en Deep Think sur certains métriques annoncés).

Tout cela indique un modèle axé sur la profondeur plutôt que sur la simple génération de texte en surface.

Donc : oui, Gemini 3 Pro figure systématiquement dans le haut du panier sur de nombreux tests aujourd’hui — mais « écrase » dépend de la tâche. Pour la génération de code pure, certains concurrents restent au coude‑à‑coude ; pour le long contexte, les maths et la synthèse multimodale, Gemini 3 Pro est fréquemment présenté comme le meilleur de sa catégorie lors des exécutions de début novembre/novembre 2025.

How can you access Gemini 3 Pro Preview?

Official entry points

Google a rendu Gemini 3 Pro disponible en aperçu sur plusieurs surfaces :

- Application Gemini (grand public / utilisateurs Pro) : Le modèle est en cours de déploiement dans l’application Gemini dans le cadre du lancement de l’ère « Gemini 3 ».

- Google AI Studio / Gemini Developer API : Les développeurs peuvent expérimenter via AI Studio et l’API Gemini Developer. L’API propose des interfaces REST et SDK et prend en charge des fonctionnalités avancées comme l’appel de fonctions et le streaming.

- Vertex AI (Google Cloud) : Les entreprises et équipes peuvent accéder à Gemini 3 Pro via Vertex AI pour des workflows de production et de MLOps. Vertex propose des exemples en Python, Node, Java, Go et curl.

- Intégrations tierces (CometAPI) : CometAPI donne accès à l’API Gemini 3 Pro, avec le nom d’appel gemini-3-pro-preview. CometAPI propose un prix bien inférieur au tarif officiel pour faciliter votre intégration.

Quickstart: Python example (official SDK pattern)

Ci‑dessous un exemple Python minimal et pratique, adapté du quickstart Gemini de Google, qui montre comment appeler l’API Gemini via le client GenAI de Google. Remplacez GEMINI_API_KEY par votre clé API obtenue depuis Google AI Studio ou votre projet GCP.

# Example: call Gemini 3 Pro Preview using Google GenAI Python SDK

# Requires: pip install google-generativeai

import os

from google import genai

# Set API key in environment:

# export GEMINI_API_KEY="YOUR_API_KEY"

client = genai.Client() # client picks up GEMINI_API_KEY from env

# Use the preview model identifier. The exact model ID may vary; use the ID listed in the API docs.

model_id = "gemini-3-pro-preview" # or "gemini-3-pro" depending on availability

prompt = """

You are an assistant that writes a short Python function to fetch JSON from a URL,

handle HTTP errors, and return parsed JSON or None on failure.

"""

resp = client.models.generate_content(model=model_id, contents=prompt)

print("MODEL RESPONSE:\n", resp.text)

Si vous choisissez CometAPI, remplacez url par https://api.cometapi.com/v1/chat/completions et key par la clé que vous avez obtenue auprès de CometAPI.

How to get the best results — prompt patterns and tips

Use “thinking” mode for hard problems

Si vous résolvez des tâches de raisonnement progressif ou des problèmes complexes de maths/code, activez la variante « thinking » de l’aperçu (si disponible) — elle alloue davantage d’étapes de raisonnement interne et fournit souvent des solutions plus fiables sur les tâches multi‑étapes. Vérifiez la présence du suffixe -thinking dans les noms de modèles dans la console.

Function calling & tool orchestration

Utilisez des fonctions déclarées (Vertex AI/GenAI function calling) pour des sorties structurées et fiables et pour réduire les hallucinations. Laissez le modèle proposer des appels de fonction et exécutez‑les de manière déterministe dans votre environnement. La documentation d’appel de fonctions inclut des exemples renvoyant des arguments JSON typés que vous pouvez exécuter en toute sécurité.

Grounding when you need up-to-date facts

Si votre application dépend de faits Web à jour, utilisez le web grounding mais surveillez les coûts et limites de débit associés aux invites ancrées. Le grounding est puissant — il permet à Gemini d’interroger Search ou Maps — mais chaque invite ancrée peut modifier votre facturation et vos caractéristiques de latence.

How Gemini 3 Pro stacks up in real-world tasks (use cases)

Code generation & developer productivity

Gemini 3 Pro progresse sur le raisonnement multi‑fichiers, le contexte de dépôts longs et la synthèse de tests/documentation en parallèle du code. Associé à l’appel de fonctions et à un agent terminal, il peut échafauder et valider des projets de taille moyenne plus vite que les anciens modèles. Les tests de la communauté montrent des scores de codage LiveCodeBench/Elo en hausse.

Research & STEM workflows

La capacité Deep Think du modèle et un budget de raisonnement plus large le rendent bien adapté aux tâches de recherche nécessitant des dérivations mathématiques multi‑étapes, la synthèse de jeux de données ou la synthèse multi‑fichiers d’articles. Les premiers résultats de benchmarks le placent en tête ou proche de la tête sur de nombreux jeux de données STEM.

Content design, multimodal creative workflows

Les sorties multimodales de Gemini 3 Pro et son intégration avec Veo/Whisk/Flow en font un excellent choix pour des workflows mêlant texte, images et vidéo — des storyboards marketing aux brouillons vidéo automatisés. Google regroupe certains outils créatifs dans AI Ultra pour les créateurs souhaitant des limites supérieures.

Conclusion: does Gemini 3 Pro crush other models?

Gemini 3 Pro Preview est une avancée majeure. Sur un large éventail de benchmarks et dans les premiers tests en conditions réelles, il arrive fréquemment à égaler ou dépasser les meilleurs modèles disponibles fin 2025, en particulier pour :

- Raisonnement complexe (maths / STEM)

- Compréhension et synthèse multimodales

- Workflows agentiques et appel de fonctions

Cependant, la marge varie selon la tâche. Pour certaines tâches très ciblées (certains styles d’écriture créative, ou des connaissances de domaine très spécialisées), d’autres modèles restent compétitifs ou préférables selon le coût/la latence et l’adéquation à l’écosystème. Les benchmarks et scores divulgués suggèrent que Gemini 3 Pro se classe souvent dans le haut du panier, mais « écraser » dépend de la tâche — pour de nombreux cas d’usage entreprise et développeur, Gemini 3 Pro est désormais le premier modèle à évaluer.

How to get started with CometAPI

CometAPI est une plateforme d’API unifiée qui agrège plus de 500 modèles d’IA de fournisseurs majeurs — tels que la série GPT d’OpenAI, Gemini de Google, Claude d’Anthropic, Midjourney, Suno, et plus encore — au sein d’une interface unique et conviviale pour les développeurs. En offrant une authentification, un formatage des requêtes et une gestion des réponses homogènes, CometAPI simplifie radicalement l’intégration de capacités d’IA dans vos applications. Que vous construisiez des chatbots, des générateurs d’images, des compositeurs de musique ou des pipelines d’analytique pilotés par les données, CometAPI vous permet d’itérer plus vite, de maîtriser les coûts et de rester agnostique vis‑à‑vis des fournisseurs — tout en profitant des dernières avancées de l’écosystème IA.

Les développeurs peuvent accéder à l’API Gemini 3 Pro Preview via CometAPI. Pour commencer, explorez les capacités des modèles de CometAPI dans le Playground et consultez le guide de l’API pour des instructions détaillées. Avant d’y accéder, assurez‑vous de vous être connecté à CometAPI et d’avoir obtenu la clé API. CometAPI propose un prix bien inférieur au tarif officiel pour faciliter votre intégration.

Prêt à démarrer ? → Inscrivez‑vous à CometAPI dès aujourd’hui !

Si vous souhaitez plus d’astuces, de guides et d’actualités sur l’IA, suivez‑nous sur VK, X et Discord !