Principais recursos

- Renderização de texto nativa / de alta qualidade dentro de imagens — destaca-se na produção de texto legível e semanticamente preciso em imagens geradas (cartazes, embalagens, capturas de tela) — uma área em que muitos modelos de imagem anteriores tinham dificuldade.

- Saída multimodal de alta fidelidade — produz imagens fotorrealistas e estilizadas com bons detalhes e layout sensível ao idioma.

- Transferência de estilo e aprimoramento de detalhes — pode aplicar estilos artísticos consistentes ou aprimorar detalhes locais, preservando a coerência da cena.

Detalhes técnicos — como o Qwen-Image funciona

Arquitetura e componentes (palavras-chave: MMDiT, Qwen2.5-VL). O modelo usa um transformer de difusão baseado em MMDiT para síntese de imagens, combinado com um encoder visual-linguístico (Qwen2.5-VL) para interpretar prompts e contexto visual. Essa separação permite que o modelo trate orientação semântica e aparência de pixels de forma diferente, melhorando a fidelidade do texto e a consistência das edições. O repositório oficial e o relatório técnico observam uma arquitetura base de 20B parâmetros para o principal modelo T2I.

Pipeline de treinamento (palavras-chave: curriculum learning, pipeline de dados). Para resolver a difícil renderização de texto, o Qwen-Image usa um currículo progressivo: começa com imagens mais simples, sem texto, e gradualmente treina com exemplos mais complexos e ricos em texto, até entradas em nível de parágrafo. A equipe construiu um pipeline abrangente que inclui coleta em larga escala, filtragem cuidadosa, aumento sintético e balanceamento para garantir que o modelo veja muitas composições realistas de texto/foto durante o treinamento. Esse currículo estratégico é uma das principais razões pelas quais o modelo se destaca na renderização de texto multilíngue.

Mecanismo de edição (palavras-chave: codificação dupla, VAE + encoder VL). Para edição, o sistema alimenta a imagem original duas vezes: uma vez no encoder Qwen2.5-VL para controle semântico e outra vez em um encoder VAE para informações reconstrutivas de aparência. O design de codificação dupla permite que o módulo de edição preserve identidade e fidelidade visual, ao mesmo tempo em que permite modificações semânticas — por exemplo, substituir um objeto ou alterar conteúdo textual sem degradar regiões não relacionadas.

Desempenho em benchmarks

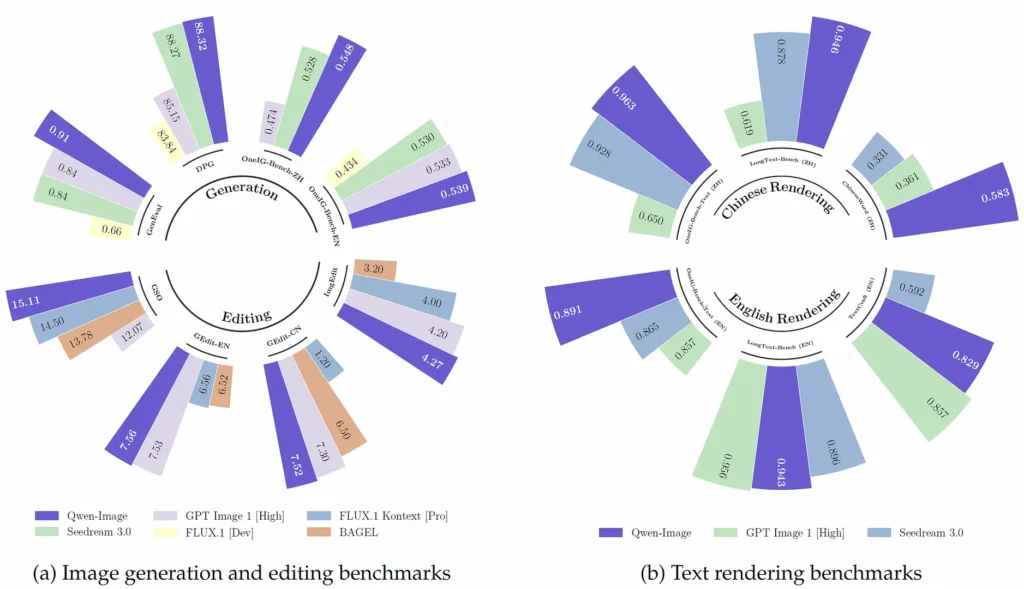

O Qwen-Image alcança desempenho SOTA ou próximo de SOTA em vários benchmarks públicos, tanto para geração quanto para edição, com resultados particularmente fortes em tarefas de renderização de texto e benchmarks de composição do mundo real (por exemplo, T2I-CoreBench e suítes selecionadas de edição de imagens).

Como o Qwen-Image se compara a outros modelos líderes

Pontos fortes relativos: renderização de texto e fidelidade de texto bilíngue são as vantagens distintivas do modelo em relação a muitos concorrentes generativos (por exemplo, DALL·E 3, SDXL, Midjourney), que frequentemente são mais fortes em composição puramente artística ou diversidade estilística, mas mais fracos em layout de texto denso com várias linhas ou em chinês. Múltiplas comparações da comunidade e as tabelas de benchmark dos autores do modelo sustentam essa caracterização.

Trade-offs relativos: em comparação com sistemas comerciais fechados e fortemente ajustados, o Qwen-Image pode exigir pós-processamento ou ajuste de prompt/adapter para atingir o mesmo nível de realismo em alguns contextos (distorção em superfícies curvas, composição fotorrealista), segundo testes independentes. Para usuários que priorizam designs padronizados, mockups de embalagens ou layouts de texto bilíngue, o Qwen-Image tende a ser preferível.

Casos de uso típicos e de alto valor

- Embalagens e mockups de produtos: texto preciso e layouts com várias linhas para rótulos e testes de embalagens.

- Publicidade e rascunhos de design: prototipagem rápida em que a fidelidade do texto é importante (cartazes, banners).

- Geração de imagens documentais: geração de imagens que devem incluir conteúdo legível (menus, placas, interfaces).

- Pipelines de edição de imagem: edições direcionadas (substituição de texto, adição/remoção de objetos) preservando estilo e perspectiva.

- Como acessar a API de imagem do Qwen

Etapa 1: Cadastre-se para obter uma chave de API

Faça login em cometapi.com. Se você ainda não for nosso usuário, registre-se primeiro. Entre no seu console do CometAPI. Obtenha a credencial de acesso, a chave de API da interface. Clique em “Add Token” na seção de token de API na central pessoal, obtenha a chave do token: sk-xxxxx e envie.

Etapa 2: Envie solicitações para a API de imagem do Qwen

Selecione o endpoint “qwen-image” para enviar a solicitação de API e defina o corpo da solicitação. O método da solicitação e o corpo da solicitação podem ser obtidos na documentação da API em nosso site. Nosso site também fornece teste no Apifox para sua conveniência. Substitua <YOUR_API_KEY> pela sua chave real do CometAPI da sua conta. A base url é Images no formato (https://api.cometapi.com/v1/images/generations) via CometAPI.

Insira sua pergunta ou solicitação no campo de conteúdo — é isso ao que o modelo responderá.

Etapa 3: Recupere e verifique os resultados

Processe a resposta da API para obter a resposta gerada. Após o processamento, a API responde com o status da tarefa e os dados de saída.