Spécifications techniques de l’API Seed 1.8

| Élément | Spécification / note |

|---|---|

| Nom du modèle / famille | Doubao-Seed-1.8 (Seed1.8) — ByteDance Seed / Volcano Engine |

| Modalités prises en charge | Texte, images, vidéo (capacités VLM multimodales), outils audio dans l’écosystème (modèles distincts pour la génération audio/vidéo). |

| Fenêtre de contexte (texte) | 256K jetons |

| Capacité vidéo/visuelle | Conçu pour le raisonnement sur longues vidéos, prend en charge un encodage visuel efficace et de larges budgets de jetons vidéo (la model card rapporte des tests et benchs). |

| Formats d’entrée | Prompts en texte libre ; chargement d’images (captures d’écran, graphiques, photos) ; vidéo sous forme d’images tokenisées / outils vidéo pour inspection de segments ; chargement de fichiers (documents). |

| Formats de sortie | Texte en langue naturelle, sorties structurées (structured-output beta), appels de fonctions / appels d’outils, code, et sorties multimodales via orchestration. |

| Modes de réflexion / d’inférence | no_think, think-low, think-medium, think-high — arbitrage entre précision et latence/coût. |

Qu’est-ce que Doubao Seed 1.8 ?

Doubao Seed 1.8 est la version 1.8 de l’équipe Seed : un LLM+VLM unifié visant explicitement l’agentivité généralisée dans le monde réel — c’est-à-dire la perception (images/vidéo), le raisonnement, l’orchestration d’outils (recherche, appels de fonctions, exécution de code, ancrage GUI) et la prise de décision en plusieurs étapes au sein d’un seul modèle. La conception met l’accent sur des « modes de réflexion » configurables (compromis entre latence et profondeur), un encodage visuel efficace et la prise en charge native du long contexte et des entrées multimodales, afin que le modèle puisse opérer comme assistant/agent autonome dans des workflows de production.

Principales fonctionnalités de l’API Seed 1.8

- Modèle agentique multimodal unifié. Intègre perception (image/vidéo), raisonnement (LLM) et action (appels d’outils/G U I, exécution de code) dans un seul modèle plutôt qu’un pipeline scindé. Cela permet des workflows d’agents compacts et une orchestration moins complexe.

- Contexte ultra-long et gestion des longues vidéos. Long contexte (prise en charge produit jusqu’à 256k jetons) et benchmarks dédiés aux longues vidéos (Seed1.8 montre une forte efficacité en jetons sur longues vidéos). Le modèle prend en charge des outils vidéo sélectifs (VideoCut) pour concentrer le raisonnement sur des horodatages.

- Automatisation GUI agentique et utilisation d’outils. Les benchmarks et tests internes (OSWorld, AndroidWorld, LiveCodeBench, benchmarks d’ancrage GUI) montrent des améliorations sur les tâches d’agent GUI et l’automatisation multi-étapes. Le modèle peut produire des commandes d’ancrage GUI et opérer dans des contextes OS/web/mobile simulés.

- Modes de réflexion configurables pour contrôler latence/coût. Quatre modes d’inférence permettent d’ajuster le calcul au moment du test pour des tâches interactives vs. des lots haute qualité. Utile pour les systèmes de production à budget de latence strict.

- Efficacité en jetons améliorée (multimodal). Seed 1.8 montre une meilleure efficacité en jetons sur des benchmarks multimodaux par rapport à ses prédécesseurs (Seed-1.5/1.6), atteignant une haute précision avec des budgets de jetons plus faibles dans plusieurs tâches de longues vidéos.

- Modes de réflexion configurables : arbitrer profondeur d’inférence vs latence/coût avec des modes distincts (

no_think→think-high) pour un usage en production interactif. - Capacités techniques

- Efficacité en jetons : Seed1.8 présente une nette efficacité en jetons vs prédécesseurs (Seed-1.5/1.6), offrant une meilleure précision à budgets de jetons réduits sur de longues tâches vidéo (p. ex., précision compétitive même à 32K jetons vidéo). Cela réduit le coût d’inférence pour de longues entrées.

- Raisonnement & perception multimodaux : Le modèle atteint le SOTA sur plusieurs tâches VQA multi-images et de mouvement/perception, et se classe deuxième ou proche du SOTA sur de nombreux benchmarks de raisonnement multimodal ; il surpasse son prédécesseur sur presque toutes les dimensions visuelles/vidéo mesurées.

- Utilisation agentique d’outils & ancrage GUI : Prise en charge documentée de l’ancrage GUI et de benchmarks d’opérations sur écran (ScreenSpot-Pro, agent GUI) avec de forts scores d’ancrage (p. ex., améliorations vs Seed-1.5-VL sur ScreenSpot-Pro).

- Raisonnement parallèle / par étapes : Augmenter le calcul au moment du test (réflexion parallèle) apporte des gains mesurables sur les benchmarks de math, codage et raisonnement multimodal.

Points saillants sélectionnés des benchmarks publics de Seed1.8

- VCRBench (raisonnement visuel de sens commun) : Seed1.8 a obtenu 59.8 (Pass@1 reporté dans la table de la model card), une amélioration sur Seed-1.5-VL et compétitif avec les meilleurs modèles.

- VideoHolmes (raisonnement vidéo) : Seed1.8 65.5, surpassant Seed-1.5-VL et se rapprochant des modèles concurrents de niveau pro.

- MMLB-NIAH (contexte long multimodal, 128k) : Seed1.8 a atteint 72.2 Pass@1 à 128k de contexte sur MMLB-NIAH, dépassant certains modèles pro contemporains.

- Suite Motion & Perception : SOTA sur 5 des 6 tâches évaluées ; exemples incluant TVBench, TempCompass et TOMATO où Seed1.8 montre des gains substantiels en perception temporelle.

- Workflows agentiques : Sur BrowseComp et d’autres benchmarks de recherche/code agentiques, Seed1.8 se classe souvent au niveau ou au-dessus de modèles pro concurrents.

Seed 1.8 vs Gemini 3 Pro / GPT-5.x

- Seed1.8 vs Seed-1.5-VL / Seed-1.6 : Améliorations nettes en perception multimodale, efficacité en jetons pour longues vidéos et exécution agentique.

- Seed1.8 vs Gemini 3 Pro / GPT-5.x : Sur de nombreux benchmarks multimodaux, Seed1.8 égale ou dépasse Gemini 3 Pro (SOTA sur plusieurs tâches VQA/mouvement ; meilleur sur MMLB-NIAH en contexte 128k). Cependant, la fiche montre aussi des domaines où les modèles de la famille Gemini conservent des avantages sur certaines tâches de connaissances disciplinaires — l’ordre relatif dépend donc du benchmark.

- Variante Seed-Code (Doubao-Seed-Code) : spécialisée pour les tâches de programmation/code agentique (long contexte pour bases de code ; benchmarks SWE spécialisés). Seed1.8 est le modèle multimodal agentique généraliste, tandis que Seed-Code est la variante axée programmation.

Cas d’usage pratiques via l’API Seedream 4.5 sur CometAPI

- Assistants de recherche multimodaux & analyse documentaire : extraire, résumer et raisonner à travers de longs documents, jeux de diapositives et rapports multi-pages.

- Compréhension & surveillance de longues vidéos : analytique de sécurité/sports, synthèse de longues réunions et analyses en flux où l’efficacité en jetons vidéo du modèle est cruciale.

- Workflows agentiques / automatisation : scénarios multi-étapes de recherche web + exécution de code + extraction de données (p. ex., analyses concurrentielles automatisées, planification de voyages, pipelines de recherche démontrés dans des benchmarks internes).

- Outils pour développeurs (si utilisation de Seed-Code) : analyse de grands codebases, assistants IDE, et exécution de code agentique pour test & réparation (Seed-Code est la variante spécialisée recommandée).

- Automatisation GUI & RPA : les benchmarks d’ancrage d’écran et d’agent GUI indiquent que le modèle exécute des tâches GUI structurées mieux que les versions Seed précédentes.

Comment utiliser l’API doubao Seed 1.8 via CometAPI

Doubao seed1.8 est proposé commercialement via CometAPI comme une API d’inférence hébergée. L’API prend en charge des charges utiles multimodales (texte + images + fragments/horodatages vidéo) et des modes d’inférence configurables pour arbitrer latence et calcul contre la qualité des réponses.

Modèles d’appel : l’API prend en charge les requêtes style chat/completion standard, les réponses en streaming, et des flux agentiques où le modèle émet des appels d’outils (recherche, exécution de code, actions GUI) et ingère les sorties d’outils comme contexte ultérieur.

Streaming & gestion du long contexte : l’API prend en charge le streaming et dispose de primitives de gestion de contexte intégrées pour les longues sessions (pour permettre des contextes 100K+ / traces d’agents multi-étapes).

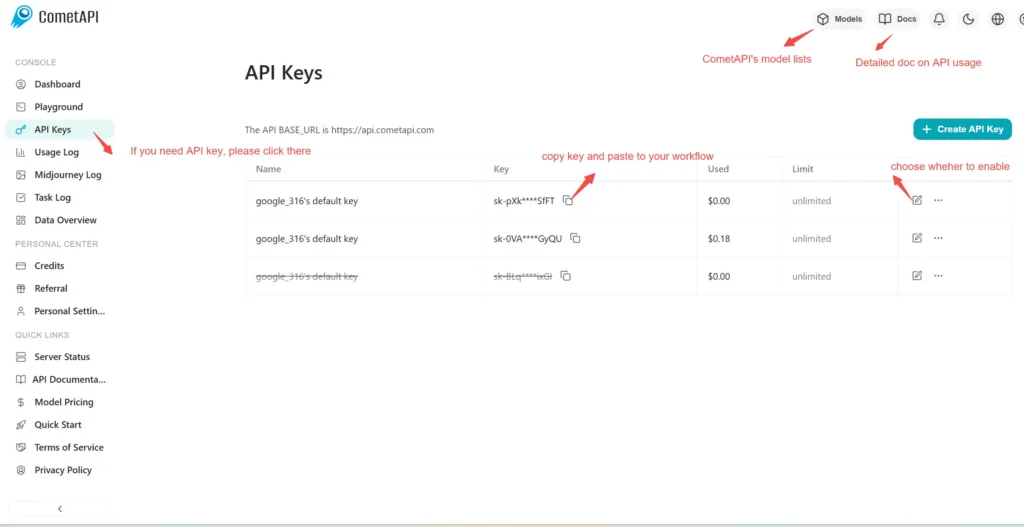

Étape 1 : Inscrivez-vous pour obtenir une clé API

Connectez-vous à cometapi.com. Si vous n’êtes pas encore utilisateur, veuillez vous inscrire d’abord. Connectez-vous à votre console CometAPI. Récupérez la clé API d’accès à l’interface. Cliquez sur “Add Token” dans la section API token du centre personnel, obtenez la clé de jeton : sk-xxxxx et soumettez.

Étape 2 : Envoyez des requêtes à l’API doubao Seed 1.8

Sélectionnez l’endpoint “doubao-seed-1-8-251228 ” pour envoyer la requête API et définissez le corps de la requête. La méthode et le corps de la requête sont disponibles dans la documentation API de notre site. Notre site fournit également un test Apifox pour votre commodité. Remplacez <YOUR_API_KEY> par votre clé CometAPI réelle depuis votre compte. Compatibilité avec les API Chat.

Insérez votre question ou demande dans le champ content — c’est à cela que le modèle répondra. Traitez la réponse de l’API pour obtenir la réponse générée.

Étape 3 : Récupérez et vérifiez les résultats

Traitez la réponse de l’API pour obtenir la réponse générée. Après traitement, l’API renvoie le statut de la tâche et les données de sortie.