Qu’est-ce que l’API GPT-Image-1.5 ?

GPT-Image-1.5 est le tout dernier membre de la famille d’images GPT d’OpenAI et le modèle derrière la nouvelle expérience Images de ChatGPT. Il est conçu pour faire passer la génération d’images de la phase d’expérimentation à un outillage créatif de niveau production : photoréalisme accru, contrôle plus fin pour les modifications itératives et inférence plus rapide pour prendre en charge des workflows interactifs et d’entreprise.

L’API gpt-image-1.5 est un endpoint de modèle d’image multimodal qui accepte une ou plusieurs images en entrée (identifiants de fichiers ou octets) plus un prompt texte, et renvoie des images générées ou des images éditées. Elle prend en charge :

- Génération texte-vers-image (création à partir d’un prompt),

- Édition d’image / in-painting / composition (appliquer des instructions à des images existantes, plusieurs images d’entrée possibles), et

- Workflows d’édition itératifs et multitours via l’API Responses (permet des interfaces “ajuster et itérer”).

L’API traite les prompts image différemment des anciennes limites de DALL·E : les modèles d’images GPT acceptent des prompts textuels nettement plus longs (recommandation de 32,000 caractères), rendant possibles des instructions complexes et riches en contraintes.

Fonctionnalités principales (pratiques)

- Meilleure éditabilité / cohérence sur plusieurs tours : préserve l’apparence des personnages, l’éclairage et les attributs visuels clés au fil des modifications itératives. Cela rend « même modèle, éditions répétées » plus fiable pour des workflows comme les catalogues produits ou les assets de marque.

- Débit plus rapide — améliorations de vitesse ×4 par rapport à GPT Image 1, visant à réduire la latence pour les workflows créatifs itératifs.

- Optimisations de coût — coûts d’entrée/sortie d’image réduits d’environ 20 % par rapport à GPT Image 1, abaissant le coût par itération d’image pour les utilisateurs à fort volume.

- Composition multi-image et référence de style — accepte plusieurs images de référence pour composer des scènes ou transférer style/éclairage.

- Réglages de qualité/fidélité — paramètres d’API permettant d’équilibrer vitesse et fidélité (utiliser une qualité plus faible pour la génération en masse ; plus élevée pour les assets de production).

- Édition multitours / intégration à l’API Responses — permet des workflows pas à pas (demander des changements, puis « affiner » en préservant l’état).

Capacités techniques

- Limite du prompt texte (modèles image) : jusqu’à 32,000 caractères (note : OpenAI le documente comme la longueur de texte autorisée pour les modèles d’images GPT). À utiliser pour des prompts longs et riches en contraintes.

- Entrées image : accepte des ID de fichiers (privilégiés pour les flux multitours) ou des octets bruts ; plusieurs images peuvent être fournies pour la composition et la référence.

- Sorties : artefacts image PNG/JPEG ou défaut de la plateforme renvoyés par l’API (ou en pièces jointes dans ChatGPT). Les sorties peuvent inclure plusieurs images candidates et prendre en charge des requêtes itératives pour affiner un résultat.

- Modes de génération : texte-vers-image, édition d’image (inpaint/extension avec instructions) et variantes. L’édition multitours prend en charge des instructions de type « ajouter/soustraire/combiner ».

- Édition sensible aux instructions : les modèles sont optimisés pour la fidélité aux instructions (préserver des invariants spécifiés comme « ne pas modifier le logo », « conserver la pose et l’éclairage »). Des schémas d’ingénierie de prompt (répéter explicitement les invariants à chaque itération) réduisent la dérive sémantique.

Performances de référence

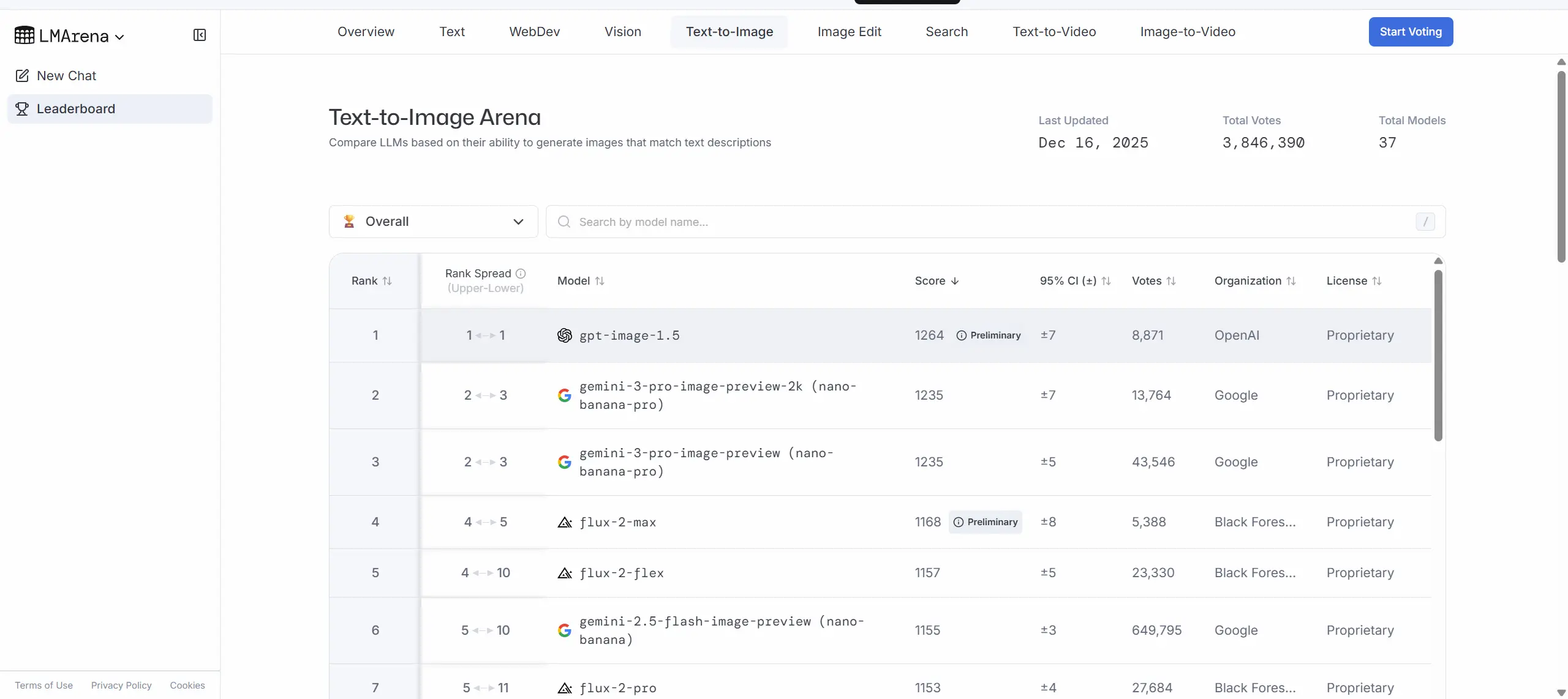

- Positionnement au classement : un rapport agrégé cite GPT Image 1.5 en tête des classements texte-vers-image avec ~1264 points sur un leaderboard d’Artificial Analysis, devant le modèle suivant d’une marge mesurable.

- Métriques par tâche (édition & préservation) : un résumé de Microsoft Foundry des métriques d’évaluation montre que GPT-Image-1.5 atteint un succès quasi parfait en modification binaire (100 % sur un BinaryEval à un seul tour) et de solides scores de préservation de visage (environ 90 % sur les mesures AuraFace) dans leur tableau comparatif face à des concurrents et d’anciens modèles OpenAI. Ces métriques comparatives placent GPT-Image-1.5 devant certains rivaux en matière de préservation et de fidélité d’édition.

Comparaison de GPT-Image-1.5 avec ses pairs

- Par rapport à GPT Image 1 (génération OpenAI précédente) : plus rapide (jusqu’à ×4), moins cher (~20 % de coût d’E/S image en moins) et meilleure fidélité d’édition — objectif : passer de la « démo/prototype » à des workflows d’image adaptés à la production.

- Par rapport aux modèles image Nano Banana Pro / Gemini de Google : GPT-Image-1.5 et la famille Nano Banana Pro / Gemini 3 de Google sont des rivaux proches — chacun ayant des points forts selon les classes de prompts. La communication d’OpenAI met l’accent sur la fidélité d’édition et la vitesse d’itération ; l’offre de Google est saluée pour un réalisme de niveau studio dans certains exemples.

- Par rapport à Qwen Image et autres modèles ouverts/fermés : GPT-Image-1.5 surpasse Qwen Image sur plusieurs métriques d’édition et de préservation dans des évaluations à un seul tour, mais les écarts se réduisent en multitours ou dans d’autres tests spécifiques au domaine.

Domaines où GPT-Image-1.5 excelle

- Imagerie produit e-commerce : variantes en masse, changements d’arrière-plan, catalogues produits cohérents à partir d’une seule photo (préservation marque/logo).

- Production d’assets créatifs et marketing : itérations rapides de concepts, maquettes photoréalistes, transferts de style contrôlés.

- Retoque photo et workflows éditoriaux : essayages réalistes de vêtements/coiffures, retouche sélective qui préserve l’identité et l’éclairage.

- Intégration aux outils de design : branchement dans des plateformes de design ou CMS pour des variantes d’images à la demande (les réglages de fidélité aident à maîtriser les coûts).

- Pipelines de composition en plusieurs étapes : les entrées multi-images permettent la composition et la génération basée sur références pour des scènes complexes.

Comment accéder à l’API GPT Image 1.5

Étape 1 : S’inscrire pour obtenir une clé d’API

Connectez-vous à cometapi.com. Si vous n’êtes pas encore utilisateur, veuillez d’abord vous inscrire. Connectez-vous à votre Console CometAPI. Récupérez la clé d’identification d’accès API de l’interface. Cliquez sur « Add Token » au niveau du jeton d’API dans le centre personnel, obtenez la clé du jeton : sk-xxxxx et soumettez.

Étape 2 : Envoyer des requêtes à l’API GPT Image 1.5

Sélectionnez l’endpoint « gpt-image-1.5 » pour envoyer la requête API et définissez le corps de la requête. La méthode et le corps de la requête sont disponibles dans la documentation API de notre site. Notre site fournit également un test Apifox pour votre convenance. Remplacez <YOUR_API_KEY> par votre clé CometAPI réelle de votre compte. l’URL de base est Images (https://api.cometapi.com/v1/images/generations) et [Image Editing]

Insérez votre question ou votre demande dans le champ content — c’est à cela que le modèle répondra. Traitez la réponse de l’API pour obtenir la réponse générée.

Étape 3 : Récupérer et vérifier les résultats

Traitez la réponse de l’API pour obtenir la réponse générée. Après le traitement, l’API répond avec l’état de la tâche et les données de sortie.

Voir aussi Gemini 3 Pro Preview API