L’intégration de CometAPI avec n8n vous permet d’alimenter vos automatisations avec les modèles d’IA les plus avancés au monde en seulement trois étapes. En utilisant un identifiant unique compatible OpenAI, vous accédez instantanément à plus de 500 modèles, dont GPT 5.5, Claude Opus 4.7 et DeepSeek V4 Pro. Cette configuration est identique pour les instances n8n cloud et auto‑hébergées, offrant une base stable et hautement disponible pour l’automatisation de vos workflows d’IA dans n8n.

Qu’est-ce que n8n et pourquoi c’est important

n8n est un outil open source d’automatisation de workflows. Il vous permet de connecter différentes applications, services et API pour automatiser des tâches — sans avoir besoin d’écrire beaucoup de code.

Ce que fait n8n

Considérez n8n comme une manière visuelle de créer des automatisations :

- Vous créez des workflows dans un éditeur par glisser‑déposer

- Chaque étape (appelée un nœud) exécute une action

- Les données circulent automatiquement d’une étape à la suivante

Fonctionnalités clés

- Open source (vous pouvez l’héberger vous‑même)

- Prend en charge des centaines d’intégrations (API, applications, bases de données)

- Autorise de la logique JavaScript personnalisée dans les workflows

- Peut s’exécuter sur votre propre serveur ou via le service cloud sur le site officiel de n8n

Pourquoi connecter n8n à CometAPI

Utiliser CometAPI comme passerelle centrale dans n8n apporte d’importants avantages opérationnels. En remplaçant des clés séparées pour OpenAI, Anthropic et Google par un seul identifiant, votre équipe élimine la charge de gérer plusieurs comptes fournisseurs et des cycles de facturation complexes. Cette architecture garantit l’absence de verrouillage fournisseur : vous pouvez passer aux derniers modèles de différents fournisseurs en mettant simplement à jour le nom du modèle dans les paramètres du nœud, ce qui permet à vos workflows de rester agiles à mesure que le paysage de l’IA évolue.

CometAPI est une API REST unifiée agrégeant plus de 500 modèles pour le chat, l’image, la vidéo, l’audio (TTS/STT) et les embeddings. Les principaux avantages incluent :

- Endpoint compatible OpenAI (

https://api.cometapi.com/v1) : compatibilité immédiate avec les nœuds OpenAI ou HTTP Request. - Tarifs inférieurs de 20 à 40 % par rapport aux fournisseurs directs, avec paiement à l’usage, pas de frais mensuels pour l’essentiel et facturation unifiée.

- Aucun verrouillage fournisseur : changez de modèle avec un seul paramètre.

- Fonctionnalités Enterprise : routage de basculement (failover), analytics, contrôles de confidentialité (pas de collecte des prompts, selon certaines discussions) et accès fiable.

Derniers développements (à mai 2026) : CometAPI maintient une intégration vérifiée/partenaire sur n8n.io, avec un nœud communautaire dédié (n8n-nodes-cometapi) disponible via npm pour les instances locales/auto‑hébergées. Les utilisateurs rapportent une compatibilité fluide avec le nœud OpenAI et une adoption croissante pour les workflows multi‑modèles. Les mises à jour récentes de n8n améliorent l’appel d’outils et les nœuds HTTP, rendant les intégrations plus robustes.

Pour commencer : prérequis et configuration du compte

Inscrivez-vous à CometAPI

Visitez cometapi.com, créez un compte gratuit et générez une clé d’API dans le tableau de bord. Les nouveaux utilisateurs obtiennent souvent des crédits d’essai. Explorez la liste des modèles et la page des tarifs.

Configurer n8n

- Cloud : n8n.cloud (géré, montée en charge facile).

- Auto‑hébergé : Docker, npm ou Kubernetes. Recommandé pour la confidentialité des données et des exécutions illimitées. Des guides récents couvrent l’exécution de nœuds CometAPI en local.

Mettez à jour vers la dernière version (par ex., 2.20+ à mai 2026) pour les améliorations IA et de stabilité.

Installer le nœud CometAPI (optionnel mais recommandé en auto-hébergement)

Utilisez le nœud communautaire :

npm install n8n-nodes-cometapi

Redémarrez n8n. Il apparaît dans le panneau des nœuds pour une expérience quasi native.

Guide d’installation étape par étape

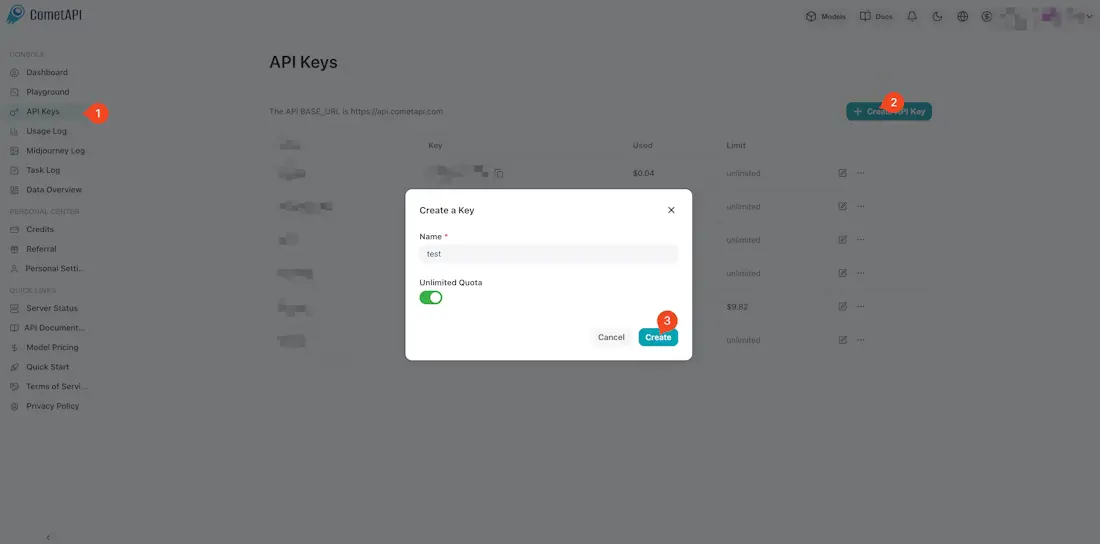

Étape 1 : Obtenez votre clé d’API CometAPI

Connectez‑vous au tableau de bord CometAPI et accédez à la section API Token. Cliquez sur Add API Key pour générer votre identifiant unique.

Copiez votre clé (généralement au format sk-xxxx) et gardez l’URL de base à portée de main : https://api.cometapi.com/v1.

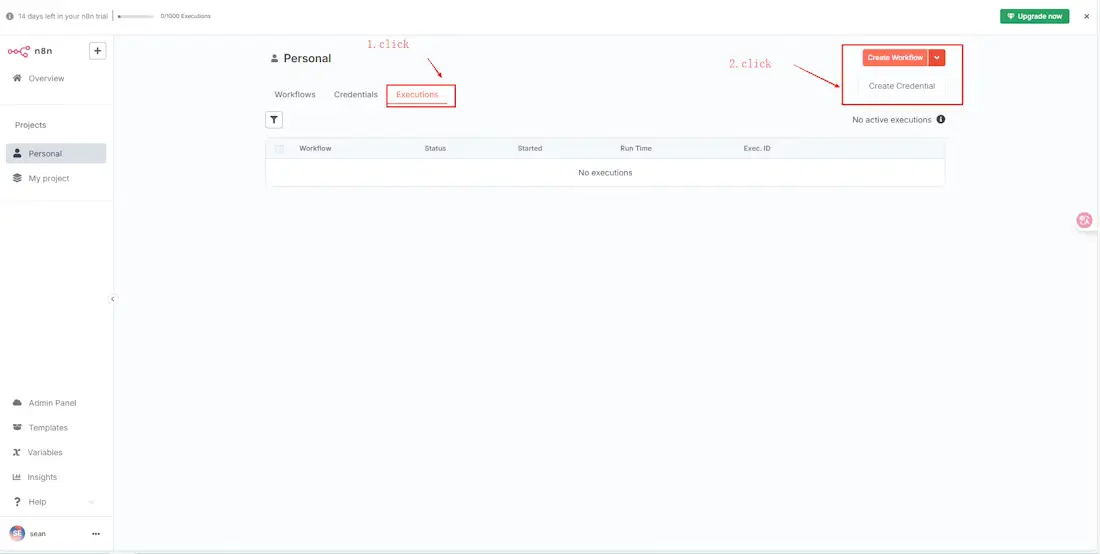

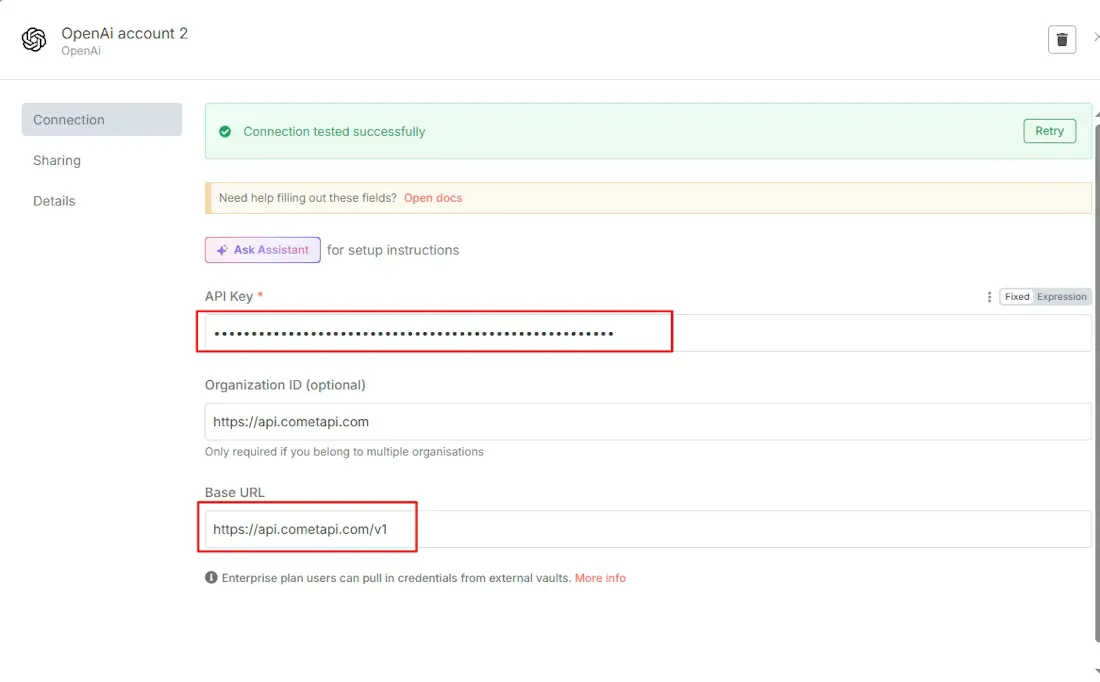

Étape 2 : Créez un identifiant OpenAI dans n8n

Ouvrez votre instance n8n et accédez à Credentials → Create Credential. Recherchez et sélectionnez le type d’identifiant OpenAI API.

- API Key : Collez votre jeton CometAPI ici.

- Base URL : Saisissez

https://api.cometapi.com/v1.

Cliquez sur Save pour finaliser la configuration.

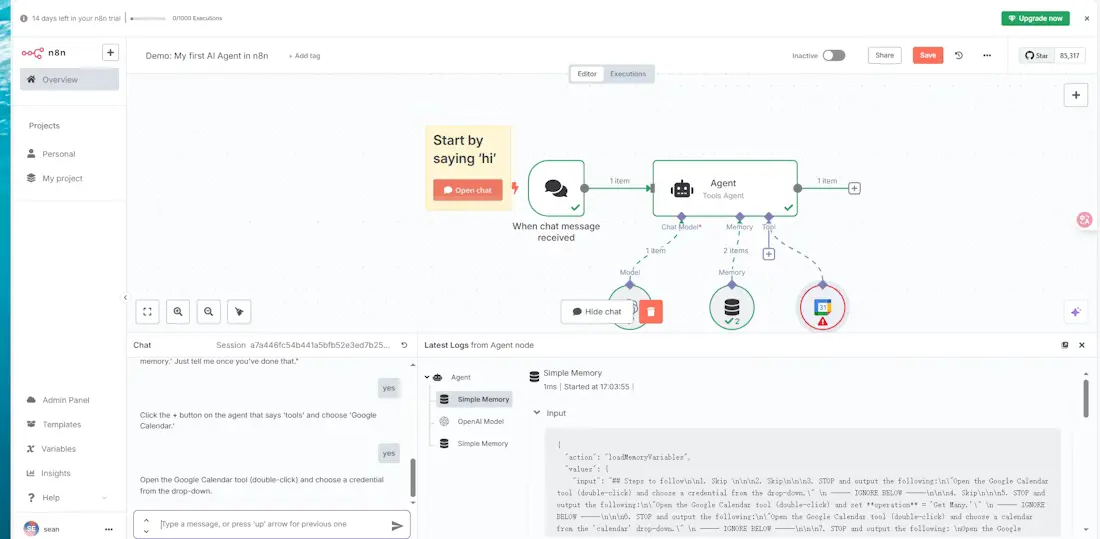

Étape 3 : Testez votre connexion

Créez un nouveau workflow et ajoutez un nœud OpenAI (comme le nœud Chat Model ou AI Agent). Sélectionnez l’identifiant CometAPI que vous venez de créer. Dans le champ model, vous pouvez désormais saisir n’importe quel ID de modèle pris en charge, comme gpt-5.5 ou claude-opus-4-7. Exécutez le nœud ; une réponse réussie vérifie que votre pont d’API compatible OpenAI pour n8n est correctement configuré.

Dépannage des problèmes courants

Si votre intégration ne fonctionne pas immédiatement, vérifiez ces trois points courants :

L’API renvoie une erreur 401 Unauthorized

Cette erreur signifie généralement que n8n ne peut pas s’authentifier auprès de la passerelle. D’abord, vérifiez que votre clé d’API a été copiée correctement, sans espaces au début ni à la fin. Ensuite, assurez‑vous que votre Base URL inclut le suffixe /v1. Sans le chemin de version, l’endpoint peut rejeter la requête.

Nom de modèle non reconnu

CometAPI héberge plus de 500 modèles, chacun avec un identifiant spécifique. Si n8n renvoie « Model not found », assurez‑vous d’utiliser l’ID exact du modèle figurant dans la documentation CometAPI. Par exemple, utilisez gpt-5.5-pro plutôt que simplement gpt-5-pro si c’est l’identifiant du catalogue actuel.

La vitesse de réponse est lente

Pour les applications en temps réel où la latence est critique, certains modèles fortement orientés raisonnement peuvent prendre plus de temps à traiter. Si votre workflow requiert des réponses quasi instantanées, essayez de passer à un modèle à haut débit comme Gemini 3.1 Flash-Lite ou DeepSeek V4 Flash, optimisés pour la vitesse.

Quels modèles pouvez-vous utiliser dans n8n via CometAPI

| Catégorie de modèle | Exemples | Idéal pour |

|---|---|---|

| Texte/Chat | GPT 5.5, Claude Opus 4.7, Gemini 3.1 Pro | Raisonnement professionnel et logique complexe |

| Code | DeepSeek V4 Pro, GPT 5.3 Codex | Codage agentique et refactorisations à l’échelle d’un dépôt |

| Image | GPT Image 2, Flux 2 Max | Contenus visuels haute fidélité et design |

| Vidéo | Sora 2, Doubao-Seedance 2.0 | Automatisation cinématographique et clips vidéo sociaux |

Modèles de workflows n8n prêts à l’emploi

L’intégration de CometAPI dans n8n permet une logique multi‑modèles sophistiquée. Voici trois modèles que vous pouvez construire dès aujourd’hui.

Modèle 1 : Automatisation du support client

- Déclencheur : un nœud Webhook reçoit un ticket d’assistance depuis votre site web.

- Traitement : un nœud CometAPI (OpenAI) utilise Claude Opus 4.7 pour analyser le texte du ticket.

- Logique : un nœud Switch évalue la « gravité » ou la « complexité » fournies par l’IA.

- Branchement : les demandes simples (par ex., « Où est ma commande ? ») sont routées vers un nœud de réponse automatisée. Les problèmes techniques complexes sont routés vers un nœud Slack ou nœud Zendesk pour intervention humaine.

- Configuration du nœud : réglez le nœud Claude sur

thinking: {type: "adaptive"}pour qu’il consacre plus de temps aux analyses de sentiment difficiles.

Modèle 2 : Chaîne de contenu automatisée

- Déclencheur : un nœud RSS Feed détecte un nouvel article dans votre secteur.

- Traitement 1 : utilisez GPT 5.5 pour lire l’article et générer un résumé exécutif de 200 mots pour votre newsletter interne.

- Traitement 2 : transmettez ce résumé à DeepSeek V3 pour générer cinq tags et mots‑clés optimisés SEO.

- Sortie : le résumé et les tags sont publiés dans une base de données Notion ou via un nœud WordPress.

- Pourquoi cette approche ? : en utilisant GPT 5.5 pour un résumé de haute qualité et le modèle moins coûteux DeepSeek V3 pour le simple étiquetage, vous maintenez une qualité élevée tout en réduisant significativement votre coût total en tokens.

Modèle 3 : Workflow de génération d’images

- Déclencheur : un nœud Google Sheets détecte une nouvelle ligne contenant un nom de produit et une description.

- Traitement : la description est envoyée à un nœud CometAPI (OpenAI) utilisant l’endpoint

/v1/images/generationsavec le modèle Flux 2 Max. - Stockage : l’URL de l’image générée est transmise à un nœud Google Drive pour téléverser et enregistrer le fichier.

- Configuration du nœud : définissez le paramètre

nà 1 et choisissez une résolution comme1024x1024pour des mockups produit de haute qualité.

Conseils d’optimisation des coûts pour n8n + CometAPI

Pour maximiser votre remise de 20 à 40 %, appliquez les stratégies d’architecture suivantes.

Utilisez des modèles économiques pour la classification et le routage

N’utilisez pas GPT 5.5 Pro pour de simples décisions « Oui/Non » ou « Catégorie A/B ». Utilisez DeepSeek V4 Flash ou GPT 5.4 nano pour ces tâches. Ces modèles coûtent une fraction des modèles phares et sont souvent plus rapides, ce qui rend l’exécution de votre workflow n8n plus efficace.

Définissez une sélection conditionnelle de modèles dans n8n

Utilisez un nœud Switch ou nœud If pour sélectionner un modèle selon la longueur d’entrée ou la priorité. Par exemple, si un document fait moins de 1 000 mots, orientez‑le vers un modèle standard. S’il s’agit d’un dépôt massif de 500 000 tokens, orientez‑le vers un modèle à long contexte comme Grok 4.20 ou Claude Opus 4.7.

Traitement par lots vs temps réel

Si votre workflow n8n n’exige pas de réponses immédiates (par ex., un rapport en fin de journée), utilisez un nœud Wait ou un nœud Schedule pour rassembler les entrées et les traiter en un seul lot. CometAPI prend en charge une forte concurrence, mais réduire la fréquence des petits appels séparés peut vous aider à rester dans des paliers de taux inférieurs et à simplifier vos journaux d’utilisation.

Tableau de comparaison : n8n + CometAPI vs alternatives

| Fonctionnalité | n8n + CometAPI | Zapier + Multiple AIs | Make.com + Direct APIs | Code personnalisé (Python/Node) |

|---|---|---|---|---|

| Coût | Faible (économies de 20 à 40 % + n8n gratuit/auto‑hébergé) | Élevé (par tâche + par API) | Moyen | Variable (temps de dev) |

| Facilité d’utilisation | Visuel, low-code | Très facile | Visuel | Beaucoup de code requis |

| Flexibilité | Illimitée (HTTP + 400+ nœuds) | Modèles limités | Bonne | La plus élevée |

| Accès aux modèles | 500+ unifiés | Fragmenté | Dépend | Manuel |

| Auto‑hébergement/Confidentialité des données | Excellent | Limité | Axé cloud | Contrôle total |

| Évolutivité | Élevée (modes file d’attente, workers) | Plafonds selon l’usage | Bonne | Dépend de l’infra |

| Maintenance | Faible (une intégration) | Élevée (connexions multiples) | Moyenne | Élevée |

| Prise en charge des agents IA | Natif + outils | Basique | En croissance | Personnalisé |

Verdict : n8n + CometAPI l’emporte pour les équipes ayant besoin de puissance, de contrôle et d’efficacité coût.

Perspectives et conseils d’optimisation

À mesure que les modèles d’IA se multiplient en 2026, des plateformes unifiées comme CometAPI associées à des orchestrateurs flexibles comme n8n deviennent essentielles. Attendez‑vous à des nœuds plus natifs, de meilleures intégrations MCP/serveur et des capacités d’agents avancées.

Optimisation sur Cometapi.com :

- Suivez l’utilisation des jetons à travers les workflows pour analyser le ROI.

- Exploitez les analytics de CometAPI + les données d’exécutions n8n.

- Expérimentez de nouveaux modèles (par ex., DeepSeek-V4) pour des tâches spécialisées à moindre coût.

- Combinez avec d’autres outils CometAPI pour des solutions d’IA de bout en bout.

Guide rapide : Construisez aujourd’hui un workflow de synthèse simple. Montez en charge vers des opérations d’IA complètes demain.

Prêt à vous lancer ? Rendez‑vous sur CometAPI pour votre clé d’API gratuite et des crédits. En auto‑hébergement ou sur le cloud n8n, connectez‑vous via les étapes ci‑dessus et transformez vos automatisations. Pour des workflows sur mesure ou du conseil entreprise, explorez les options sur Cometapi.com.

Cette intégration n’est pas seulement technique — c’est un multiplicateur stratégique de productivité et d’innovation à l’ère de l’IA.

FAQ

Q : Ai-je besoin d’un identifiant distinct pour chaque modèle d’IA ?

R : Non. Un seul identifiant CometAPI donne accès à plus de 500 modèles dans n8n, de GPT et Claude à DeepSeek et Kimi.

Q : CometAPI est-il moins cher que l’utilisation directe d’OpenAI dans n8n ?

R : Oui. Les prix de CometAPI sont fixés 20 à 40 % en dessous des tarifs officiels de détail pour les mêmes modèles.

Q : Cela fonctionne-t-il avec n8n auto‑hébergé ?

R : Oui. Le processus de configuration est identique sur n8n Cloud et les versions Docker auto‑hébergées.

Q : Quels nœuds n8n fonctionnent avec CometAPI ?

R : Tout nœud qui accepte des identifiants OpenAI fonctionne, y compris AI Agent, Chat Model et les nœuds de complétion standard.

Q : Puis-je changer de modèle sans reconfigurer n8n ?

R : Oui. Modifiez simplement la chaîne du nom du modèle dans les paramètres du nœud (par ex., changez gpt-5.5 en claude-opus-4-7) ; l’identifiant sous‑jacent reste valide pour tous les fournisseurs.