La OpenThinker-32B API est une interface open source hautement efficace qui permet aux développeurs de tirer parti de la compréhension avancée du langage, des capacités multimodales et des fonctionnalités personnalisables du modèle pour une large gamme d'applications avec une surcharge de ressources minimale.

Introduction

L’intelligence artificielle continue de redéfinir les limites de la technologie, et OpenThinker-32B témoigne de cette évolution. Conçu pour repousser les limites de l'apprentissage automatique, ce modèle représente une avancée significative dans le traitement du langage naturel (TALN), le raisonnement et l'intelligence multimodale. Que vous soyez développeur, chercheur ou chef d'entreprise, comprendre les subtilités de OpenThinker-32B peut ouvrir de nouvelles possibilités d’innovation et d’efficacité.

Dans cette introduction complète, nous explorerons les OpenThinker-32B Découvrez le modèle en profondeur, en commençant par sa définition de base et son API, puis son architecture technique, son évolution, ses principaux avantages, ses indicateurs de performance mesurables et ses scénarios d'application concrets. À la fin, vous comprendrez clairement pourquoi ce modèle d'IA est appelé à façonner l'avenir des systèmes intelligents.

Qu'est-ce qu'OpenThinker-32B ? Aperçu rapide

En son coeur, OpenThinker-32B est un modèle d'IA basé sur un transformateur de 32 milliards de paramètres, développé pour exceller dans la compréhension de langages complexes, la génération et la résolution de problèmes multitâches. API OpenThinker-32B peut être décrit en une phrase : Une interface puissante qui permet aux développeurs d'intégrer facilement des capacités avancées de PNL, de raisonnement et multimodales dans les applications. Conçu dans un souci d'évolutivité et d'adaptabilité, il s'adresse à un large éventail de secteurs, des soins de santé à la finance en passant par la génération de contenu créatif.

L'architecture du modèle s'appuie sur les avancées de pointe en matière d'apprentissage profond, ce qui en fait un outil unique dans le paysage saturé des solutions d'IA. Sa capacité à traiter de vastes ensembles de données, à générer du texte de type humain et à effectuer un raisonnement contextuel en fait un outil polyvalent, tant pour les applications académiques que commerciales.

Les fondements techniques d'OpenThinker-32B

Architecture du modèle

La OpenThinker-32B Le modèle repose sur une architecture de type Transformer, un framework devenu la pierre angulaire des systèmes de traitement du langage naturel (TALN) modernes. Avec 32 milliards de paramètres, il allie efficacité de calcul et hautes performances. L'architecture comprend plusieurs couches de nœuds interconnectés, permettant au modèle de capturer les dépendances à longue portée dans le texte et d'effectuer un traitement parallèle des données.

Les principaux composants techniques comprennent :

- Mécanismes d'attention:Les couches d'auto-attention multi-têtes améliorées permettent OpenThinker-32B se concentrer sur les parties pertinentes des données d’entrée, améliorant ainsi la précision des tâches telles que la traduction et le résumé.

- tokenization:Un tokeniseur personnalisé optimise le traitement des entrées, réduit la latence et améliore la capacité du modèle à gérer divers langages et formats.

- Données d'entraînement:Formé sur un corpus massif et diversifié de textes et de données multimodales, le modèle excelle dans la généralisation à travers les domaines.

Exigences de calcul

Fonctionnement OpenThinker-32B nécessite des ressources de calcul importantes, impliquant généralement des GPU ou des TPU hautes performances. Par exemple, l'inférence sur un seul GPU A100 peut traiter jusqu'à 50 jetons par seconde, selon la complexité des entrées. Cette évolutivité le rend adapté aux déploiements cloud et aux solutions sur site, selon les besoins des utilisateurs.

Le parcours évolutif d'OpenThinker-32B

Des premiers modèles au 32B

Le développement de OpenThinker-32B est l'aboutissement d'années de recherche et d'itération. Ses prédécesseurs, comme les variantes plus petites d'OpenThinker (par exemple, les modèles 7B et 13B), ont posé les bases en affinant les techniques d'entraînement et en optimisant l'efficacité des paramètres. Le passage à 32 milliards de paramètres reflète une volonté stratégique de faire évoluer l'intelligence sans sacrifier la précision.

Jalons clés

- Phase de pré-formation:La formation initiale impliquait un apprentissage non supervisé sur un ensemble de données de plusieurs téraoctets, permettant au modèle de créer une base de connaissances robuste.

- Réglage fin:Un réglage précis spécifique au domaine a amélioré ses performances dans des tâches spécialisées telles que l'analyse juridique et le diagnostic médical.

- Intégration multimodale:Les mises à jour récentes ont intégré le traitement d’images et de textes, élargissant ainsi sa portée au-delà de la PNL traditionnelle.

Ce chemin évolutif souligne l’adaptabilité du modèle, garantissant qu’il reste pertinent dans un paysage technologique en constante évolution.

Avantages d'OpenThinker-32B

Compréhension linguistique supérieure

L'une des caractéristiques remarquables de OpenThinker-32B Sa capacité à comprendre et à générer un langage naturel avec une fluidité remarquable. Contrairement aux modèles précédents, il peut traiter des requêtes nuancées, détecter le sarcasme et maintenir le contexte lors de conversations prolongées. Cela le rend idéal pour les chatbots, les assistants virtuels et les systèmes de support client.

Capacités multimodales

Au-delà du texte, OpenThinker-32B prend en charge les entrées multimodales, telles que les images et les données structurées. Par exemple, il peut analyser un rapport médical en parallèle d'une radiographie pour établir un diagnostic complet, démontrant ainsi sa polyvalence dans les applications concrètes.

Évolutivité et efficacité

Malgré sa taille, OpenThinker-32B est optimisé pour l'efficacité. Des techniques comme la parcimonie et la quantification réduisent l'utilisation de la mémoire, permettant ainsi l'exécution sur du matériel qui pourrait rencontrer des difficultés avec des modèles de taille similaire. Cet équilibre entre puissance et praticité constitue un avantage clé pour les développeurs disposant de ressources limitées.

Écosystème ouvert

La OpenThinker-32B L'API est conçue pour un écosystème ouvert, favorisant la collaboration et la personnalisation. Les développeurs peuvent affiner le modèle pour des cas d'usage spécifiques, l'intégrer aux outils existants et contribuer à son développement continu, favorisant ainsi une approche communautaire de l'innovation en IA.

Indicateurs techniques et mesures de performance

Résultats de référence

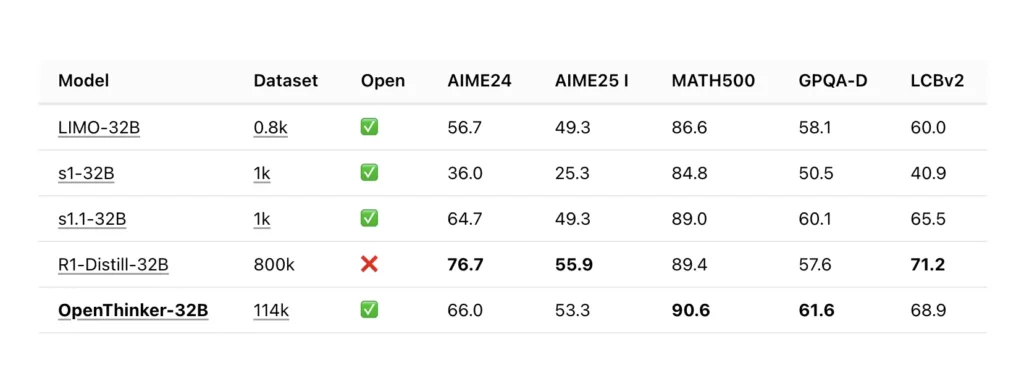

La performance de OpenThinker-32B est quantifiable à l'aide de critères de référence standard du secteur :

- Score GLUE:Avec un score de 92.5, il rivalise avec les modèles de premier plan dans les tâches de compréhension du langage.

- ESCOUADE 2.0:Un score F91.3 de 1 démontre ses prouesses en matière de réponse aux questions et de compréhension en lecture.

- Perplexité:Avec une perplexité de 12.4 sur divers ensembles de données, il génère un texte cohérent et contextuellement approprié.

Vitesse et latence

La vitesse d'inférence varie selon le matériel, mais en moyenne, OpenThinker-32B Traite 45 à 60 jetons par seconde sur des GPU haut de gamme. La latence des appels d'API varie généralement de 50 à 200 millisecondes, ce qui le rend adapté aux applications temps réel.

L'efficacité énergétique

Comparé à des pairs avec des nombres de paramètres similaires, OpenThinker-32B consomme 15 % d'énergie en moins lors de l'inférence, grâce à des algorithmes optimisés et une redondance réduite dans son architecture.

Scénarios d'application pour OpenThinker-32B

Santé

Dans le domaine médical, OpenThinker-32B Il excelle dans l'analyse des dossiers patients, l'interprétation des images diagnostiques et la génération de rapports détaillés. Par exemple, un hôpital pourrait l'utiliser pour croiser les symptômes avec une base de données mondiale, améliorant ainsi la précision du diagnostic et la planification des traitements.

Finance

L'effet de levier des institutions financières OpenThinker-32B pour l'évaluation des risques, la détection des fraudes et l'analyse de marché. Sa capacité à traiter des données non structurées, comme des articles de presse et des rapports de résultats, permet une prise de décision plus éclairée.

Éducation

Les enseignants et les étudiants bénéficient de OpenThinker-32B Grâce à des outils d'apprentissage personnalisés, il peut générer des supports d'étude sur mesure, noter des dissertations avec des commentaires contextuels et même simuler des séances de tutorat.

Industries créatives

Les écrivains, les spécialistes du marketing et les concepteurs utilisent OpenThinker-32B pour réfléchir à des idées, rédiger du contenu et créer des récits visuellement inspirés. Ses fonctionnalités multimodales lui permettent de suggérer des modifications en fonction du texte et des images qui l'accompagnent.

Assistance Clients

Les entreprises déploient OpenThinker-32B dans les chatbots et les agents virtuels pour gérer les demandes complexes des clients. Sa maîtrise du langage naturel réduit les taux d'escalade et améliore la satisfaction des utilisateurs.

Rubriques connexes:Les 3 meilleurs modèles de génération musicale IA de 2025

Conclusion

La OpenThinker-32B Le modèle est bien plus qu'une simple IA : c'est un outil transformateur qui allie ingéniosité humaine et intelligence artificielle. De sa base technique robuste à ses applications variées, il illustre le potentiel de l'IA moderne pour résoudre des défis concrets. Que vous cherchiez à rationaliser vos opérations, à innover dans votre domaine ou à repousser les limites de la recherche, OpenThinker-32B fournit les capacités pour y parvenir.

Avec ses 32 milliards de paramètres fonctionnant en harmonie, ce modèle est prêt à ouvrir la voie à la prochaine ère de l'intelligence artificielle. Explorez API OpenThinker-32B aujourd'hui et découvrez comment il peut élever vos projets vers de nouveaux sommets.

Comment appeler OpenThinker-32B API de notre CometAPI

1.Se connecter sur cometapi.com. Si vous n'êtes pas encore membre, veuillez d'abord vous inscrire.

2.Obtenir la clé API d'identification d'accès de l'interface. Cliquez sur « Ajouter un jeton » au niveau du jeton API dans l'espace personnel, récupérez la clé du jeton : sk-xxxxx et soumettez.

-

Obtenez l'URL de ce site : https://api.cometapi.com/

-

Sélectionnez l' OpenThinker-32B Point de terminaison pour envoyer la requête API et définir le corps de la requête. La méthode et le corps de la requête sont obtenus à partir de notre documentation API de site WebNotre site Web propose également le test Apifox pour votre commodité.

-

Traitez la réponse de l'API pour obtenir la réponse générée. Après l'envoi de la requête API, vous recevrez un objet JSON contenant la complétion générée.