Les 19–20 novembre 2025, OpenAI a publié deux mises à niveau connexes mais distinctes : GPT-5.1-Codex-Max, un nouveau modèle de programmation agentique pour Codex qui met l’accent sur le codage à long horizon, l’efficacité en tokens et la « compaction » pour maintenir des sessions multi‑fenêtres ; et GPT-5.1 Pro, un modèle ChatGPT de niveau Pro mis à jour, optimisé pour des réponses plus claires et plus capables dans des travaux professionnels complexes.

Qu’est-ce que GPT-5.1-Codex-Max et quel problème cherche-t-il à résoudre ?

GPT-5.1-Codex-Max est un modèle Codex spécialisé d’OpenAI, ajusté pour des workflows de code qui nécessitent un raisonnement et une exécution soutenus à long horizon. Là où des modèles ordinaires peuvent trébucher face à des contextes extrêmement longs — par exemple, des refactorisations multi‑fichiers, des boucles d’agents complexes ou des tâches CI/CD persistantes — Codex‑Max est conçu pour compacter automatiquement et gérer l’état de session à travers plusieurs fenêtres de contexte, ce qui lui permet de continuer à travailler de manière cohérente lorsqu’un projet s’étend sur des milliers (ou plus) de tokens. OpenAI positionne Codex‑Max comme l’étape suivante pour rendre les agents capables de coder réellement utiles dans des travaux d’ingénierie prolongés.

Qu’est-ce que GPT-5.1-Codex-Max et quel problème cherche-t-il à résoudre ?

GPT-5.1-Codex-Max est un modèle Codex spécialisé d’OpenAI, ajusté pour des workflows de code qui nécessitent un raisonnement et une exécution soutenus à long horizon. Là où des modèles ordinaires peuvent trébucher face à des contextes extrêmement longs — par exemple, des refactorisations multi‑fichiers, des boucles d’agents complexes ou des tâches CI/CD persistantes — Codex‑Max est conçu pour compacter automatiquement et gérer l’état de session à travers plusieurs fenêtres de contexte, ce qui lui permet de continuer à travailler de manière cohérente lorsqu’un projet s’étend sur des milliers (ou plus) de tokens.

OpenAI le décrit comme « plus rapide, plus intelligent et plus économe en tokens à chaque étape du cycle de développement », et il est explicitement destiné à remplacer GPT‑5.1‑Codex comme modèle par défaut dans les surfaces Codex.

Aperçu des fonctionnalités

- Compaction pour la continuité multi‑fenêtres : émonde et préserve le contexte critique pour travailler de manière cohérente sur des millions de tokens et pendant des heures. 0

- Efficacité en tokens améliorée par rapport à GPT‑5.1‑Codex : jusqu’à ~30 % de tokens de réflexion en moins pour un effort de raisonnement similaire sur certains benchmarks de code.

- Durabilité agentique à long horizon : observée en interne comme capable de soutenir des boucles d’agents sur plusieurs heures/jours (OpenAI a documenté des exécutions internes >24 heures).

- Intégrations plateforme : disponible dès aujourd’hui dans le CLI Codex, les extensions d’IDE, le cloud et les outils de revue de code ; accès API à venir.

- Prise en charge de l’environnement Windows : OpenAI note spécifiquement que Windows est pris en charge pour la première fois dans les workflows Codex, élargissant la portée auprès des développeurs.

Comment se compare-t-il aux produits concurrents (par ex., GitHub Copilot, autres IA de programmation) ?

GPT‑5.1‑Codex‑Max est présenté comme un collaborateur plus autonome et à long horizon, comparé aux outils de complétion à la demande. Alors que Copilot et des assistants similaires excellent pour des complétions à court terme dans l’éditeur, les forces de Codex‑Max résident dans l’orchestration de tâches multi‑étapes, le maintien d’un état cohérent entre les sessions et la gestion de workflows nécessitant planification, tests et itération. Cela dit, la meilleure approche pour la plupart des équipes restera hybride : utiliser Codex‑Max pour l’automatisation complexe et les tâches d’agents soutenues, et des assistants plus légers pour les complétions au niveau de la ligne.

Comment fonctionne GPT-5.1-Codex-Max ?

Qu’est-ce que la « compaction » et comment permet-elle un travail de longue durée ?

Un progrès technique central est la compaction — un mécanisme interne qui émonde l’historique de session tout en préservant les éléments saillants du contexte afin que le modèle puisse poursuivre un travail cohérent à travers plusieurs fenêtres de contexte. Concrètement, cela signifie que les sessions Codex approchant leur limite de contexte seront compactées (tokens plus anciens ou de moindre valeur résumés/préservés) de manière à offrir à l’agent une fenêtre fraîche pour continuer à itérer, et ce, jusqu’à la fin de la tâche. OpenAI signale des exécutions internes où le modèle a travaillé de manière continue pendant plus de 24 heures.

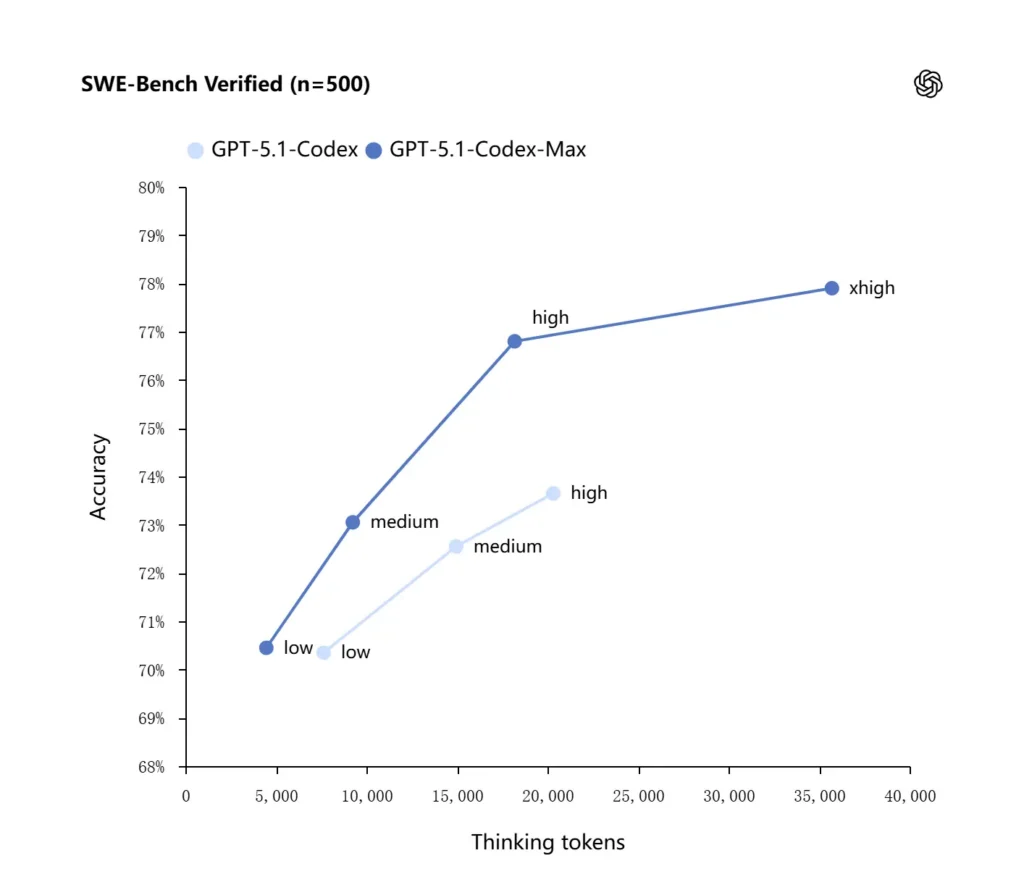

Raisonnement adaptatif et efficacité en tokens

GPT‑5.1‑Codex‑Max applique des stratégies de raisonnement améliorées qui le rendent plus économe en tokens : dans les benchmarks internes rapportés par OpenAI, le modèle Max atteint des performances similaires ou meilleures que GPT‑5.1‑Codex tout en utilisant significativement moins de tokens de « réflexion » — OpenAI cite environ 30 % de tokens de réflexion en moins sur SWE‑bench Verified à effort de raisonnement égal. Le modèle introduit également un mode d’effort de raisonnement « Extra High (xhigh) » pour les tâches non sensibles à la latence, lui permettant d’investir davantage de raisonnement interne pour délivrer des sorties de meilleure qualité.

Intégrations système et outillage agentique

Codex‑Max est distribué au sein des workflows Codex (CLI, extensions d’IDE, cloud et surfaces de revue de code) afin qu’il puisse interagir avec les chaînes d’outils des développeurs. Les premières intégrations incluent le CLI Codex et les agents IDE (VS Code, JetBrains, etc.), avec un accès API prévu ultérieurement. L’objectif de conception n’est pas seulement une synthèse de code plus intelligente, mais une IA capable d’exécuter des workflows multi‑étapes : ouvrir des fichiers, exécuter des tests, corriger des échecs, refactoriser et relancer.

Comment GPT-5.1-Codex-Max se comporte-t-il sur les benchmarks et en situation réelle ?

Raisonnement soutenu et tâches à long horizon

Les évaluations montrent des améliorations mesurables en raisonnement soutenu et sur des tâches à long horizon :

- Évaluations internes OpenAI : Codex‑Max peut travailler sur des tâches pendant « plus de 24 heures » dans des expériences internes, et l’intégration de Codex aux outils des développeurs a augmenté des métriques de productivité d’ingénierie internes (par ex., usage et débit de pull requests). Ce sont des affirmations internes d’OpenAI et elles indiquent des améliorations au niveau des tâches dans la productivité réelle.

- Évaluations indépendantes (METR) : le rapport indépendant de METR a mesuré l’horizon de temps observé à 50 % (une statistique représentant la durée médiane pendant laquelle le modèle peut soutenir de manière cohérente une tâche longue) pour GPT‑5.1‑Codex‑Max à environ 2 heures 40 minutes (avec un large intervalle de confiance), contre 2 heures 17 minutes pour GPT‑5 dans des mesures comparables — une amélioration significative et conforme à la tendance en matière de cohérence soutenue. La méthodologie et l’IC de METR mettent l’accent sur la variabilité, mais le résultat étaye le récit selon lequel Codex‑Max améliore la performance pratique à long horizon.

Benchmarks de code

OpenAI rapporte des résultats améliorés sur des évaluations de codage de pointe, notamment SWE‑bench Verified où GPT‑5.1‑Codex‑Max surpasse GPT‑5.1‑Codex avec une meilleure efficacité en tokens. L’entreprise souligne que, pour le même effort de raisonnement « medium », le modèle Max produit de meilleurs résultats tout en utilisant environ 30 % de tokens de réflexion en moins ; pour les utilisateurs qui autorisent un raisonnement interne plus long, le mode xhigh peut encore élever la qualité des réponses au prix de la latence.

| GPT‑5.1-Codex (high) | GPT‑5.1-Codex-Max (xhigh) | |

| SWE-bench Verified (n=500) | 73.7% | 77.9% |

| SWE-Lancer IC SWE | 66.3% | 79.9% |

| Terminal-Bench 2.0 | 52.8% | 58.1% |

Comment GPT-5.1-Codex-Max se compare-t-il à GPT-5.1-Codex ?

Différences de performances et d’objectif

- Portée : GPT‑5.1‑Codex était une variante de codage hautes performances de la famille GPT‑5.1 ; Codex‑Max est explicitement un successeur agentique à long horizon destiné à être la recommandation par défaut pour Codex et des environnements similaires à Codex.

- Efficacité en tokens : Codex‑Max présente des gains matériels d’efficacité en tokens (allégation d’environ 30 % de tokens de réflexion en moins d’OpenAI) sur SWE‑bench et en usage interne.

- Gestion du contexte : Codex‑Max introduit la compaction et la gestion native multi‑fenêtres pour soutenir des tâches qui dépassent une seule fenêtre de contexte ; Codex n’offrait pas cette capacité de manière native à la même échelle.

- Préparation outillage : Codex‑Max est livré comme modèle Codex par défaut sur le CLI, les IDE et les surfaces de revue de code, signalant une migration pour les workflows de développement en production.

Quand utiliser quel modèle ?

- Utilisez GPT‑5.1‑Codex pour l’assistance de codage interactive, les modifications rapides, les petites refactorisations et les cas à faible latence où l’ensemble du contexte pertinent tient aisément dans une seule fenêtre.

- Utilisez GPT‑5.1‑Codex‑Max pour des refactorisations multi‑fichiers, des tâches d’agents automatisés nécessitant de nombreux cycles d’itération, des workflows de type CI/CD, ou lorsque vous avez besoin que le modèle conserve une perspective au niveau du projet à travers de multiples interactions.

Modèles de consignes pratiques, et exemples pour de meilleurs résultats ?

Modèles de consignes efficaces

- Soyez explicite sur les objectifs et contraintes : « Refactoriser X, préserver l’API publique, conserver les noms de fonctions et s’assurer que les tests A, B, C passent. »

- Fournissez un contexte reproductible minimal : liez le test défaillant, incluez les traces de pile et des extraits de fichiers pertinents plutôt que de déverser des dépôts entiers. Codex‑Max compacterra l’historique si nécessaire.

- Utilisez des instructions par étapes pour les tâches complexes : décomposez les gros travaux en une séquence de sous‑tâches et laissez Codex‑Max itérer à travers elles (par ex., « 1) exécuter les tests 2) corriger les 3 principaux tests échoués 3) lancer le linter 4) résumer les changements »).

- Demandez des explications et des diffs : sollicitez à la fois le patch et une brève justification pour que les relecteurs humains puissent évaluer rapidement la sécurité et l’intention.

Exemples de modèles de consignes

Tâche de refactorisation

« Refactorer le module

payment/pour extraire le traitement des paiements danspayment/processor.py. Conserver stables les signatures des fonctions publiques pour les appelants existants. Créer des tests unitaires pourprocess_payment()couvrant le succès, l’échec réseau et la carte invalide. Exécuter la suite de tests et retourner les tests échoués ainsi qu’un patch au format diff unifié. »

Correction de bug + test

« Un test

tests/test_user_auth.py::test_token_refreshéchoue avec une trace. Investiguer la cause racine, proposer un correctif avec des changements minimaux et ajouter un test unitaire pour prévenir la régression. Appliquer le patch et exécuter les tests. »

Génération itérative de PR

« Implémenter la fonctionnalité X : ajouter l’endpoint

POST /api/exportqui diffuse les résultats d’export et est authentifié. Créer l’endpoint, ajouter la documentation, créer les tests et ouvrir une PR avec un résumé et une checklist des éléments manuels. »

Pour la plupart de ces cas, commencez avec un effort medium ; passez en xhigh lorsque vous avez besoin que le modèle raisonne en profondeur à travers de nombreux fichiers et plusieurs itérations de tests.

Comment accéder à GPT-5.1-Codex-Max

Où il est disponible aujourd’hui

OpenAI a intégré GPT‑5.1‑Codex‑Max dans les outils Codex aujourd’hui : le CLI Codex, les extensions d’IDE, le cloud et les flux de revue de code utilisent Codex‑Max par défaut (vous pouvez opter pour Codex‑Mini). La disponibilité de l’API est en préparation ; GitHub Copilot dispose de versions publiques préliminaires qui incluent des modèles GPT‑5.1 et série Codex.

Les développeurs peuvent accéder à GPT‑5.1‑Codex‑Max et à l’API GPT‑5.1‑Codex via CometAPI. Pour commencer, explorez les capacités des modèles de CometAPI dans le Playground et consultez le guide de l’API pour des instructions détaillées. Avant d’y accéder, veuillez vous assurer que vous êtes connecté à CometAPI et que vous avez obtenu la clé API. CometAPI propose un prix bien inférieur au prix officiel pour vous aider à intégrer.

Prêt à démarrer ? → Inscrivez-vous à CometAPI dès aujourd’hui !

Si vous voulez davantage d’astuces, de guides et d’actualités sur l’IA, suivez-nous sur VK, X et Discord !

Démarrage rapide (pas à pas pratique)

- Assurez-vous d’y avoir accès : confirmez que votre offre ChatGPT/Codex (Plus, Pro, Business, Edu, Enterprise) ou votre offre API développeur prend en charge les modèles de la famille GPT‑5.1/Codex.

- Installez le CLI Codex ou l’extension IDE : si vous voulez exécuter des tâches de code localement, installez le CLI Codex ou l’extension IDE Codex pour VS Code / JetBrains / Xcode selon le cas. L’outillage utilisera par défaut GPT‑5.1‑Codex‑Max dans les configurations prises en charge.

- Choisissez l’effort de raisonnement : commencez avec l’effort medium pour la plupart des tâches. Pour le débogage en profondeur, des refactorisations complexes, ou lorsque vous voulez que le modèle réfléchisse davantage et que la latence de réponse importe peu, passez en modes high ou xhigh. Pour de petites corrections rapides, low est raisonnable.

- Fournissez le contexte du dépôt : donnez au modèle un point de départ clair — une URL de dépôt ou un ensemble de fichiers et une instruction courte (par ex., « refactorer le module payment pour utiliser async I/O et ajouter des tests unitaires, conserver les contrats au niveau des fonctions »). Codex‑Max compacterra l’historique à l’approche des limites de contexte et poursuivra le travail.

- Itérez avec les tests : après que le modèle a produit des patches, exécutez les suites de tests et renvoyez les échecs dans le cadre de la session en cours. La compaction et la continuité multi‑fenêtres permettent à Codex‑Max de conserver l’important contexte des tests échoués et d’itérer.

Conclusion :

GPT‑5.1‑Codex‑Max représente un pas important vers des assistants de programmation agentiques capables de soutenir des tâches d’ingénierie complexes et de longue durée avec une efficacité et un raisonnement améliorés. Les avancées techniques (compaction, modes d’effort de raisonnement, entraînement en environnement Windows) le rendent particulièrement bien adapté aux organisations d’ingénierie modernes — à condition que les équipes associent le modèle à des contrôles opérationnels prudents, des politiques claires de supervision humaine et un monitoring robuste. Pour les équipes qui l’adoptent avec soin, Codex‑Max a le potentiel de transformer la manière dont les logiciels sont conçus, testés et maintenus — en convertissant les corvées d’ingénierie répétitives en une collaboration à plus forte valeur entre humains et modèles.