GPT-5.2 est la version ponctuelle de décembre 2025 de la famille GPT-5 d’OpenAI : une famille de modèles multimodaux phares (texte + vision + outils) optimisée pour le travail de connaissance professionnel, le raisonnement sur de longs contextes, l’utilisation agentique d’outils et l’ingénierie logicielle. OpenAI présente GPT-5.2 comme le modèle le plus capable de la série GPT-5 à ce jour et indique qu’il a été développé en mettant l’accent sur un raisonnement multi-étapes fiable, la gestion de très grands documents, et une sécurité/ conformité aux politiques améliorées ; la sortie comprend trois variantes destinées aux utilisateurs — Instant, Thinking et Pro — et est déployée d’abord auprès des abonnés payants de ChatGPT et des clients API.

Qu’est-ce que GPT-5.2 et pourquoi est-ce important ?

GPT-5.2 est le dernier membre de la famille GPT-5 — une nouvelle série de modèles « frontier » conçue spécifiquement pour combler l’écart entre les assistants conversationnels à tour unique et les systèmes qui doivent raisonner à travers de longs documents, appeler des outils, interpréter des images et exécuter de manière fiable des workflows multi-étapes. OpenAI positionne 5.2 comme sa version la plus capable à ce jour pour le travail de connaissance professionnel : il établit de nouveaux résultats à l’état de l’art sur des benchmarks internes (notamment un nouveau benchmark GDPval pour le travail de connaissance), montre de meilleures performances en codage sur des benchmarks d’ingénierie logicielle, et offre des capacités de long contexte et de vision nettement améliorées.

Concrètement, GPT-5.2 est plus qu’un simple « modèle de chat plus grand ». C’est une famille de trois variantes ajustées (Instant, Thinking, Pro) qui arbitrent la latence, la profondeur de raisonnement et le coût — et qui, associées à l’API d’OpenAI et au routage de ChatGPT, peuvent être utilisées pour lancer de longues tâches de recherche, construire des agents qui appellent des outils externes, interpréter des images et des graphiques complexes, et générer du code de niveau production avec une fidélité supérieure aux versions précédentes. Le modèle prend en charge de très grandes fenêtres de contexte (la documentation d’OpenAI mentionne une fenêtre de contexte de 400,000 tokens et une limite de sortie maximale de 128,000 pour les modèles phares), de nouvelles fonctionnalités d’API pour des niveaux d’effort de raisonnement explicites, et un comportement d’invocation d’outils « agentique ».

5 capacités clés améliorées dans GPT-5.2

1) GPT-5.2 est-il meilleur en logique multi-étapes et en mathématiques ?

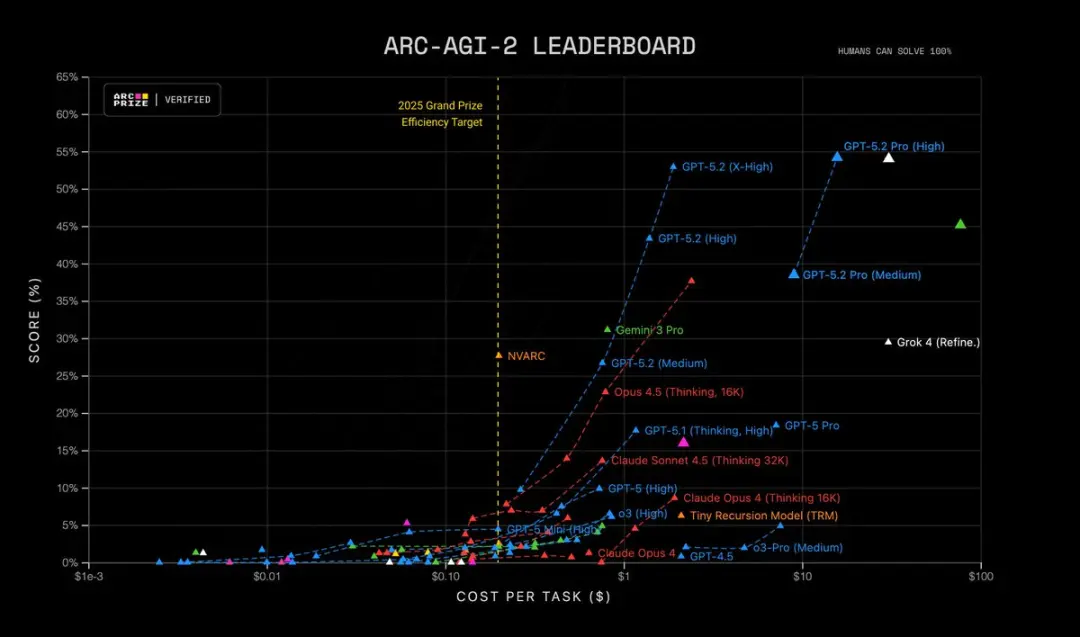

GPT-5.2 apporte un raisonnement multi-étapes plus affûté et des performances nettement plus fortes en mathématiques et en résolution structurée de problèmes. OpenAI indique avoir ajouté un contrôle plus granulaire de l’effort de raisonnement (de nouveaux niveaux comme xhigh), mis au point la prise en charge de « reasoning tokens », et ajusté le modèle pour maintenir la chaîne de pensée sur des traces de raisonnement internes plus longues. Des benchmarks comme FrontierMath et des tests de type ARC-AGI montrent des gains substantiels par rapport à GPT-5.1 ; des marges plus importantes sur des benchmarks spécifiques aux domaines utilisés dans des workflows scientifiques et financiers. En bref : GPT-5.2 « réfléchit plus longtemps » lorsqu’on le lui demande, et peut réaliser un travail symbolique/mathématique plus compliqué avec une meilleure cohérence.

| RC-AGI-1 (Vérifié) Raisonnement abstrait | 86.2% | 72.8% |

|---|---|---|

| ARC-AGI-2 (Vérifié) Raisonnement abstrait | 52.9% | 17.6% |

GPT-5.2 Thinking établit des records dans plusieurs tests avancés de science et de raisonnement mathématique :

- GPQA Diamond Science Quiz : 92.4% (version Pro 93.2%)

- ARC-AGI-1 Raisonnement abstrait : 86.2% (premier modèle à dépasser le seuil de 90%)

- ARC-AGI-2 Raisonnement d’ordre supérieur : 52.9%, établissant un nouveau record pour le modèle Thinking Chain

- FrontierMath Test de mathématiques avancées : 40.3%, dépassant largement son prédécesseur ;

- HMMT Problèmes de concours de mathématiques : 99.4%

- AIME Test de mathématiques : 100% solution complète

En outre, GPT-5.2 Pro (High) est à l’état de l’art sur ARC-AGI-2, atteignant un score de 54.2% pour un coût de $15.72 par tâche ! Surclassant tous les autres modèles.

Pourquoi c’est important : de nombreuses tâches du monde réel — modélisation financière, conception d’expériences, synthèse de programmes nécessitant un raisonnement formel — sont limitées par la capacité d’un modèle à enchaîner de nombreuses étapes correctes. GPT-5.2 réduit les « étapes hallucinéess » et produit des traces de raisonnement intermédiaires plus stables lorsque vous lui demandez de montrer son travail.

2) Comment la compréhension de longs textes et le raisonnement inter-documents se sont-ils améliorés ?

La compréhension de longs contextes est l’une des améliorations phares. Le modèle sous-jacent de GPT-5.2 prend en charge une fenêtre de contexte de 400k tokens et — surtout — maintient une précision plus élevée à mesure que le contenu pertinent se déplace en profondeur dans ce contexte. GDPval, une suite de tâches pour le « travail de connaissance bien spécifié » couvrant 44 métiers, où GPT-5.2 Thinking atteint la parité ou mieux que des juges humains experts sur une large part des tâches. Des rapports indépendants confirment que le modèle retient et synthétise l’information à travers de nombreux documents bien mieux que les modèles précédents. C’est un progrès réellement pratique pour des tâches comme la due diligence, la synthèse juridique, les revues de littérature, et la compréhension de bases de code.

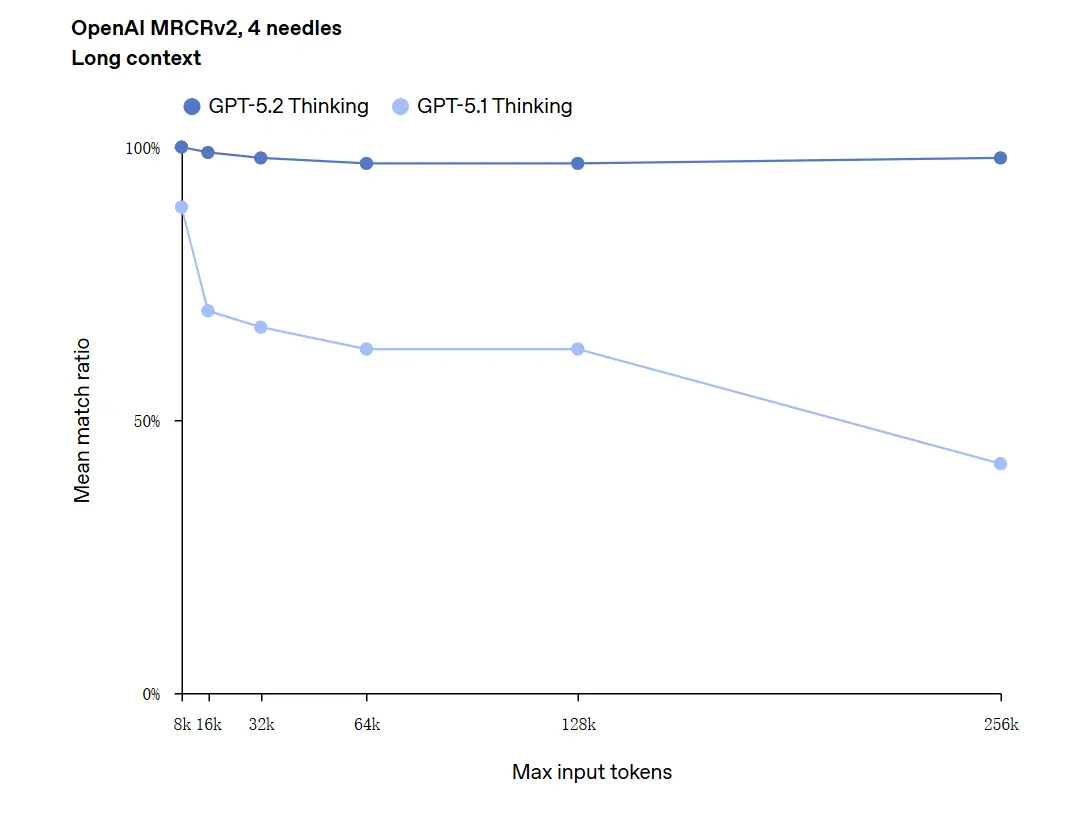

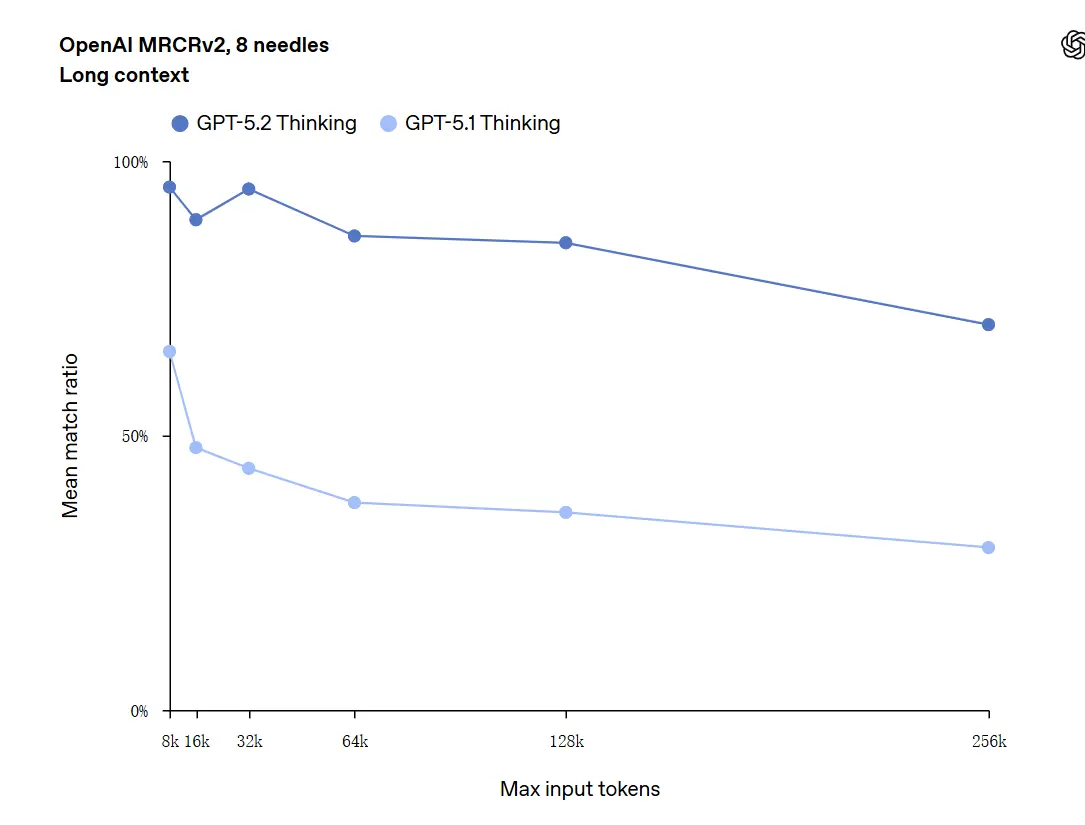

GPT-5.2 peut gérer des contextes jusqu’à 256,000 tokens (soit environ 200+ pages de documents). En outre, dans le test de compréhension de long texte « OpenAI MRCRv2 », GPT-5.2 Thinking a atteint un taux de précision proche de 100%.

Mise en garde sur « 100% de précision » : les améliorations sont décrites comme « s’approchant de 100% » pour des micro-tâches étroites ; les données d’OpenAI sont mieux décrites comme « à l’état de l’art et dans de nombreux cas au niveau ou au-dessus des experts humains sur les tâches évaluées », pas littéralement infaillibles pour tous les usages. Les benchmarks montrent de grands gains mais pas une perfection universelle.

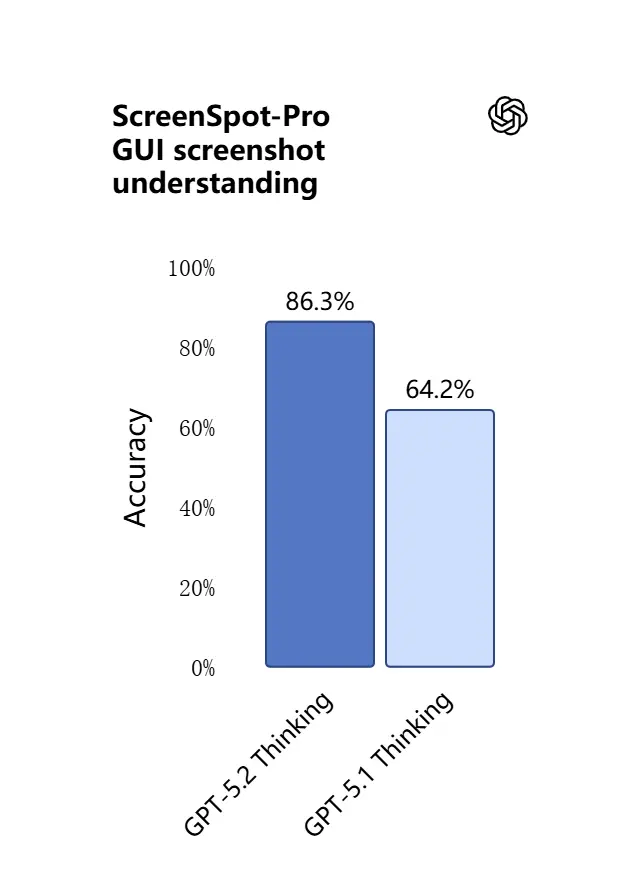

3) Quoi de neuf en compréhension visuelle et en raisonnement multimodal ?

Les capacités de vision de GPT-5.2 sont plus affûtées et plus pratiques. Le modèle est meilleur pour interpréter des captures d’écran, lire des graphiques et des tableaux, reconnaître des éléments d’interface, et combiner des entrées visuelles avec un long contexte textuel. Ce n’est pas qu’une légende : GPT-5.2 peut extraire des données structurées à partir d’images (par ex., des tableaux dans un PDF), expliquer des graphiques, et raisonner sur des diagrammes d’une manière qui prend en charge des actions outillées en aval (par ex., générer une feuille de calcul à partir d’un rapport photographié).

.webp)

Effet pratique : les équipes peuvent fournir directement au modèle des jeux de diapositives complets, des rapports de recherche scannés ou des documents riches en images et demander des synthèses inter-documents — réduisant fortement le travail d’extraction manuelle.

4) Comment l’invocation d’outils et l’exécution de tâches ont-elles évolué ?

GPT-5.2 pousse plus loin le comportement agentique : il est meilleur pour planifier des tâches multi-étapes, décider quand appeler des outils externes, et exécuter des séquences d’appels API/outils pour mener un travail de bout en bout. Des améliorations d’« agentic tool-calling » — le modèle proposera un plan, appellera des outils (bases de données, calcul, systèmes de fichiers, navigateur, exécuteurs de code), et synthétisera les résultats dans un livrable final plus fiablement que les modèles précédents. L’API introduit du routage et des contrôles de sécurité (listes d’outils autorisés, échafaudage d’outils) et l’interface ChatGPT peut router automatiquement les requêtes vers la variante 5.2 appropriée (Instant vs Thinking).

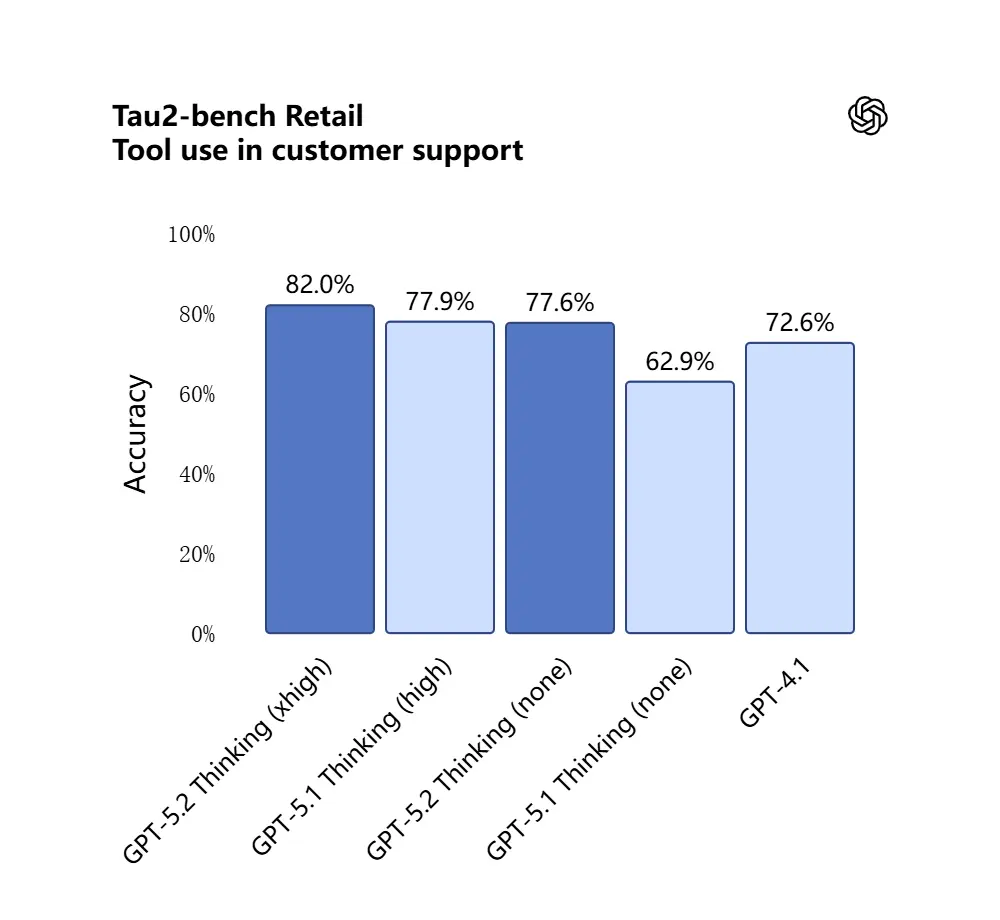

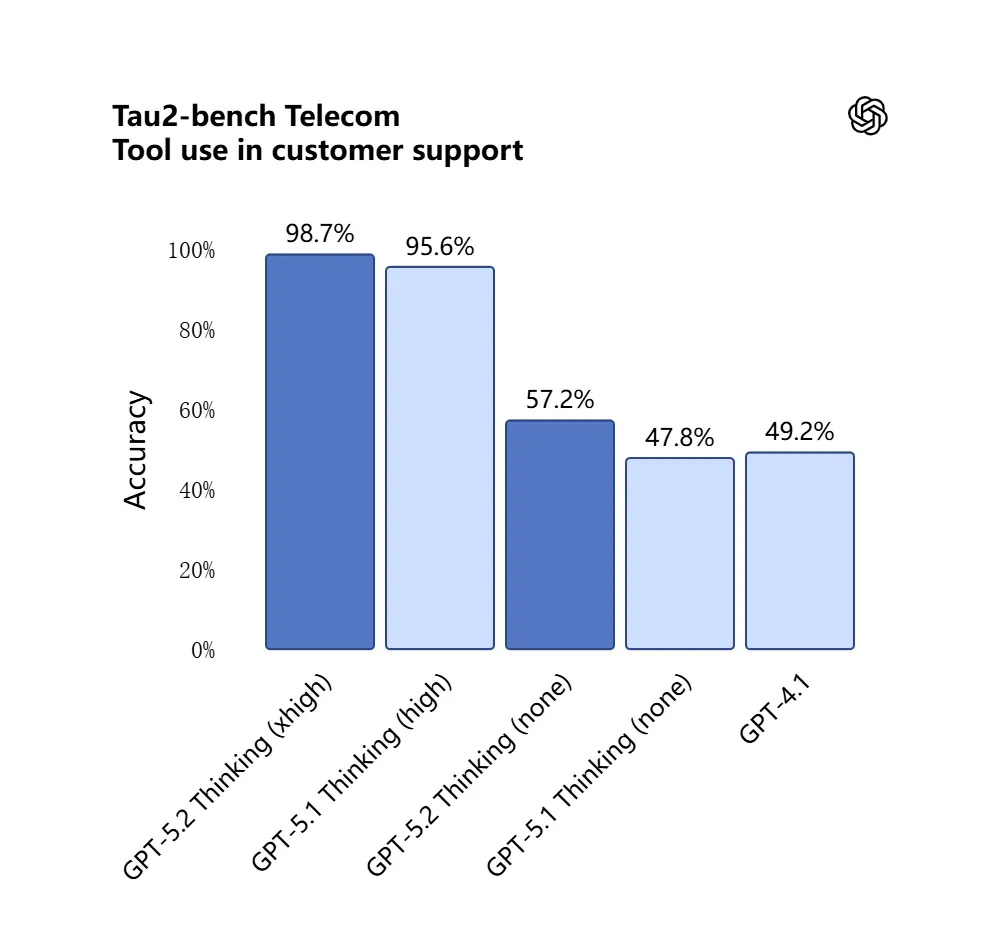

GPT-5.2 a obtenu 98.7% dans le benchmark Tau2-Bench Telecom, démontrant des capacités de recours aux outils matures sur des tâches complexes multi-tours.

Pourquoi c’est important : cela rend GPT-5.2 plus utile comme assistant autonome pour des workflows du type « ingérer ces contrats, extraire des clauses, mettre à jour une feuille de calcul, et écrire un e-mail de synthèse » — des tâches qui nécessitaient auparavant une orchestration minutieuse.

5) Les capacités de programmation ont évolué

GPT-5.2 est sensiblement meilleur sur les tâches d’ingénierie logicielle : il écrit des modules plus complets, génère et exécute des tests plus fiablements, comprend des graphes de dépendances de projets complexes, et est moins sujet au « code paresseux » (sauter le boilerplate ou omettre de relier des modules). Sur des benchmarks de codage de niveau industriel (SWE-bench Pro, etc.), GPT-5.2 établit de nouveaux records. Pour les équipes qui utilisent des LLM comme coéquipiers de programmation, cette amélioration peut réduire la vérification manuelle et les retouches nécessaires après génération.

Dans le test SWE-Bench Pro (tâche d’ingénierie logicielle industrielle en conditions réelles), le score de GPT-5.2 Thinking est monté à 55.6%, tout en atteignant un nouveau sommet de 80% dans le test SWE-Bench Verified.

_Software%20engineering.webp)

Dans les applications pratiques, cela signifie :

- Le débogage automatique du code en production conduit à une plus grande stabilité ;

- Prise en charge de la programmation multi-langages (pas limitée à Python) ;

- Capacité à mener de manière autonome des tâches de correction de bout en bout.

Quelles sont les différences entre GPT-5.2 et GPT-5.1 ?

Réponse courte : GPT-5.2 est une amélioration itérative mais substantielle. Il conserve l’architecture de la famille GPT-5 et ses fondations multimodales, mais progresse sur quatre dimensions pratiques :

- Profondeur et cohérence du raisonnement. 5.2 introduit des niveaux d’effort de raisonnement plus élevés et un meilleur chaînage pour les problèmes multi-étapes ; 5.1 avait déjà amélioré le raisonnement, mais 5.2 relève le plafond pour les maths complexes et la logique multi-phase.

- Fiabilité sur de longs contextes. Les deux versions ont étendu le contexte, mais 5.2 est ajusté pour maintenir la précision profondément dans des entrées très longues (OpenAI affirme une meilleure rétention jusqu’à des centaines de milliers de tokens).

- Fidélité vision + multimodale. 5.2 améliore le croisement entre images et texte — par ex., lire un graphique et intégrer ces données dans une feuille de calcul — montrant une précision plus élevée au niveau des tâches.

- Comportement agentique avec outils et fonctionnalités API. 5.2 expose de nouveaux paramètres d’effort de raisonnement (

xhigh) et des fonctions de compactage du contexte dans l’API, et OpenAI a affiné la logique de routage dans ChatGPT afin que l’interface choisisse automatiquement la meilleure variante. - Moins d’erreurs, plus de stabilité : GPT-5.2 réduit son « taux d’illusion » (taux de réponses erronées) de 38%. Il répond plus fiablement aux questions de recherche, d’écriture et d’analyse, réduisant les cas de « faits fabriqués ». Dans des tâches complexes, sa sortie structurée est plus claire et sa logique plus stable. Parallèlement, la sécurité de ses réponses est significativement améliorée dans les tâches liées à la santé mentale. Il se montre plus robuste dans des scénarios sensibles tels que la santé mentale, l’automutilation, le suicide et la dépendance émotionnelle.

Dans les évaluations système, GPT-5.2 Instant a obtenu 0.995 (sur 1.0) sur la tâche « Mental Health Support », bien supérieur à GPT-5.1 (0.883).

Quantitativement, les benchmarks publiés par OpenAI montrent des gains mesurables sur GDPval, les benchmarks de mathématiques (FrontierMath), et les évaluations d’ingénierie logicielle. GPT-5.2 dépasse GPT-5.1 sur des tâches de feuilles de calcul de niveau analyste en banque d’investissement junior de plusieurs points de pourcentage.

GPT-5.2 est-il gratuit — combien cela coûte-t-il ?

Puis-je utiliser GPT-5.2 gratuitement ?

OpenAI a lancé GPT-5.2 en commençant par les offres ChatGPT payantes et l’accès API. Historiquement, OpenAI a conservé les modèles les plus rapides / les plus profonds derrière des niveaux payants tout en rendant plus largement disponibles ultérieurement des variantes plus légères ; avec 5.2, l’entreprise a indiqué que le déploiement commencerait sur les plans payants (Plus, Pro, Business, Enterprise) et que l’API est accessible aux développeurs. Cela signifie que l’accès gratuit immédiat est limité : le niveau gratuit peut recevoir plus tard un accès dégradé ou routé (par exemple vers des sous-variantes plus légères) au fur et à mesure de la montée en charge.

La bonne nouvelle, c’est que CometAPI est désormais intégré à GPT-5.2, et qu’il est actuellement en promotion de Noël. Vous pouvez désormais utiliser GPT-5.2 via CometAPI ; le playground vous permet d’interagir librement avec GPT-5.2, et les développeurs peuvent utiliser l’API GPT-5.2 (CometAPI est tarifé à 20% du prix d’OpenAI) pour construire des workflows.

Combien cela coûte-t-il via l’API (usage développeur / production) ?

L’utilisation de l’API est facturée au token. Les tarifs de plateforme publiés par OpenAI au lancement indiquent (CometAPI est tarifé à 20% du prix d’OpenAI) :

- GPT-5.2 (standard chat) — $1.75 par 1M de tokens d’entrée et $14 par 1M de tokens de sortie (des réductions s’appliquent pour les entrées mises en cache).

- GPT-5.2 Pro (flagship) — $21 par 1M de tokens d’entrée et $168 par 1M de tokens de sortie (nettement plus cher car destiné à des charges de travail à haute précision et forte intensité de calcul).

- À titre de comparaison, GPT-5.1 était moins cher (par ex., $1.25 entrée / $10 sortie par 1M de tokens).

Interprétation : les coûts de l’API ont augmenté par rapport aux générations précédentes ; le prix indique que la performance premium de 5.2 en raisonnement et long contexte est tarifée comme un palier produit distinct. Pour les systèmes de production, les coûts dépendent fortement du nombre de tokens en entrée/sortie et de la fréquence de réutilisation des entrées mises en cache (les entrées mises en cache bénéficient de fortes remises).

Ce que cela signifie en pratique

- Pour un usage occasionnel via l’interface ChatGPT, les abonnements mensuels (Plus, Pro, Business, Enterprise) sont la voie principale. Les tarifs des abonnements ChatGPT n’ont pas changé avec la sortie 5.2 (OpenAI maintient les prix des plans même si l’offre de modèles évolue).

- Pour un usage développeur & production, budgétez les coûts par token. Si votre application diffuse beaucoup de longues réponses ou traite de longs documents, le prix des tokens de sortie ($14 / 1M de tokens pour Thinking) dominera les coûts à moins de mettre soigneusement en cache les entrées et de réutiliser les sorties.

GPT-5.2 Instant vs GPT-5.2 Thinking vs GPT-5.2 Pro

OpenAI a lancé GPT-5.2 avec trois variantes orientées usage pour correspondre aux cas d’emploi : Instant, Thinking et Pro :

- GPT-5.2 Instant : rapide, économique, ajusté pour le travail quotidien — FAQ, modes d’emploi, traductions, rédaction rapide. Faible latence ; bonnes premières ébauches et workflows simples.

- GPT-5.2 Thinking : réponses plus approfondies et de meilleure qualité pour un travail soutenu — synthèse de longs documents, planification multi-étapes, revues de code détaillées. Latence et qualité équilibrées ; le « cheval de bataille » par défaut pour les tâches professionnelles.

- GPT-5.2 Pro : qualité et fiabilité maximales. Plus lent et plus coûteux ; idéal pour des tâches difficiles à forts enjeux (ingénierie complexe, synthèse juridique, décisions à forte valeur) et lorsque qu’un effort de raisonnement « xhigh » est requis.

Tableau de comparaison

| Fonctionnalité / Mesure | GPT-5.2 Instant | GPT-5.2 Thinking | GPT-5.2 Pro |

|---|---|---|---|

| Usage prévu | Tâches quotidiennes, brouillons rapides | Analyse approfondie, longs documents | Qualité maximale, problèmes complexes |

| Latence | La plus faible | Modérée | La plus élevée |

| Effort de raisonnement | Standard | Élevé | xHigh disponible |

| Idéal pour | FAQ, tutoriels, traductions, prompts courts | Synthèses, planification, feuilles de calcul, tâches de codage | Ingénierie complexe, synthèse juridique, recherche |

| Exemples de noms d’API | gpt-5.2-chat-latest | gpt-5.2 | gpt-5.2-pro |

| Prix par jeton d’entrée (API) | $1.75 / 1M | $1.75 / 1M | $21 / 1M |

| Prix par jeton de sortie (API) | $14 / 1M | $14 / 1M | $168 / 1M |

| Disponibilité (ChatGPT) | Déploiement progressif ; plans payants puis plus large | Déploiement auprès des plans payants | Utilisateurs Pro / Enterprise (payant) |

| Exemple de cas d’usage typique | Rédaction d’e-mail, petits extraits de code | Construire un modèle financier multi-feuilles, Q&A sur un long rapport | Auditer une base de code, générer une conception système de qualité production |

Pour qui GPT-5.2 est-il adapté ?

GPT-5.2 est conçu pour un large éventail d’utilisateurs cibles. Ci-dessous, des recommandations par rôle :

Entreprises & équipes produit

Si vous construisez des produits de travail de connaissance (assistants de recherche, revue de contrats, pipelines analytiques ou outils pour développeurs), les capacités de long contexte et agentiques de GPT-5.2 peuvent réduire significativement la complexité d’intégration. Les entreprises qui ont besoin d’une compréhension robuste des documents, de rapports automatisés ou de copilotes intelligents trouveront Thinking/Pro utiles. Microsoft et d’autres partenaires de plateforme intègrent déjà 5.2 dans des suites de productivité (par ex., Microsoft 365 Copilot).

Développeurs et équipes d’ingénierie

Les équipes qui souhaitent utiliser des LLM comme co-programmeurs ou pour automatiser la génération/test de code bénéficieront de la meilleure fidélité de programmation dans 5.2. L’accès API (avec les modes thinking ou pro) permet des synthèses plus profondes de grandes bases de code grâce à la fenêtre de contexte de 400k tokens. Attendez-vous à payer plus via l’API en utilisant Pro, mais la réduction du débogage et de la relecture manuels peut justifier ce coût pour des systèmes complexes.

Chercheurs et analystes data

Si vous synthétisez régulièrement de la littérature, parsez de longs rapports techniques, ou souhaitez une aide à la conception d’expériences, le long contexte et les améliorations en mathématiques de GPT-5.2 accélèrent les workflows. Pour une recherche reproductible, couplez le modèle avec un prompt engineering soigneux et des étapes de vérification.

Petites entreprises et power users

ChatGPT Plus (et Pro pour les utilisateurs avancés) recevra un routage vers des variantes 5.2 ; cela rend l’automatisation avancée et des sorties de grande qualité accessibles à de plus petites équipes sans construire d’intégration API. Pour les non-techniciens ayant besoin de meilleures synthèses de documents ou de création de diapositives, GPT-5.2 apporte une valeur pratique notable.

Notes pratiques pour les développeurs et les opérateurs

Fonctionnalités API à surveiller

- Niveaux de

reasoning.effort(par ex.,medium,high,xhigh) permettant d’indiquer au modèle la quantité de calcul à consacrer au raisonnement interne ; utilisez-les pour échanger latence et précision requêtes par requête. - Context compaction : l’API inclut des outils pour compresser et compacter l’historique afin de préserver le contenu réellement pertinent sur de longues chaînes. C’est critique pour garder une utilisation des tokens gérable.

- Tool scaffolding & allowed-tools controls : en production, il faut explicitement lister les outils autorisés et journaliser les appels d’outils pour audit.

Conseils de contrôle des coûts

- Mettez en cache les embeddings de documents fréquemment utilisés et exploitez les entrées mises en cache (qui reçoivent de fortes remises) pour des requêtes répétées sur le même corpus. La tarification de la plateforme d’OpenAI inclut des remises significatives pour les entrées mises en cache.

- Routez les requêtes exploratoires / à faible valeur vers Instant et réservez Thinking/Pro pour les traitements batch ou les passes finales.

- Estimez soigneusement l’usage de tokens (entrée + sortie) lors de la projection des coûts API, car les longues sorties multiplient le coût.

En résumé — faut-il passer à GPT-5.2 ?

Si votre travail dépend du raisonnement sur de longs documents, de la synthèse inter-documents, de l’interprétation multimodale (images + texte), ou de la construction d’agents qui appellent des outils, GPT-5.2 est une mise à niveau évidente : il améliore la précision pratique et réduit le travail d’intégration manuel. Si vous exécutez principalement des chatbots à grand volume et faible latence ou des applications strictement contraintes par le budget, Instant (ou des modèles antérieurs) peut rester un choix raisonnable.

GPT-5.2 représente un passage délibéré de « meilleur chat » à « meilleur assistant professionnel » : plus de calcul, plus de capacités, et des paliers de coût plus élevés — mais aussi de réels gains de productivité pour les équipes qui peuvent exploiter un long contexte fiable, un meilleur raisonnement/mathématiques, la compréhension d’images, et l’exécution agentique d’outils.

Pour commencer, explorez les modèles GPT-5.2 (GPT-5.2;GPT-5.2 pro, GPT-5.2 chat ) dans le Playground et consultez le guide de l’API pour des instructions détaillées. Avant d’y accéder, veuillez vous assurer que vous êtes connecté à CometAPI et avez obtenu la clé API. CometAPI propose un prix bien inférieur au tarif officiel pour vous aider à intégrer.

Prêt à démarrer ? → Essai gratuit des modèles gpt-5.2 !