Kimi K2 représente une avancée significative dans les modèles de langage open source à grande échelle, combinant une architecture de pointe basée sur un mélange d'experts et une formation spécialisée pour les tâches agentiques. Nous explorons ci-dessous ses origines, sa conception, ses performances et les considérations pratiques relatives à son accès et à son utilisation.

Qu'est-ce que Kimi K2 ?

Kimi K2 est un modèle de langage expert (MoE) à mille milliards de paramètres développé par Moonshot AI. Il comprend 32 milliards de paramètres « activés » (ceux utilisés par jeton) et un nombre total de mille milliards de paramètres experts, offrant une capacité considérable sans coûts d'inférence linéaire. Basé sur l'optimiseur Muon, Kimi K1 a été entraîné sur plus de 2 milliards de jetons, atteignant une stabilité à des échelles auparavant considérées comme peu pratiques. Le modèle est proposé en deux variantes principales :

Kimi‑K2‑Instruct : Pré-réglé pour les applications conversationnelles et agentiques, prêt pour un déploiement immédiat dans les systèmes de dialogue et les flux de travail basés sur des outils.

Kimi‑K2‑Base : Un modèle de base adapté à la recherche, au réglage personnalisé et à l’expérimentation de bas niveau.

Comment fonctionne son architecture ?

- Mélange d'experts (MoE) : À chaque couche, un mécanisme de filtrage sélectionne un petit sous-ensemble d'experts (8 sur 384) pour traiter chaque jeton, réduisant considérablement le calcul pour l'inférence tout en conservant une base de connaissances massive.

- Couches spécialisées : Incorpore une seule couche dense aux côtés de 61 couches au total, avec des têtes d'attention numérotées 64 et des dimensions cachées adaptées à l'efficacité du MoE.

- Contexte et vocabulaire : Prend en charge jusqu'à 128 160 jetons en longueur de contexte et un vocabulaire de XNUMX XNUMX jetons, permettant une compréhension et une génération de forme longue.

Pourquoi Kimi K2 est-il important ?

Kimi K2 repousse les limites de l'IA open source en offrant des performances comparables aux principaux modèles propriétaires, notamment dans les benchmarks de codage et de raisonnement.

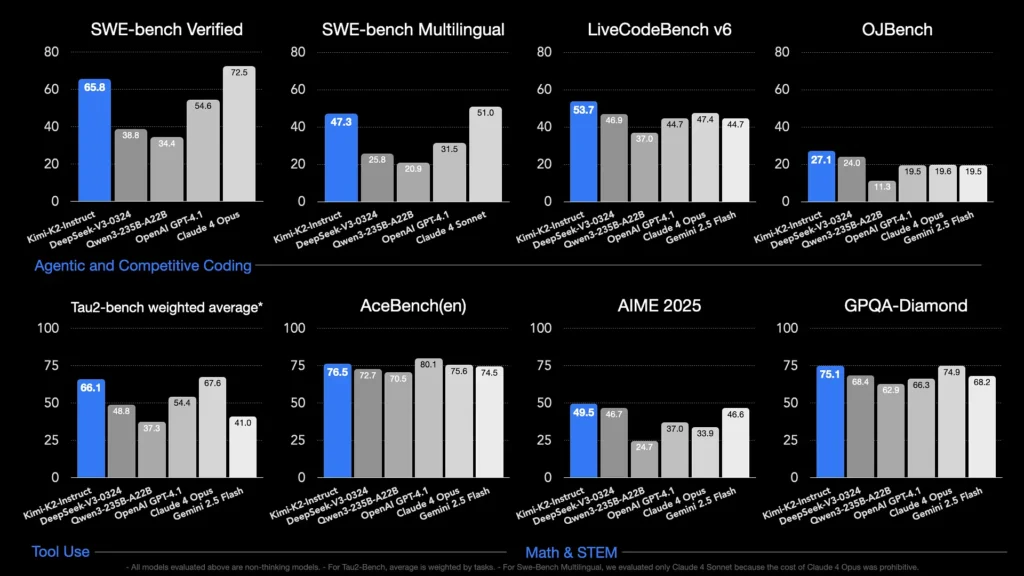

Quels benchmarks mettent en valeur ses capacités ?

- LiveCodeBench v6 : Atteint un taux de réussite de 1 %, devançant les modèles open source et rivalisant avec les systèmes fermés comme GPT-53.7 (4.1 %).

- SWE-bench Vérifié : Il obtient un score de 65.8 %, surpassant les 4.1 % de GPT-54.6 et se classant deuxième après Claude Sonnet 4 dans les tests de comparaison accessibles au public.

- MultiPL‑E et OJBench : Démontre une solide capacité de codage multilingue (85.7 % sur MultiPL-E) et des performances fiables face aux défis de programmation du monde réel.

- Mathématiques-500:Atteint 97.4 %, surpassant les 4.1 % de GPT-92.4, démontrant ses prouesses en matière de raisonnement mathématique formel.

Comment est-il optimisé pour les tâches agentiques ?

Au-delà de la génération brute, Kimi K2 a été entraîné avec des scénarios d'utilisation d'outils synthétiques (données MCP) pour appeler des outils externes, raisonner selon des processus en plusieurs étapes et résoudre des problèmes de manière autonome. Cela le rend particulièrement performant dans des environnements comme Cline, où il peut orchestrer l'exécution de code, l'interaction avec les API et l'automatisation des workflows de manière fluide.

Comment puis-je accéder à Kimi K2 ?

Les options d’accès couvrent les plateformes officielles, les distributions open source et les intégrations tierces, répondant aux besoins de la recherche, du développement et de l’entreprise.

Plateforme officielle Moonshot AI

Moonshot AI propose une inférence hébergée via sa plateforme, offrant un accès API à faible latence aux variantes Kimi-K2-Base et Kimi-K2-Instruct. La tarification est échelonnée en fonction de la consommation de calcul, avec des offres Entreprise incluant un support prioritaire et des déploiements sur site. Les utilisateurs peuvent s'inscrire sur le site web de Moonshot AI et récupérer leurs clés API pour une intégration immédiate.

API Comet

CometAPI a déjà intégré K2 à ses offres. Elle associe l'inférence K2 à une infrastructure GPU gérée, des garanties SLA et des niveaux de tarification évolutifs, permettant aux entreprises de choisir entre une utilisation des API à l'utilisation ou une capacité réservée avec des remises sur volume.

CometAPI est une plateforme d'API unifiée qui regroupe plus de 500 modèles d'IA provenant de fournisseurs leaders, tels que la série GPT d'OpenAI, Gemini de Google, Claude d'Anthropic, Midjourney, Suno, etc., au sein d'une interface unique et conviviale pour les développeurs. En offrant une authentification, un formatage des requêtes et une gestion des réponses cohérents, CometAPI simplifie considérablement l'intégration des fonctionnalités d'IA dans vos applications.

Les développeurs peuvent accéder API Kimi K2(kimi-k2-0711-preview)à travers API CometPour commencer, explorez les capacités du modèle dans le cour de récréation et consultez le Guide de l'APIPour des instructions détaillées, veuillez vous connecter à CometAPI et obtenir la clé API avant d'y accéder.

Intégrations d'outils tiers

- Cline : Un IDE populaire centré sur le code qui prend en charge nativement Kimi K2 via le

cline:moonshotai/kimi-k2fournisseur, offrant aux développeurs un accès en un clic au chat, à la génération de code et aux flux de travail agentiques au sein de leur éditeur. - Espaces de visage enlacés : Des démos hébergées par la communauté et des interfaces utilisateur minimalistes permettent aux utilisateurs d'interagir avec les modèles K2-Instruct directement dans le navigateur. Un compte Hugging Face est requis et les performances peuvent varier en fonction des ressources back-end partagées.

Comment utiliser Kimi K2 ?

Une fois que vous avez choisi une méthode d'accès, vous pouvez utiliser K2 pour une variété de tâches, du chat à l'exécution de code en passant par les agents autonomes.

Via API ou SDK de la plateforme

- Authentifier: Récupérez votre clé API depuis Moonshot AI ou CometAPI.

- Initialiser le client : Utilisez le SDK officiel (Python/JavaScript) ou les requêtes HTTP standard.

- Choisissez la variante du modèle :

- Kimi-K2-Base pour la mise au point et la recherche.

- Kimi‑K2‑Instruct pour le chat et les agents plug-and-play.

- Modèle de CometAPI :

kimi-k2-0711-preview

- Envoyer des invites : Formatez les entrées selon le modèle de discussion (rôles système, utilisateur, assistant) pour tirer parti d'un comportement optimisé de suivi des instructions.

Exécution locale avec llama.cpp

Pour les configurations hors ligne ou auto-hébergées, utilisez les pondérations GGUF quantifiées Unsloth (245 Go pour la quantification dynamique 1.8 bits).

- Télécharger Poids : Depuis le référentiel GitHub ou Hugging Face de Moonshot AI.

- Installer llama.cpp : Assurez-vous de disposer d'un disque suffisant (≥ 250 Go) et d'une RAM+VRAM combinée (≥ 250 Go) pour un débit d'environ 5 jetons/s.

- Modèle de lancement :

./main --model kimi-k2-gguf.q8_0 --prompt "Your prompt here" - Ajustez les paramètres : Utiliser les paramètres recommandés (

rope_freq_base,context_len) documenté dans le guide Unsloth pour des performances stables.

Intégrations avec des outils de développement

- Plugins IDE : Plusieurs plugins communautaires activent K2 dans les IDE VS Code, Neovim et JetBrains. La configuration implique généralement de spécifier le point de terminaison de l'API et l'ID du modèle dans les paramètres.

- Cadres d'automatisation : Exploitez le noyau agentique de K2 avec des frameworks comme LangChain ou Haystack pour enchaîner les invites, les appels d'API et les étapes d'exécution de code dans des automatisations complexes.

Quels sont les cas d’utilisation typiques de Kimi K2 ?

La combinaison de l'échelle, de la formation des agents et de l'accès ouvert de K2 le rend polyvalent dans tous les domaines.

Aide au codage

De la génération de modèles standard et de la refactorisation à la correction de bogues et au profilage des performances, les benchmarks de codage SOTA de K2 se traduisent par des gains de productivité réels, surpassant souvent les alternatives en termes de lisibilité et de simplicité.

Connaissance et raisonnement

Avec une longueur de contexte de 128 Ko, K2 gère les documents longs, les questions-réponses multi-documents et le raisonnement par chaîne de pensée. Son architecture MoE garantit la rétention de connaissances diverses sans oubli catastrophique.

Flux de travail d'agents

K2 excelle dans l'orchestration de tâches en plusieurs étapes (récupération de données, appel d'API, mise à jour des bases de code et synthèse des résultats), ce qui le rend idéal pour les assistants autonomes dans le support client, l'analyse de données et DevOps.

Comment Kimi K2 se compare-t-il aux autres modèles open source ?

Alors que les récentes versions ouvertes de DeepSeek V3 et Meta ont dominé les gros titres plus tôt en 2025, Kimi K2 se différencie par :

Intelligence agentique

Kimi K2 a été spécifiquement conçu pour les workflows « agentiques » : automatisation des tâches via des appels d'outils, des commandes shell, l'automatisation web et l'intégration d'API. Son ensemble de données d'entraînement auto-exécutable comprend divers exemples d'appels d'outils, permettant une intégration transparente avec des systèmes réels.

Efficacité des coûts

Avec un coût d'inférence par jeton environ 80 à 90 % inférieur à celui de modèles comme Claude Sonnet 4, Kimi K2 offre des performances de niveau entreprise sans prix exorbitants, catalysant une adoption rapide parmi les développeurs sensibles aux prix.

Licences et accessibilité

Contrairement à certaines versions open source encombrées de licences restrictives, Kimi K2 est disponible sous une licence permissive qui autorise l'utilisation commerciale, les œuvres dérivées et les déploiements locaux, conformément à l'éthique open source de Moonshot AI.

- En alliant une conception MoE de pointe, une formation agentique rigoureuse et une disponibilité open source, Kimi K2 permet aux développeurs et aux chercheurs de créer des applications intelligentes et autonomes sans coûts prohibitifs ni écosystèmes fermés. Que vous écriviez du code, élaboriez des workflows complexes en plusieurs étapes ou expérimentiez un raisonnement à grande échelle, K2 offre une base polyvalente et performante.