Seedance 2.0 est le modèle de génération vidéo IA de nouvelle génération de ByteDance, officiellement lancé en mars 2026. Il prend en charge les entrées texte, image, audio et vidéo, peut utiliser jusqu’à 9 images, 3 clips vidéo et 3 clips audio comme références, et est conçu pour offrir un contrôle de niveau réalisateur, une stabilité des mouvements et une co‑génération audio‑vidéo. Dans les classements actuels à votes à l’aveugle d’Artificial Analysis, Seedance 2.0 arrive en tête des catégories texte‑vers‑vidéo et image‑vers‑vidéo sans audio, avec des scores Elo de 1269 et 1351 respectivement.

Qu’est-ce que Seedance 2.0 ?

Seedance 2.0 est le modèle de création vidéo nouvelle génération de ByteDance Seed. Officiellement, il s’appuie sur une architecture unifiée de co‑génération multimodale audio‑vidéo acceptant des entrées texte, image, audio et vidéo, et il se positionne comme un outil pour créateurs doté de capacités de référence et d’édition exceptionnellement larges. Seedance 2.0 a été conçu pour des workflows de contenu de niveau industriel, avec une précision physique, un réalisme, une contrôlabilité et une stabilité dans les scènes à mouvements complexes supérieurs à la version 1.5 précédente. Contrairement aux modèles plus anciens axés principalement sur le texte‑vers‑vidéo, Seedance 2.0 introduit une pipeline de génération multimodale entièrement unifiée, permettant :

- Génération texte‑vers‑vidéo

- Animation image‑vers‑vidéo

- Montage vidéo‑vers‑vidéo

- Sortie synchronisée avec l’audio

Cela en fait l’une des plateformes de création vidéo IA les plus complètes disponibles en 2026.

Pourquoi est-ce important ?

La plupart des générateurs vidéo restent optimisés pour un flux relativement étroit : un prompt en entrée, un clip en sortie. Seedance 2.0 va plus loin en abordant la génération vidéo comme un espace de travail de réalisateur. Selon ByteDance, il peut utiliser simultanément plusieurs types de références, préserver la cohérence du sujet, suivre plus fidèlement des instructions détaillées, et même planifier le langage de la caméra d’une manière plus « directoriale ». Cette combinaison compte, car les problèmes les plus difficiles en génération vidéo ne sont pas seulement esthétiques, mais relèvent de la continuité, de la cohérence des mouvements et du contrôle de ce qui se passe au fil du temps.

Quoi de neuf et fonctionnalités clés de Seedance 2.0 ?

Génération multimodale unifiée

La fonctionnalité la plus importante est la capacité du modèle à raisonner conjointement sur plusieurs modalités. Seedance 2.0 prend en charge jusqu’à 9 images, 3 vidéos et 3 clips audio comme références, ainsi que des instructions en langage naturel, et peut générer des vidéos jusqu’à 15 secondes. Concrètement, cela signifie que vous pouvez guider non seulement le sujet et la scène, mais aussi le style de mouvement, le déplacement de la caméra, les effets spéciaux et les cues audio en une seule passe de génération.

Contrôle de niveau réalisateur

Seedance 2.0 est également conçu autour de ce que ByteDance décrit comme un contrôle de niveau réalisateur. Les créateurs peuvent façonner l’interprétation, l’éclairage, les ombres et le mouvement de la caméra à l’aide d’images, d’audio et de vidéo de référence. Le modèle peut préserver l’identité du sujet de manière stable, reproduire fidèlement des scripts complexes et choisir un langage de caméra reflétant une sorte de « logique de montage » intégrée. Pour les créateurs, c’est un pas majeur au‑delà du simple texte‑vers‑vidéo.

Montage et extension, pas seulement génération

Autre amélioration notable : Seedance 2.0 ne s’arrête pas à la génération. Seedance 2.0 ajoute des capacités d’édition et d’extension vidéo, permettant des modifications ciblées de scènes, personnages, actions ou points d’intrigue spécifiques, et autorisant des plans de suivi continus. L’article destiné aux développeurs explique également que le modèle peut être utilisé pour « continuer le tournage » en prolongeant un clip plutôt qu’en repartant de zéro. Cela compte pour l’efficacité du workflow, car cela réduit le besoin de régénérer une scène entière pour corriger un segment.

Meilleure gestion des mouvements complexes

Seedance 2.0 est nettement plus performant dans les scènes avec plusieurs sujets, des interactions et des mouvements compliqués. La qualité de génération a considérablement progressé par rapport à la version 1.5, avec une meilleure précision physique, un réalisme accru et une contrôlabilité renforcée. Le taux d’exploitabilité de Seedance 2.0 dans les scènes de mouvement difficiles atteint un niveau SOTA dans le cadre de son évaluation interne, tout en reconnaissant que des améliorations restent nécessaires en stabilité des détails fins, réalisme et vivacité.

Évaluation des performances

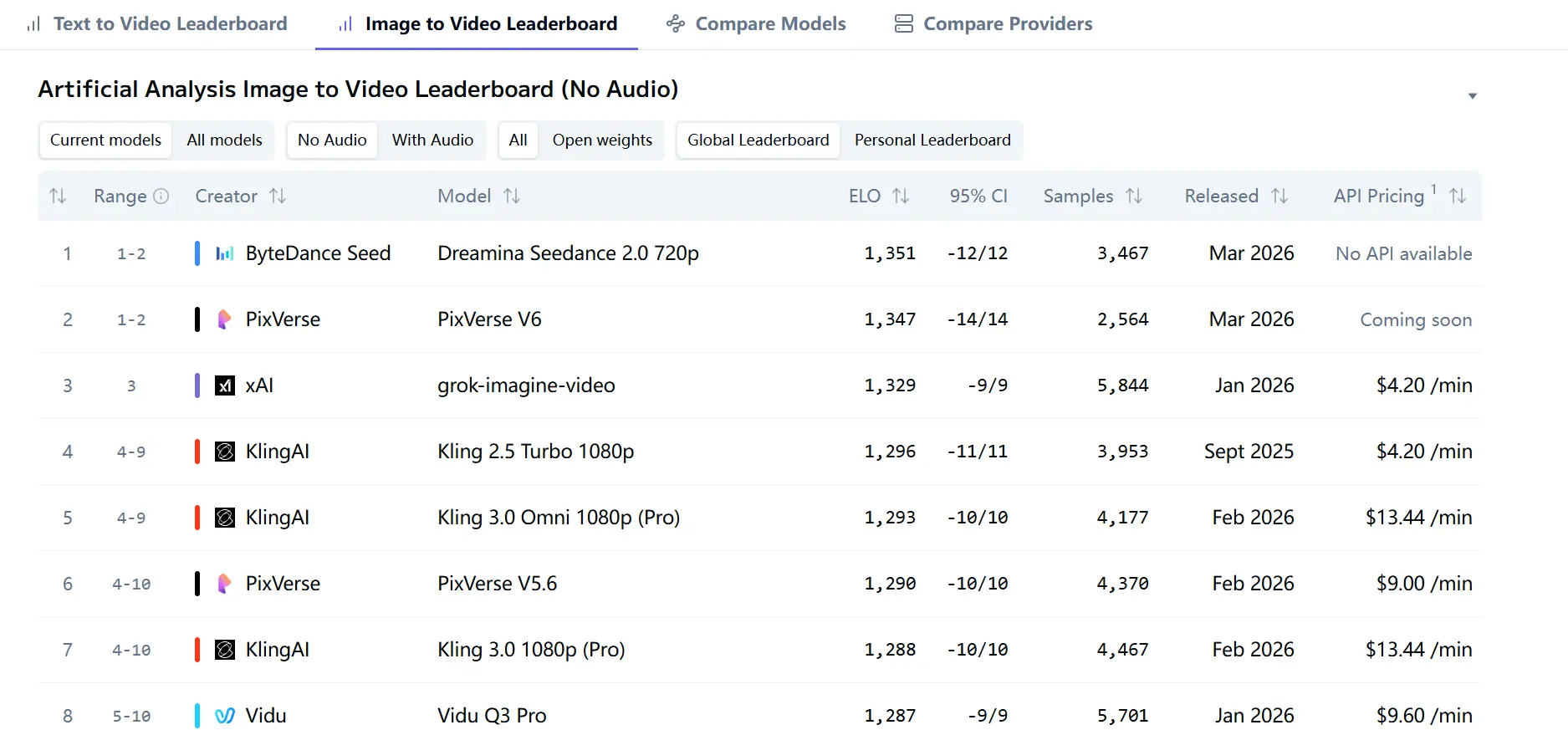

Le signal tiers le plus solide parmi les sources examinées est l’Artificial Analysis Video Arena. Sur les pages de classement actuelles, Dreamina Seedance 2.0 720p est en tête de l’Image‑to‑Video Arena sans audio avec un Elo de 1351, et de la Text‑to‑Video Arena sans audio avec un Elo de 1269. Les pages de classement indiquent également que les classements proviennent de votes d’utilisateurs à l’aveugle, ce qui est important car cela mesure la préférence humaine à grande échelle plutôt que de simples métriques internes au modèle.

Cela compte parce que cela signifie que Seedance 2.0 n’est pas seulement présenté comme performant ; il est actuellement préféré par les utilisateurs dans des tests comparatifs en confrontation directe sur deux arènes majeures. En texte‑vers‑vidéo sans audio, il devance Kling 3.0 1080p (Pro), SkyReels V4, PixVerse V6 et Kling 3.0 Omni 1080p (Pro). En image‑vers‑vidéo sans audio, il devance de peu PixVerse V6 et grok‑imagine‑video.

Instantané des performances de Seedance 2.0

| Indicateur | Seedance 2.0 |

|---|---|

| Classement image‑vers‑vidéo | Top 15 mondial |

| Score Elo | ~1258 |

| Classement texte‑vers‑vidéo | Top 25 |

| Coût | ~$1.56/min |

| Atout | Équilibre coût‑performance |

👉 Interprétation :

- Pas toujours n°1 en qualité brute

- Mais rapport valeur‑performance exceptionnel

Seedance 2.0, c’est vraiment si bon ?

Ses principaux atouts

Les plus grands atouts de Seedance 2.0 sont clairs : il gère mieux les mouvements complexes que de nombreux modèles vidéo, il prend en charge plusieurs modalités de référence, il offre l’édition et l’extension, et il dirige actuellement les classements publics les plus visibles en texte‑vers‑vidéo et image‑vers‑vidéo sans audio. Les améliorations en précision physique, réalisme et contrôlabilité sont précisément les attributs qui comptent lorsqu’un modèle passe de démos ludiques à des workflows professionnels.

Ses limites actuelles

Seedance n’est pas présenté par ByteDance comme parfait. Il reste des marges de progression en stabilité des détails, réalisme et vivacité des mouvements, et des défis subsistent en cohérence multi‑sujets, précision du rendu de texte et effets de montage complexes.

Mon évaluation

D’après les sources consultées, Seedance 2.0 ressemble moins à une mise à jour marginale qu’à une étape sérieuse vers un système vidéo prêt pour la production. Son meilleur argument n’est pas une seule démo tape‑à‑l’œil, mais la combinaison d’une pile d’entrées multimodales plus large, de contrôles d’édition directs, d’extension de clip et d’un leadership crédible sur des classements publics. Cela en fait l’un des modèles vidéo les plus importants actuellement sur le marché, en particulier pour les équipes qui accordent autant d’importance à la contrôlabilité qu’à la qualité cinématographique brute.

Seedance 2.0 vs Sora 2 vs Veo 3.1

Tableau de comparaison (leaders 2026 de la vidéo IA)

| Fonctionnalité | Seedance 2.0 | Sora 2 | Veo 3.1 |

|---|---|---|---|

| Développeur | ByteDance | OpenAI | |

| Types d’entrée | Texte, image, audio, vidéo | Texte | Texte + image |

| Génération audio | ✅ Natif | ❌ Limité | ✅ |

| Durée vidéo max | 15–20 sec | ~25 sec | ~8 sec (prolongeable) |

| Capacité de montage | ⭐ Avancée (basée sur des références) | Modérée | Modérée |

| Classement Elo | Top 15–25 | Élevé | Élevé |

| Efficacité coût | ⭐ Élevée | Moyenne | Moyenne |

| Usage commercial | Oui | Limité (filigrane) | Oui |

| Atout unique | Montage multimodal | Longue narration | Fidélité visuelle |

Points clés

- Seedance 2.0 = meilleur montage + flexibilité multimodale

- Sora 2 = meilleure longueur narrative

- Veo 3.1 = meilleure fidélité image‑vers‑vidéo

Dans les classements texte‑vers‑vidéo actuels d’Artificial Analysis, Seedance 2.0 720p est devant Veo 3.1 et Sora 2 Pro dans la catégorie sans audio. Cela ne tranche pas tous les débats sur la qualité, car les modèles diffèrent par le workflow, les contraintes de sécurité et la mise en produit, mais cela montre que Seedance 2.0 a rejoint le même premier niveau que les offres occidentales les plus visibles.

L’avantage le plus évident de Seedance 2.0 est l’ampleur des entrées. ByteDance indique qu’il peut traiter conjointement texte, image, audio et vidéo, et qu’il peut utiliser jusqu’à 9 images, 3 vidéos et 3 clips audio à la fois. La documentation de Sora 2 d’OpenAI, en revanche, liste le texte et l’image comme entrées et la vidéo plus l’audio comme sorties, avec un accès via l’application Sora et sora.com ; Sora 2 Pro est également disponible pour les utilisateurs de ChatGPT Pro sur le web. Veo 3.1 de Google se situe quelque part entre les deux : il est centré sur la création guidée par l’image et la génération de vidéos riches en audio, avec jusqu’à 3 images de référence, l’extension de scène, et un contrôle de la première et de la dernière image.

Comment accéder et où comparer

Si vous souhaitez accéder à Sora 2, Veo 3.1 et xx simultanément sur une même plateforme, je recommande CometAPI. Le Playground de CometAPI permet la génération vidéo directe en n’utilisant qu’une commande simple ou quelques images de référence. Si vous voulez configurer votre propre API de génération vidéo par programmation, alors CometAPI mérite encore plus d’être considéré. Il fournit des API pour Sora 2, Veo 3.1, etc., et est actuellement proposé avec 20 % de réduction.

Comment utiliser Seedance 2.0 avec CometAPI

Génération texte‑vers‑vidéo

Saisissez la description de votre scène. Plus vous êtes précis, mieux c’est — incluez les mouvements de caméra, l’éclairage, l’ambiance et le style. La forte adhérence aux prompts de Seedance 2.0 fait que la sortie correspond étroitement à votre intention, ce qui le rend fiable pour la production de contenu plutôt que pour des essais‑erreurs.

Dans le Playground CometAPI, vous pouvez saisir directement des prompts et générer des vidéos avec le modèle Seedance 2.0. C’est particulièrement utile pour le contenu social (Reels, TikTok, YouTube Shorts), les vidéos de marque et les courts métrages narratifs.

Comment procéder :

- Ouvrez CometAPI

- Sélectionnez le modèle Seedance 2.0

- Saisissez votre prompt

- Ajustez les paramètres (durée, résolution, ratio d’aspect)

- Lancez la génération et attendez le résultat

Image‑vers‑vidéo avec CometAPI

Téléchargez une image statique — telle qu’une photo produit, une illustration conceptuelle ou une maquette — et utilisez les capacités image‑vers‑vidéo de Seedance 2.0 via CometAPI pour l’animer.

Le résultat est un mouvement fluide et contextuel généré à partir de votre entrée visuelle. C’est idéal pour les équipes disposant déjà d’assets de design et souhaitant les transformer en vidéo sans un workflow de production complet.

Comment procéder :

- Utilisez

input_reference(ou le champ de téléversement de fichier équivalent dans le Playground) - Ajoutez un prompt axé sur le mouvement décrivant comment la scène doit évoluer

Exemple de prompt :

« La caméra effectue un lent travelling avant vers le produit, éclairage de studio doux, reflets subtils, ambiance publicitaire haut de gamme »

Génération audio‑visuelle en une seule passe

Au lieu de générer d’abord la vidéo puis d’ajouter séparément l’audio, CometAPI prend en charge la pipeline de génération audio‑visuelle native de Seedance 2.0.

En décrivant à la fois les visuels et le son dans un seul prompt, vous pouvez générer une vidéo et un audio synchronisés en une étape. Cela produit des résultats plus cohérents et intentionnels tout en réduisant le temps de montage.

Exemple de prompt :

« Une plage paisible au lever du soleil, douces vagues déferlantes, lumière dorée chaleureuse, musique d’ambiance douce avec sons de l’océan »

La sortie comprend :

- Vidéo générée

- Piste audio de fond synchronisée

- Synchronisation et ambiance naturellement alignées

Pourquoi utiliser CometAPI pour Seedance 2.0

- Accès direct via l’API ou le Playground

- Contrôle simple des paramètres (durée, résolution, format)

- Prise en charge des flux texte‑vers‑vidéo et image‑vers‑vidéo

- Gestion intégrée des tâches pour la génération vidéo asynchrone

Conclusion

Seedance 2.0 ressemble à un véritable bond en avant en génération vidéo IA : un système multimodal combinant entrées texte, image, audio et vidéo ; un leader de classement à la fois en texte‑vers‑vidéo et image‑vers‑vidéo ; et un modèle conçu pour un contrôle de style réalisateur plutôt qu’un usage ludique occasionnel. Si vous ne vous souciez que de la qualité perçue brute, les éléments actuels indiquent qu’il est exceptionnel.

Commencez à créer avec Seedance 2.0 sur CometAPI dès aujourd’hui.