Le 28 juillet 2025, la startup pékinoise Zhipu AI a officiellement dévoilé sa série de grands modèles de langage open source GLM‑4.5, marquant sa version la plus puissante à ce jour et visant des applications d’agents intelligents avancées. L’annonce — faite lors d’un événement en ligne en direct à la suite de la World Artificial Intelligence Conference (WAIC) — a présenté deux variantes : la version complète GLM‑4.5 avec 355 milliards de paramètres totaux (32 milliards actifs) et la version plus compacte GLM‑4.5‑Air avec 106 milliards de paramètres totaux (12 milliards actifs). Les deux modèles adoptent une architecture de raisonnement hybride « réfléchi » et « non réfléchi » conçue pour équilibrer l’inférence profonde et la réponse rapide, et offrent une fenêtre de contexte de 128,000 tokens pour des cas d’usage conversationnels et orientés tâches à grande échelle.

Le lancement de GLM‑4.5 intervient dans un contexte de course nationale à l’IA qui s’intensifie. Selon l’agence d’État Xinhua, les développeurs chinois ont publié 1,509 grands modèles de langage en juillet 2025, en tête du total mondial de 3,755 modèles — un témoignage clair de l’ampleur et de la rapidité d’expansion de l’écosystème de l’IA en Chine.

Licence open source de GLM‑4.5

En nette rupture avec les paradigmes propriétaires fermés, Z.ai publie GLM‑4.5 sous une licence open source « de type MIT », entièrement vérifiable, offrant aux entreprises une transparence totale sur les poids du modèle et le code d’entraînement. Les organisations peuvent déployer GLM‑4.5 sur site, l’affiner sur des jeux de données propriétaires, ou l’intégrer via des services d’inférence auto‑hébergés, évitant ainsi le verrouillage fournisseur et des structures de tarification d’API opaques.

La disponibilité de GLM‑4.5 pour les tâches agentiques générales et de GLM‑4.5‑Air, une variante légère optimisée pour les environnements à faibles ressources, garantit un large spectre d’usages — des déploiements à l’échelle des centres de données aux scénarios d’inférence sur appareils en périphérie.

Sur le plan stratégique, l’approche open source de Zhipu positionne l’entreprise face aux acteurs occidentaux fermés comme OpenAI. En démocratisant l’accès à un modèle comparable à GPT‑4 sous licence MIT, Zhipu vise à cultiver une communauté robuste de développeurs en aval et à établir des références techniques pour les capacités d’IA agentique. Les observateurs de l’industrie notent que cette initiative s’inscrit dans une tendance plus large parmi les « tigres de l’IA » chinois, dont Moonshot AI et Step AI, qui ont également ouvert leurs grands modèles pour accélérer les cycles d’innovation.

Benchmarks de performance et analyse comparative

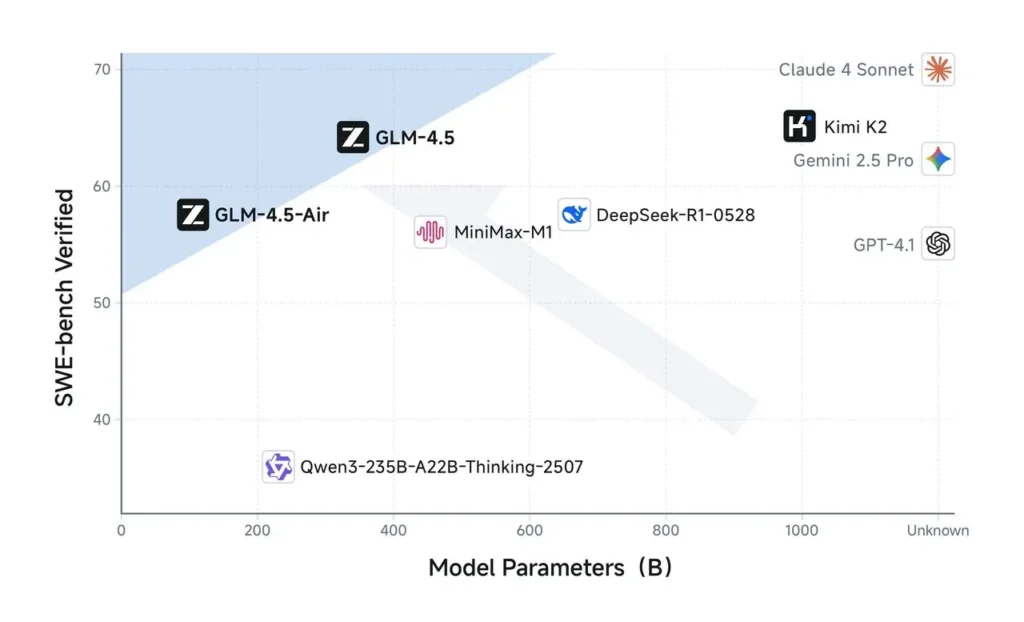

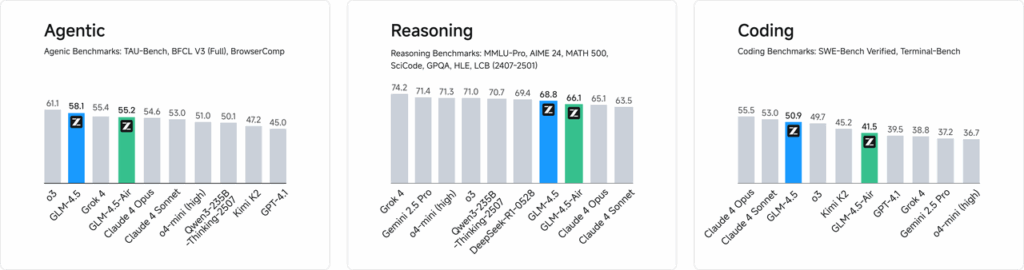

Des benchmarks préliminaires fournis par Zhipu AI indiquent que GLM‑4.5 atteint un score agrégé de 63.2 sur 12 suites d’évaluation standardisées — le plaçant au troisième rang parmi les modèles open source et propriétaires — tandis que la version allégée GLM‑4.5‑Air obtient 59.8, conciliant efficacité et haute précision. Des évaluations internes de programmation montrent en outre que GLM‑4.5 surpasse des rivaux majeurs, avec un taux de victoire de 53.9 % contre Kimi K2 et un taux de réussite de 80.8 % face à Qwen3‑Coder sur 52 tâches de programmation variées.

Les démonstrations lors de l’événement en direct ont mis en avant les capacités agentiques de GLM‑4.5 : le modèle a mené de manière autonome des recherches web — récupérant et synthétisant des informations issues de multiples sources — et a interagi avec des environnements simulés de réseaux sociaux et de développement pour générer des publications, exécuter des extraits de code et manipuler des éléments d’interface utilisateur en temps réel. Les utilisateurs intéressés peuvent essayer immédiatement la version complète gratuitement via le portail Qingyan de Zhipu et la plateforme CometAPI, tandis que les développeurs peuvent accéder aux endpoints d’API sur le service BigModel de CometAPI ou télécharger l’intégralité des poids du modèle depuis Hugging Face et ModelScope sous licence MIT.

L’efficacité des coûts est une pierre angulaire de la stratégie de Z.ai. Entraîné sur un corpus de 15 trillion de tokens, GLM‑4.5 exploite des chemins d’inférence optimisés pour offrir un débit de 100–200 tokens par seconde — jusqu’à huit fois plus rapide que des rivaux nationaux comparables — à un prix annoncé de seulement $0.11 par million de tokens, sous‑cotant des modèles comme DeepSeek‑R1 et les dernières versions d’Alibaba. Sous la licence permissive MIT, tous les poids, le code et la documentation du modèle sont librement disponibles via Hugging Face, afin de favoriser une communauté mondiale dynamique de développeurs et de chercheurs.

« GLM‑4.5 incarne notre engagement à démocratiser l’accès à une technologie d’IA de premier plan », a déclaré Zhang Peng, CEO de Z.ai, dans une interview à CNBC. « En ouvrant un modèle qui excelle en raisonnement, en programmation et dans des fonctions agentiques, nous permettons aux organisations de toute taille d’innover sans les contraintes d’API propriétaires ni des coûts prohibitifs. »

Prise en main

CometAPI est une plateforme d’API unifiée qui agrège plus de 500 modèles d’IA de fournisseurs majeurs — tels que la série GPT d’OpenAI, Gemini de Google, Claude d’Anthropic, Midjourney, Suno, et plus encore — au sein d’une interface unique conviviale pour les développeurs. En offrant une authentification cohérente, un formatage des requêtes homogène et une gestion uniforme des réponses, CometAPI simplifie considérablement l’intégration de capacités d’IA dans vos applications. Que vous développiez des chatbots, des générateurs d’images, des compositeurs de musique ou des pipelines d’analytique pilotés par les données, CometAPI vous permet d’itérer plus vite, de maîtriser les coûts et de rester agnostique vis‑à‑vis des fournisseurs — tout en tirant parti des dernières avancées de l’écosystème de l’IA.

Les développeurs peuvent accéder à l’API GLM‑4.5 via CometAPI, les versions les plus récentes des modèles Claude répertoriées correspondant à la date de publication de l’article. Pour commencer, explorez les capacités du modèle dans le Playground et consultez le guide API pour des instructions détaillées. Avant d’y accéder, assurez‑vous de vous être connecté à CometAPI et d’avoir obtenu la clé API. CometAPI propose un prix bien inférieur au tarif officiel pour faciliter votre intégration.