Kecerdasan Buatan (AI) telah merevolusi banyak industri, dan salah satu aplikasinya yang paling menarik adalah dalam pembuatan gambar. Dari membuat wajah manusia yang realistis hingga menghasilkan karya seni surealis, kemampuan Pembuatan Gambar AI telah membuka jalan baru dalam seni, desain, dan teknologi. Artikel ini membahas mekanisme di balik gambar yang dihasilkan AI, model yang mendukungnya, dan implikasi yang lebih luas dari teknologi ini.

Memahami Dasar-Dasarnya: Bagaimana Cara Kerja Pembuatan Gambar AI?

Apa itu Model Generatif?

Model generatif adalah kelas algoritme AI yang dapat membuat contoh data baru yang menyerupai data pelatihan. Dalam konteks pembuatan gambar, model ini mempelajari pola dari gambar yang ada dan menggunakan pengetahuan ini untuk menghasilkan gambar baru yang serupa.

Peran Jaringan Neural

Inti dari pembuatan gambar AI adalah jaringan saraf, khususnya model pembelajaran mendalam seperti Jaringan Saraf Konvolusional (CNN). CNN dirancang untuk memproses data dengan topologi seperti kisi, sehingga ideal untuk analisis dan pembuatan gambar. CNN bekerja dengan mendeteksi pola seperti tepi, tekstur, dan bentuk, yang penting untuk memahami dan membuat ulang gambar.

Model AI Utama dalam Pembuatan Gambar AI

Jaringan Permusuhan Generatif (GAN)

Diperkenalkan oleh Ian Goodfellow pada tahun 2014, GAN terdiri dari dua jaringan saraf: generator dan diskriminator. Generator menciptakan gambar, sementara diskriminator mengevaluasinya terhadap gambar nyata. Melalui proses yang berlawanan ini, generator meningkatkan outputnya untuk menghasilkan gambar yang semakin realistis.

GayaGAN

Dikembangkan oleh NVIDIA, StyleGAN adalah varian GAN yang dikenal untuk menghasilkan wajah manusia berkualitas tinggi. Varian ini memperkenalkan arsitektur generator berbasis gaya, yang memungkinkan kontrol atas berbagai tingkat detail dalam gambar. StyleGAN2 dan StyleGAN3 semakin meningkatkan kualitas gambar dan mengatasi masalah seperti tekstur yang menempel.

Model Difusi

Model difusi menghasilkan gambar dengan memulai dengan gangguan acak dan secara bertahap menyempurnakannya agar sesuai dengan keluaran yang diinginkan. Model ini populer karena kemampuannya menghasilkan gambar berkualitas tinggi dan fleksibilitasnya dalam berbagai aplikasi.

Difusi Stabil

Stable Diffusion adalah model difusi sumber terbuka yang memungkinkan pembuatan teks menjadi gambar. Model ini juga dapat melakukan inpainting dan outpainting, yang memungkinkan penyuntingan dan perluasan gambar. Sifat sumber terbukanya telah membuatnya dapat diakses secara luas oleh para pengembang dan seniman.

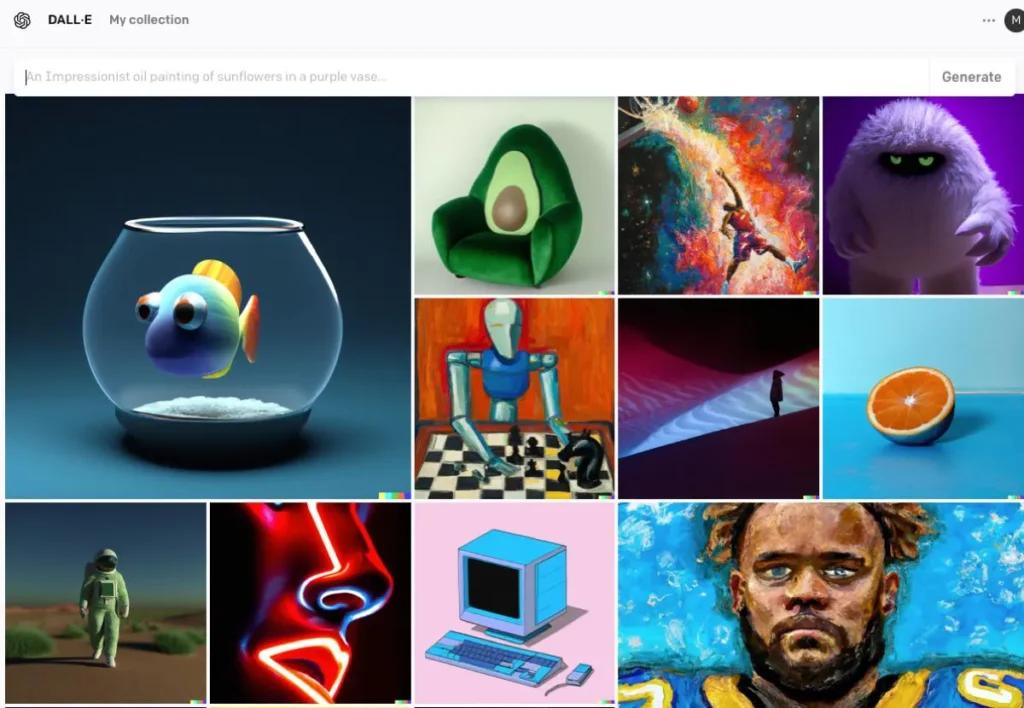

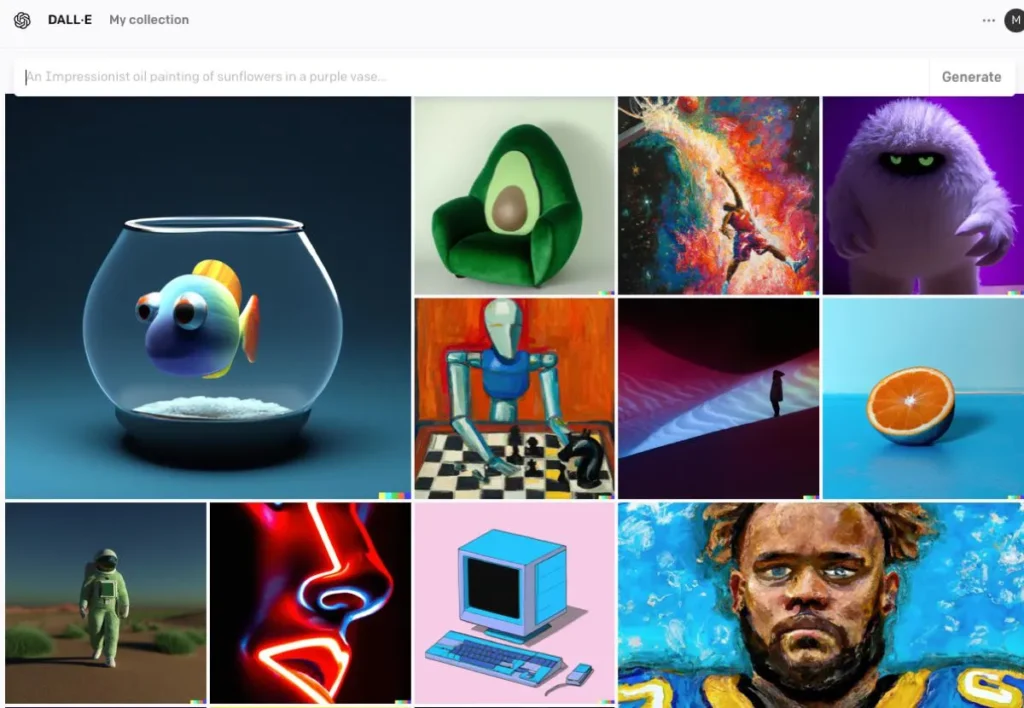

DALL · E

Dikembangkan oleh OpenAI, DALL·E adalah model berbasis transformer yang mampu menghasilkan gambar dari deskripsi tekstual. DALL·E 2 dan DALL·E 3 telah menyempurnakan model aslinya, menawarkan resolusi yang lebih tinggi dan penyelarasan gambar-teks yang lebih akurat. DALL·E 3 terintegrasi ke dalam ChatGPT untuk meningkatkan interaksi pengguna.

Proses Pembuatan Gambar AI

Melatih Model

Model AI memerlukan pelatihan ekstensif pada kumpulan data gambar yang besar. Selama pelatihan, model belajar mengenali pola dan fitur dalam gambar, sehingga memungkinkannya menghasilkan gambar baru yang meniru data pelatihan.

Menghasilkan Gambar Baru

Setelah dilatih, model dapat menghasilkan gambar baru dengan:

- Menerima Input: Ini bisa berupa gangguan acak (dalam GAN), perintah teks (dalam DALL·E), atau gambar yang sudah ada (untuk diedit). Langkah ini menangkap makna semantik teks, yang memungkinkan AI memahami konten dan konteks.

- Memproses Input: Model memproses input melalui lapisan jaringan sarafnya, menerapkan pola dan fitur yang dipelajari. Dengan menggunakan teks yang dikodekan, AI menggunakan model seperti Generative Adversarial Networks (GAN) atau model difusi untuk membuat gambar. Model-model ini menghasilkan gambar dengan memulai dengan gangguan acak dan menyempurnakannya agar sesuai dengan deskripsi tekstual.

- Penyempurnaan dan Evaluasi: Gambar yang dihasilkan kemudian disempurnakan menggunakan mekanisme perhatian untuk memastikan koherensi dengan teks. Model diskriminator mengevaluasi realisme dan konsistensi gambar dengan input, memberikan umpan balik untuk penyempurnaan lebih lanjut.

- Mengeluarkan Gambar:Hasil akhir adalah gambar baru yang mencerminkan karakteristik data pelatihan dan masukan spesifik yang diberikan.

Contoh Kode Pembuatan Gambar AI

Berikut adalah contoh kode Python praktis yang menunjukkan cara menghasilkan gambar menggunakan tiga model AI terkemuka: Generative Adversarial Networks (GAN), Stable Diffusion, dan DALL·E.

Jaringan Adversarial Generatif (GAN) dengan PyTorch

Generative Adversarial Networks (GAN) terdiri dari dua jaringan saraf—Generator dan Diskriminator—yang bersaing satu sama lain untuk menghasilkan contoh data baru yang realistis. Berikut contoh sederhana menggunakan PyTorch untuk menghasilkan gambar:

pythonimport torch

import torch.nn as nn

# Define the Generator network

class Generator(nn.Module):

def __init__(self):

super(Generator, self).__init__()

self.fc1 = nn.Linear(100, 128)

self.fc2 = nn.Linear(128, 784) # Assuming output image size is 28x28

def forward(self, x):

x = torch.relu(self.fc1(x))

x = torch.tanh(self.fc2(x))

return x

# Instantiate the generator

generator = Generator()

# Generate a random noise vector

noise = torch.randn(1, 100)

# Generate an image

generated_image = generator(noise)

Kode ini mendefinisikan jaringan generator sederhana yang mengambil vektor kebisingan 100 dimensi sebagai input dan menghasilkan output 784 dimensi, yang dapat dibentuk ulang menjadi gambar 28×28. tanh fungsi aktivasi memastikan bahwa nilai keluaran berada dalam rentang , yang umum untuk data gambar.

Difusi Stabil dengan Hugging Face Diffusers

Stable Diffusion adalah model teks-ke-gambar yang kuat yang menghasilkan gambar berdasarkan deskripsi tekstual. The Hugging Face diffusers perpustakaan menyediakan antarmuka yang mudah untuk menggunakan model ini:

pythonfrom diffusers import StableDiffusionPipeline

import torch

# Load the pre-trained Stable Diffusion model

pipe = StableDiffusionPipeline.from_pretrained("CompVis/stable-diffusion-v1-4")

pipe = pipe.to("cuda") # Move the model to GPU for faster inference

# Generate an image from a text prompt

prompt = "A serene landscape with mountains and a river"

image = pipe(prompt).images

# Save the generated image

image.save("generated_image.png")

Skrip ini memuat model Difusi Stabil dan menghasilkan gambar berdasarkan perintah yang diberikan. Pastikan Anda telah menginstal dependensi yang diperlukan dan GPU yang kompatibel untuk kinerja yang optimal.

DALL·E dengan API OpenAI

DALL·E adalah model teks-ke-gambar lain yang dikembangkan oleh OpenAI. Anda dapat berinteraksi dengannya menggunakan API OpenAI:

pythonimport openai

import requests

from PIL import Image

from io import BytesIO

# Set your OpenAI API key

openai.api_key = "your-api-key"

# Generate an image using DALL·E

response = openai.Image.create(

prompt="A futuristic cityscape at sunset",

n=1,

size="512x512"

)

# Get the URL of the generated image

image_url = response

# Download and display the image

image_response = requests.get(image_url)

image = Image.open(BytesIO(image_response.content))

image.save("dalle_generated_image.png")

menggantikan "your-api-key" dengan kunci API OpenAI Anda yang sebenarnya. Skrip ini mengirimkan perintah ke model DALL·E dan mengambil gambar yang dihasilkan. Gambar tersebut kemudian disimpan secara lokal.

CometAPI juga terintegrasi API DALL-E 3Anda juga dapat menggunakan kunci CometAPI untuk mengakses API DALL-E 3, yang lebih nyaman dan cepat daripada OpenAI.

Untuk informasi Model lebih lanjut di Comet API silakan lihat Dokumen API.

Contoh-contoh ini memberikan titik awal untuk menghasilkan gambar menggunakan berbagai model AI. Setiap model memiliki kemampuan dan persyaratan yang unik, jadi pilihlah yang paling sesuai dengan kebutuhan proyek Anda.

Kesimpulan

Pembuatan gambar dengan AI berada di persimpangan antara teknologi dan kreativitas, menawarkan kemungkinan yang belum pernah ada sebelumnya dalam pembuatan konten visual. Memahami bagaimana AI menghasilkan gambar, model yang terlibat, dan implikasi dari teknologi ini sangat penting saat kita menavigasi integrasinya ke dalam berbagai aspek masyarakat.

Akses AI Image API di CometAPI

CometAPI menyediakan akses ke lebih dari 500 model AI, termasuk model multimoda sumber terbuka dan khusus untuk obrolan, gambar, kode, dan banyak lagi. Kekuatan utamanya terletak pada penyederhanaan proses integrasi AI yang secara tradisional rumit. Dengannya, akses ke alat AI terkemuka seperti Claude, OpenAI, Deepseek, dan Gemini tersedia melalui satu langganan terpadu. Anda dapat menggunakan API di CometAPI untuk membuat musik dan karya seni, membuat video, dan membangun alur kerja Anda sendiri

API Komet menawarkan harga yang jauh lebih rendah dari harga resmi untuk membantu Anda mengintegrasikan API GPT-4o ,API Midjourney API Difusi Stabil (API Difusi Stabil XL 1.0) dan Flux API(FLUX.1 API dll), dan Anda akan mendapatkan $1 di akun Anda setelah mendaftar dan masuk!

CometAPI mengintegrasikan yang terbaru API gambar GPT-4o .