API GPT 5.1 adalah apa yang disebut GPT-5.1 Thinking sebagai varian penalaran tingkat lanjut dari keluarga GPT-5.1 OpenAI. API ini mengutamakan penalaran adaptif dan berkualitas tinggi sekaligus memberikan kontrol eksplisit kepada pengembang atas keseimbangan latensi/komputasi.

Fitur dasar

- Penalaran adaptifModel ini secara dinamis menyesuaikan kedalaman berpikir per permintaan — lebih cepat pada tugas rutin, lebih persisten pada tugas kompleks. Hal ini mengurangi latensi dan penggunaan token untuk kueri umum. Model ini secara eksplisit mengalokasikan lebih banyak waktu penalaran untuk perintah kompleks, dan lebih persisten pada masalah multi-langkah; bisa lebih lambat untuk tugas yang sulit tetapi memberikan jawaban yang lebih mendalam.

- Mode penalaran:

none/low/medium/high(GPT-5.1 secara default adalahnoneuntuk kasus latensi rendah; pilih level yang lebih tinggi untuk tugas yang lebih menuntut). API Respons memperlihatkanreasoningparameter untuk mengontrol ini. - Nada & gaya default: ditulis lebih jelas tentang topik yang kompleks (lebih sedikit jargon), lebih bersifat menjelaskan dan “sabar.”

- Jendela konteks (token / konteks panjang) Berpikir: jauh lebih besar — 400K konteks token untuk tingkatan berbayar.

Detail teknis utama

- Alokasi komputasi adaptif —Pelatihan dan desain inferensi menyebabkan model mengeluarkan lebih sedikit token penalaran untuk tugas-tugas sepele dan secara proporsional lebih banyak untuk tugas-tugas sulit. Ini bukan "mesin berpikir" yang terpisah, melainkan alokasi dinamis dalam alur penalaran.

- Parameter penalaran di API Respons — klien melewati

reasoningobjek (misalnyareasoning: { "effort": "high" }) untuk meminta penalaran internal yang lebih dalam; pengaturanreasoning: { "effort": "none" }Secara efektif menonaktifkan proses penalaran internal yang diperluas untuk latensi yang lebih rendah. API Respons juga mengembalikan metadata penalaran/token (bermanfaat untuk biaya dan debugging). - Alat & panggilan alat paralel — GPT-5.1 meningkatkan pemanggilan alat paralel dan menyertakan alat bernama (seperti

apply_patch) yang mengurangi mode kegagalan untuk penyuntingan terprogram; paralelisasi meningkatkan throughput ujung ke ujung untuk alur kerja yang banyak menggunakan alat. - Prompt cache dan persistensi -

prompt_cache_retention='24h'didukung pada titik akhir Respons dan Penyelesaian Obrolan untuk mempertahankan konteks di seluruh sesi multi-giliran (mengurangi pengodean token berulang).

Kinerja tolok ukur

Contoh latensi/efisiensi token (disediakan vendor): Pada kueri rutin, OpenAI melaporkan pengurangan token/waktu yang signifikan (contoh: perintah daftar npm yang sebelumnya membutuhkan ~10 detik / ~250 token pada GPT-5 kini membutuhkan ~2 detik / ~50 token pada GPT-5.1 dalam pengujian representatif mereka). Penguji awal pihak ketiga (misalnya, manajer aset, perusahaan pemrograman) melaporkan peningkatan kecepatan 2–3 kali lipat pada banyak tugas dan peningkatan efisiensi token dalam alur yang banyak menggunakan alat.

OpenAI dan mitra awal menerbitkan klaim tolok ukur representatif dan mengukur peningkatan:

| Evaluasi | GPT‑5.1 (tinggi) | GPT‑5 (tinggi) |

| Bangku SWE Terverifikasi (semua 500 soal) | 76.3% | 72.8% |

| Berlian GPQA (tanpa alat) | 88.1% | 85.7% |

| TUJUAN 2025 (tanpa alat) | 94.0% | 94.6% |

| Matematika Perbatasan (dengan alat Python) | 26.7% | 26.3% |

| MMMU | 85.4% | 84.2% |

| Tau2-bangku Maskapai Penerbangan | 67.0% | 62.6% |

| Tau2-bangku Telekomunikasi* | 95.6% | 96.7% |

| Tau2-bangku Ritel | 77.9% | 81.1% |

| BrowseComp Konteks Panjang 128k | 90.0% | 90.0% |

Keterbatasan & pertimbangan keselamatan

- Risiko halusinasi tetap ada. Penalaran adaptif membantu dalam memecahkan masalah yang kompleks namun tidak menghilangkan halusinasi;

reasoning_effortMeningkatkan pemeriksaan tetapi tidak menjamin keakuratan. Selalu validasi keluaran berisiko tinggi. - Pertukaran sumber daya dan biaya: Meskipun GPT-5.1 bisa jauh lebih efisien dalam penggunaan token pada alur sederhana, mengaktifkan upaya penalaran yang tinggi atau penggunaan alat agen yang lama dapat meningkatkan konsumsi token dan latensi. Gunakan caching prompt untuk mengurangi biaya berulang jika diperlukan.

- Keamanan alat:

apply_patchdanshellPeralatan meningkatkan daya otomatisasi (dan risiko). Penerapan di area produksi harus mengendalikan eksekusi peralatan (meninjau perbedaan/perintah sebelum eksekusi), menggunakan hak akses paling rendah, dan memastikan CI/CD serta pagar pengaman operasional yang kuat.

Perbandingan dengan model lain

- melawan GPT-5: GPT-5.1 meningkatkan penalaran adaptif dan kepatuhan instruksi; OpenAI melaporkan waktu respons yang lebih cepat pada tugas-tugas mudah dan persistensi yang lebih baik pada tugas-tugas sulit. GPT-5.1 juga menambahkan

noneopsi penalaran dan penembolokan perintah yang diperluas. - vs GPT-4.x / 4.1GPT-5.1 dirancang untuk tugas-tugas yang lebih agensi, membutuhkan banyak alat, dan pengodean; OpenAI dan mitranya melaporkan peningkatan pada tolok ukur pengodean dan penalaran multi-langkah. Untuk banyak tugas percakapan standar, GPT-5.1 Instant mungkin sebanding dengan model obrolan GPT-4.x sebelumnya, tetapi dengan kemampuan kendali dan preset kepribadian yang lebih baik.

- vs Antropik / Claude / LLM lainnyaArsitektur MoA ChatGPT 5.1 memberikannya keunggulan tersendiri dalam tugas-tugas yang membutuhkan penalaran kompleks dan multi-langkah. ChatGPT 5.1 meraih skor 98.20 yang belum pernah terjadi sebelumnya pada benchmark HELM untuk penalaran kompleks, dibandingkan dengan Claude 4 yang hanya 95.60 dan Gemini 2.0 Ultra yang hanya 94.80.

Kasus penggunaan umum

- Asisten pengkodean agen / Tinjauan PR / Pembuatan kode — ditingkatkan

apply_patchkeandalan dan pengendalian kode yang lebih baik. - Penalaran multi-langkah yang kompleks — penjelasan teknis, bukti matematika, draf ringkasan hukum di mana model harus merangkai langkah-langkah dan memeriksa pekerjaan.

- Agen otomatis dengan penggunaan alat — pengambilan pengetahuan + alur kerja pemanggilan alat (basis data/pencarian/shell), di mana pemanggilan alat paralel dan penalaran yang lebih persisten meningkatkan throughput dan ketahanan.

- Otomatisasi dukungan pelanggan untuk tiket yang rumit — di mana diagnosis bertahap dan pengumpulan bukti multi-putaran dibutuhkan, dan model tersebut dapat menyeimbangkan kecepatan dan upaya.

Cara memanggil API GPT-5.1 dari CometAPI

Harga API gpt-5.1 di CometAPI, diskon 20% dari harga resmi:

| Token Masukan | $1.00 |

| Token Keluaran | $8.00 |

Langkah-langkah yang Diperlukan

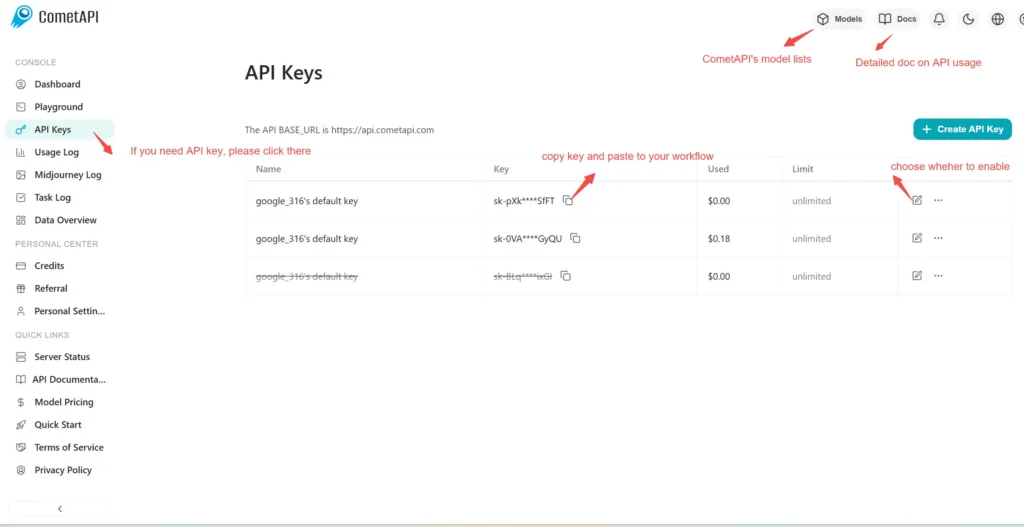

- Masuk ke cometapi.comJika Anda belum menjadi pengguna kami, silakan mendaftar terlebih dahulu.

- Masuk ke Anda Konsol CometAPI.

- Dapatkan kunci API kredensial akses antarmuka. Klik “Tambahkan Token” pada token API di pusat personal, dapatkan kunci token: sk-xxxxx dan kirimkan.

Gunakan Metode

- Pilih "

gpt-5.1” untuk mengirim permintaan API dan mengatur isi permintaan. Metode permintaan dan isi permintaan diperoleh dari dokumen API situs web kami. Situs web kami juga menyediakan pengujian Apifox demi kenyamanan Anda. - Mengganti dengan kunci CometAPI Anda yang sebenarnya dari akun Anda.

- Masukkan pertanyaan atau permintaan Anda ke dalam kolom konten—inilah yang akan ditanggapi oleh model.

- Memproses respons API untuk mendapatkan jawaban yang dihasilkan.

CometAPI menyediakan REST API yang sepenuhnya kompatibel—untuk migrasi yang lancar. Detail penting untuk Obrolan dan Responses:

- URL dasar: https://api.cometapi.com/v1/chat/completions / https://api.cometapi.com/v1/responses

- Nama Model:

gpt-5.1 - Otentikasi:

Bearer YOUR_CometAPI_API_KEYHeader - Jenis konten:

application/json.

Lihat juga gpt-5.1-chat-latest (GPT-5.1 Instan) API