Seri GLM-4.5, yang dikembangkan oleh Zhipu AI (Z.ai), merupakan kemajuan signifikan dalam model bahasa besar (LLM) sumber terbuka. Dirancang untuk menyatukan kemampuan penalaran, pengodean, dan agen, GLM-4.5 menawarkan kinerja yang tangguh di berbagai aplikasi. Baik Anda seorang pengembang, peneliti, maupun penggemar, panduan ini memberikan informasi detail tentang cara mengakses dan memanfaatkan seri GLM-4.5 secara efektif.

Apa Seri GLM-4.5 dan Mengapa Itu Penting?

GLM-4.5 adalah model penalaran hibrida yang menggabungkan dua mode berbeda: "mode berpikir" untuk penalaran kompleks dan penggunaan alat, dan "mode non-berpikir" untuk respons langsung. Pendekatan mode ganda ini memungkinkan model untuk menangani beragam tugas secara efisien. Seri ini mencakup dua varian utama:

- GLM-4.5: Menampilkan total 355 miliar parameter dengan 32 miliar parameter aktif, model ini dirancang untuk penerapan skala besar di seluruh tugas penalaran, pembangkitan, dan multi-agen.

- GLM-4.5-Udara: Versi ringan dengan total 106 miliar parameter dan 12 miliar parameter aktif, dioptimalkan untuk inferensi cloud pada perangkat dan skala yang lebih kecil tanpa mengorbankan kemampuan inti.

Kedua model mendukung mode penalaran hibrida, menawarkan mode "berpikir" dan "tidak berpikir" untuk menyeimbangkan tugas penalaran kompleks dan respons cepat. Model-model ini bersifat sumber terbuka dan dirilis di bawah lisensi MIT, sehingga dapat diakses untuk penggunaan komersial dan pengembangan sekunder.

Prinsip Arsitektur dan Desain

Pada intinya, GLM-4.5 memanfaatkan MoE untuk merutekan token secara dinamis melalui sub-jaringan pakar khusus, yang memungkinkan efisiensi parameter dan perilaku penskalaan yang unggul (). Pendekatan ini berarti lebih sedikit parameter yang perlu diaktifkan per penerusan, sehingga menurunkan biaya operasional sekaligus mempertahankan kinerja mutakhir pada tugas penalaran dan pengkodean ().

Kemampuan Utama

- Penalaran dan Pengkodean Hibrida: GLM-4.5 mendemonstrasikan kinerja SOTA pada tolok ukur pemahaman bahasa alami dan pengujian pembuatan kode, yang seringkali menyaingi model hak milik dalam hal akurasi dan kelancaran.

- Integrasi Agen:Antarmuka pemanggilan alat bawaan memungkinkan GLM-4.5 untuk mengatur alur kerja multi-langkah—seperti kueri basis data, orkestrasi API, dan pembuatan front-end interaktif—dalam satu sesi.

- Artefak Multi-Modal:Dari aplikasi mini HTML/CSS hingga simulasi berbasis Python dan SVG interaktif, GLM-4.5 dapat menghasilkan artefak yang berfungsi penuh, meningkatkan keterlibatan pengguna dan produktivitas pengembang.

Mengapa GLM-4.5 merupakan Pengubah Permainan?

GLM-4.5 telah dipuji bukan hanya karena kinerjanya yang luar biasa tetapi juga karena mendefinisikan ulang proposisi nilai LLM sumber terbuka di lingkungan perusahaan dan penelitian.

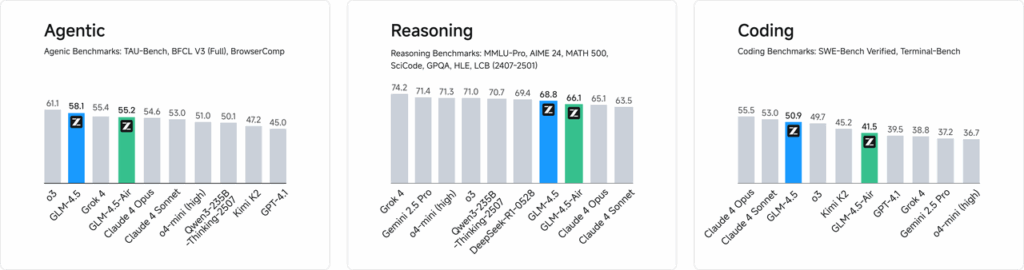

Tolok Ukur Kinerja

Dalam evaluasi independen terhadap 52 tugas pemrograman—yang mencakup pengembangan web, analisis data, dan otomatisasi—GLM-4.5 secara konsisten mengungguli model sumber terbuka terkemuka lainnya dalam hal keandalan pemanggilan alat dan penyelesaian tugas secara keseluruhan. Dalam uji perbandingan dengan Claude Code, Kimi-K2, dan Qwen3-Coder, GLM-4.5 meraih skor terbaik di kelasnya pada tolok ukur seperti papan peringkat "SWE-bench Verified".

Penghematan biaya

Selain akurasi, desain MoE GLM-4.5 menurunkan biaya inferensi secara drastis. Harga publik untuk panggilan API mulai dari RMB 0.8 per juta token input dan RMB 2 per juta token output—sekitar sepertiga biaya penawaran proprietary yang sebanding. Dipadukan dengan kecepatan pembangkitan puncak 100 token/detik, model ini mendukung penerapan throughput tinggi dan latensi rendah tanpa biaya yang mahal.

Bagaimana Anda Dapat Mengakses GLM-4.5?

1. Akses Langsung melalui Platform Z.ai

Cara termudah untuk berinteraksi dengan GLM-4.5 adalah melalui platform Z.ai. Dengan mengunjungi chat.z.aiPengguna dapat memilih model GLM-4.5 dan mulai berinteraksi melalui antarmuka yang ramah pengguna. Platform ini memungkinkan pengujian dan pembuatan prototipe secara langsung tanpa perlu integrasi yang rumit. Pengguna dapat memilih model GLM-4.5 atau GLM-4.5-Air dari pojok kiri atas dan langsung memulai obrolan. Antarmuka ini ramah pengguna dan tidak memerlukan pengaturan, sehingga ideal untuk interaksi dan demonstrasi cepat.

2. Akses API untuk Pengembang

Bagi pengembang yang ingin mengintegrasikan GLM-4.5 ke dalam aplikasi, platform API Z.ai menyediakan dukungan komprehensif. API ini menawarkan antarmuka yang kompatibel dengan OpenAI untuk model GLM-4.5 dan GLM-4.5-Air, sehingga memudahkan integrasi yang lancar ke dalam alur kerja yang sudah ada. Dokumentasi detail dan panduan integrasi tersedia di Dokumentasi API Z.ai .

3. Penerapan Sumber Terbuka

Bagi mereka yang tertarik dengan penerapan lokal, model GLM-4.5 tersedia di platform seperti Hugging Face dan ModelScope. Model-model ini dirilis di bawah lisensi sumber terbuka MIT, yang memungkinkan penggunaan komersial dan pengembangan sekunder. Model-model ini dapat diintegrasikan dengan kerangka kerja inferensi arus utama seperti vLLM dan SGLang.

4. Integrasi dengan CometAPI

API Komet menawarkan akses yang efisien ke model GLM-4.5 melalui platform API terpadu mereka di Papan DasborIntegrasi ini menyederhanakan autentikasi, pembatasan laju, dan penanganan kesalahan, menjadikannya pilihan yang sangat baik bagi pengembang yang menginginkan pengaturan yang mudah. Selain itu, format API standar CometAPI memungkinkan peralihan model dan pengujian A/B yang mudah antara GLM-4.5 dan model lain yang tersedia.

Bagaimana Pengembang Dapat Mengakses Seri GLM-4.5?

Ada beberapa saluran untuk memperoleh dan menerapkan GLM-4.5, dari pengunduhan model langsung hingga API yang dikelola.

Melalui Hugging Face dan ModelScope

Baik Hugging Face maupun ModelScope menghosting seri GLM-4.5 lengkap di bawah namespace zai-org. Setelah menyetujui lisensi MIT, pengembang dapat:

- Kloning Repositori:

git clone https://huggingface.co/zai-org/GLM-4.5

- Instal Ketergantungan:

pip install transformers accelerate

- Muat Modelnya:

from transformers import AutoModelForCausalLM, AutoTokenizer

tokenizer = AutoTokenizer.from_pretrained("zai-org/GLM-4.5")

model = AutoModelForCausalLM.from_pretrained("zai-org/GLM-4.5")

``` :contentReference{index=15}.

Melalui CometAPI

API Komet menyediakan API tanpa server untuk GLM‑4.5 dan GLM-4.5 Air API dengan tarif per token, dapat diakses melalui, dengan mengonfigurasi titik akhir yang kompatibel dengan OpenAI, Anda dapat memanggil GLM-4.5 melalui klien Python OpenAI dengan penyesuaian minimal pada basis kode yang ada. CometAPI tidak hanya menyediakan GLM4.5 dan GLM-4.5-air tetapi juga semua model resmi:

| Nama model | memperkenalkan | Harga |

glm-4.5 | Model penalaran kita yang paling kuat, dengan 355 miliar parameter | Token Masukan $0.48 Token Keluaran $1.92 |

glm-4.5-air | Hemat Biaya Ringan Performa Kuat | Token Masukan $0.16 Token Keluaran $1.07 |

glm-4.5-x | Performa Tinggi Penalaran Kuat Respons Sangat Cepat | Token Masukan $1.60 Token Keluaran $6.40 |

glm-4.5-airx | Ringan, Performa Kuat, Respons Sangat Cepat | Token Masukan $0.02 Token Keluaran $0.06 |

glm-4.5-flash | Performa Kuat Sangat Baik untuk Penalaran Coding & Agen | Token Masukan $3.20 Token Keluaran $12.80 |

Integrasi Python dan REST API

Untuk penerapan yang disesuaikan, organisasi dapat menghosting GLM-4.5 pada kluster GPU khusus menggunakan Docker atau Kubernetes. Pengaturan RESTful yang umum meliputi:

Meluncurkan Server Inferensi:

bashdocker run -p 8000:8000 zai-org/glm-4.5:latest

Mengirim Permintaan:

bashcurl -X POST http://localhost:8000/generate \ -H "Content-Type: application/json" \ -d '{"prompt": "Translate to French: Hello.", "max_tokens": 50}' Responses conform to the JSON formats used by popular LLM APIs .

Apa Praktik Terbaik untuk Mengintegrasikan GLM-4.5 dalam Aplikasi?

Untuk memaksimalkan ROI dan memastikan kinerja yang kuat, tim harus mempertimbangkan hal berikut:

Optimasi API dan Batasan Kecepatan

- Permintaan Batch: Kelompokkan perintah serupa untuk mengurangi overhead dan memanfaatkan throughput GPU.

- Menyimpan Kueri Umum dalam Cache: Simpan pelengkapan yang sering secara lokal untuk menghindari panggilan inferensi yang berlebihan.

- Pengambilan Sampel Adaptif: Menyesuaikan secara dinamis

temperaturedantop_pberdasarkan kompleksitas kueri untuk menyeimbangkan kreativitas dan determinisme.

Keamanan dan Kepatuhan

- Sanitasi Data: : Praproses input untuk menghilangkan informasi sensitif sebelum mengirimnya ke model.

- Access Control: Terapkan kunci API, daftar putih IP, dan pembatasan kecepatan untuk mencegah penyalahgunaan dan penyalahgunaan.

- Pencatatan Audit: Catat perintah, penyelesaian, dan metadata untuk kepatuhan terhadap persyaratan perusahaan dan peraturan, terutama dalam konteks keuangan atau perawatan kesehatan.

Mulai

CometAPI adalah platform API terpadu yang menggabungkan lebih dari 500 model AI dari penyedia terkemuka—seperti seri GPT OpenAI, Gemini Google, Claude Anthropic, Midjourney, Suno, dan lainnya—menjadi satu antarmuka yang ramah bagi pengembang. Dengan menawarkan autentikasi yang konsisten, pemformatan permintaan, dan penanganan respons, CometAPI secara drastis menyederhanakan integrasi kapabilitas AI ke dalam aplikasi Anda. Baik Anda sedang membangun chatbot, generator gambar, komposer musik, atau alur kerja analitik berbasis data, CometAPI memungkinkan Anda melakukan iterasi lebih cepat, mengendalikan biaya, dan tetap tidak bergantung pada vendor—semuanya sambil memanfaatkan terobosan terbaru di seluruh ekosistem AI.

Bagi para pengembang yang ingin mengintegrasikan GLM-4.5 ke dalam aplikasi mereka, platform CometAPI menawarkan solusi yang tangguh. API ini menyediakan antarmuka yang kompatibel dengan OpenAI, memungkinkan integrasi yang mulus ke dalam alur kerja yang sudah ada. Dokumentasi dan panduan penggunaan yang terperinci tersedia di Halaman API Comet.

Pengembang dapat mengakses GLM‑4.5 dan GLM-4.5 Air API melalui API Komet, versi model terbaru yang tercantum adalah versi per tanggal publikasi artikel. Untuk memulai, jelajahi kemampuan model di tempat bermain dan konsultasikan Panduan API untuk petunjuk terperinci. Sebelum mengakses, pastikan Anda telah masuk ke CometAPI dan memperoleh kunci API. API Komet menawarkan harga yang jauh lebih rendah dari harga resmi untuk membantu Anda berintegrasi.

Kesimpulan

GLM-4.5 merupakan kemajuan signifikan di bidang model bahasa besar, menawarkan solusi serbaguna untuk berbagai aplikasi. Arsitektur penalaran hibridanya, kapabilitas agen, dan sifatnya yang bersifat sumber terbuka menjadikannya pilihan menarik bagi pengembang dan organisasi yang ingin memanfaatkan teknologi AI canggih. Dengan menjelajahi berbagai metode akses yang diuraikan dalam panduan ini, pengguna dapat mengintegrasikan GLM-4.5 secara efektif ke dalam proyek mereka dan berkontribusi pada pengembangannya yang berkelanjutan.